Estadstica 2011 Maestra en Finanzas Universidad del CEMA

- Slides: 43

Estadística 2011 Maestría en Finanzas Universidad del CEMA Profesor: Alberto Landro Asistente: Julián R. Siri

Clase 9 1. Procesos AR(1) 2. Procesos AR(1) no estacionarios 3. Procesos AR(2) 4. Procesos MA(1) 5. Procesos MA(2) 6. Estacionariedad e Invertibilidad 7. Procesos ARMA(p, q)

1. Procesos AR(1) • Vamos a analizar los procesos autorregresivos, que son aquellos procesos estocásticos que, en mayor medida, pueden ser explicados por su propia historia. • Decíamos que un proceso que “no tiene memoria” es un proceso autorregresivo de orden 0. Teóricamente nuestro ruido blanco será un proceso AR(0), ya que cada observación presente no estará influida por ninguna observación del pasado.

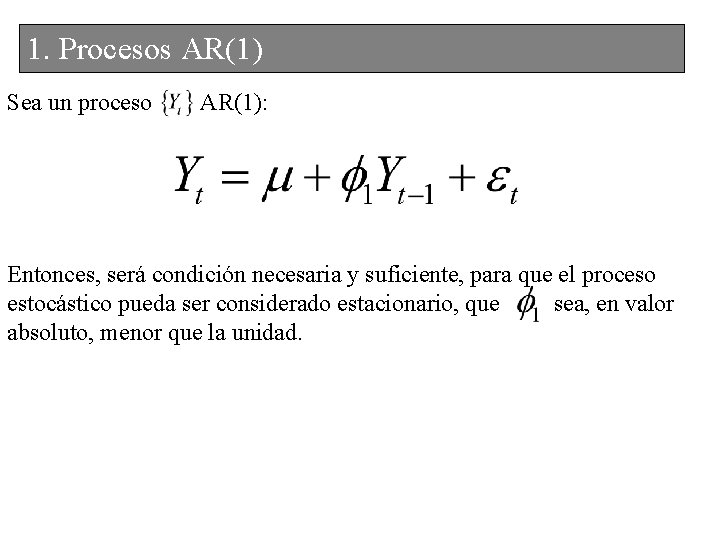

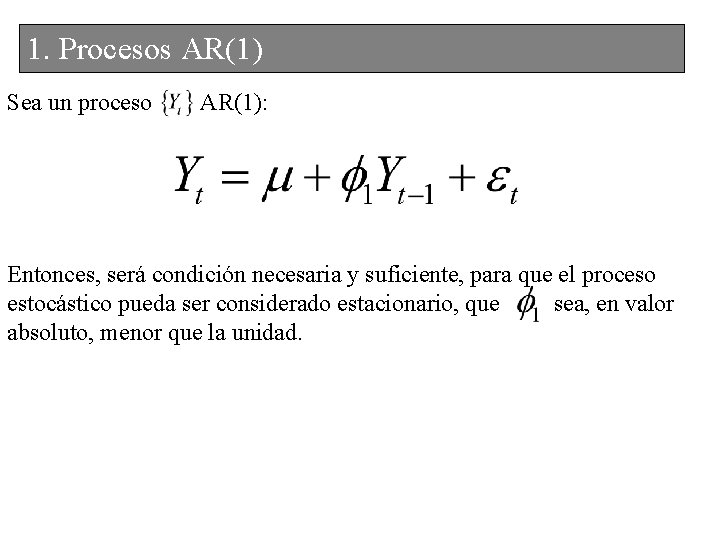

1. Procesos AR(1) Sea un proceso AR(1): Entonces, será condición necesaria y suficiente, para que el proceso estocástico pueda ser considerado estacionario, que sea, en valor absoluto, menor que la unidad.

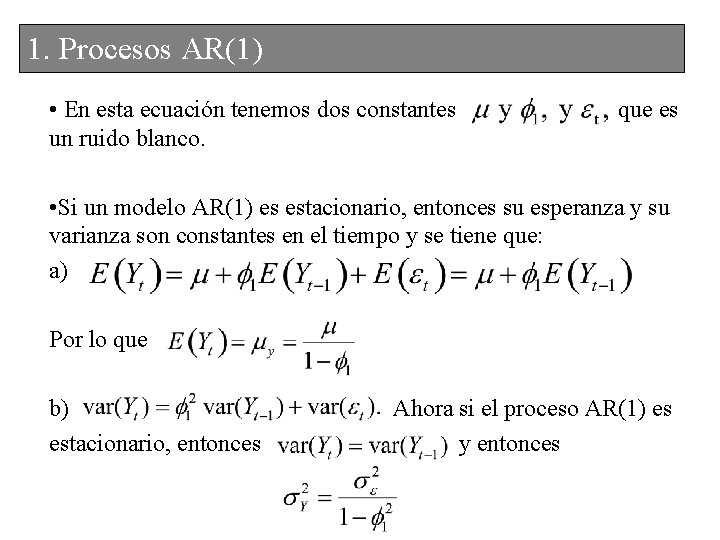

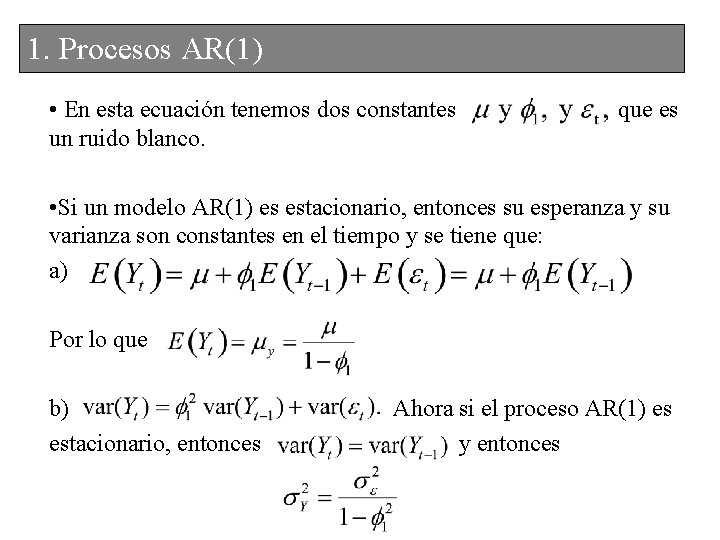

1. Procesos AR(1) • En esta ecuación tenemos dos constantes un ruido blanco. que es • Si un modelo AR(1) es estacionario, entonces su esperanza y su varianza son constantes en el tiempo y se tiene que: a) Por lo que b) estacionario, entonces Ahora si el proceso AR(1) es y entonces

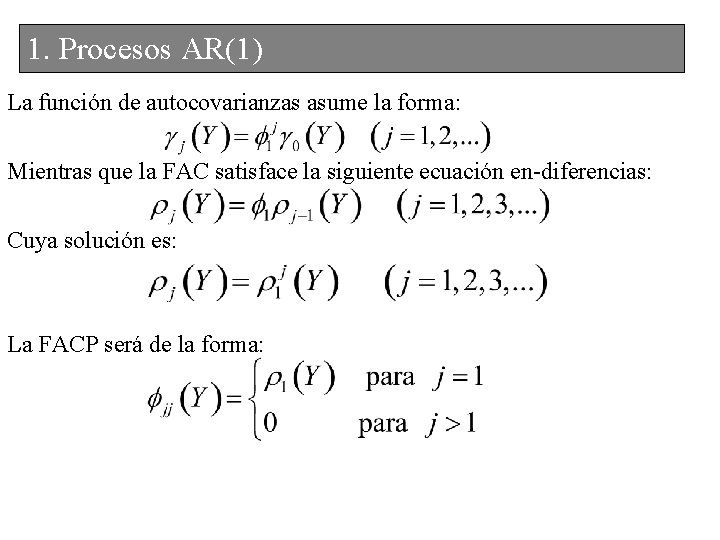

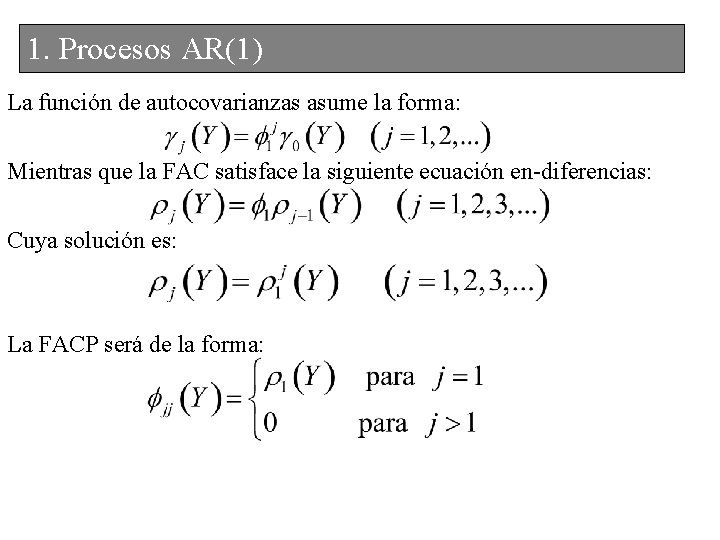

1. Procesos AR(1) La función de autocovarianzas asume la forma: Mientras que la FAC satisface la siguiente ecuación en-diferencias: Cuya solución es: La FACP será de la forma:

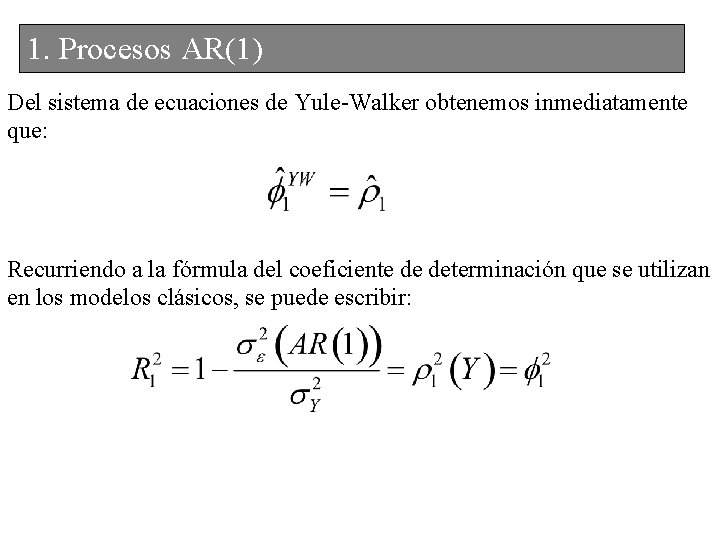

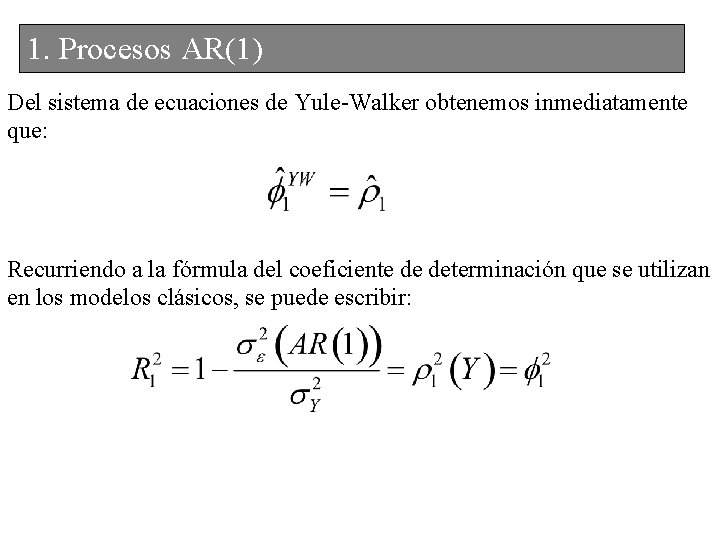

1. Procesos AR(1) Del sistema de ecuaciones de Yule-Walker obtenemos inmediatamente que: Recurriendo a la fórmula del coeficiente de determinación que se utilizan en los modelos clásicos, se puede escribir:

1. Procesos AR(1) • Aunque el interes se centra generalmente en los procesos estocáticos estacionarios, es util analizar algun proceso no estacionario. El Random Walk o Caminata Aleatoria es uno generalmente estudiado. A menudo se modela el precio de las acciones y de tipos de cambio como un random walk. • A continuación vamos a distinguir entre dos tipos de caminatas aleatorias: sin variaciones (es decir sin término constante) y con variaciones (con termino constante).

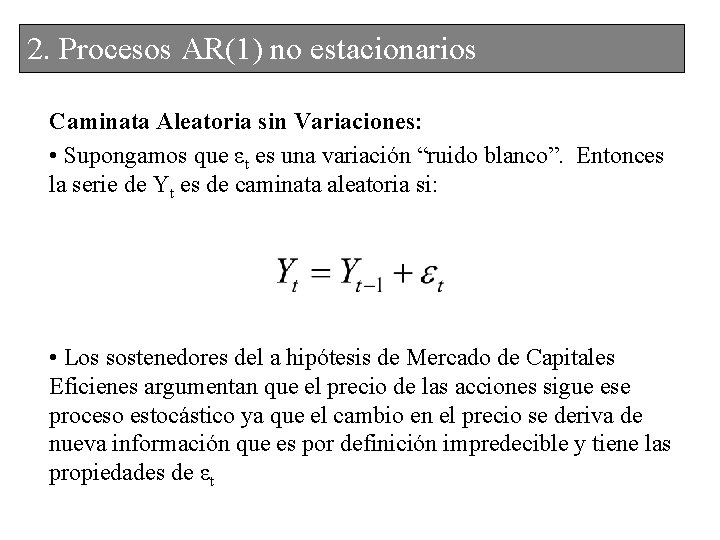

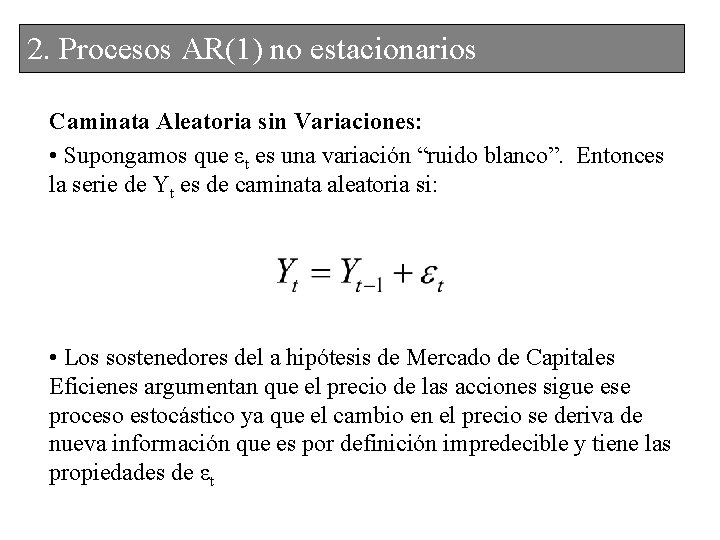

2. Procesos AR(1) no estacionarios Caminata Aleatoria sin Variaciones: • Supongamos que εt es una variación “ruido blanco”. Entonces la serie de Yt es de caminata aleatoria si: • Los sostenedores del a hipótesis de Mercado de Capitales Eficienes argumentan que el precio de las acciones sigue ese proceso estocástico ya que el cambio en el precio se deriva de nueva información que es por definición impredecible y tiene las propiedades de εt

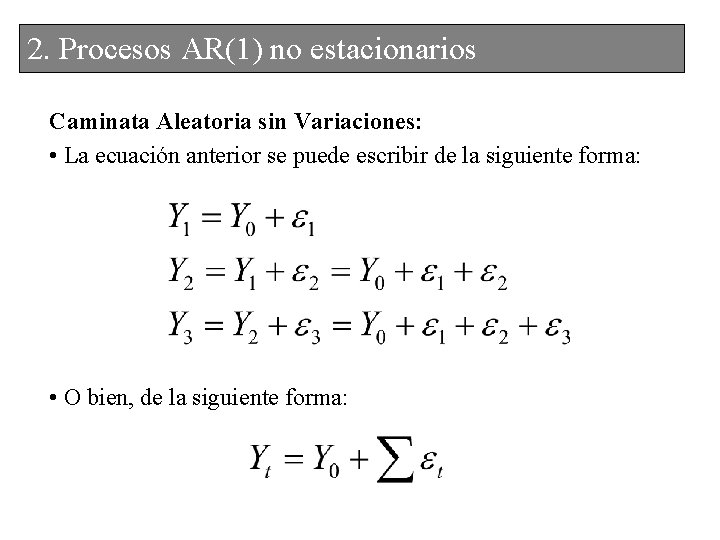

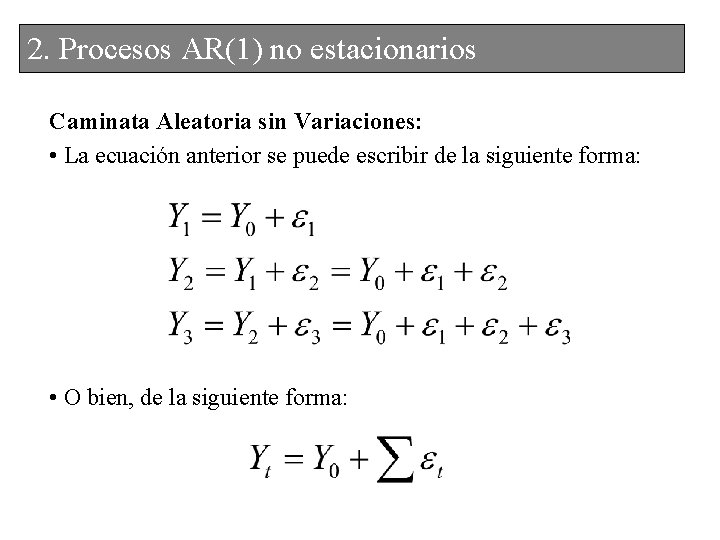

2. 2. Procesos. AR(1)nonoestacionarios Caminata Aleatoria sin Variaciones: • La ecuación anterior se puede escribir de la siguiente forma: • O bien, de la siguiente forma:

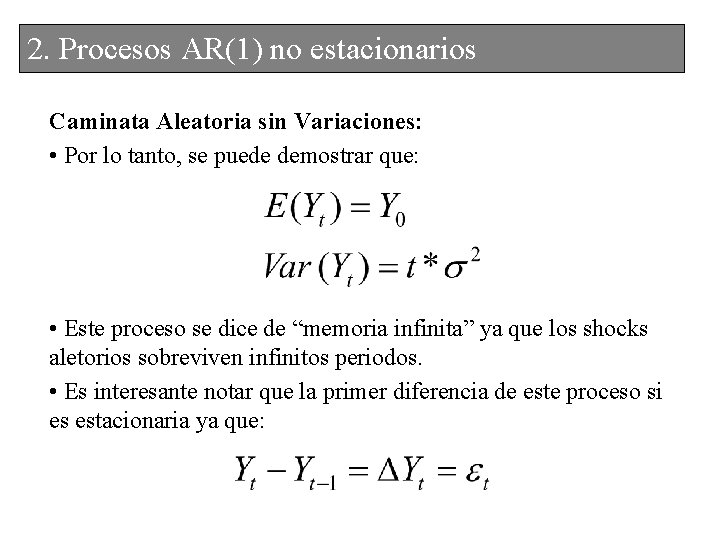

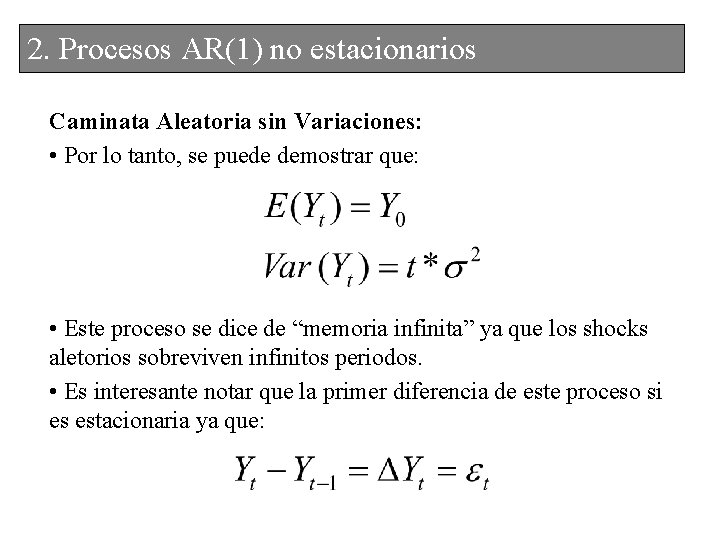

2. 2. Procesos. AR(1)nonoestacionarios Caminata Aleatoria sin Variaciones: • Por lo tanto, se puede demostrar que: • Este proceso se dice de “memoria infinita” ya que los shocks aletorios sobreviven infinitos periodos. • Es interesante notar que la primer diferencia de este proceso si es estacionaria ya que:

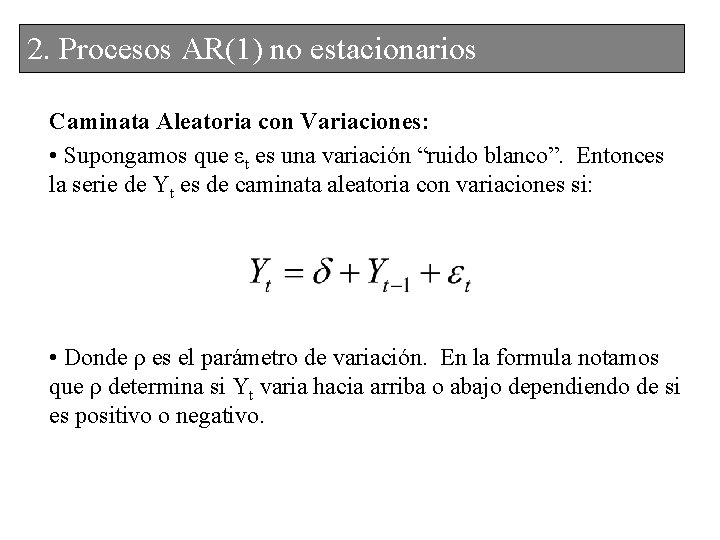

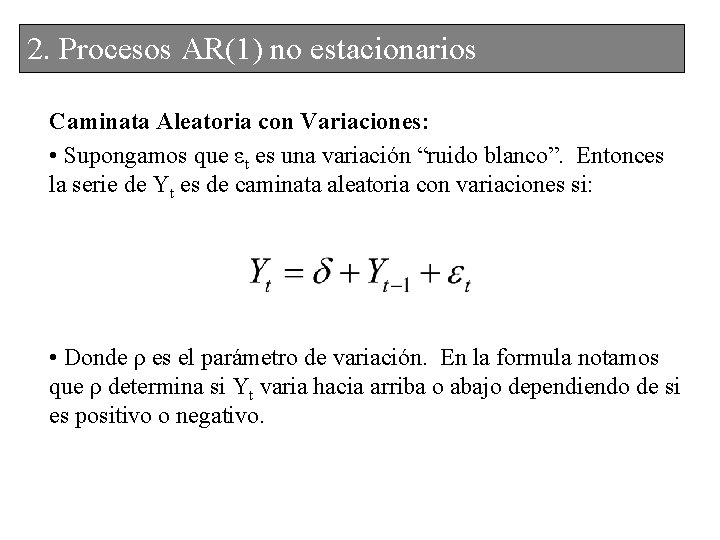

2. 2. Procesos. AR(1)nonoestacionarios Caminata Aleatoria con Variaciones: • Supongamos que εt es una variación “ruido blanco”. Entonces la serie de Yt es de caminata aleatoria con variaciones si: • Donde ρ es el parámetro de variación. En la formula notamos que ρ determina si Yt varia hacia arriba o abajo dependiendo de si es positivo o negativo.

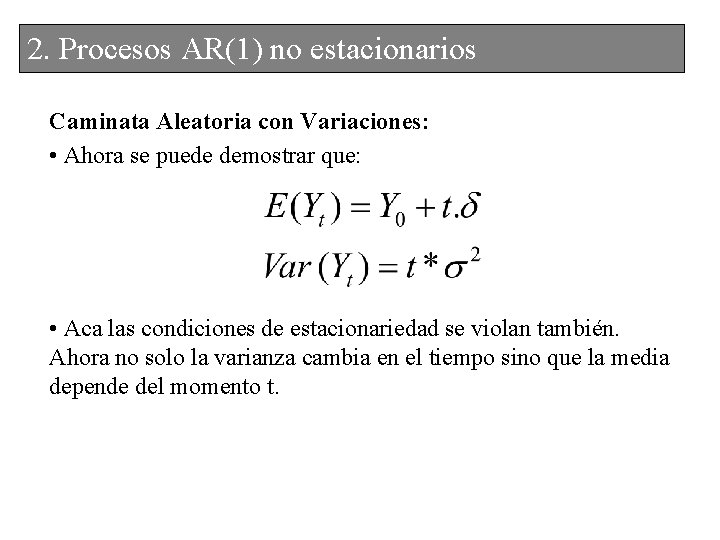

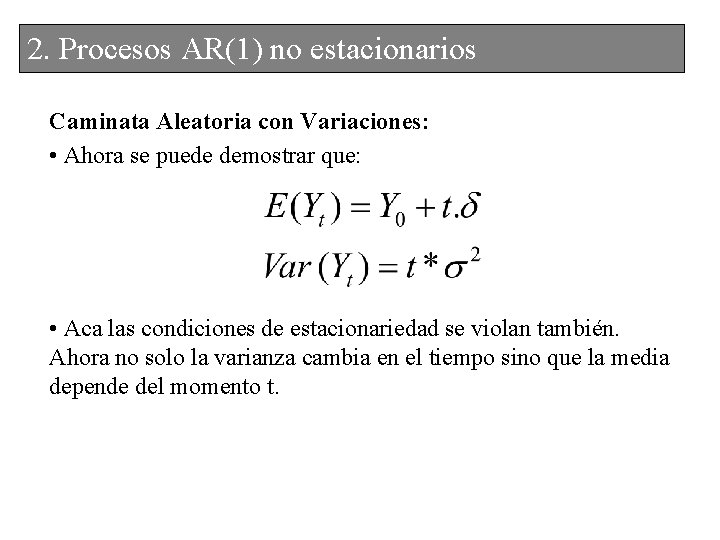

2. 2. Procesos. AR(1)nonoestacionarios Caminata Aleatoria con Variaciones: • Ahora se puede demostrar que: • Aca las condiciones de estacionariedad se violan también. Ahora no solo la varianza cambia en el tiempo sino que la media depende del momento t.

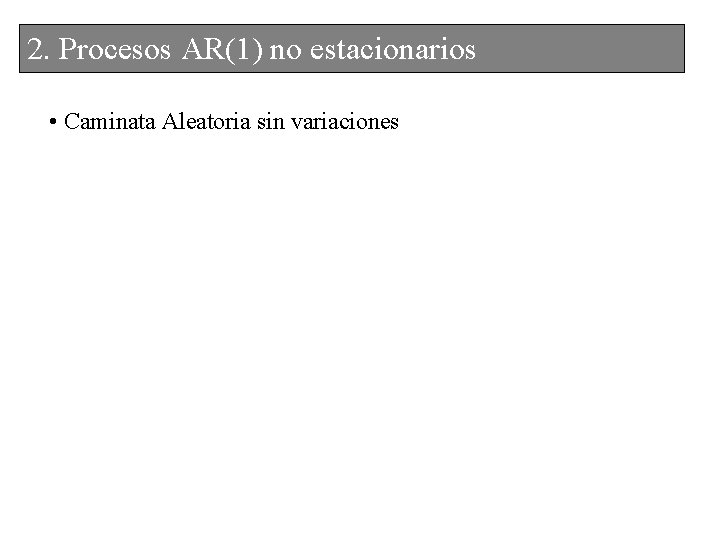

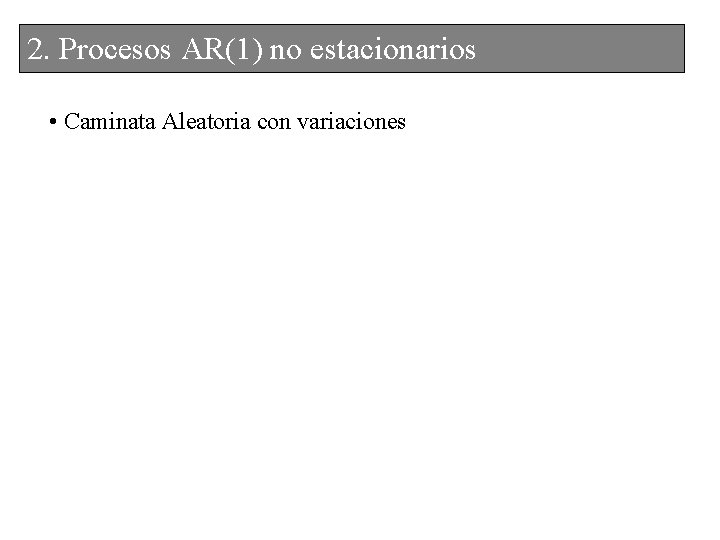

2. 2. Procesos. AR(1)nonoestacionarios • A continuación vamos a construir dos series Random Walk, una con variaciones y otro sin. • Para construir la serie sin variación se utilizó la formula correspondiente, se generaron 200 valores de εt y se supuso un Y inicial igual a 0. • Luego, para generar la serie con variación se utilizó la formula correspondiente, se tomaron los mismos 200 valores de εt , se tomo un δ=2 y también se partió de un Y inicial igual a 0.

2. 2. Procesos. AR(1)nonoestacionarios • Caminata Aleatoria sin variaciones

2. 2. Procesos. AR(1)nonoestacionarios • Caminata Aleatoria con variaciones

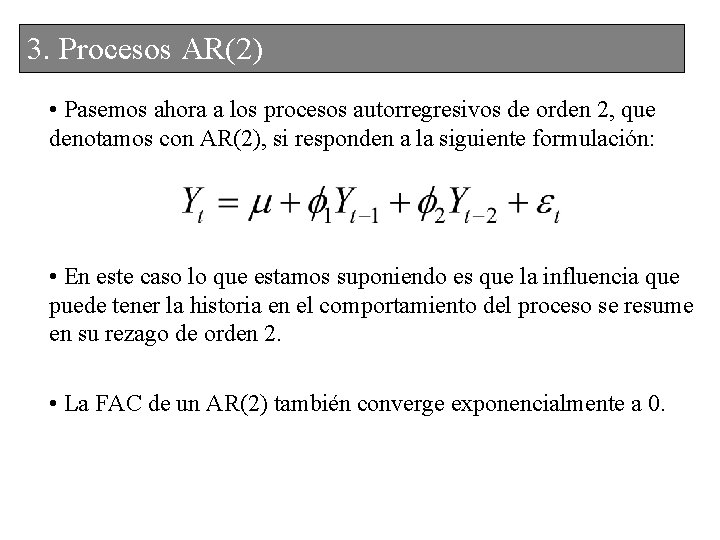

3. Procesos AR(2) • Pasemos ahora a los procesos autorregresivos de orden 2, que denotamos con AR(2), si responden a la siguiente formulación: • En este caso lo que estamos suponiendo es que la influencia que puede tener la historia en el comportamiento del proceso se resume en su rezago de orden 2. • La FAC de un AR(2) también converge exponencialmente a 0.

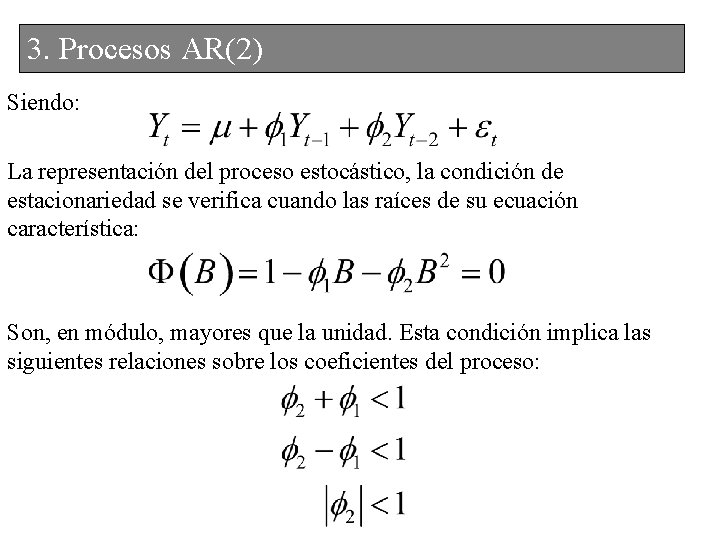

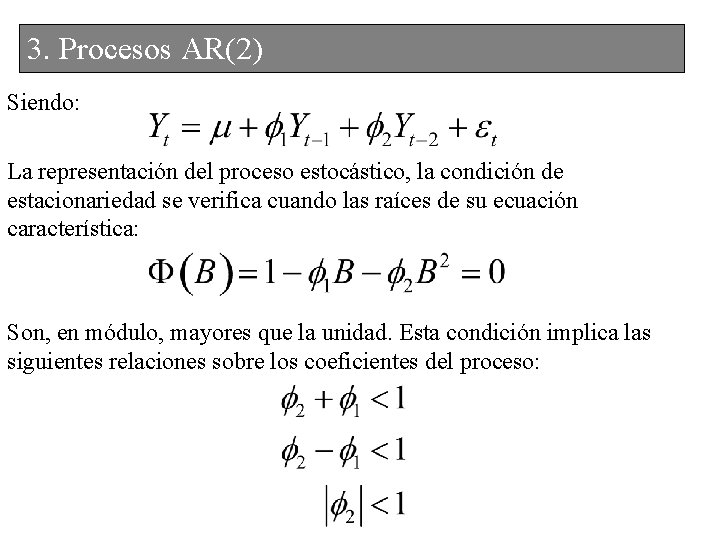

3. Procesos AR(2) Siendo: La representación del proceso estocástico, la condición de estacionariedad se verifica cuando las raíces de su ecuación característica: Son, en módulo, mayores que la unidad. Esta condición implica las siguientes relaciones sobre los coeficientes del proceso:

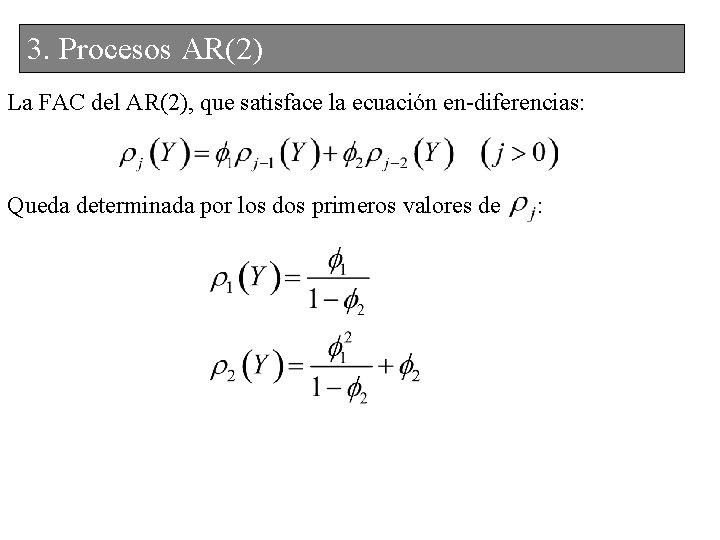

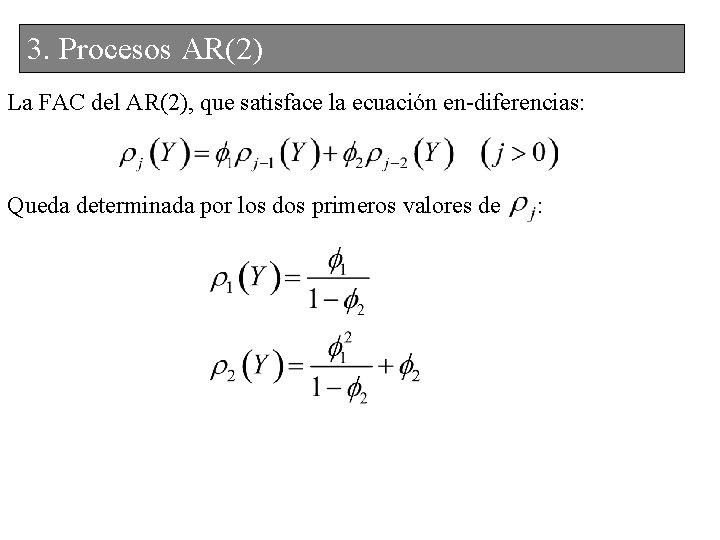

3. Procesos AR(2) La FAC del AR(2), que satisface la ecuación en-diferencias: Queda determinada por los dos primeros valores de :

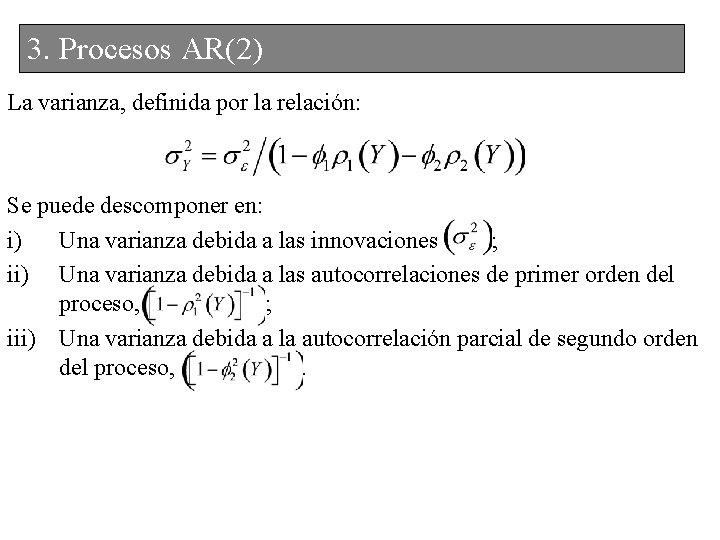

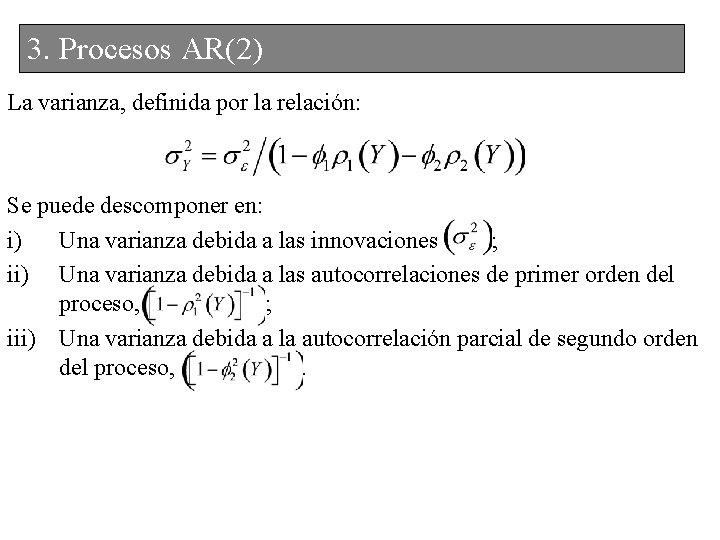

3. Procesos AR(2) La varianza, definida por la relación: Se puede descomponer en: i) Una varianza debida a las innovaciones ; ii) Una varianza debida a las autocorrelaciones de primer orden del proceso, ; iii) Una varianza debida a la autocorrelación parcial de segundo orden del proceso, .

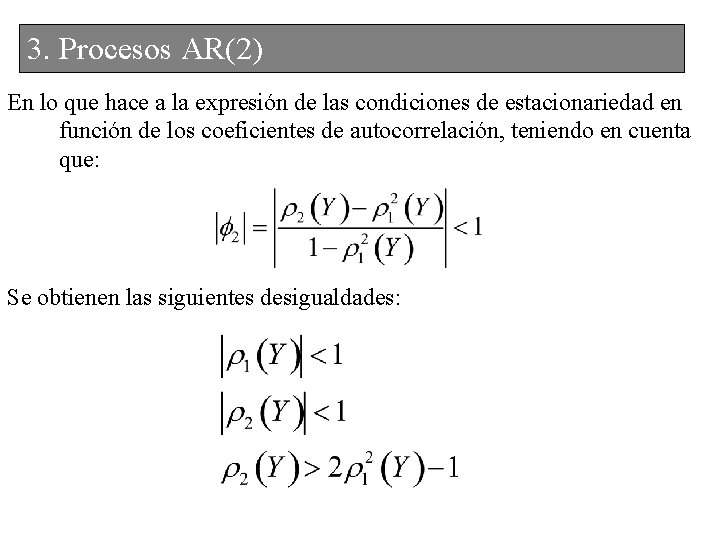

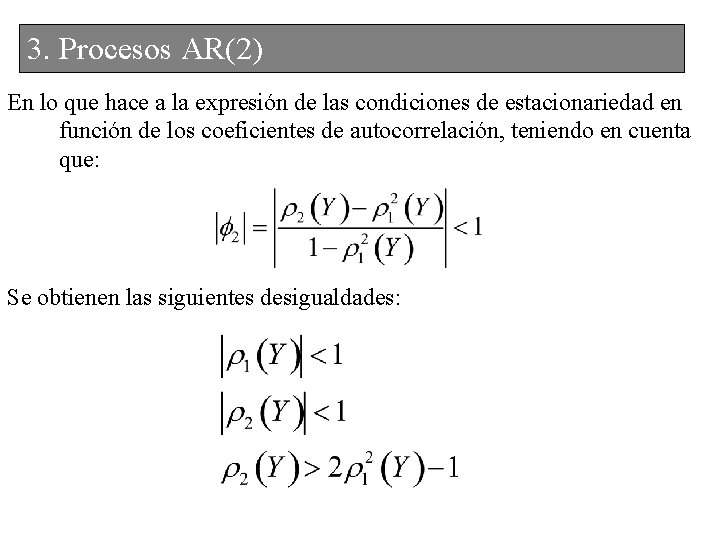

3. Procesos AR(2) En lo que hace a la expresión de las condiciones de estacionariedad en función de los coeficientes de autocorrelación, teniendo en cuenta que: Se obtienen las siguientes desigualdades:

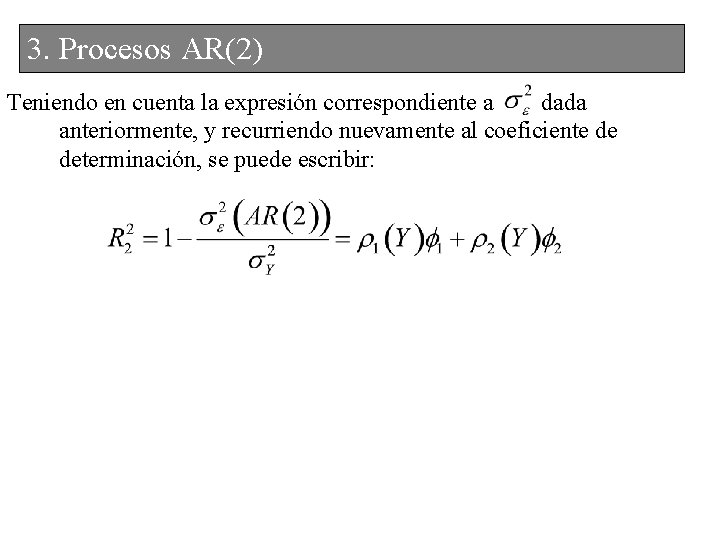

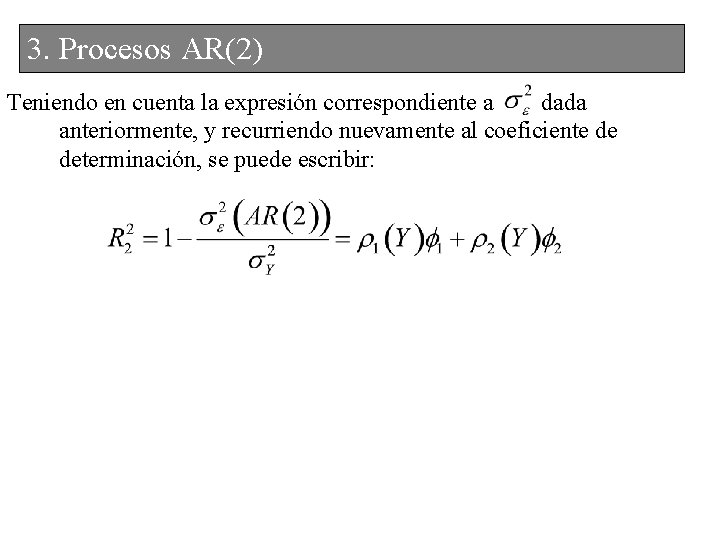

3. Procesos AR(2) Teniendo en cuenta la expresión correspondiente a dada anteriormente, y recurriendo nuevamente al coeficiente de determinación, se puede escribir:

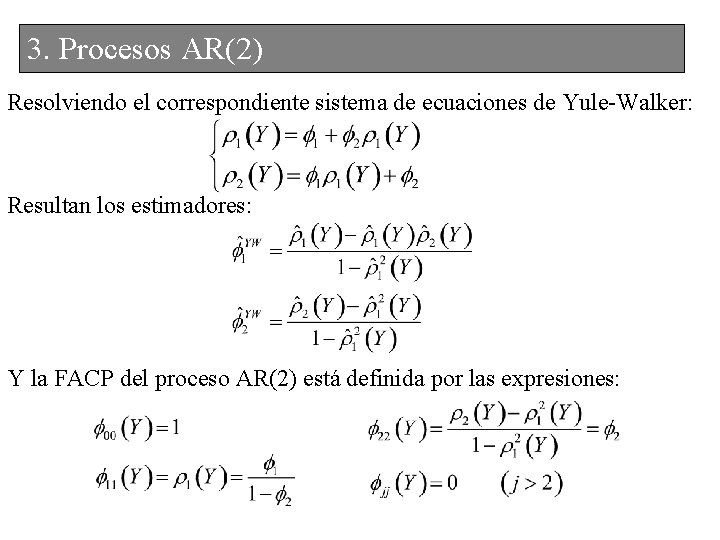

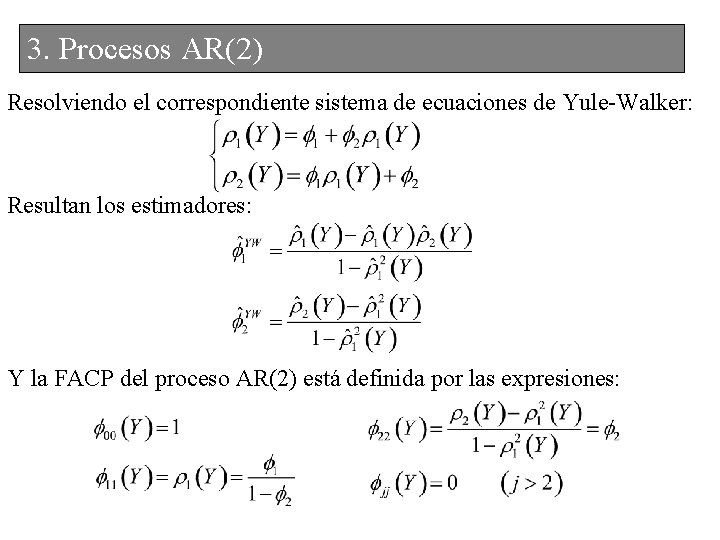

2. 3. Procesos AR(2) Resolviendo el correspondiente sistema de ecuaciones de Yule-Walker: Resultan los estimadores: Y la FACP del proceso AR(2) está definida por las expresiones:

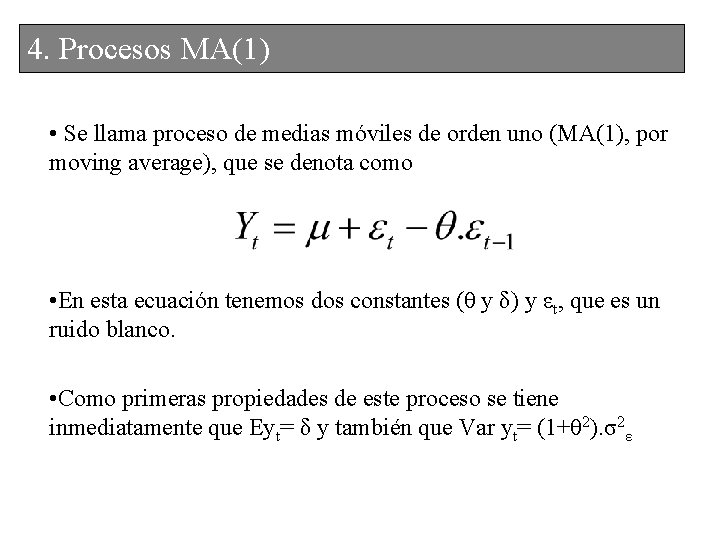

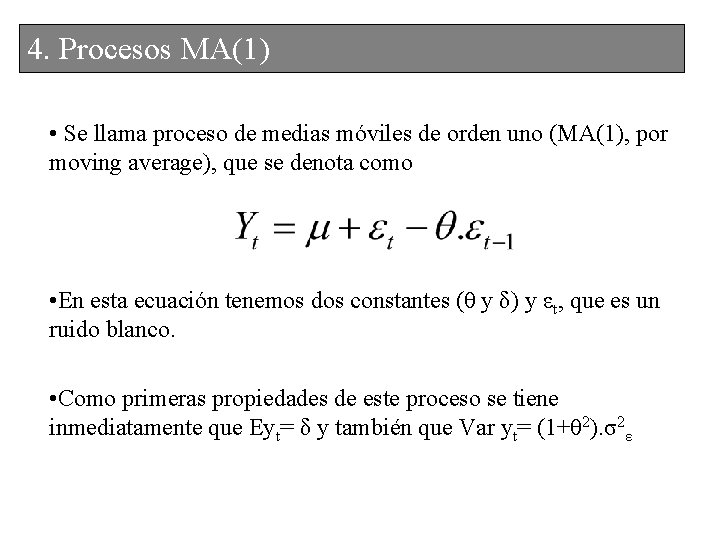

4. Procesos MA(1) • Se llama proceso de medias móviles de orden uno (MA(1), por moving average), que se denota como • En esta ecuación tenemos dos constantes (θ y δ) y εt, que es un ruido blanco. • Como primeras propiedades de este proceso se tiene inmediatamente que Eyt= δ y también que Var yt= (1+θ 2). σ2ε

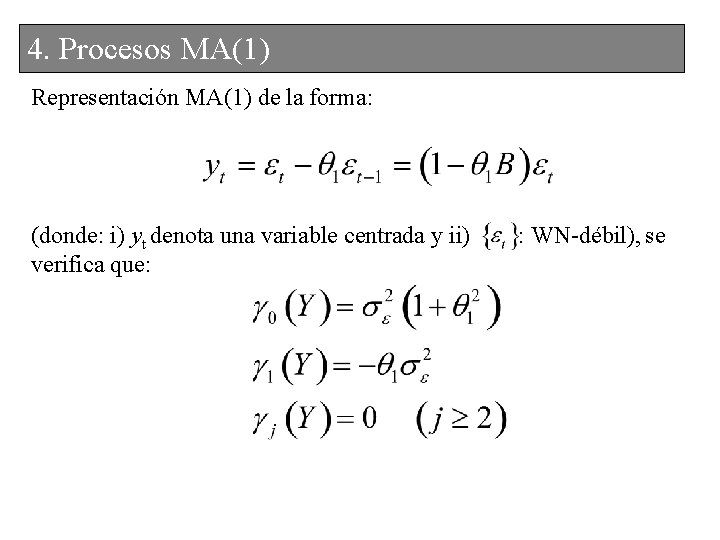

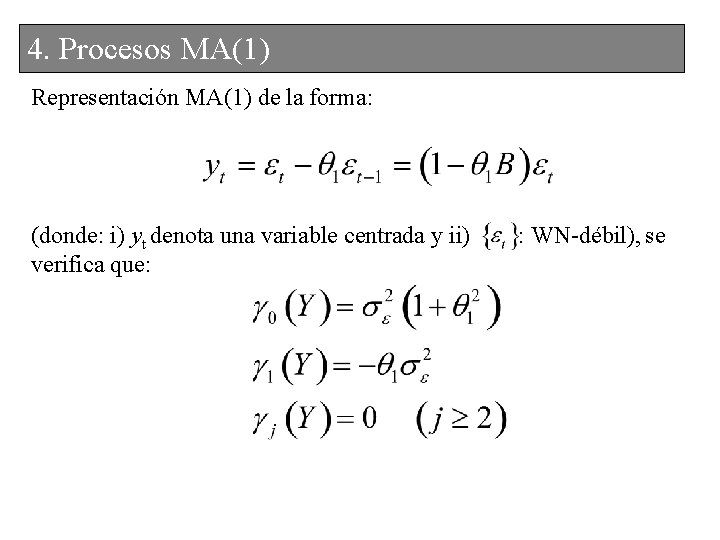

4. 3. Procesos. MA(1) Representación MA(1) de la forma: (donde: i) yt denota una variable centrada y ii) verifica que: : WN-débil), se

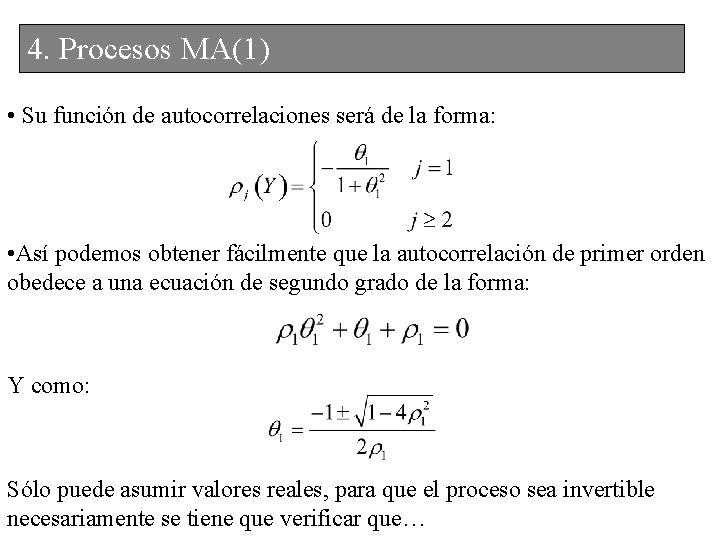

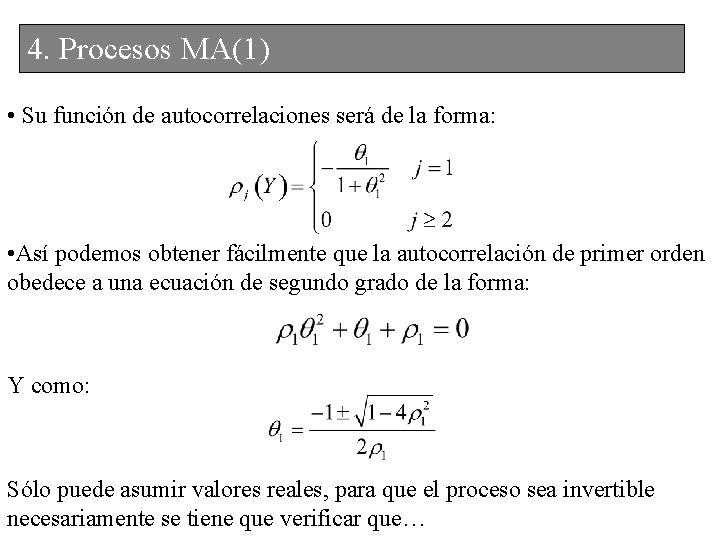

4. 3. Procesos. MA(1) • Su función de autocorrelaciones será de la forma: • Así podemos obtener fácilmente que la autocorrelación de primer orden obedece a una ecuación de segundo grado de la forma: Y como: Sólo puede asumir valores reales, para que el proceso sea invertible necesariamente se tiene que verificar que…

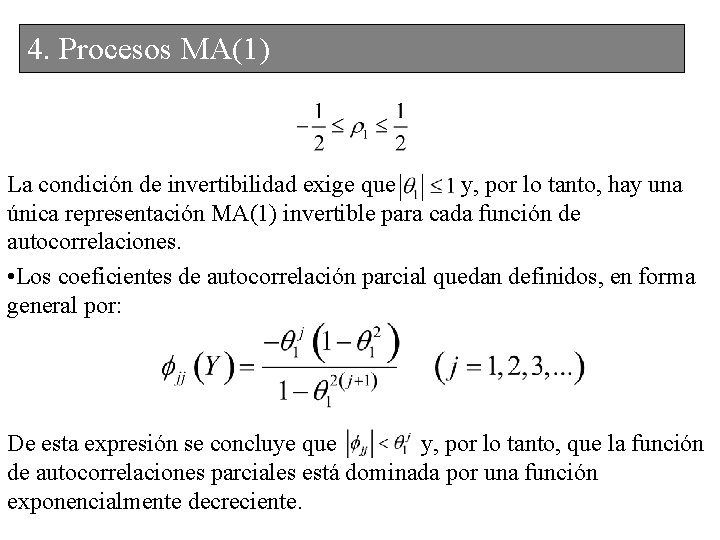

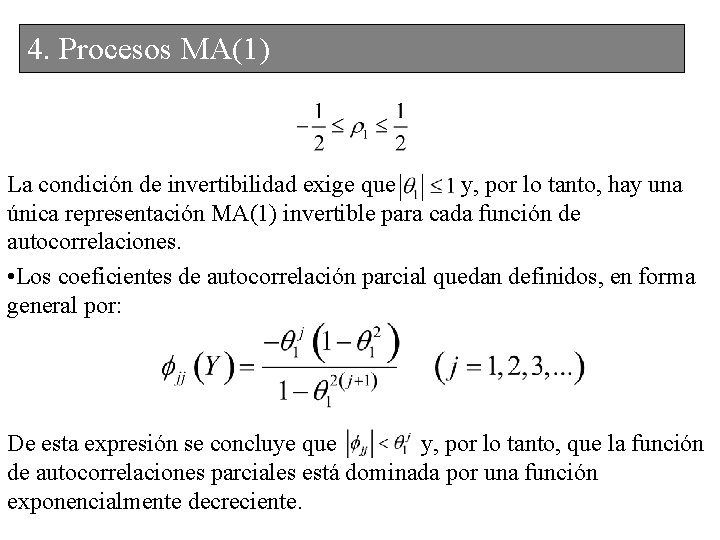

4. 3. Procesos. MA(1) La condición de invertibilidad exige que y, por lo tanto, hay una única representación MA(1) invertible para cada función de autocorrelaciones. • Los coeficientes de autocorrelación parcial quedan definidos, en forma general por: De esta expresión se concluye que y, por lo tanto, que la función de autocorrelaciones parciales está dominada por una función exponencialmente decreciente.

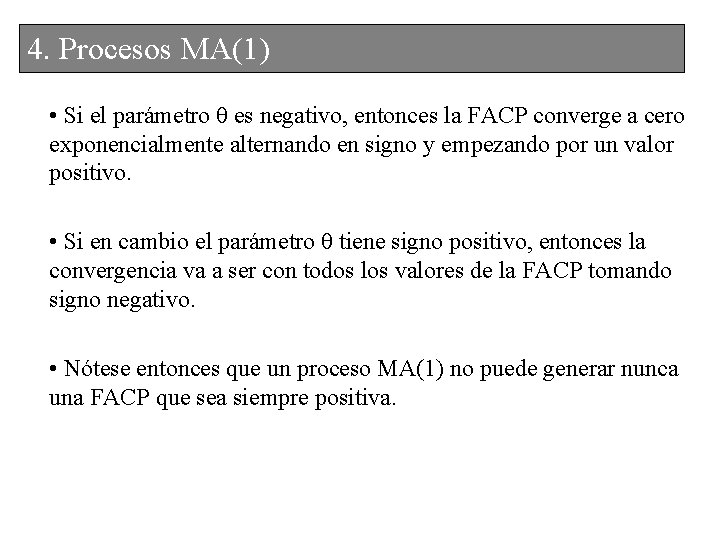

4. 3. Procesos. MA(1) • Si el parámetro θ es negativo, entonces la FACP converge a cero exponencialmente alternando en signo y empezando por un valor positivo. • Si en cambio el parámetro θ tiene signo positivo, entonces la convergencia va a ser con todos los valores de la FACP tomando signo negativo. • Nótese entonces que un proceso MA(1) no puede generar nunca una FACP que sea siempre positiva.

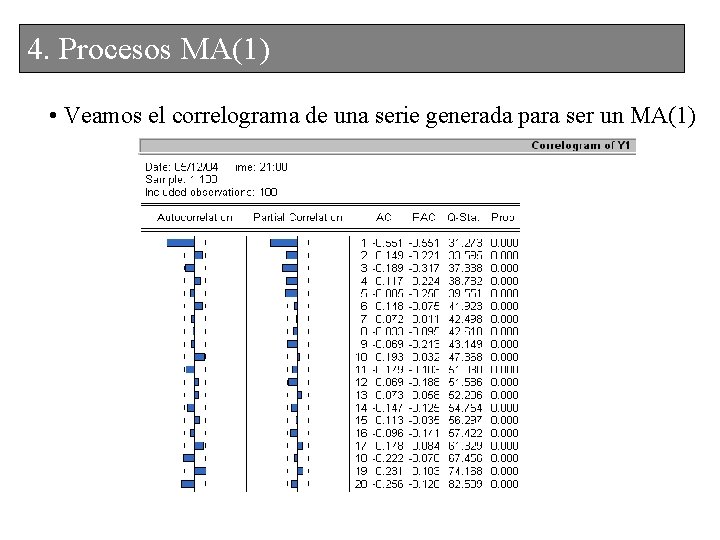

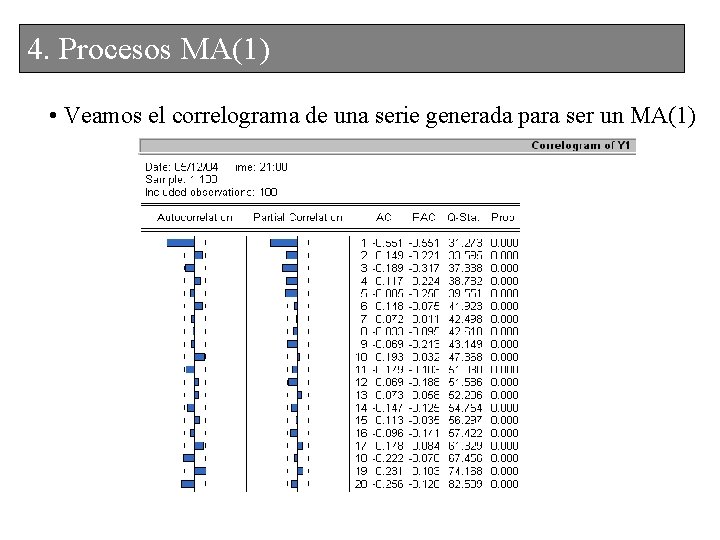

4. 3. Procesos. MA(1) • Veamos el correlograma de una serie generada para ser un MA(1)

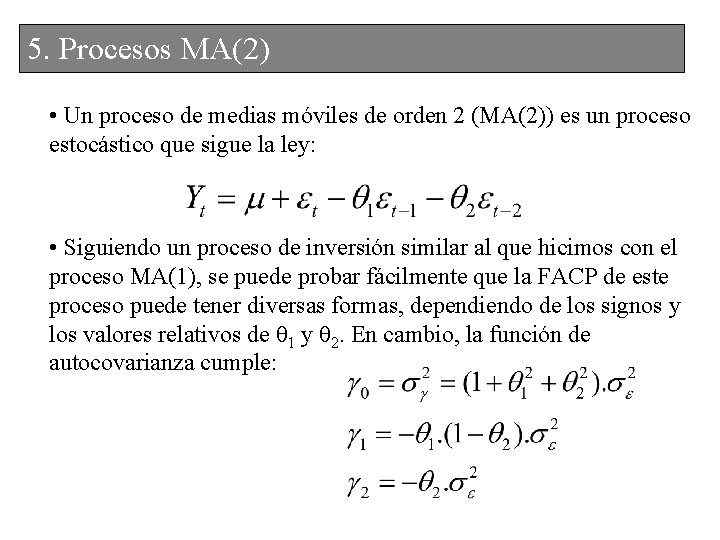

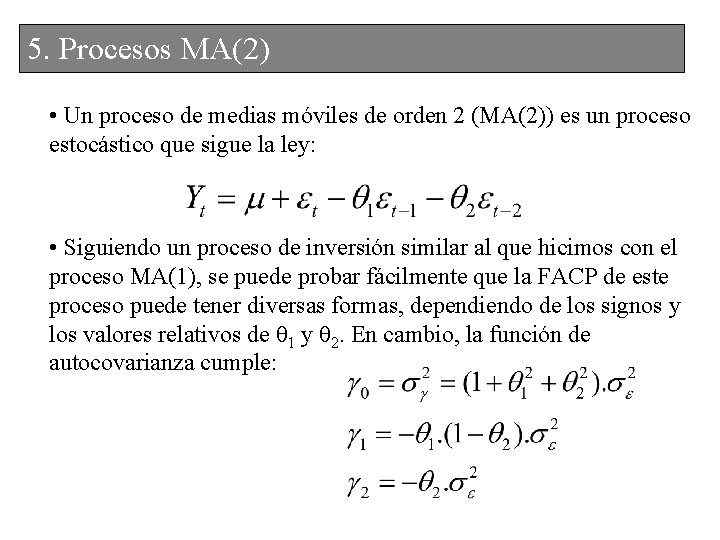

5. 4. Procesos. MA(2) • Un proceso de medias móviles de orden 2 (MA(2)) es un proceso estocástico que sigue la ley: • Siguiendo un proceso de inversión similar al que hicimos con el proceso MA(1), se puede probar fácilmente que la FACP de este proceso puede tener diversas formas, dependiendo de los signos y los valores relativos de θ 1 y θ 2. En cambio, la función de autocovarianza cumple:

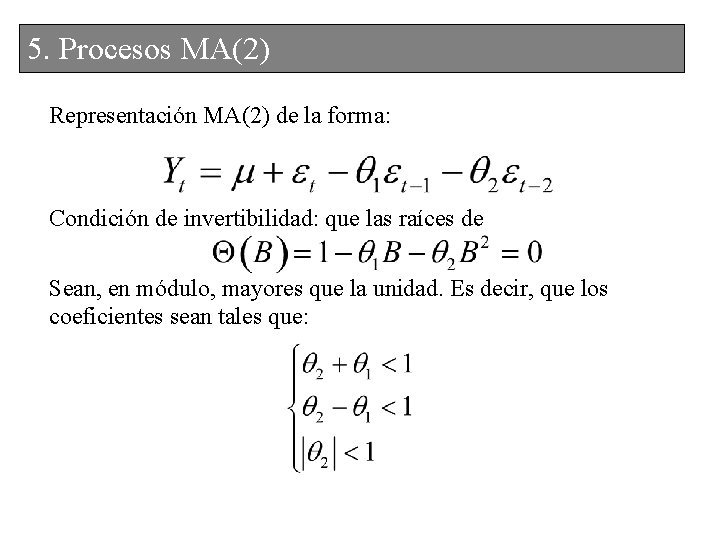

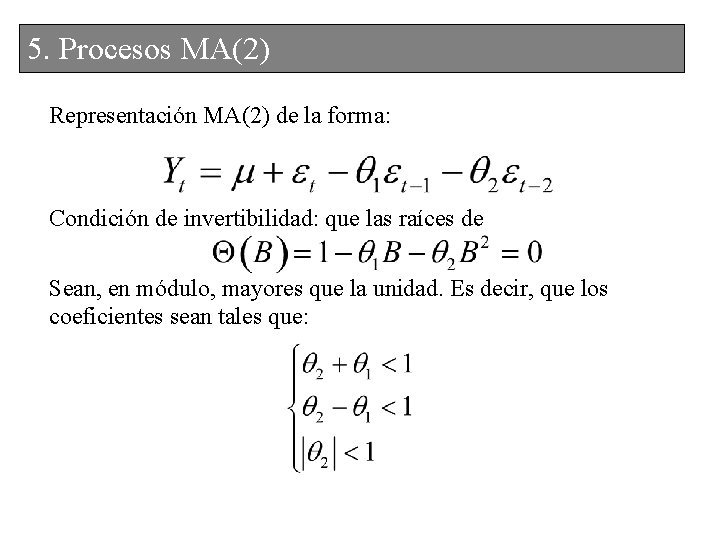

5. 4. Procesos. MA(2) Representación MA(2) de la forma: Condición de invertibilidad: que las raíces de Sean, en módulo, mayores que la unidad. Es decir, que los coeficientes sean tales que:

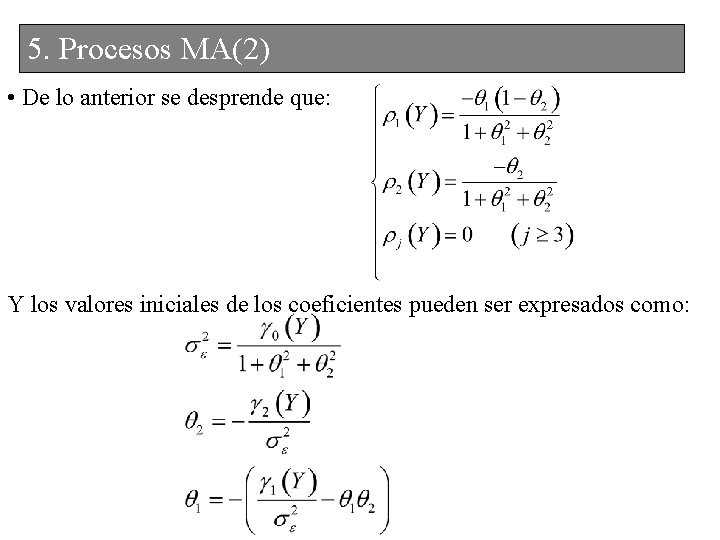

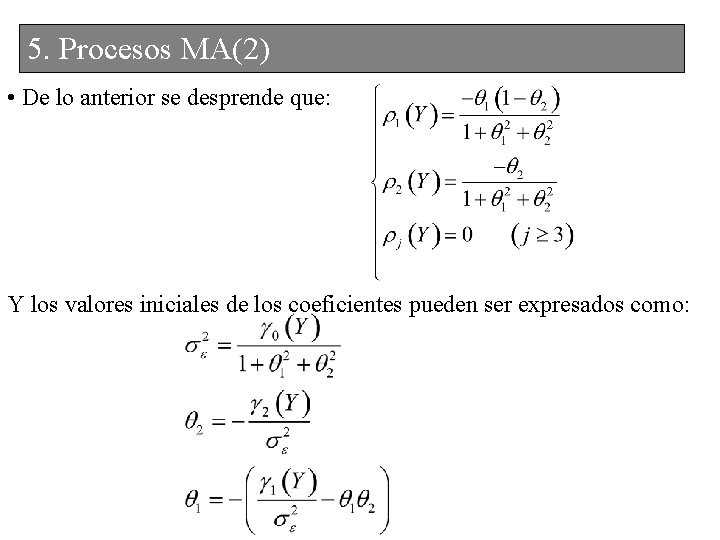

5. 4. Procesos. MA(2) • De lo anterior se desprende que: Y los valores iniciales de los coeficientes pueden ser expresados como:

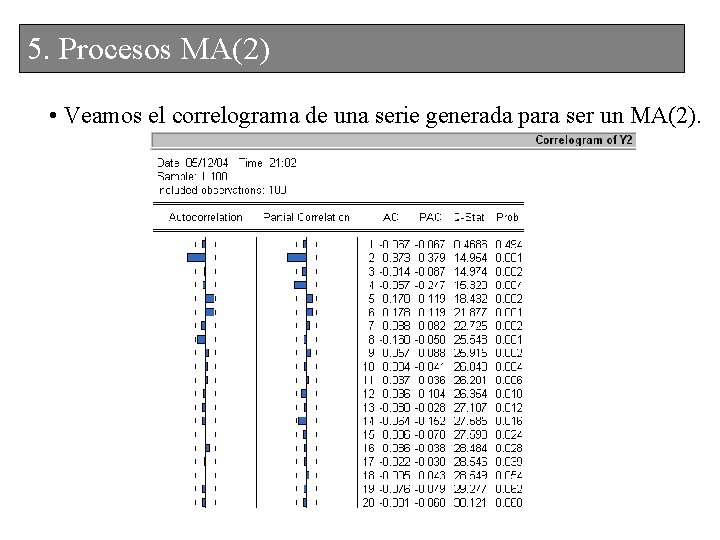

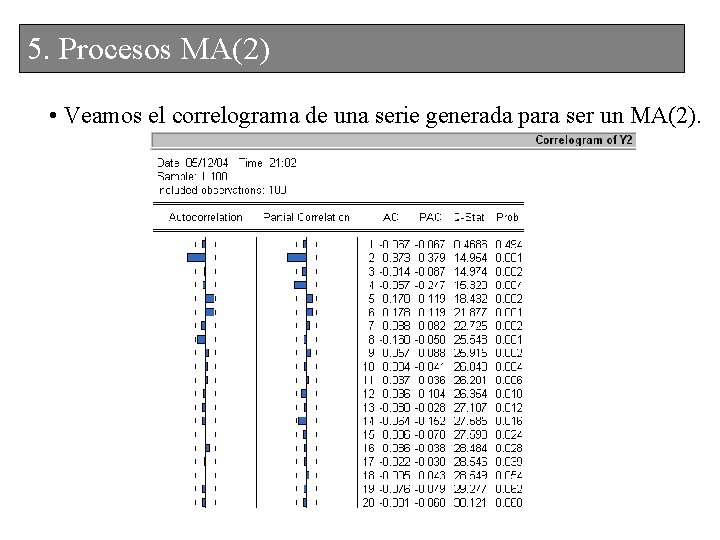

5. 4. Procesos. MA(2) • Veamos el correlograma de una serie generada para ser un MA(2).

6. Estacionariedad e Invertibilidad • Las condiciones de estacionariedad e invertibilidad son impuestas respectivamente a los procesos AR(p) y MA(q). • Decíamos que es deseable que un proceso AR(p) sea estacionario de modo que se pueda estimar uno y sólo un modelo y no uno que contenga infinitos parámetros, por ejemplo, por el cambio a cada momento del tiempo, de la esperanza del proceso. • Las condiciones que se imponen a los AR buscan evitar que las sumatorias que se desarrollan se vuelvan infinitas y no converjan a 0. Los procesos AR(p) siempre son invertibles.

6. 5. Estacionariedade e. Invertibilidad • En el caso de procesos de medias móviles, las condiciones similares a las de estacionariedad son las de invertibilidad. • Cuando un proceso MA es invertible, entonces dicho proceso admite una representación autorregresiva, donde los valores pasados de la variable yt reciben una ponderación cada vez menor. • Cuando presentamos los modelos autorregresivos supusimos que los procesos bajo estudio eran estacionarios. Sin embargo, las series de datos económicos que usualmente se analizan se caracterizan por ser claramente no estacionarias, como ya vimos la clase pasada. • Cuando esto ocurre, lo usual es que las primeras o segundas diferencias de la variable original sí sean estacionarias.

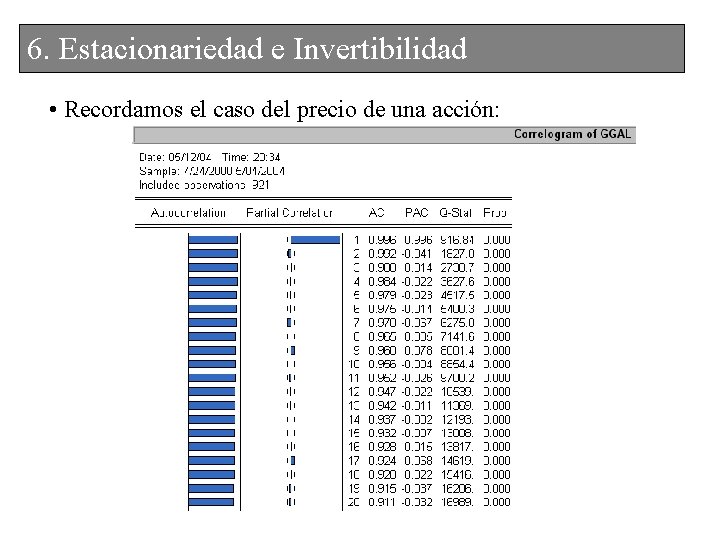

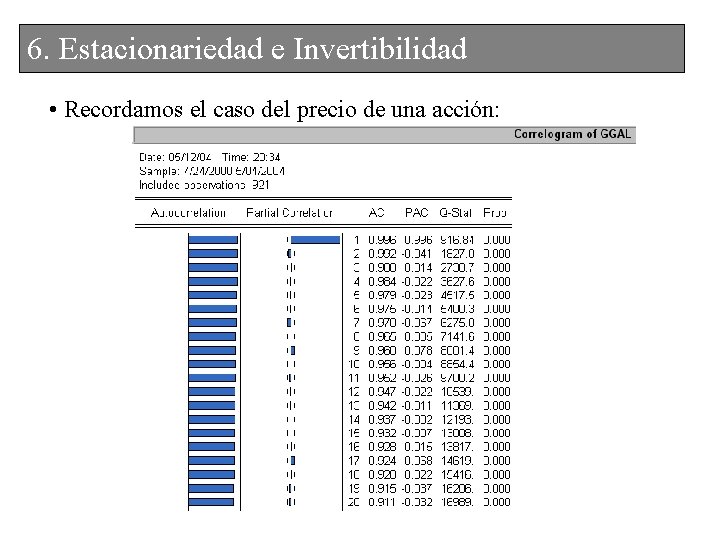

6. Estacionariedad e Invertibilidad • Recordamos el caso del precio de una acción:

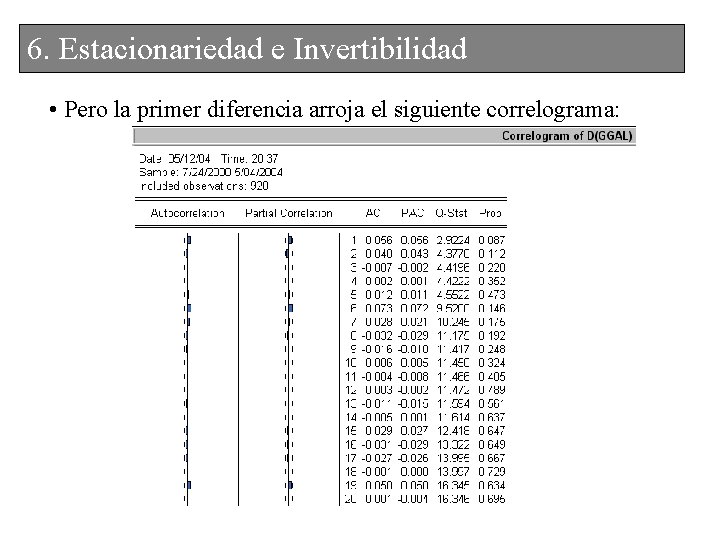

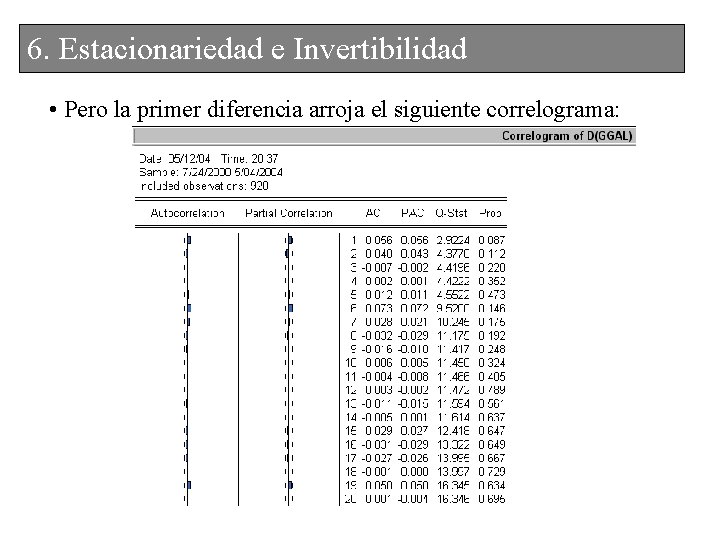

6. 6. Estacionariedade e. Invertibilidad • Pero la primer diferencia arroja el siguiente correlograma:

6. 6. Estacionariedade e. Invertibilidad • Por lo tanto, los procesos que pueden trasformarse en estacionarios mediante sus diferencias de orden d, se conocen como procesos integrados de orden d. • Un proceso integrado de orden 1 es el proceso de random walk visto anteriormente, cuya varianza era creciente con el tiempo. Sin embargo, su primer diferencia correspondía al término εt , el que si es estacionario o integrado de orden 0.

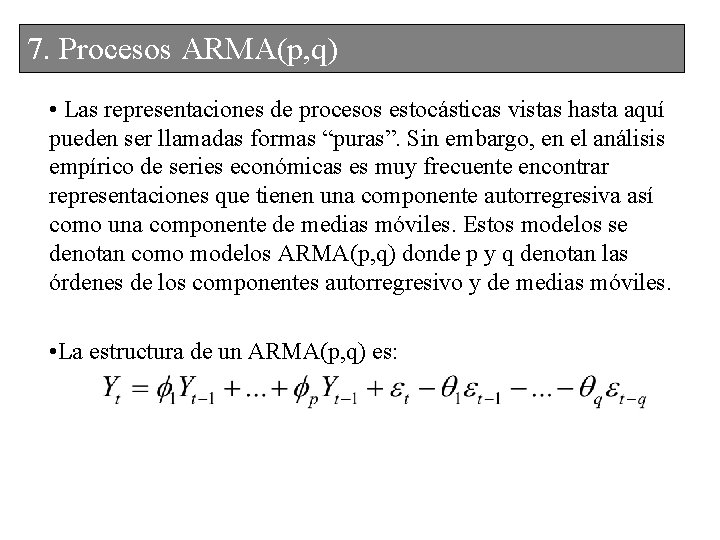

7. Procesos ARMA(p, q) • Las representaciones de procesos estocásticas vistas hasta aquí pueden ser llamadas formas “puras”. Sin embargo, en el análisis empírico de series económicas es muy frecuente encontrar representaciones que tienen una componente autorregresiva así como una componente de medias móviles. Estos modelos se denotan como modelos ARMA(p, q) donde p y q denotan las órdenes de los componentes autorregresivo y de medias móviles. • La estructura de un ARMA(p, q) es:

7. 6. Procesos. ARMA(p, q) ARMA • La FAC de un proceso ARMA(1, 1) comienza del valor ρ1 que acabamos de mostrar y a partir de él, decrece a una tasa Φ. Es decir, que la FAC se comporta a partir de k=1 como la FAC de un proceso AR(1). Generalizando: la FAC de un proceso ARMA(p, q) se comporta como la FAC de un AR(p) para todo k>q. • Esto hace que la identificación no sea tan sencilla, ya que la FAC y la FACP de un ARMA(p, q) heredan características de sus dos componentes.

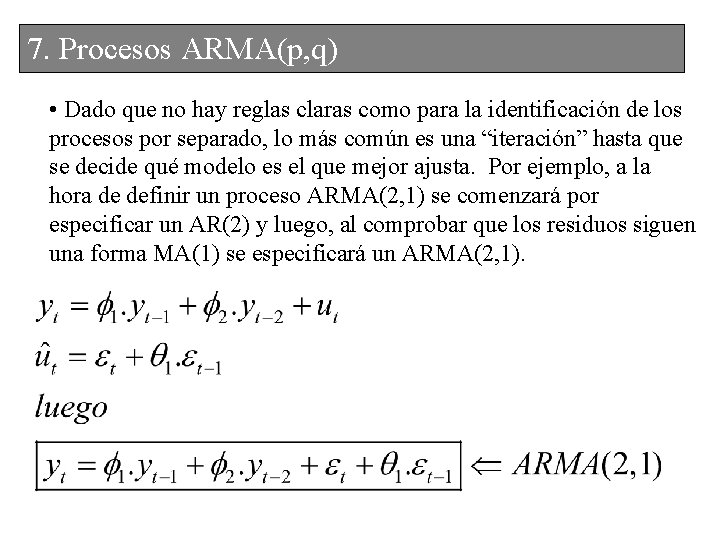

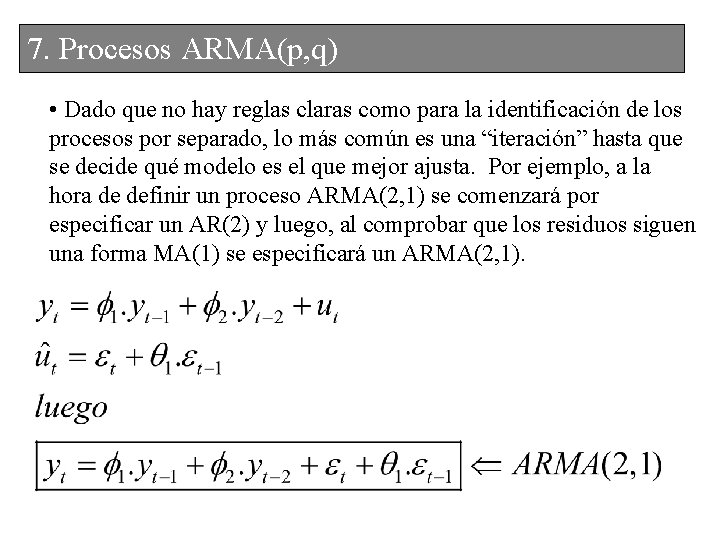

7. 6. Procesos. ARMA(p, q) ARMA • Dado que no hay reglas claras como para la identificación de los procesos por separado, lo más común es una “iteración” hasta que se decide qué modelo es el que mejor ajusta. Por ejemplo, a la hora de definir un proceso ARMA(2, 1) se comenzará por especificar un AR(2) y luego, al comprobar que los residuos siguen una forma MA(1) se especificará un ARMA(2, 1).

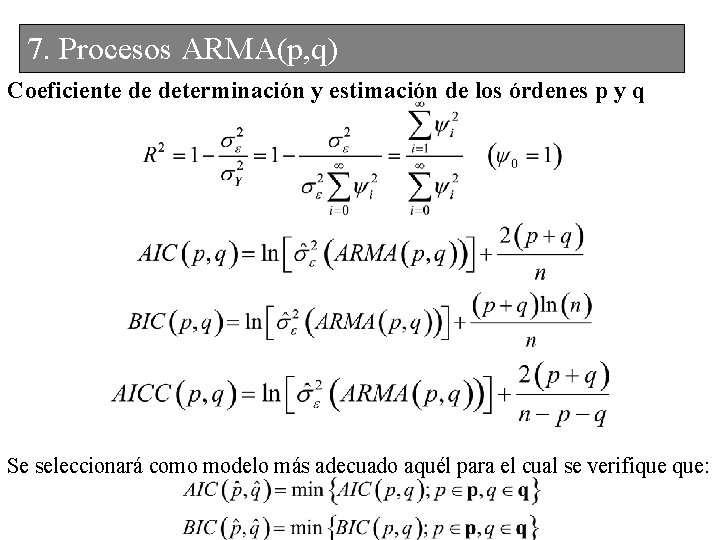

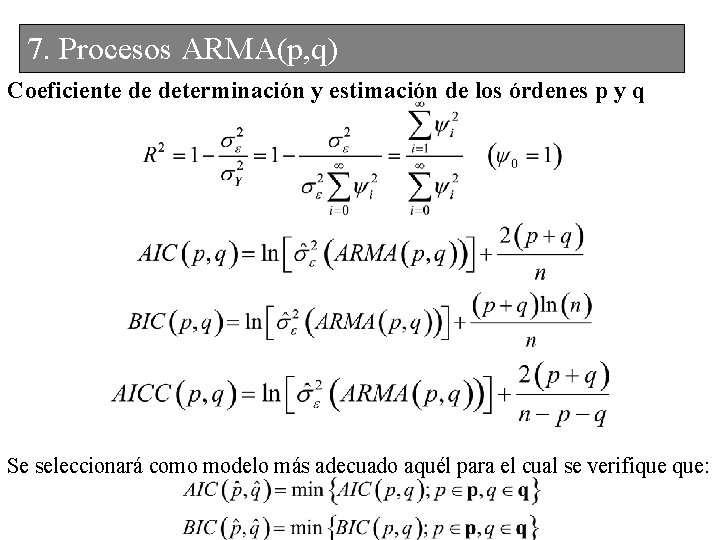

7. Procesos ARMA(p, q) Coeficiente de determinación y estimación de los órdenes p y q Se seleccionará como modelo más adecuado aquél para el cual se verifique que:

FIN Me pueden escribir a: jrs 06@cema. edu. ar Las presentaciones estarán colgadas en: www. cema. edu. ar/u/jrs 06