Esclarecimentos sobre o livro Informao Uma histria uma

Esclarecimentos sobre o livro: Informação: Uma história, uma teoria, uma enxurrada. Prof. Dr. Marcos L. Mucheroni 1

Teoria da Informação I Motivação Problemas indecidíveis Problemas intratáveis Não existe algoritmo (lógico) para tudo. Os algoritmos conhecidos são demasiado dispendiosos Simplificação; heurísticas Necessidade de um modelo simples de computador para estudar a computabilidade Máquinas de Turing Modelo de computador, mais do que de linguagem

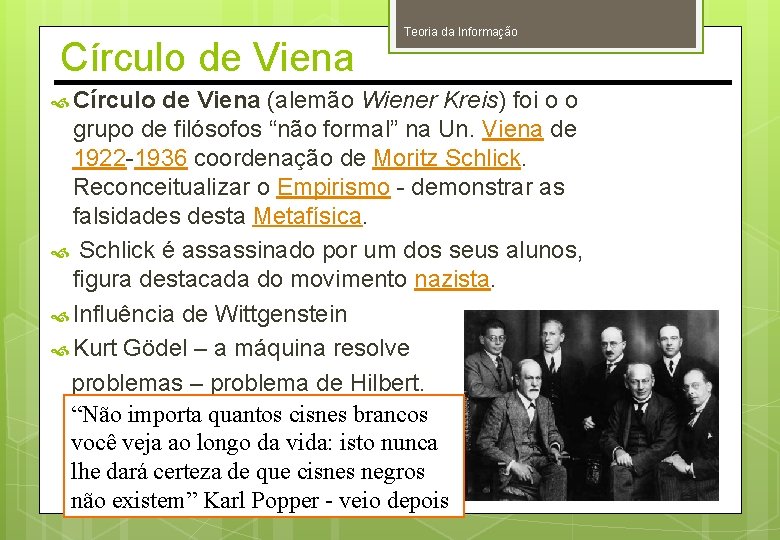

Círculo de Viena Círculo Teoria da Informação de Viena (alemão Wiener Kreis) foi o o grupo de filósofos “não formal” na Un. Viena de 1922 -1936 coordenação de Moritz Schlick. Reconceitualizar o Empirismo - demonstrar as falsidades desta Metafísica. Schlick é assassinado por um dos seus alunos, figura destacada do movimento nazista. Influência de Wittgenstein Kurt Gödel – a máquina resolve problemas – problema de Hilbert. “Não importa quantos cisnes brancos você veja ao longo da vida: isto nunca lhe dará certeza de que cisnes negros não existem” Karl Popper - veio depois

Contexto histórico – neologicismo também Popper. Contexto David Hilbert (início do séc. XX) Kurt Gödel (1931) Teorema da incompletude: construiu uma fórmula que não pode ser provada nem refutada Técnica semelhante ao programa contraditório H 2 Alan Turing (1936) Há alguma maneira de determinar se qualquer fórmula da lógica de predicados de primeira ordem, aplicada aos inteiros, é verdadeira? Máquina de Turing: modelo de qualquer computação possível Foi desenvolvido, durante a 2ª Guerra, no esforço de construção de máquinas de quais emergiram os computadores Hipótese de Church (tese de Church-Turing, não demonstrável) Todos os modelos gerais de computação são equivalentes às funções parciais recursivas e às máquinas de Turing (mesmo os computadores actuais)

Problema: número computáveis Devem existir problemas indecidíveis Problema é decidir se uma cadeia pertence a uma linguagem O número de linguagens diferentes sobre um alfabeto com mais do que um símbolo não é numerável Os programas são numeráveis Não é possível estabelecer uma correspondência biunívoca com Cadeias finitas sobre alfabetos finitos Ordenar por comprimento e por ordem lexicográfica Podem ser contados, embora em número infinito. Há infinitamente menos programas do que problemas Linguagem ao acaso dá provavelmente um problema indecidível A maioria dos problemas parecem decidíveis porque são escolhidos

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Novos fios e nova lógica Infância de Shannon na pequena cidade de Gaylord, interesse por matemática e códigos, vai para Universidade de Michigan em 1932. 1936 vê anuncio d emprego para alunos de pósgraduação Massachusetts Institute of Technology. Vannevar Bush era o chefe do departamento de engenharia e procurava um assistente para sua máquina: Analisador Diferencial, computador de Charles Babbage, descrito no livro de Gleick: ”Ao contrário da máquina de Babbage, esta não manipulava os números. Funcionava com base nas quantidades – gerando curvas, como Bush gostava de dizer, para representar o futuro de um sistema dinâmico. Diríamos hoje que o aparato era analógico em vez de digital. ” (Gleick, 2013, p. 181).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Novos fios e nova lógica Vannevar - dispositivos de transmissão, e, portanto tratase de informação nos dispositivos, e também o modelo de Shannon será isto. Desenvolve em ligação com a escrita desde o já é esta lógica (Bertrand Russel e Alfred N. Withehead): ” A invenção da escrita, catalisou a lógica, tornando possível raciocinar a respeito do raciocínio – trazer diante dos olhos um encadeamento de ideias para um exame atento – e então, tantos séculos mais tarde, a lógica era reanimada com a invenção de máquinas capazes de trabalhar a partir de símbolos. Na lógica e na matemática, as formas mais elevadas de raciocínio, todas as peças pareciam estar se encaixando” (Gleick, 2013, p. 185).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Nascimento do computador Este aparato além de dispositivos comuns: engrenagens e polias, novos dispositivos eletromecânicos que são os relés, e eles são os primeiros dispositivos a simularem bits, dígitos binários, inicialmente SIM e NÃO, e depois 0 e 1. Ideia inicial era que informação nas pessoas seria igual se codificássemos o pensamento: ” Esse fugidio objetivo foi buscado por Boole, e, antes dele, por Babbage, e muito antes de ambos por Leibniz, e todos acreditavam que a perfeição do raciocínio poderia advir da codificação perfeita do pensamento” (Gleick, 2013, p. 186). Ver Olga Pombo “Leibniz” – Characteristica Universalis – em “três projetos complementares.

Teoria da Informação Problema teórico importante Kurt Gödel que formulou que qualquer teorema pode ser demonstrado por regras mecânicas: ” “Qualquer teorema: pois o sistema era completo, ou afirmava sê-lo. Regras mecânicas, pois a lógica operava inexoravelmente, sem espaço para as variações da interpretação humana. Seus símbolos tinham sido exauridos de significado. Qualquer pessoa poderia verificar uma comprovação passo a passo simplesmente seguindo as regras, sem compreender o processo” (Gleick, 2013, pg. 190). Mas isto pode ser formulado de modo mais completo, uma vez que isto vai interessar a Shannon e Turing:

Teorema de Gödel Teorema James Gleick – Informação: Uma história, uma teoria, uma enxurrada. 1: "Qualquer teoria axiomática recursivamente enumerável e capaz de expressar algumas verdades básicas de aritmética não pode ser, ao mesmo tempo, completa e consistente. Ou seja, sempre há em uma teoria consistente proposições verdadeiras que não podem ser demonstradas nem negadas. " Teorema 2: "Uma teoria, recursivamente enumerável e capaz de expressar verdades básicas da aritmética e alguns enunciados da teoria da prova, pode provar sua própria consistência se, e somente se, for inconsistente. " Isto significa na prática que o determinismo caiu por terra. Também W. Eisenberg com seu "principio da incerteza”.

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Shannon e Turing, se encontram Claude Shannon trabalha no MIT – com V. Bush, sugeriu trocar a engenharia pela Matemática e este vai ao a Bell Laboratories, onde Alain Turing trabalhava secretamente em decifrar o código da Máquina Enigma, enquanto Shannon codificar Sistema X. ”. . Eles falavam indiretamento a respeito de uma noção de Turing que envolvia uma forma de medir tudo aquilo” (Gleick, 2013, p. 222). ” Shannon tinha chegado a uma noção parecida. . . sua “análise de algumas propriedades fundamentais dos sistemas gerais de transmissão de informações” (Gleick, 2013, p. 223).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Laboratório Bell – segredos Alain Turing: decodificar a alemã Enigma Claude Shannon – Máquina X codificar as conversas Roosevelt x Churchill Nos intervalos – conversas sobre Hilbert-Gödel ” Aquilo que Marshall Mc. Luhan chamou se meio era para Shannon o canal, e o canal estava sujeito a um rigoroso tratamento matemático” (Gleick, 2013, p. 272).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Um cérebro mundano Ao debater o problema de Hilbert, Shannon e Turing – a máquina pode pensar ? Diz como uma piada – na verdade quero um cérebro humano - Presidente da Bell Labs ! Então partem para um problema mais simples Jogar xadrez, Shannon cria o seu labirinto. Ratos – mecanismos (vetores) Norbert Wiener – Há pensamento

Computador: Turing-Church Norbert Wiener seu professor via nisto um “pensar” algo como a teoria do behaviorismo da psicologia, que vê tudo no formado do controle, professor de Shannon, Vannevar Bush com o qual trabalhou em seu laboratório escreveu: Como podemos pensar ? referindo-se ao futuro. Também tinha clareza que este era um novo início de uma batalha “Esta não foi uma guerra de cientistas; foi uma guerra onde todos tiveram seu papel” BUSH, V. As we may thing ? 1945. -Shannon trabalhou em sua máquina analítica, a qual muitos estudantes e professores recorriam no desespero para fazer gráficos de seus ensaios laboratoriais.

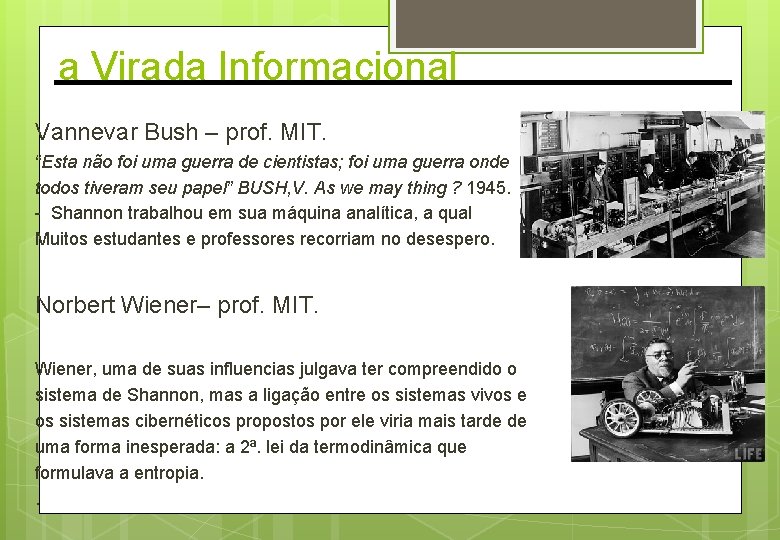

a Virada Informacional Vannevar Bush – prof. MIT. “Esta não foi uma guerra de cientistas; foi uma guerra onde todos tiveram seu papel” BUSH, V. As we may thing ? 1945. - Shannon trabalhou em sua máquina analítica, a qual Muitos estudantes e professores recorriam no desespero. Norbert Wiener– prof. MIT. Wiener, uma de suas influencias julgava ter compreendido o sistema de Shannon, mas a ligação entre os sistemas vivos e os sistemas cibernéticos propostos por ele viria mais tarde de uma forma inesperada: a 2ª. lei da termodinâmica que formulava a entropia. .

A entropia e a informação A Lei de Clausius da entropia , era sobre apenas a energia que era transformada em “trabalho”, Máquinas a vapor, mas a indústria química florescia na Alemanha e Maxwell -2ª. Lei da termodinâmica o universo como um sistema: - a energia do universo é constante, - a entropia então aumenta Paralelo – a entropia da informação.

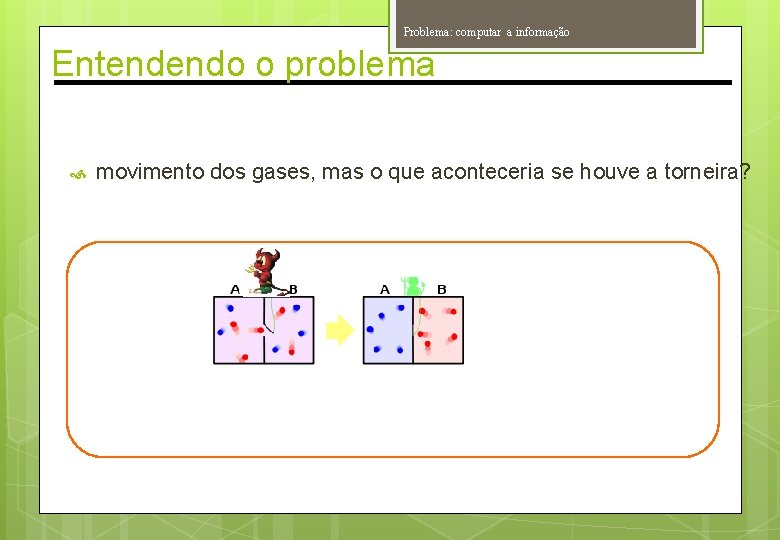

Problema: computar a informação Entendendo o problema movimento dos gases, mas o que aconteceria se houve a torneira?

Problema: computar a informação O demônio se torna popular O demônio de Maxwell se tornou popular. ” A ideia da dissipação de energia depende da extensão do nosso conhecimento”. (Gleick, 2013, p. 281). Foi Maxwell que introduzia a desordem como algo não físico: Mas o tempo esta ordem daí decorre a flecha do tempo fundamental no Big Bang. Tem o mesmo grau de verdade da afirmação que diz se, ao jogarmos uma jarra de água no mar, não se pode recuperar a mesma água novamente. Ou seja, na caixa de gás é improvável estatisticamente desmisturar os gases. . . Ver novamente.

Problema: computar a informação As teorias matemáticas Henry Poincaré (matemática) escreveu que a “sutileza infinita” era O demônio de Maxwell se universo” tornou popular. “capaz de reverter o rumo do Biologia descobre “membranas biológicas “ que funcionam como válvulas, biólogo James Johnstone (1914) Surgem questões curiosas do tipo: “Não devemos agora introduzir a demonologia na ciência” ? ? ? Acontecia já na física quesó considerava a “média estatística das Num sistema termodinâmico: equilíbrio térmico swpwnsw sw como se velocidades”. movem as partículas.

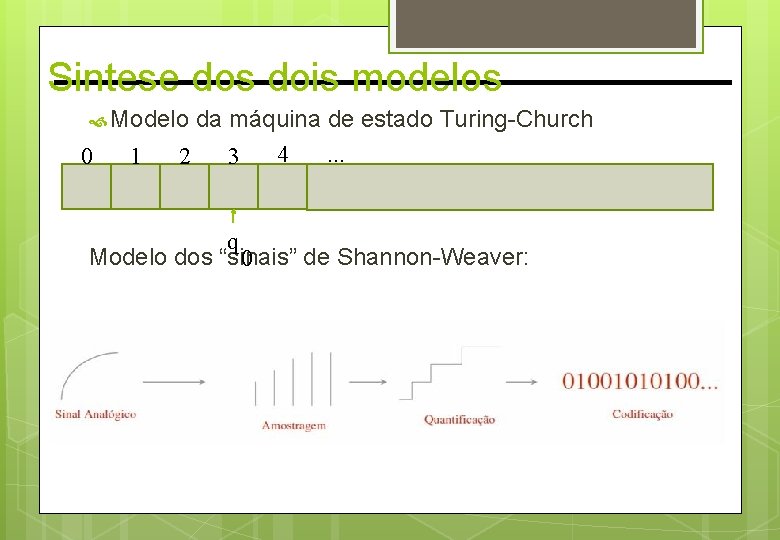

Sintese dos dois modelos Modelo 0 1 da máquina de estado Turing-Church. . . 4 2 3 q Modelo dos “sinais” de Shannon-Weaver: 0

A informação física e “enxurrada” A informação ontológica ganha natureza física. Do ser ao bit – informação ou sinal “ôntico”. A “abundância” e a “virada informacional” foi devido a ciência e de certa forma ao neopositivismo – decada de 40. A “enxurrada” é a “abundância” mais o uso da máquina. Duas naturezas: A organização do conhecimento no ser. depende da “visão de mundo” e da “visão do Ser”. Organização da dinâmica da máquina – algoritmos. .

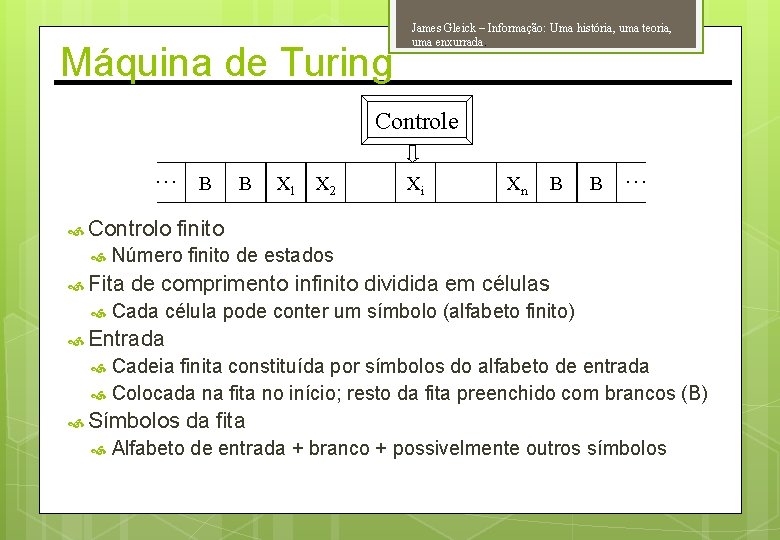

Máquina de Turing James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Controle … B Controlo X 1 X 2 Xi Xn B B … finito Número finito de estados Fita B de comprimento infinito dividida em células Cada célula pode conter um símbolo (alfabeto finito) Entrada Cadeia finita constituída por símbolos do alfabeto de entrada Colocada na fita no início; resto da fita preenchido com brancos (B) Símbolos da fita Alfabeto de entrada + branco + possivelmente outros símbolos

Teoria da Informação Máquina de Turing Cabeça da fita Sempre posicionada numa célula No início, está na célula mais à esquerda da entrada Movimento ou passo da máquina função do estado do controlo e do símbolo a ser varrido pela cabeça 1. Mudança de estado Pode 2. Escrita de um símbolo na célula onde está a cabeça Pode ser o mesmo 3. Deslocação da cabeça de uma célula à esquerda ou à direita Não restringe: sequência de passos com a cabeça parada seguida de um com movimento pode ser resumida neste

Conclusões – depois Importantes para a T. I. Nem tudo é computável A teoria da decisão, não é científica. Todo formulação sistemática tem uma contradição. A teoria da informação também pode ser pensada assim. A entropia é a expansão infinita do conhecimento por situações de contradição. Apesar disto a entropia pode ser formulada logicamente. Todo problema de linguagem e codificação é finito, portanto limitado. Video (se quiserem ver): http: //globotv. globo. com/gnt/saia-justa/v/james-gleick-afirma-queinformacao-nao-e-conhecimento/2641704

- Slides: 24