ENTROPIA rednia informacja na wiadomo bw gdzie Px

![ENTROPIA Średnia informacja na wiadomość [b/w] gdzie P(x) – prawdopodobieństwo wystąpienia danego stanu wiadomości ENTROPIA Średnia informacja na wiadomość [b/w] gdzie P(x) – prawdopodobieństwo wystąpienia danego stanu wiadomości](https://slidetodoc.com/presentation_image/7e0cdd655fc6f63f815da3c39b0012e8/image-1.jpg)

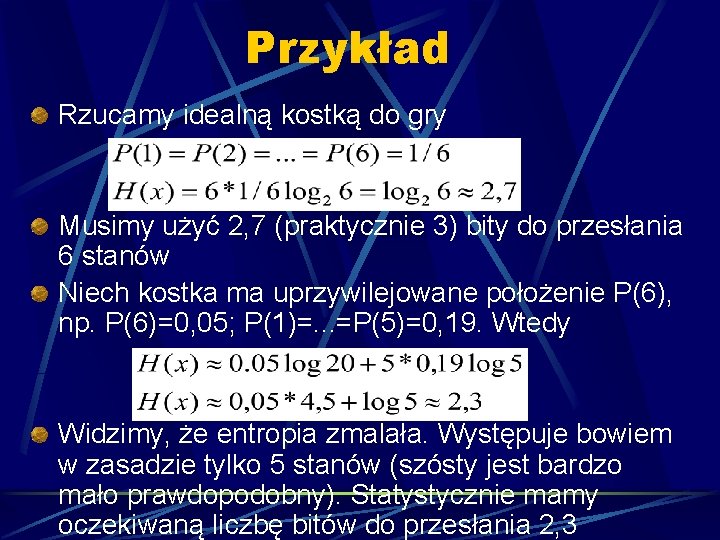

ENTROPIA Średnia informacja na wiadomość [b/w] gdzie P(x) – prawdopodobieństwo wystąpienia danego stanu wiadomości x. Jeśli prawdopodobieństwa P(x) są jednakowe, H(x) jest największa. H(x) określa się w bitach/wiadomość. Oznacza ona oczekiwaną liczbę bitów przy przesyłaniu danej wiadomości kanałem binarnym.

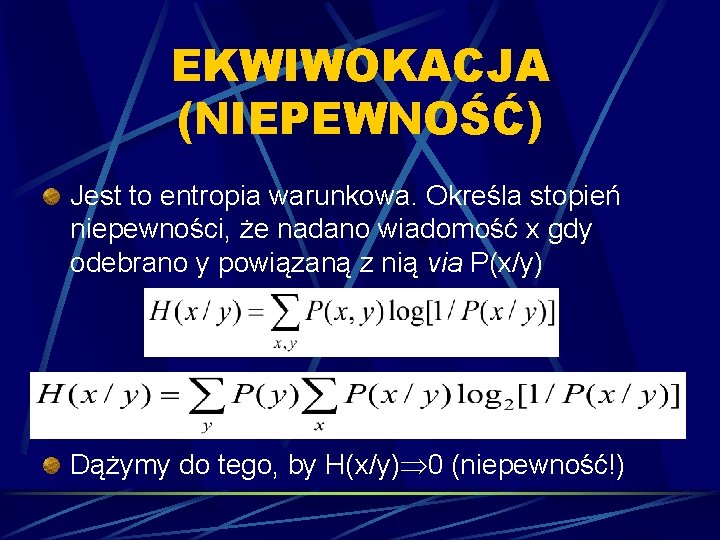

Przykład Rzucamy idealną kostką do gry Musimy użyć 2, 7 (praktycznie 3) bity do przesłania 6 stanów Niech kostka ma uprzywilejowane położenie P(6), np. P(6)=0, 05; P(1)=. . . =P(5)=0, 19. Wtedy Widzimy, że entropia zmalała. Występuje bowiem w zasadzie tylko 5 stanów (szósty jest bardzo mało prawdopodobny). Statystycznie mamy oczekiwaną liczbę bitów do przesłania 2, 3

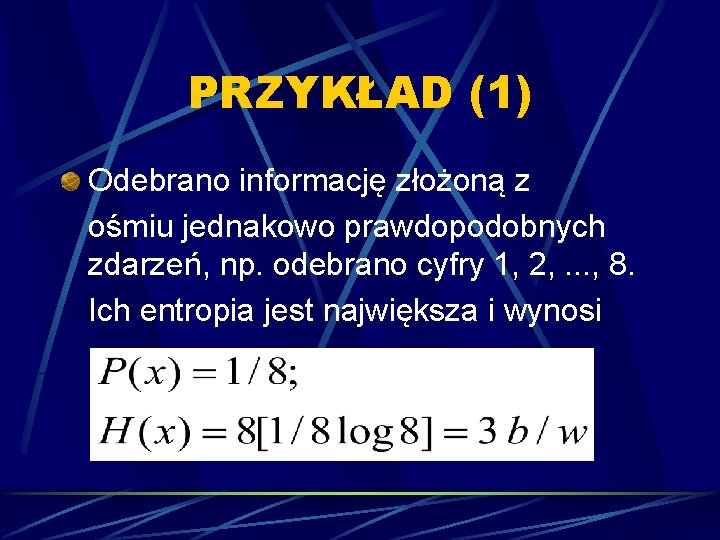

EKWIWOKACJA (NIEPEWNOŚĆ) Jest to entropia warunkowa. Określa stopień niepewności, że nadano wiadomość x gdy odebrano y powiązaną z nią via P(x/y) Dążymy do tego, by H(x/y) 0 (niepewność!)

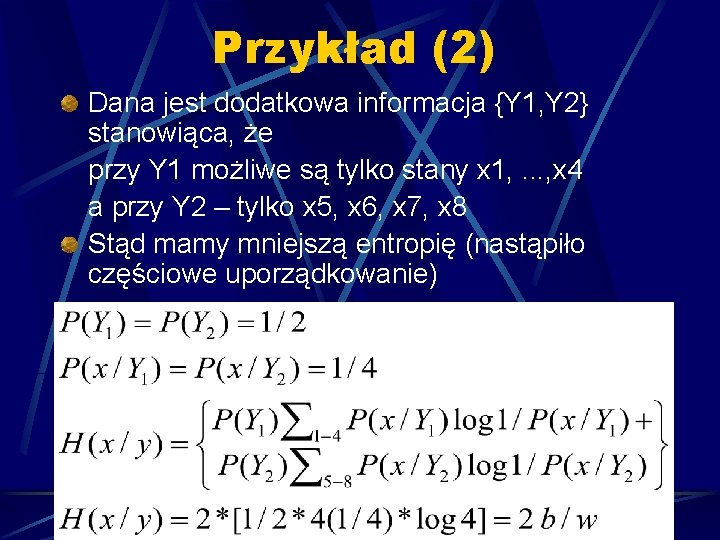

PRZYKŁAD (1) Odebrano informację złożoną z ośmiu jednakowo prawdopodobnych zdarzeń, np. odebrano cyfry 1, 2, . . . , 8. Ich entropia jest największa i wynosi

Przykład (2) Dana jest dodatkowa informacja {Y 1, Y 2} stanowiąca, że przy Y 1 możliwe są tylko stany x 1, . . . , x 4 a przy Y 2 – tylko x 5, x 6, x 7, x 8 Stąd mamy mniejszą entropię (nastąpiło częściowe uporządkowanie)

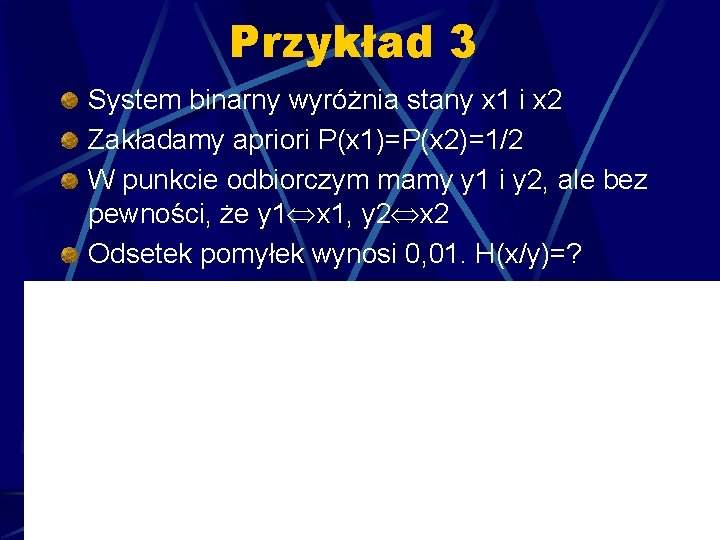

Przykład 3 System binarny wyróżnia stany x 1 i x 2 Zakładamy apriori P(x 1)=P(x 2)=1/2 W punkcie odbiorczym mamy y 1 i y 2, ale bez pewności, że y 1 x 1, y 2 x 2 Odsetek pomyłek wynosi 0, 01. H(x/y)=?

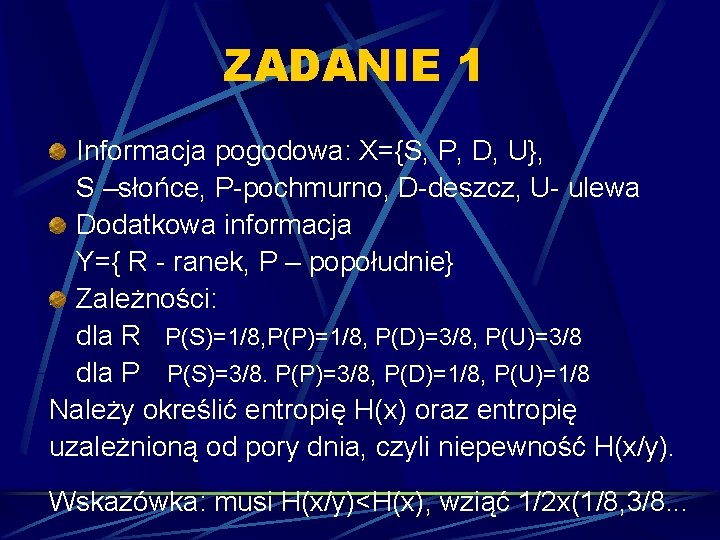

ZADANIE 1 Informacja pogodowa: X={S, P, D, U}, S –słońce, P-pochmurno, D-deszcz, U- ulewa Dodatkowa informacja Y={ R - ranek, P – popołudnie} Zależności: dla R P(S)=1/8, P(P)=1/8, P(D)=3/8, P(U)=3/8 dla P P(S)=3/8. P(P)=3/8, P(D)=1/8, P(U)=1/8 Należy określić entropię H(x) oraz entropię uzależnioną od pory dnia, czyli niepewność H(x/y). Wskazówka: musi H(x/y)<H(x), wziąć 1/2 x(1/8, 3/8. . .

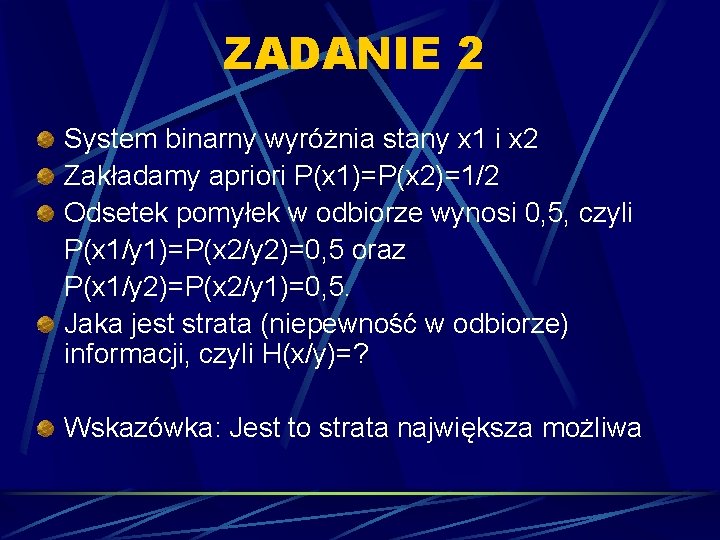

ZADANIE 2 System binarny wyróżnia stany x 1 i x 2 Zakładamy apriori P(x 1)=P(x 2)=1/2 Odsetek pomyłek w odbiorze wynosi 0, 5, czyli P(x 1/y 1)=P(x 2/y 2)=0, 5 oraz P(x 1/y 2)=P(x 2/y 1)=0, 5. Jaka jest strata (niepewność w odbiorze) informacji, czyli H(x/y)=? Wskazówka: Jest to strata największa możliwa

- Slides: 8