Engenhos de Busca Web Equipe Rafael Corra e

Engenhos de Busca Web Equipe: Rafael Corrêa e Igor Goes {rcls, igp}

Roteiro Evolução Web e Desafios; Arquitetura; Evolução da Busca; Rankeamento; Authorities, Hubs, Hits, Page. Rank e Hilltop; Spiders; Estratégias de Busca; Indexação; Browsing; Metabuscas; Conclusão.

Evolução Web Gigantesco e ubíquo banco de dados, sem estrutura definida. Como se comunicar ?

Evolução Web 1990 - Tim Berners-Lee do CERN(Conseil Européen pour la Recherche Nucleaire) cria o WWW; Libwww, Erwise, Voilawww, Mosaic(NCSA), etc. . .

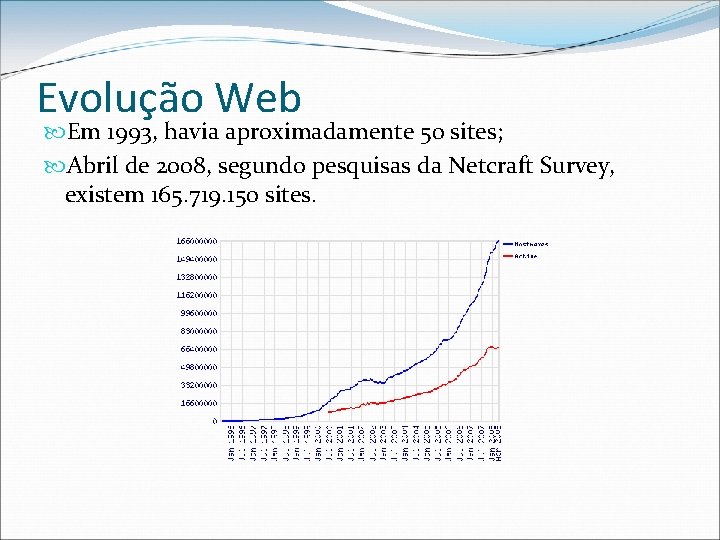

Evolução Web Em 1993, havia aproximadamente 50 sites; Abril de 2008, segundo pesquisas da Netcraft Survey, existem 165. 719. 150 sites.

Desafios Dados: Descentralização; Volatilidade; Volume; Redundancia; Qualidade.

Arquiteturas Sistemas RI padrão + WEB Principais arquiteturas Arquitetura centralizada Arquitetura distribuída

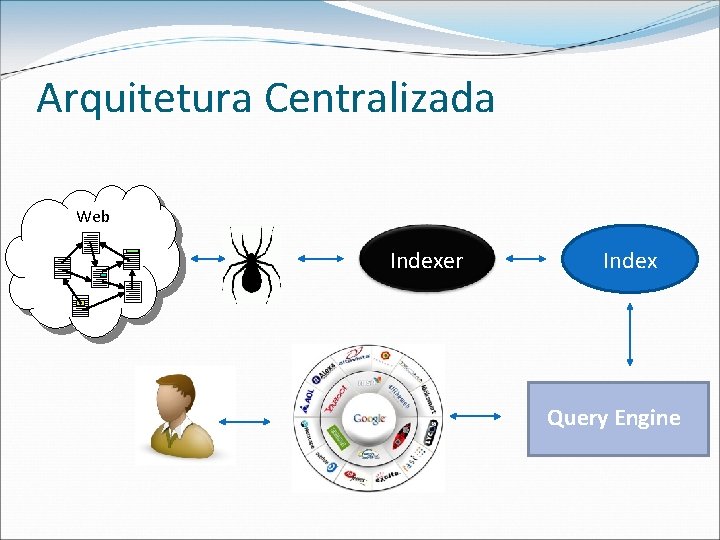

Arquitetura Centralizada Web Indexer Index Query Engine

Arquitetura Centralizada Principais problemas: Sobrecarga dos servidores Aumento de tráfego (spiders) Informação recolhida sem coordenação

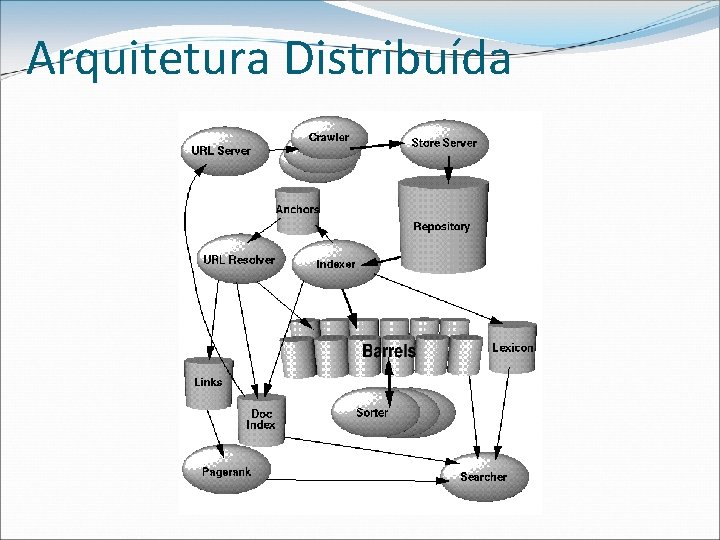

Arquitetura Distribuída

Evolução da Busca 1993 – Spiders foram criados para coletar URL’s; 1994 – Yahoo Coleta manual de sites; Hierarquia de tópicos. 1995 – Altavista Grande capacidade de processamento de queries; Suportando booleanos, frases e operadores.

Evolução da Busca 1998 – Google Análise dos links; Page. Rank; Authorities. 2004 - Google Scholar Busca especializada; Artigos cientifícos; Dados estruturados.

Authorities Definição: são páginas que são reconhecidas por proverem informações significantes, confiáveis e úteis sobre um determinado tópico Busca informação desejada dentro dos sites

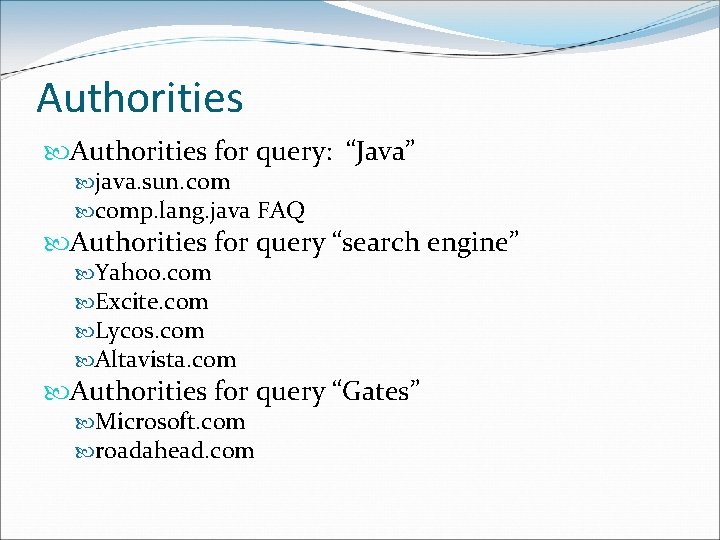

Authorities for query: “Java” java. sun. comp. lang. java FAQ Authorities for query “search engine” Yahoo. com Excite. com Lycos. com Altavista. com Authorities for query “Gates” Microsoft. com roadahead. com

Hubs Definição: termo para o grupo que une todos os sites web que recebem grande quantidade de links e que por sua vez fazem laço com páginas web que consideram importantes. Ou seja, são páginas de índices que provêem grande quantidade de links úteis para páginas de conteúdo relevante

Authorities e Hubs Na definição de Jon Kleinberg, de hubs e autoridades: uma boa autoridade será uma página apontada por bons hubs e um bom hub será uma página que aponta para boas autoridades.

HITS (Hyperlink Induced Topic Search) Tenta determinar hubs e autoridades em um tópico particular através da análise de um grafo relevante da web É baseado em fatos recursivos pois hubs apontam para autoridades e autoridades são apontadas por hubs. O peso de cada link dependerá dos índices hub e authority da página em que se encontra. O processo de cálculo é recursivo e pode envolver bilhões de páginas. Quando de sua concepção, o algoritmo mostrou-se impraticável.

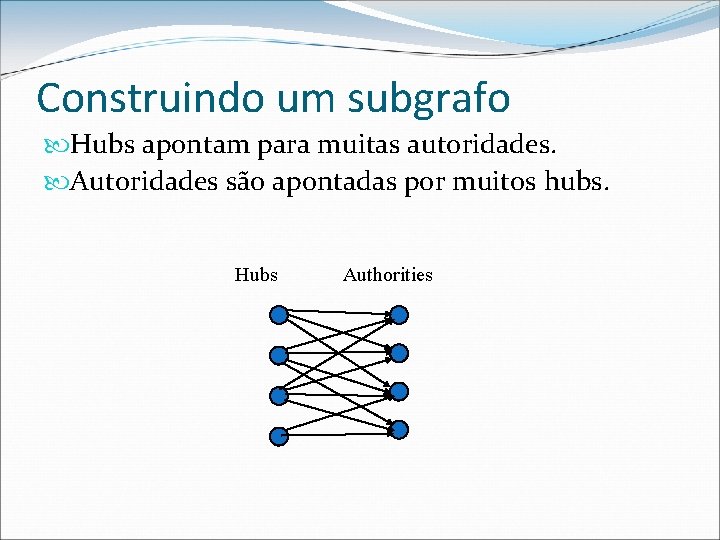

Construindo um subgrafo Hubs apontam para muitas autoridades. Autoridades são apontadas por muitos hubs. Hubs Authorities

Page. Rank Atribui um peso para cada elemento “hiperlincado”. Os links são como votos. Quanto mais apontamentos a página tiver, maior vai ser o page rank dela.

Page. Rank Medida de importância de uma página para o Google. Download da barra de ferramentas do Google.

Page Rank

Page. Rank Falhas: Qualquer página contida no índice, aumentava o Page. Rank da página que recebia o link. Webmasters estavam comprando links, para aumentar seu pagen. Rank E uma vez tendo contruído um site de alto pagerank, ficava fácil para os webmasters construírem outros sitese, de imediato, apontar links de suas próprias páginas e conseguir um bom posicionamento inicial. Solução: Algoritmo Hilltop

Algoritmo Hilltop O Hilltop procura detectar hosts afiliados; se um link apontar para uma página em um host afiliado, o valor do link é descontado. Hosts afiliados = mesmos primeiros três octetos de endereço IP Ex. : Hosts com IPs 200. 109. 112. 132 e 200. 109. 112. 132 (ou qualquer outro host de IP 200. 109. 112. xxx) são considerados afiliados

Algoritmo Hilltop O hilltop deixa claro que se eu quiser ter bom posicionamento do meu site de filmes é muito melhor eu ter um link em mdb. com (um expert no tópico filmes) do que um link em nature. com

Spiders (Robots/Bots/Crawlers) Procuram informações nos sites Entram nas páginas e lêem o conteúdo assim como os internautas. Não avaliam o site propriamente. Avaliam o código que o gera. O código deve estar em perfeita sintonia com os critérios que esses programas utilizam. 25

Spiders (Robots/Bots/Crawlers) Alguns desses critérios: Indexação Banco de dados é criado para cada termo de busca e são relacionadas as paginas Quando se faz a busca, a spider recorre a esse banco de dados. Html- as ferramentas de buscam entendem melhor. Links- Quanto mais sites tiverem links para a página, mais relevante será essa página. 26

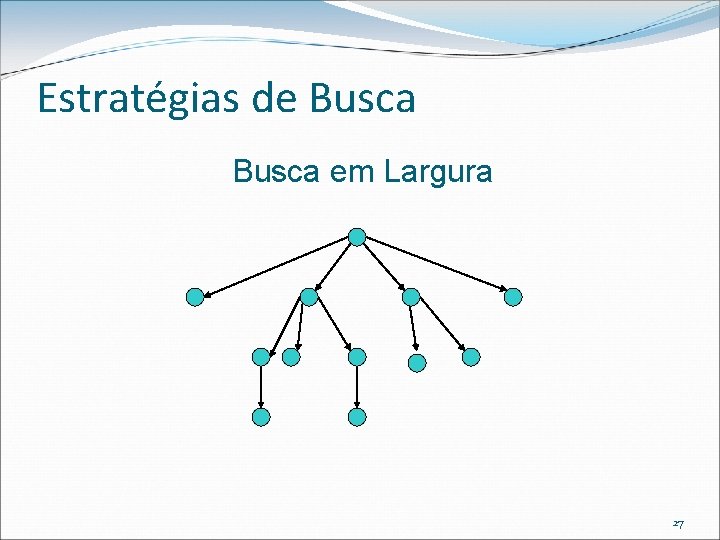

Estratégias de Busca em Largura 27

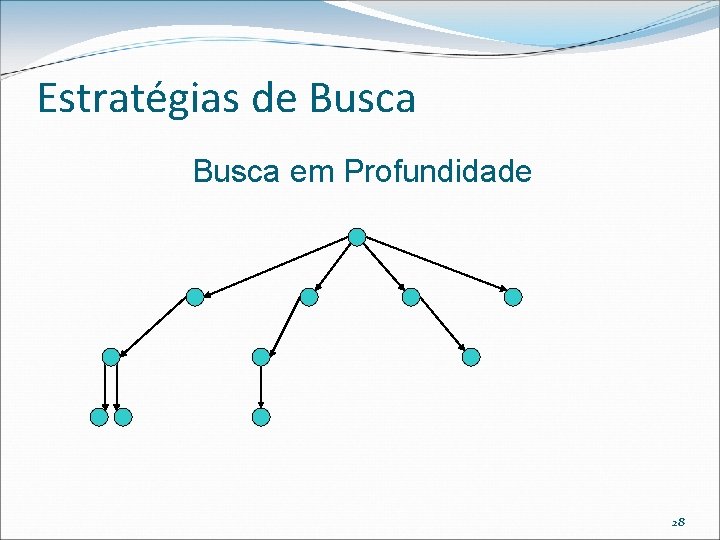

Estratégias de Busca em Profundidade 28

Prós e Contras… Busca em largura requer muita memória para guardar todos os nós do nível anterior porém é o método padrão utilizado. Busca em profundidade necessita de menos memória porém pode se “perder” em um único nó, dada a alta conectividade da Web. 29

Directed/Focused Spidering Selecionam as páginas mais “interessantes” primeiro. Direcionado aos Links 30

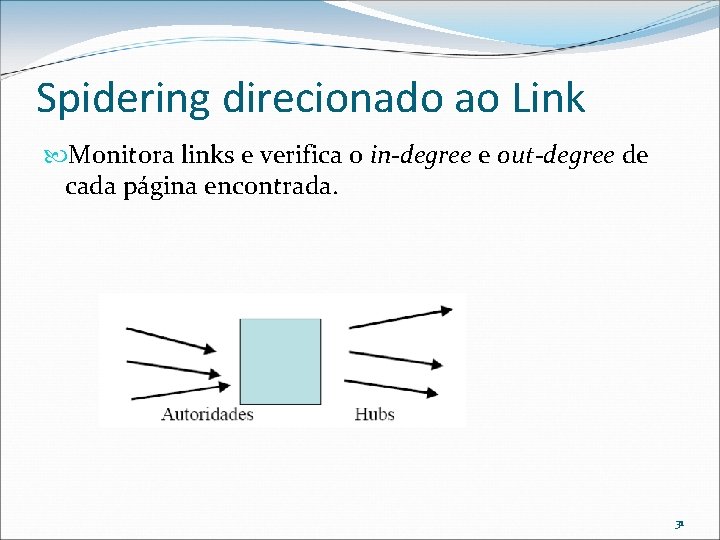

Spidering direcionado ao Link Monitora links e verifica o in-degree e out-degree de cada página encontrada. 31

Spidering direcionado ao Link Busca na fila primeiramente páginas populares que são apontadas por muitos links (authorities). Busca na fila primeiramente páginas “sumário”com muitos links (hubs). 32

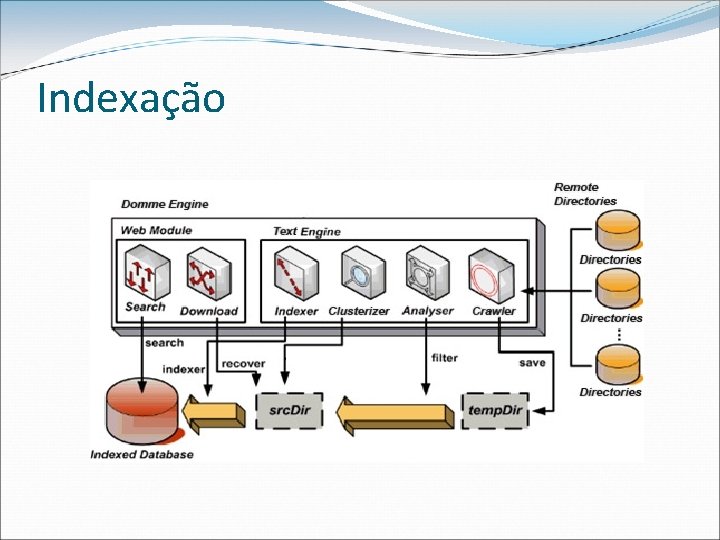

Indexação

Análise do Formato Reconhecimento de Linguagem Processamento de Linguagem Natural Eliminação de stopwords Operações de normalização Pontuação, espaços, uppercase, . . . Tokenization Reconhecimento da Seção Indexação de Meta Tag 34

Busca no Arquivo de Índices Consulta é respondida através de busca binária no arquivo de índices Consulta formada por várias palavras o sistema recupera os índices para cada palavra isolada os resultados da recuperação são combinados para gerar a resposta final 35

Browsing Diretórios Web Pequena cobertura geralmente menos de 1% das páginas Links geralmente possuem conteúdos mais relevantes Alguns são focados em um domínio específico Muitas ferramentas de busca são híbridas Exemplo: Yahoo! 36

Browsing Diretórios Web Vantagens Documentos mais relevantes Possibilidade de armazenar o conteúdo de todas as páginas classificadas, por serem em menores quantidades Desvantagens Nem todos os documentos são classificados Documentos mudam constantemente Tentativas de classificação automática não são 100% efetivas 37

Metabuscas Servidores Web que enviam uma consulta a vários motores de busca, diretórios Web e outros bancos de dados Coletam as respostas e unificam o resultado Vantagens Habilidade em unificar resultados de várias origens Utilização de uma interface única 38

Conclusão A Internet cresce de forma rápida e não estruturada Necessidade de ferramentas de RI mais eficientes Aumento da demanda de armazenamento e processamento de sistemas de RI Apesar dos avanços, é muito difícil resolver estes problemas de forma definitiva 39

- Slides: 39