Decision Tree Classification Decision Tree Proses pada Decision

- Slides: 15

Decision Tree Classification

Decision Tree • Proses pada Decision Tree adalah mengubah bentuk data (tabel) menjadi bentuk Tree, Mengubah Tree menjadi Rule, dan menyederhanakan rule(basuki&syarif, 2003)

Decision Tree • Metode Decision Tree mengubah fakta yang sangat besar menjadi decision Tree yang merepresentasikan aturan. • Sebuah Decision Tree adalah struktur yang dapat digunakan untuk membagi data yang besar menjadi himpunan-himpunan record yang lebih kecil dengan menerapkan serangkaian aturan keputusan. (Berry & Linoff)

Decision Tree • Algoritma yang digunakan untuk pembentukan Decision Tree diantaranya: ID 3, CART, C 4. 5 • Algoritma C 4. 5 merupakan pengembangan dari ID 3

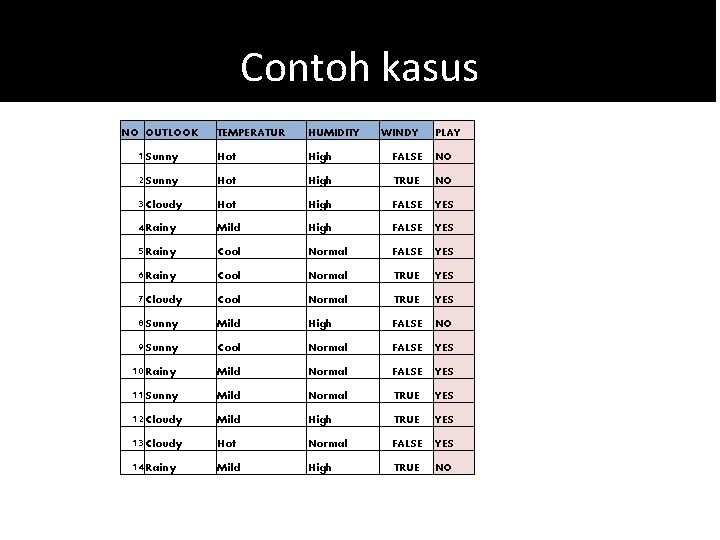

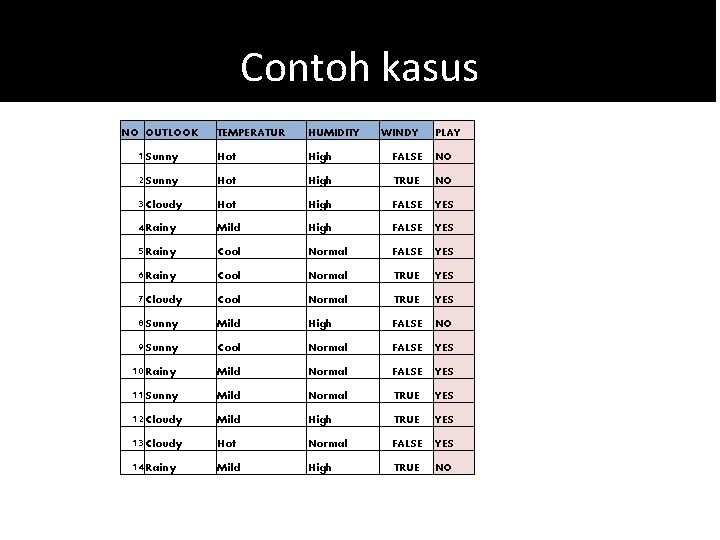

Contoh kasus NO OUTLOOK TEMPERATUR HUMIDITY WINDY PLAY 1 Sunny Hot High FALSE NO 2 Sunny Hot High TRUE NO 3 Cloudy Hot High FALSE YES 4 Rainy Mild High FALSE YES 5 Rainy Cool Normal FALSE YES 6 Rainy Cool Normal TRUE YES 7 Cloudy Cool Normal TRUE YES 8 Sunny Mild High FALSE NO 9 Sunny Cool Normal FALSE YES 10 Rainy Mild Normal FALSE YES 11 Sunny Mild Normal TRUE YES 12 Cloudy Mild High TRUE YES 13 Cloudy Hot Normal FALSE YES 14 Rainy Mild High TRUE NO

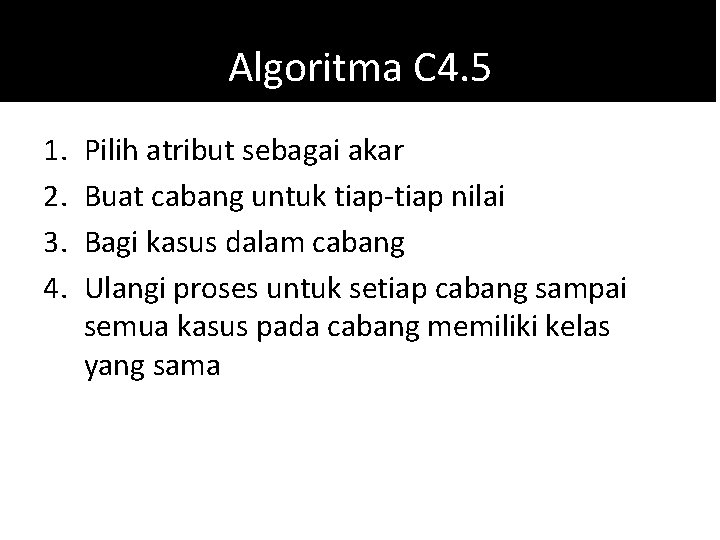

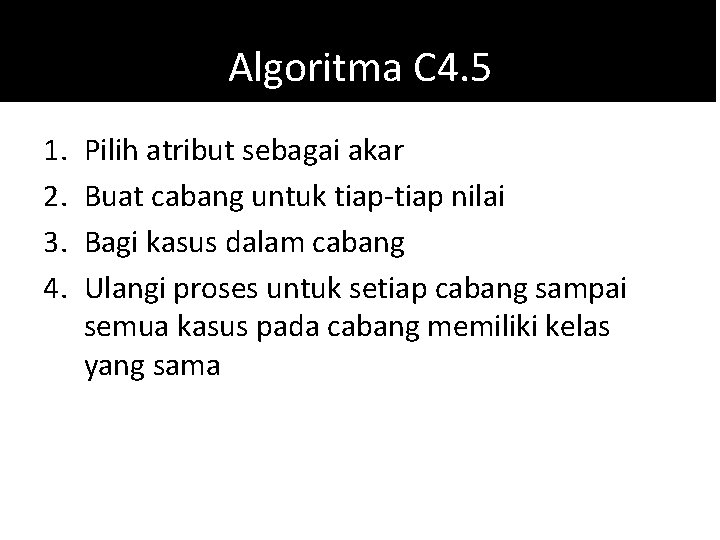

Algoritma C 4. 5 1. 2. 3. 4. Pilih atribut sebagai akar Buat cabang untuk tiap-tiap nilai Bagi kasus dalam cabang Ulangi proses untuk setiap cabang sampai semua kasus pada cabang memiliki kelas yang sama

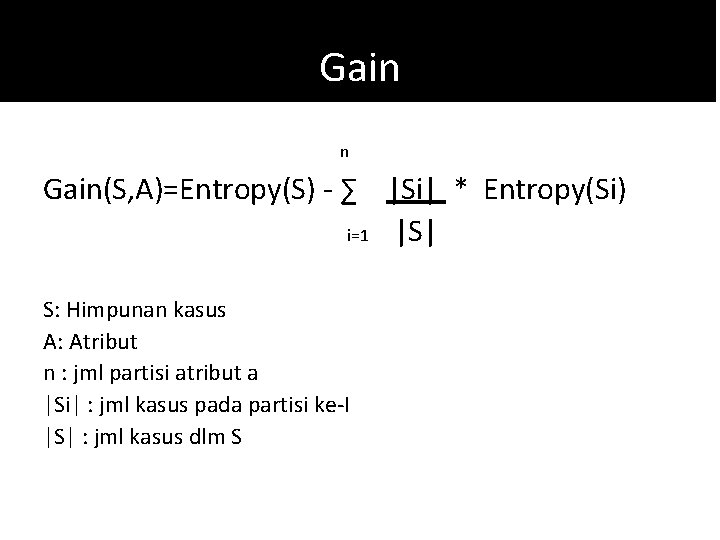

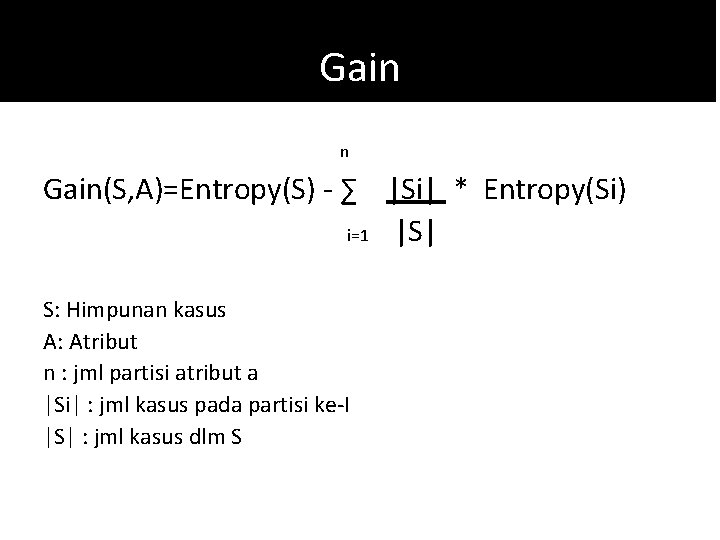

Gain n Gain(S, A)=Entropy(S) - ∑ |Si| * Entropy(Si) i=1 |S| S: Himpunan kasus A: Atribut n : jml partisi atribut a |Si| : jml kasus pada partisi ke-I |S| : jml kasus dlm S

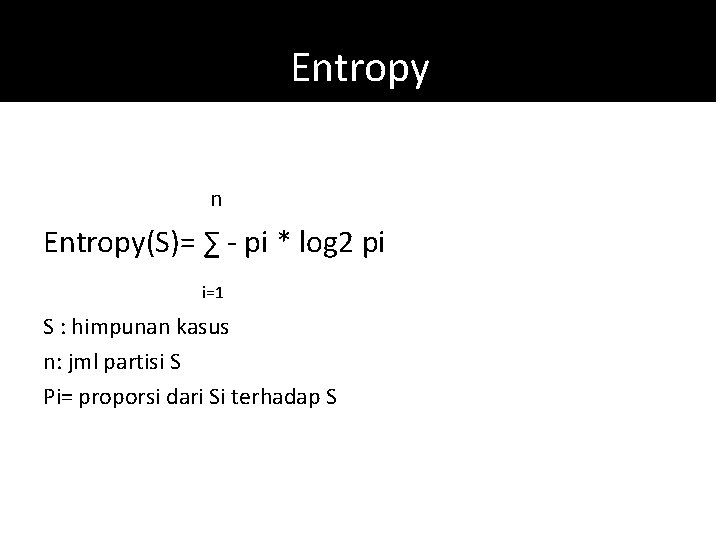

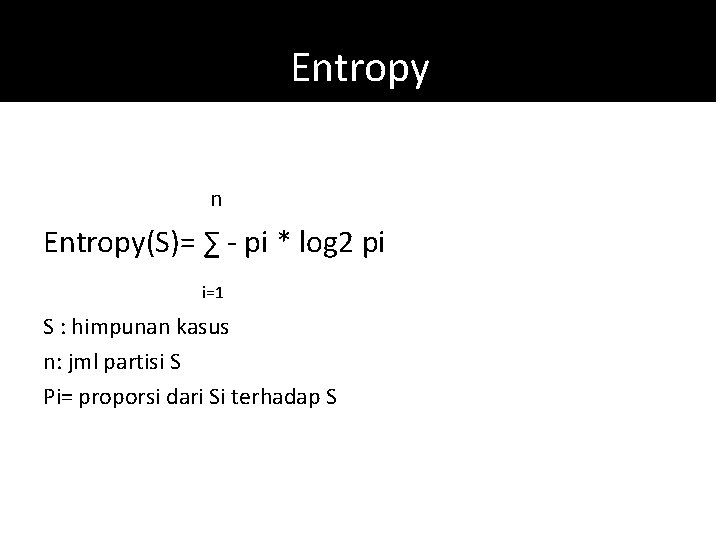

Entropy n Entropy(S)= ∑ - pi * log 2 pi i=1 S : himpunan kasus n: jml partisi S Pi= proporsi dari Si terhadap S

Meringkas JML Kasus NO OUTLOOK TEMPERATUR HUMIDITY WINDY PLAY 1 Sunny Hot High FALSE NO 2 Sunny Hot High TRUE NO 3 Cloudy TOTAL Hot High FALSE YES OUTLOOK 4 Rainy Mild High FALSE YES Cloudy 5 Rainy Cool Normal FALSE YES Rainy 6 Rainy Cool Normal TRUE YES Sunny 7 Cloudy TEMPERATUR Cool Normal TRUE YES Cool 8 Sunny Mild High FALSE NO Hot 9 Sunny Cool Normal FALSE YES Mild 10 Rainy Mild Normal FALSE YES HUMIDITY High 11 Sunny Mild Normal TRUE YES 12 Cloudy Mild High TRUE YES 13 Cloudy Hot Normal FALSE YES Normal FALSE TRUE 14 Rainy Mild High TRUE NO JML WINDY NO YES Kasus

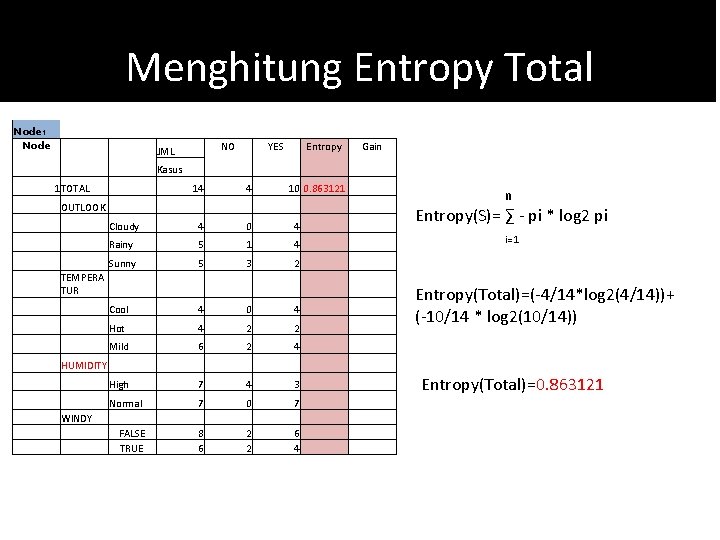

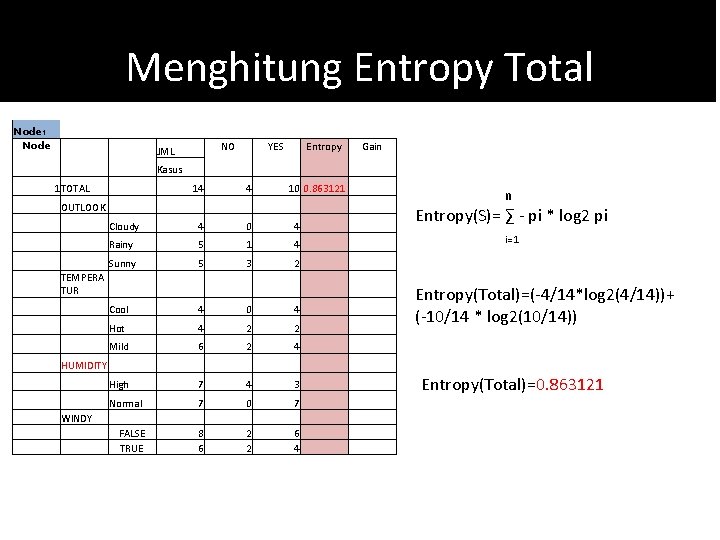

Menghitung Entropy Total Node 1 Node NO JML 1 TOTAL YES Entropy Gain Kasus 14 OUTLOOK Cloudy 4 Rainy Sunny TEMPERA TUR Cool 4 Hot Mild HUMIDITY High 7 WINDY Normal FALSE TRUE 7 4 10 0. 863121 0 4 5 1 4 5 3 2 0 4 4 2 2 6 2 4 4 3 0 7 6 4 8 6 2 2 n Entropy(S)= ∑ - pi * log 2 pi i=1 Entropy(Total)=(-4/14*log 2(4/14))+ (-10/14 * log 2(10/14)) Entropy(Total)=0. 863121

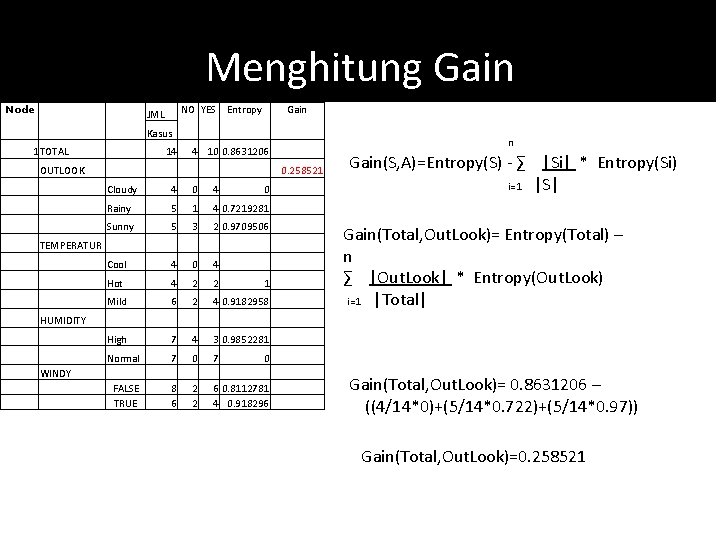

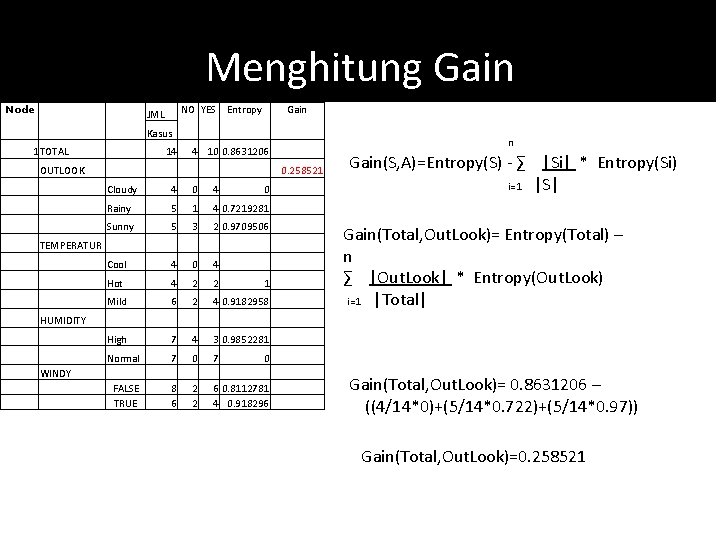

Menghitung Gain Node NO YES Entropy JML 1 TOTAL Gain Kasus 14 4 10 0. 8631206 OUTLOOK Cloudy 4 0 4 Rainy 5 1 4 0. 7219281 Sunny 5 3 2 0. 9709506 TEMPERATUR Cool 4 Hot Mild HUMIDITY High 7 4 3 0. 9852281 WINDY Normal FALSE TRUE 7 0 7 0 4 4 2 2 6 2 4 0. 9182958 0. 258521 8 6 2 2 1 n Gain(S, A)=Entropy(S) - ∑ |Si| * Entropy(Si) i=1 |S| Gain(Total, Out. Look)= Entropy(Total) – n ∑ |Out. Look| * Entropy(Out. Look) i=1 |Total| 0 6 0. 8112781 4 0. 918296 Gain(Total, Out. Look)= 0. 8631206 – ((4/14*0)+(5/14*0. 722)+(5/14*0. 97)) Gain(Total, Out. Look)=0. 258521

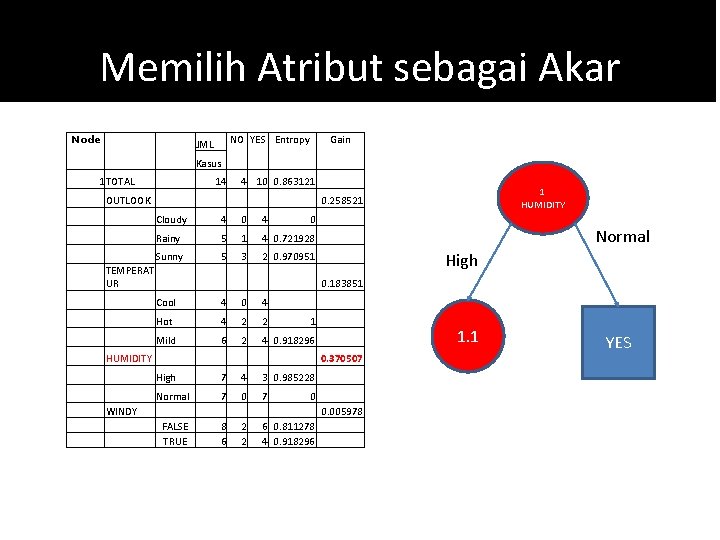

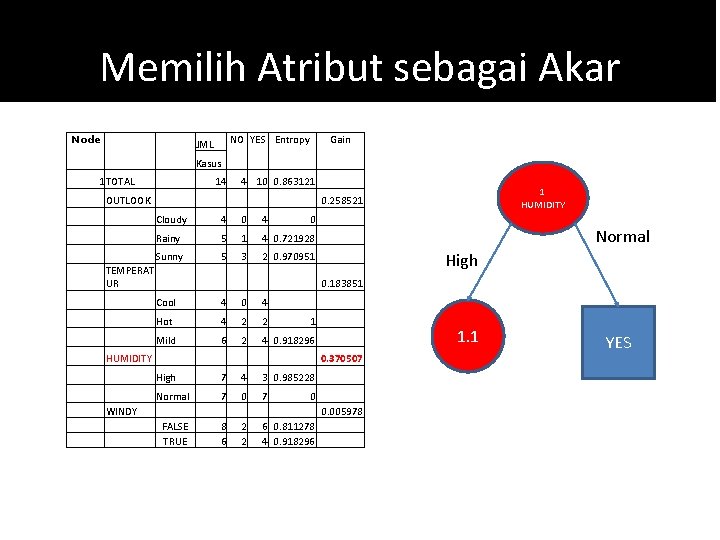

Memilih Atribut sebagai Akar Node NO YES Entropy JML 1 TOTAL Gain Kasus 14 4 10 0. 863121 OUTLOOK Cloudy 4 0 4 Rainy 5 1 4 0. 721928 5 3 2 0. 970951 Sunny TEMPERAT UR Cool 4 0 4 Hot 4 2 2 Mild 6 2 4 0. 918296 HUMIDITY High 7 4 3 0. 985228 WINDY Normal FALSE TRUE 7 0 7 2 2 1 HUMIDITY 0. 258521 0 8 6 Normal High 0. 183851 1 1. 1 0. 370507 0 6 0. 811278 4 0. 918296 0. 005978 YES

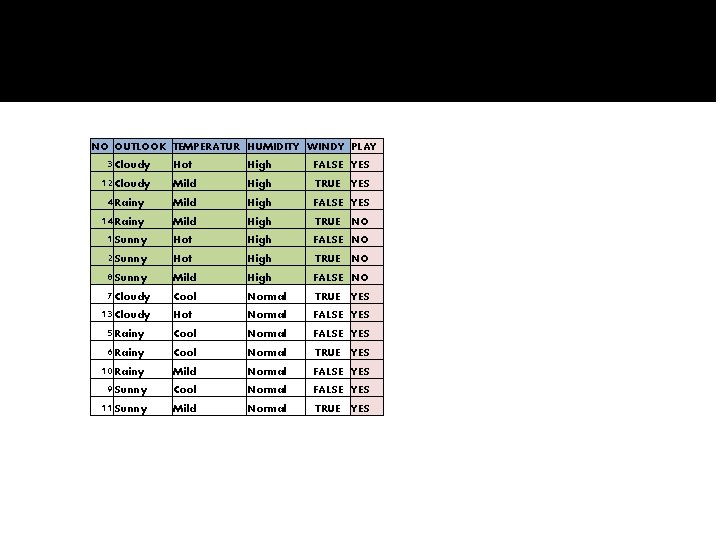

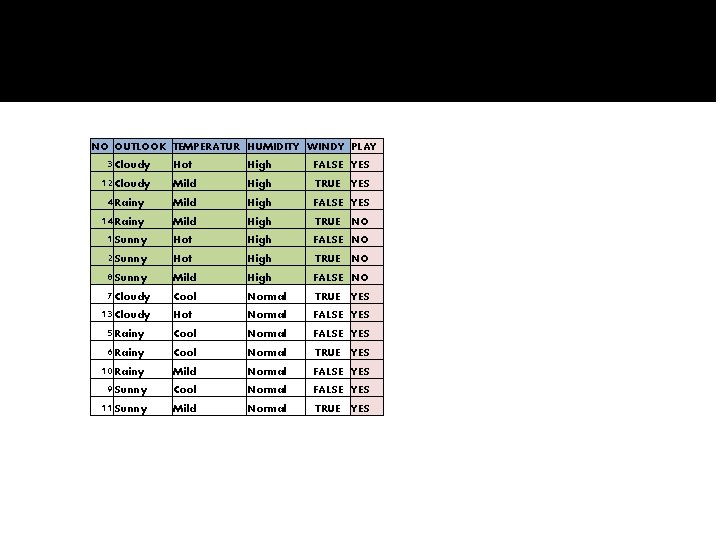

NO OUTLOOK TEMPERATUR HUMIDITY WINDY PLAY 3 Cloudy 12 Cloudy 4 Rainy 1 Sunny 2 Sunny 8 Sunny 7 Cloudy 13 Cloudy 5 Rainy 6 Rainy 10 Rainy 9 Sunny 11 Sunny Hot High FALSE YES Mild High TRUE YES Mild High FALSE YES Mild High TRUE NO Hot High FALSE NO Hot High TRUE NO Mild High FALSE NO Cool Normal TRUE YES Hot Normal FALSE YES Cool Normal TRUE YES Mild Normal FALSE YES Cool Normal FALSE YES Mild Normal TRUE YES

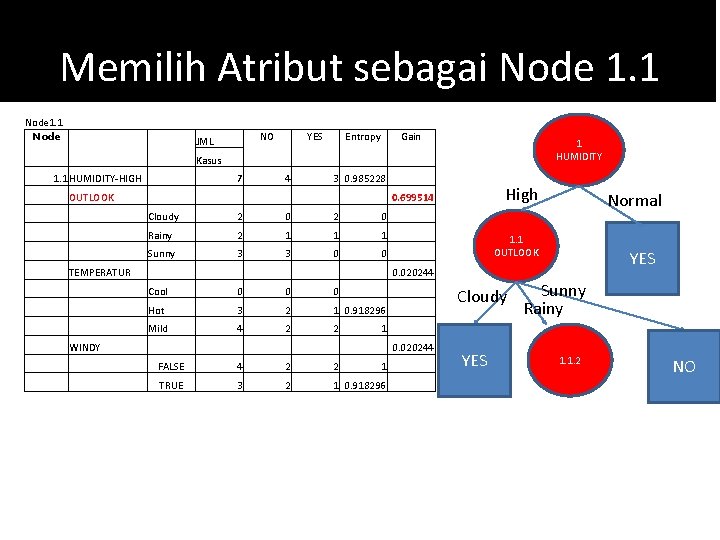

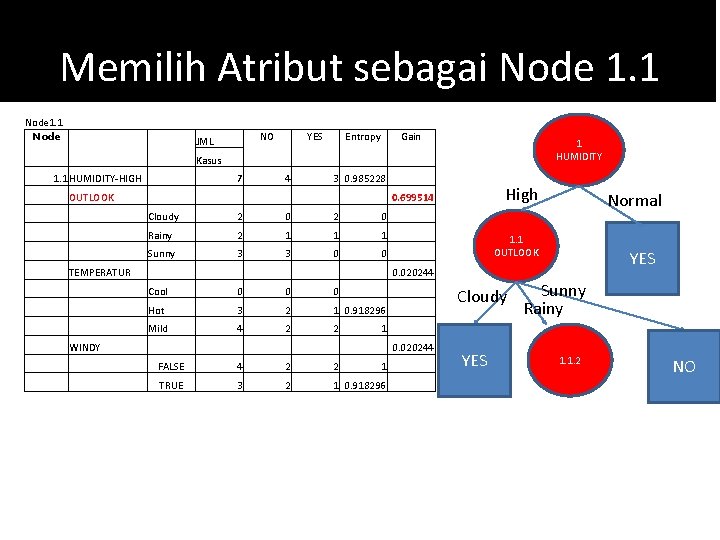

Memilih Atribut sebagai Node 1. 1 Node NO JML YES Entropy Gain 1 HUMIDITY Kasus 1. 1 HUMIDITY-HIGH 7 4 3 0. 985228 OUTLOOK Cloudy 2 0 Rainy 2 1 1 1 Sunny 3 3 0 0 TEMPERATUR Cool 0 0 0 Hot 3 2 1 0. 918296 Mild 4 2 2 WINDY FALSE 4 2 2 TRUE 3 2 1 0. 918296 High 0. 699514 Normal 1. 1 OUTLOOK YES 0. 020244 Cloudy Sunny Rainy 1 0. 020244 1 YES 1. 1. 2 NO

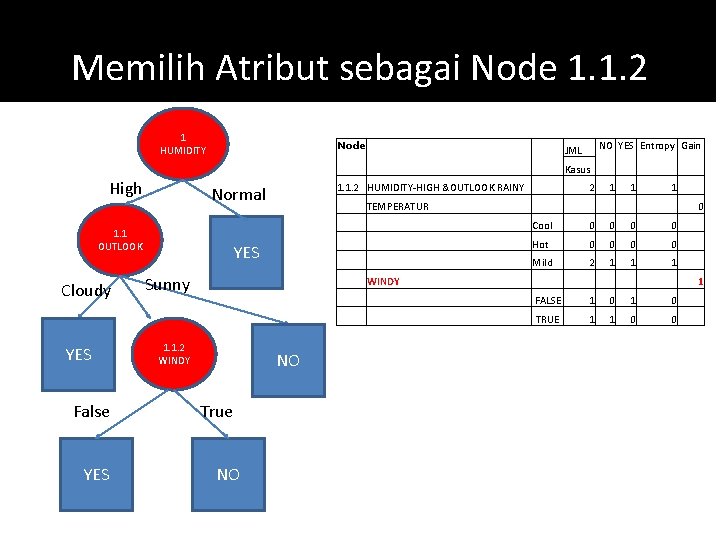

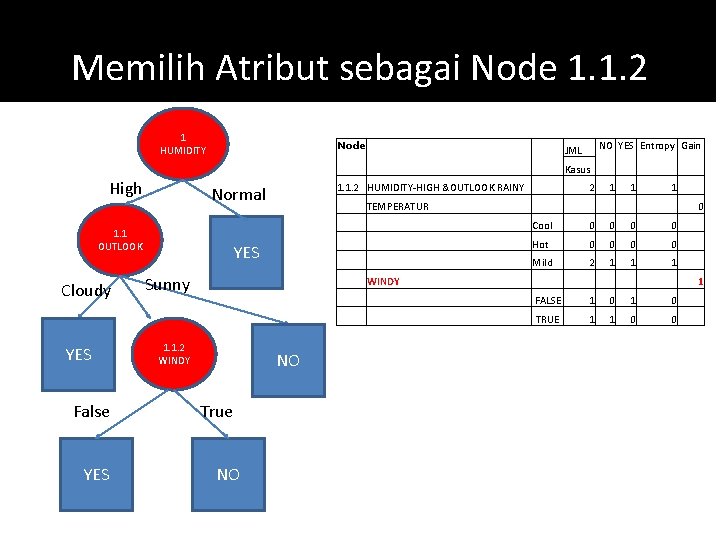

Memilih Atribut sebagai Node 1. 1. 2 1 HUMIDITY Node High 1. 1 OUTLOOK Cloudy YES False YES Sunny 1. 1. 2 WINDY NO True NO Kasus 1. 1. 2 HUMIDITY-HIGH &OUTLOOK RAINY Normal NO YES Entropy Gain JML 2 1 1 TEMPERATUR Cool 0 0 Hot 0 0 Mild 2 1 1 1 WINDY FALSE 1 0 TRUE 1 1 0 0 1 0 1