Categorizao de Documentos modificada Mariana Lara Neves Flvia

- Slides: 31

Categorização de Documentos (modificada) Mariana Lara Neves Flávia Barros CIn/UFPE 1

Roteiro Introdução Categorização de Documentos Preparação de Dados Construção Manual do Classificador Construção Automática do Classificador Comparação das Abordagens Referências CIn/UFPE 2

Categorização de Documentos Definição: n atribuição de uma ou mais classes prédefinidas aos documentos Objetivos: n n CIn/UFPE Organizar os documentos Facilitar a sua busca automática 3

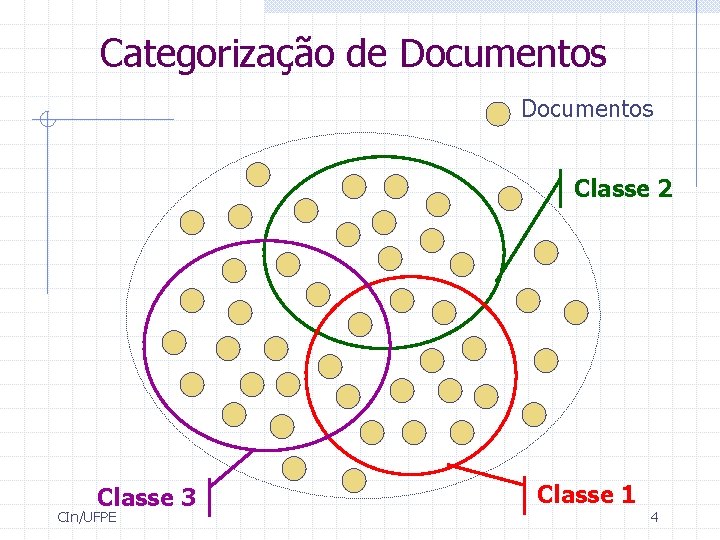

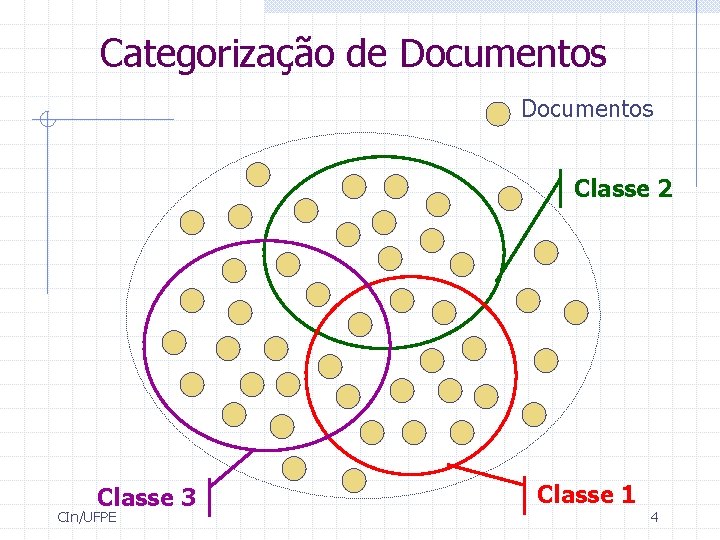

Categorização de Documentos Classe 2 Classe 3 CIn/UFPE Classe 1 4

Categorização de Documentos Classificação Manual: n Leitura dos documentos por um especialista Construção Manual do Classificador: n Sistemas baseados em conhecimento w Base de Regras escrita manualmente Construção Automática do Classificador: n CIn/UFPE Algoritmos de aprendizagem automática 5

Construção do Classificador Conjunto de treinamento: n n Aquisição do conhecimento ou Treinamento do algoritmo Ajuste do sistema Conjunto de teste: n n CIn/UFPE Diferente do conjunto de treinamento Avaliação do desempenho do sistema 6

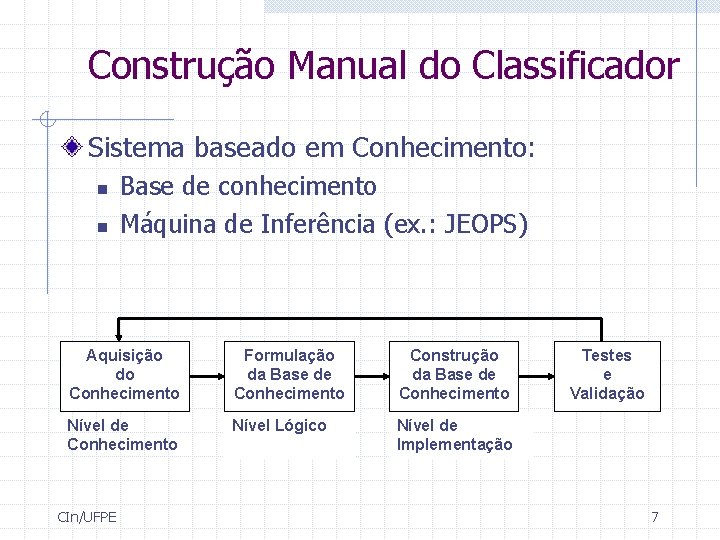

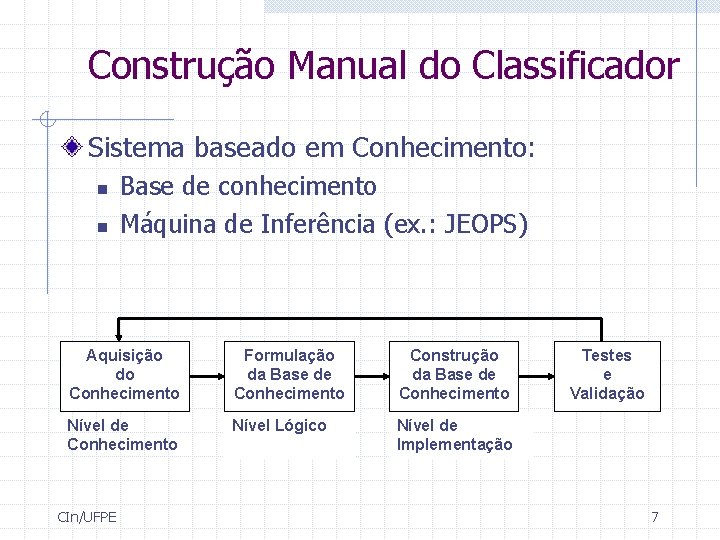

Construção Manual do Classificador Sistema baseado em Conhecimento: n n Base de conhecimento Máquina de Inferência (ex. : JEOPS) Aquisição do Conhecimento Formulação da Base de Conhecimento Construção da Base de Conhecimento Nível Lógico Nível de Implementação CIn/UFPE Testes e Validação 7

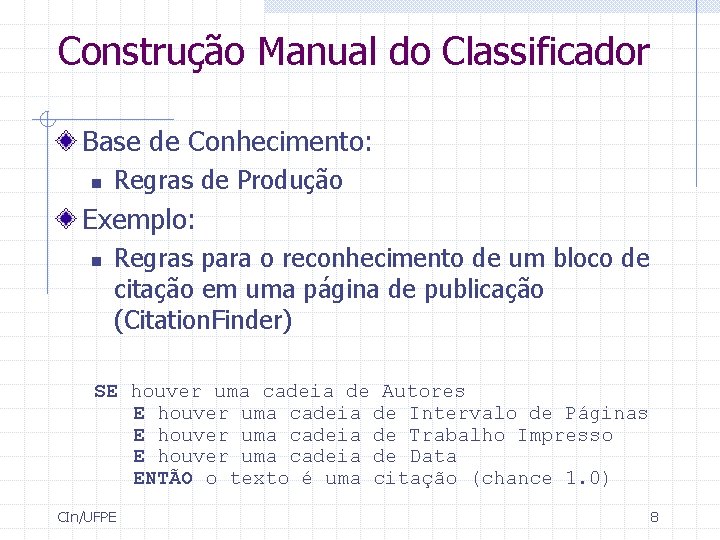

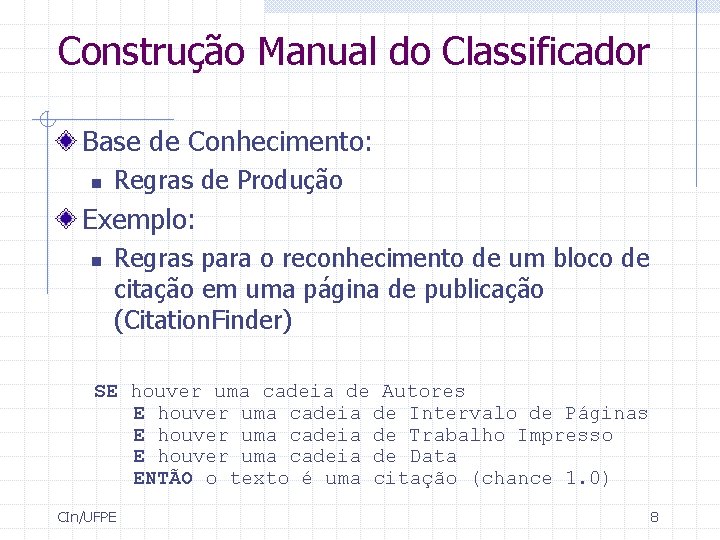

Construção Manual do Classificador Base de Conhecimento: n Regras de Produção Exemplo: n Regras para o reconhecimento de um bloco de citação em uma página de publicação (Citation. Finder) SE houver uma cadeia de Autores E houver uma cadeia de Intervalo de Páginas E houver uma cadeia de Trabalho Impresso E houver uma cadeia de Data ENTÃO o texto é uma citação (chance 1. 0) CIn/UFPE 8

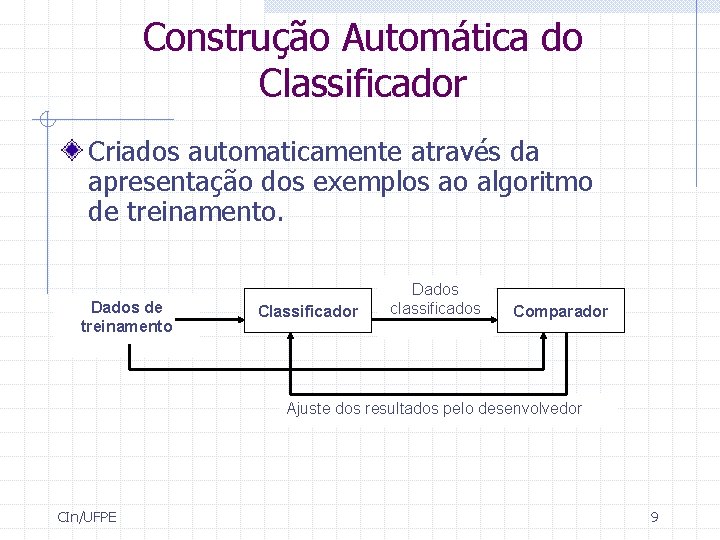

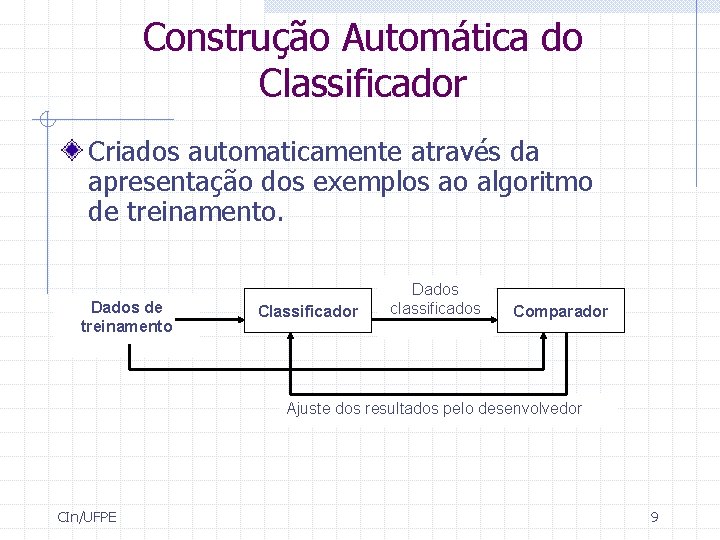

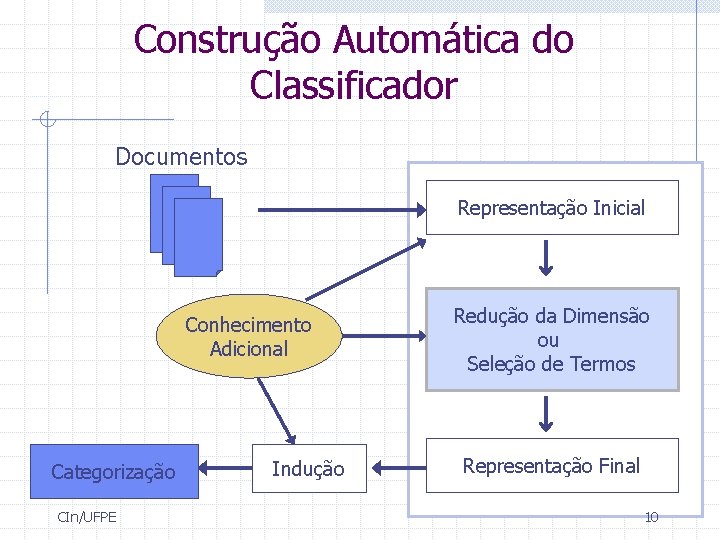

Construção Automática do Classificador Criados automaticamente através da apresentação dos exemplos ao algoritmo de treinamento. Dados de treinamento Classificador Dados classificados Comparador Ajuste dos resultados pelo desenvolvedor CIn/UFPE 9

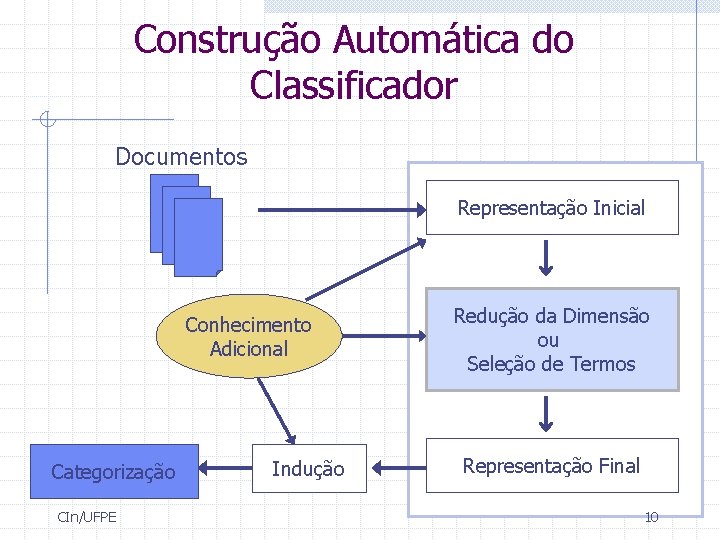

Construção Automática do Classificador Documentos Representação Inicial Conhecimento Adicional Categorização CIn/UFPE Indução Redução da Dimensão ou Seleção de Termos Representação Final 10

Construção Automática do Classificador Representação Inicial dos Documentos n CIn/UFPE Utiliza pré-processamento com as mesmas técnicas de recuperação de informação!! 11

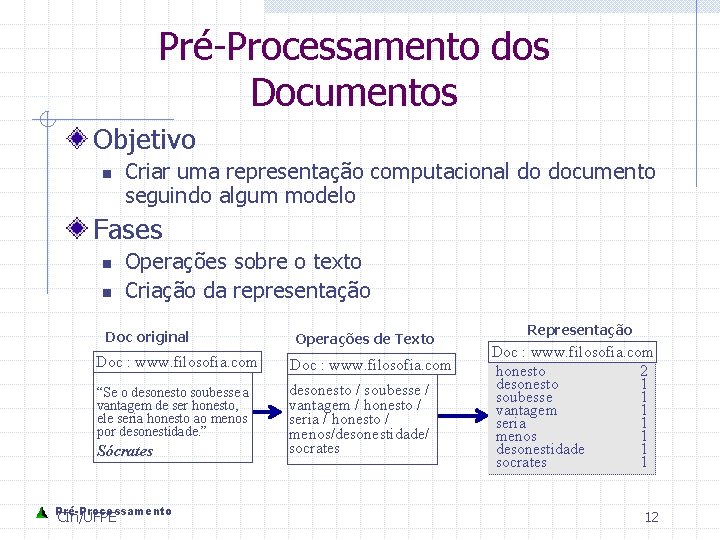

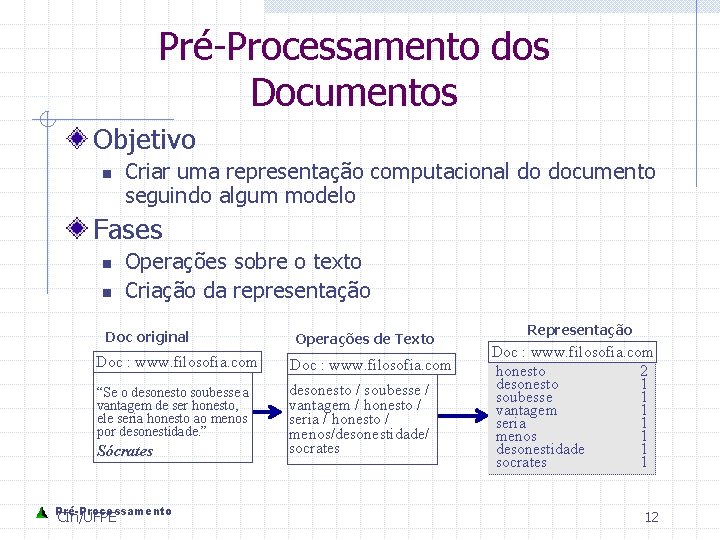

Pré-Processamento dos Documentos Objetivo n Criar uma representação computacional do documento seguindo algum modelo Fases n n Operações sobre o texto Criação da representação Doc original Operações de Texto Doc : www. filosofia. com “Se o desonesto soubesse a vantagem de ser honesto, ele seria honesto ao menos por desonestidade. ” desonesto / soubesse / vantagem / honesto / seria / honesto / menos/desonestidade/ socrates Sócrates Pré-Processamento CIn/UFPE Representação Doc : www. filosofia. com honesto 2 desonesto 1 soubesse 1 vantagem 1 seria 1 menos 1 desonestidade 1 socrates 1 12

Pré-Processamento: Operações sobre o texto Análise léxica n Converte uma cadeia de caracteres em uma cadeia de palavras/termos Eliminação de stopwords n Palavras consideradas irrelevantes w Ex. : artigos, pronomes, alguns verbos, “WWW”. . . Pré-Processamento CIn/UFPE - 13

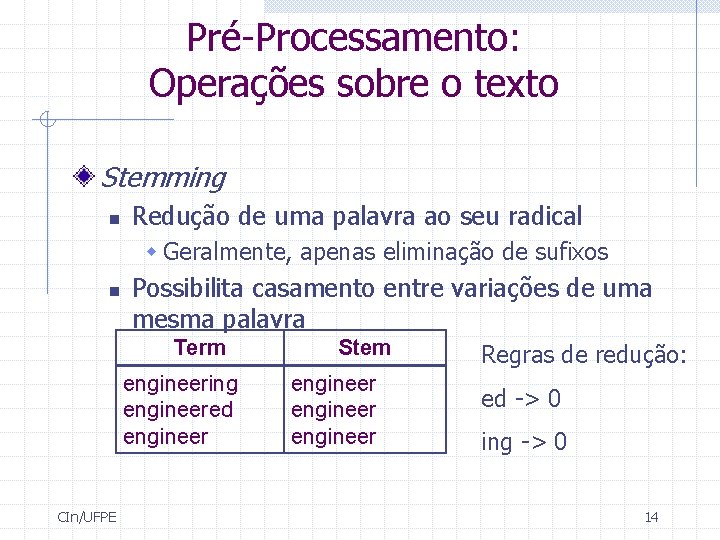

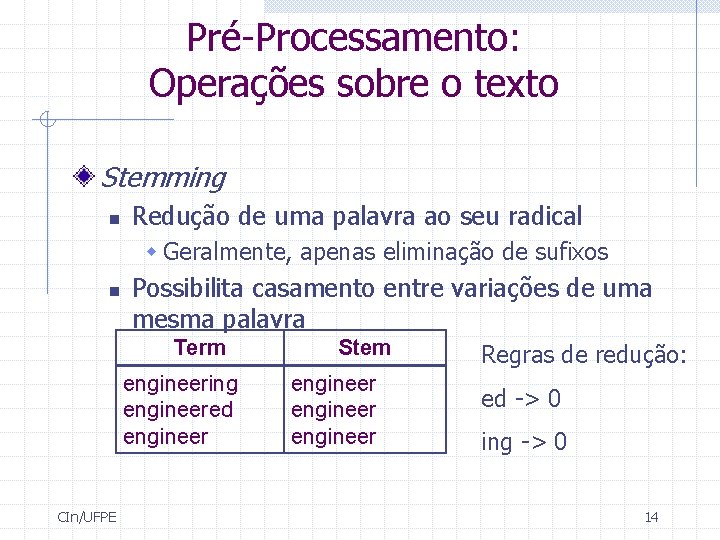

Pré-Processamento: Operações sobre o texto Stemming n Redução de uma palavra ao seu radical w Geralmente, apenas eliminação de sufixos n Possibilita casamento entre variações de uma mesma palavra Term engineering engineered engineer CIn/UFPE Stem engineer Regras de redução: ed -> 0 ing -> 0 14

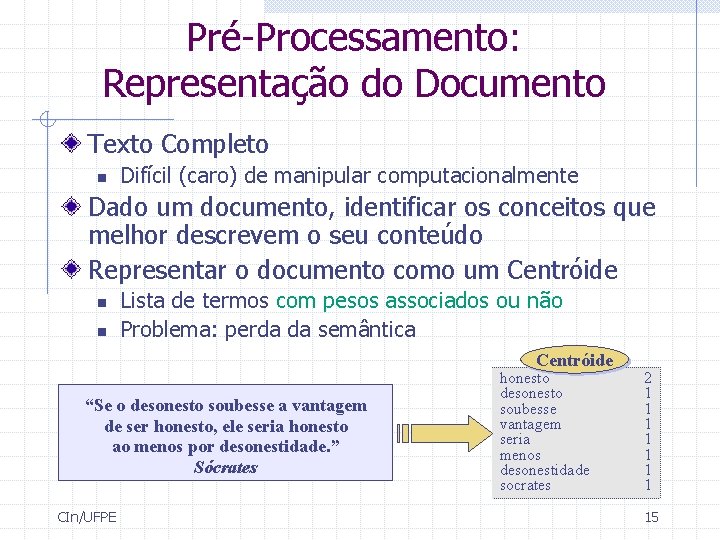

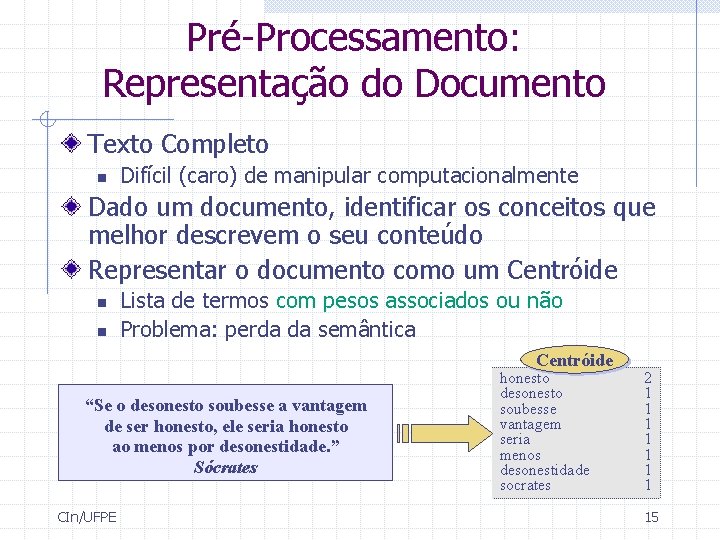

Pré-Processamento: Representação do Documento Texto Completo n Difícil (caro) de manipular computacionalmente Dado um documento, identificar os conceitos que melhor descrevem o seu conteúdo Representar o documento como um Centróide n n Lista de termos com pesos associados ou não Problema: perda da semântica Centróide “Se o desonesto soubesse a vantagem de ser honesto, ele seria honesto ao menos por desonestidade. ” Sócrates CIn/UFPE honesto desonesto soubesse vantagem seria menos desonestidade socrates 2 1 1 1 15

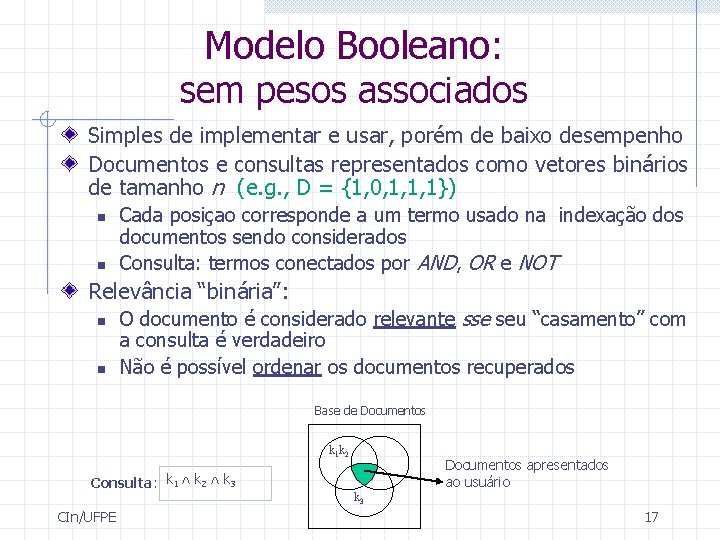

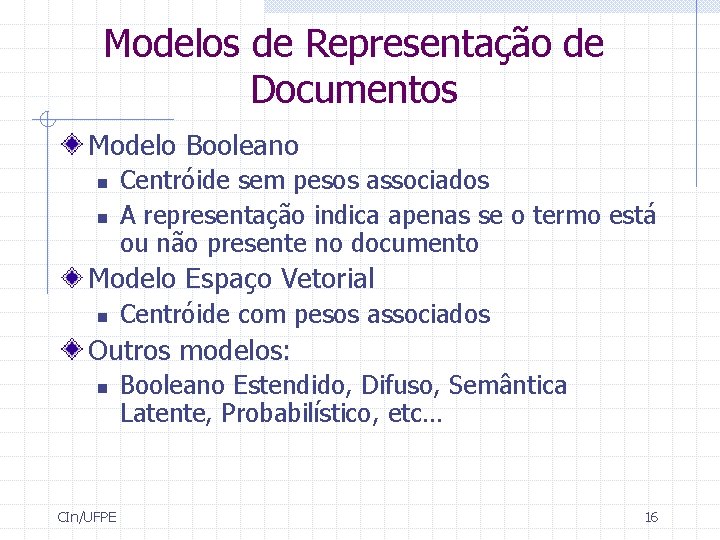

Modelos de Representação de Documentos Modelo Booleano n n Centróide sem pesos associados A representação indica apenas se o termo está ou não presente no documento Modelo Espaço Vetorial n Centróide com pesos associados Outros modelos: n CIn/UFPE Booleano Estendido, Difuso, Semântica Latente, Probabilístico, etc… 16

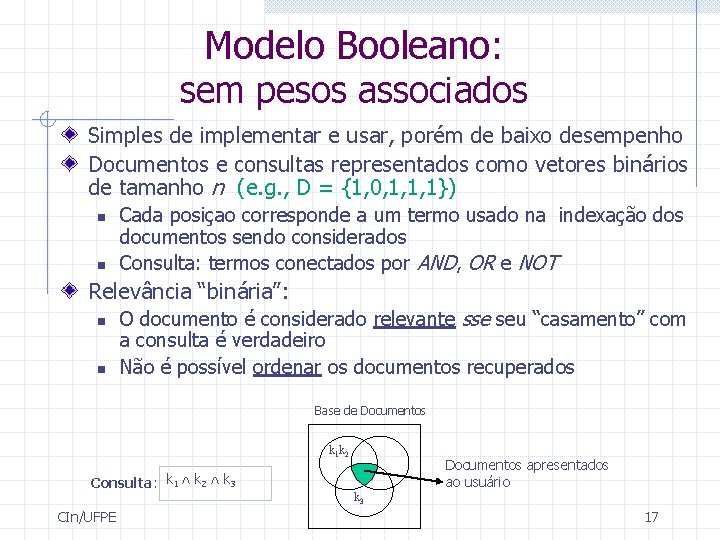

Modelo Booleano: sem pesos associados Simples de implementar e usar, porém de baixo desempenho Documentos e consultas representados como vetores binários de tamanho n (e. g. , D = {1, 0, 1, 1, 1}) n n Cada posiçao corresponde a um termo usado na indexação dos documentos sendo considerados Consulta: termos conectados por AND, OR e NOT Relevância “binária”: n n O documento é considerado relevante sse seu “casamento” com a consulta é verdadeiro Não é possível ordenar os documentos recuperados Base de Documentos k 1 k 2 Consulta: k 1 k 2 k 3 CIn/UFPE Documentos apresentados ao usuário k 3 17

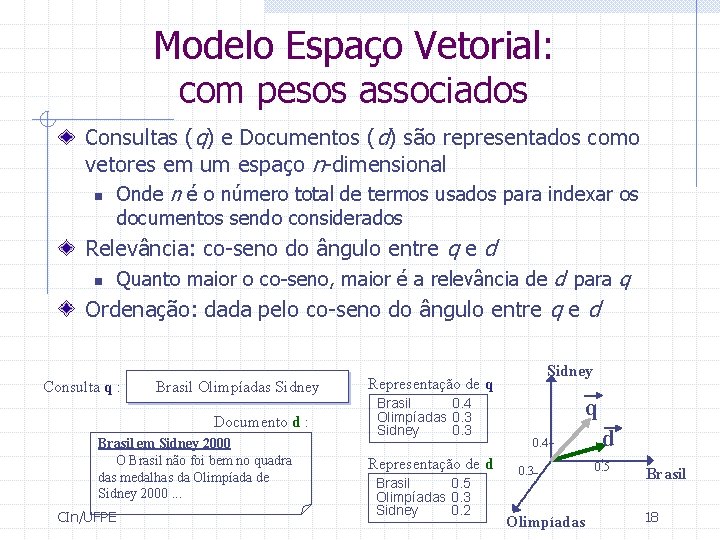

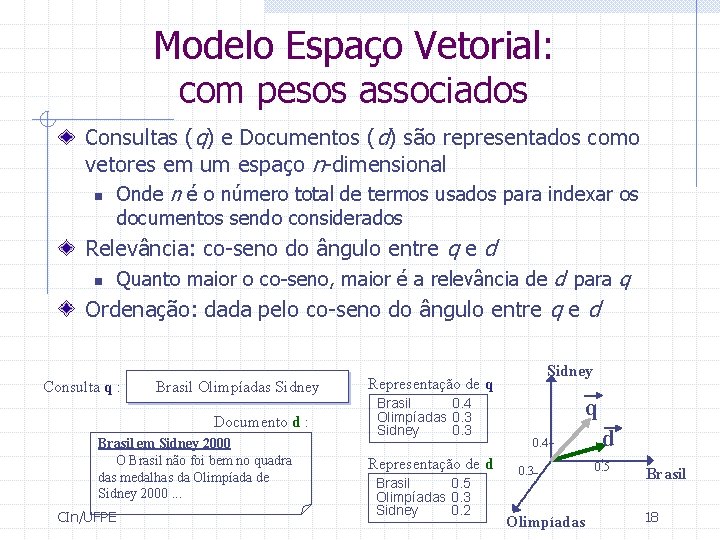

Modelo Espaço Vetorial: com pesos associados Consultas (q) e Documentos (d) são representados como vetores em um espaço n-dimensional n Onde n é o número total de termos usados para indexar os documentos sendo considerados Relevância: co-seno do ângulo entre q e d n Quanto maior o co-seno, maior é a relevância de d para q Ordenação: dada pelo co-seno do ângulo entre q e d Consulta q : Brasil Olimpíadas Sidney Documento d : Brasil em Sidney 2000 O Brasil não foi bem no quadra das medalhas da Olimpíada de Sidney 2000. . . CIn/UFPE Sidney Representação de q Brasil 0. 4 Olimpíadas 0. 3 Sidney 0. 3 Representação de d Brasil 0. 5 Olimpíadas 0. 3 Sidney 0. 2 q 0. 4 0. 3 Olimpíadas d 0. 5 Brasil 18

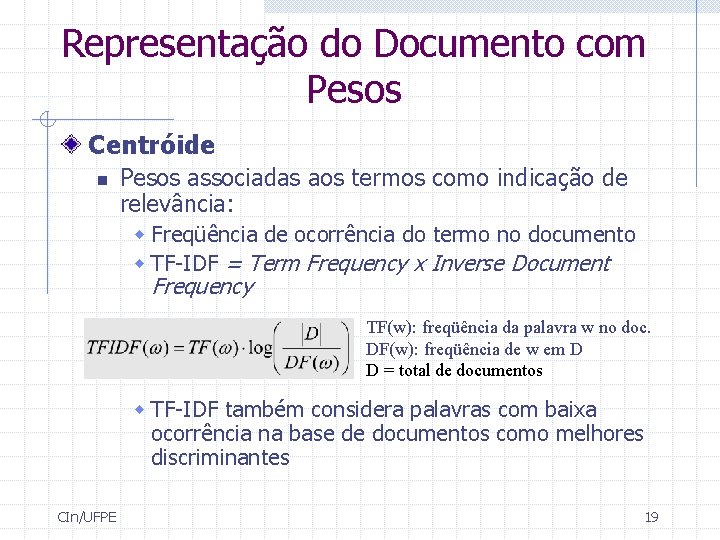

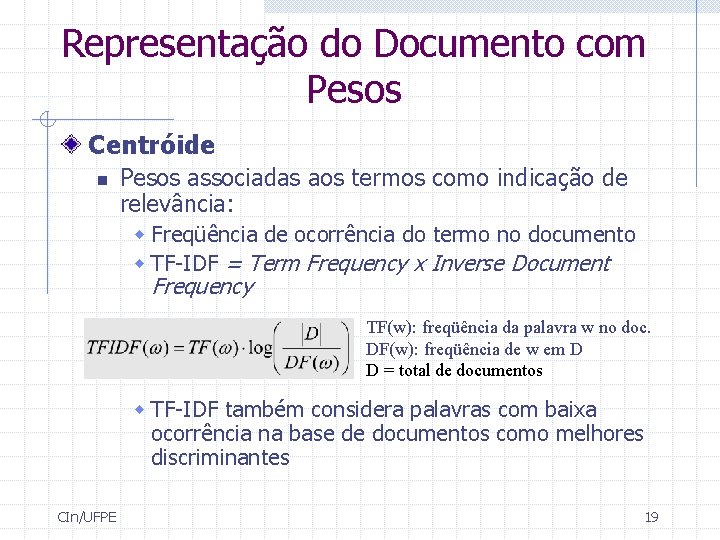

Representação do Documento com Pesos Centróide n Pesos associadas aos termos como indicação de relevância: w Freqüência de ocorrência do termo no documento w TF-IDF = Term Frequency x Inverse Document Frequency TF(w): freqüência da palavra w no doc. DF(w): freqüência de w em D D = total de documentos w TF-IDF também considera palavras com baixa ocorrência na base de documentos como melhores discriminantes CIn/UFPE 19

Representação do Documento com Pesos Centróide n Limitar tamanho do centróide em 50 mantendo apenas termos com maior peso w Aumenta a eficiência do sistema w Estudos mostram que isso não altera muito o seu poder de representação do centróide CIn/UFPE 20

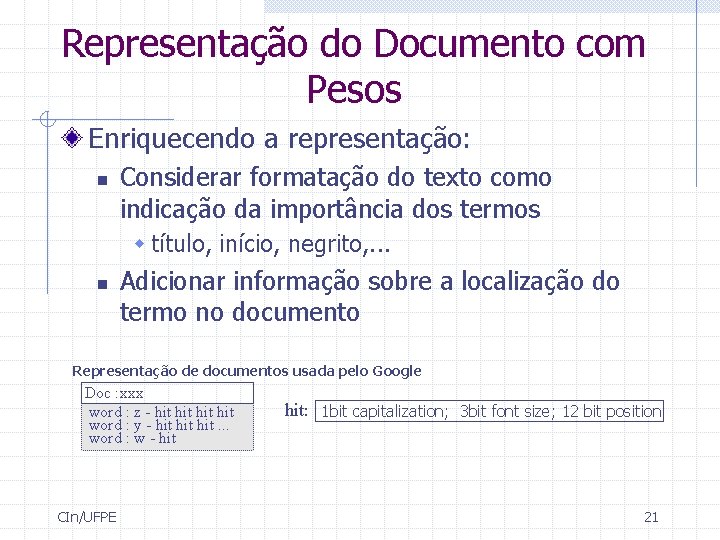

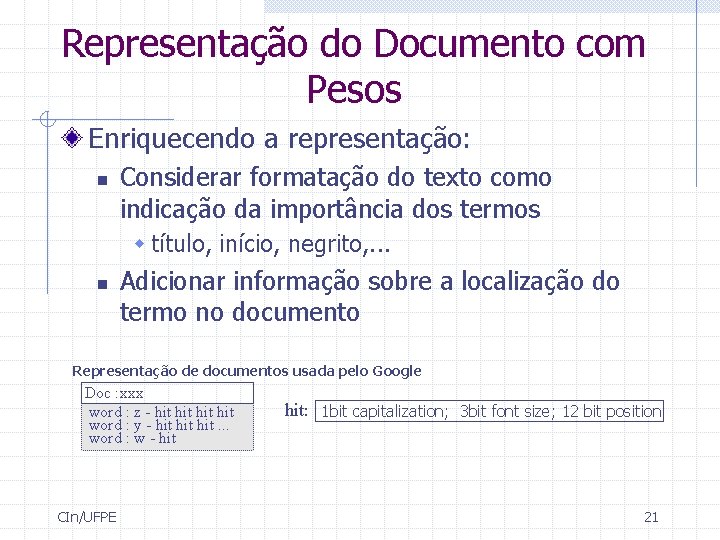

Representação do Documento com Pesos Enriquecendo a representação: n Considerar formatação do texto como indicação da importância dos termos w título, início, negrito, . . . n Adicionar informação sobre a localização do termo no documento Representação de documentos usada pelo Google Doc : xxx word : z - hit hit word : y - hit hit. . . word : w - hit CIn/UFPE hit: 1 bit capitalization; 3 bit font size; 12 bit position 21

Redução da Dimensão da Representação Inicial Objetivo: n Reduzir o tamanho dos centróides para diminuir o risco de super-especialização do classificador gerado (overfitting) Abordagens: n n Seleção de um subconjunto de termos Indução Construtiva Tipos de Redução: n n CIn/UFPE Global: considera um conjunto de termos para todas as classes Local: considera um conjunto de termos para cada classes 22

Seleção dos Termos Cada termo recebe uma “relevância”, que é usada para ordenar a lista de termos Os “n” primeiros termos mais relevantes são utilizados para treinar o algoritmo Várias técnicas: n n Freqüência de ocorrência nos documentos (redução global) Outras (redução local) w Entropia, Coeficiente de Correlação, 2 , . . . CIn/UFPE 23

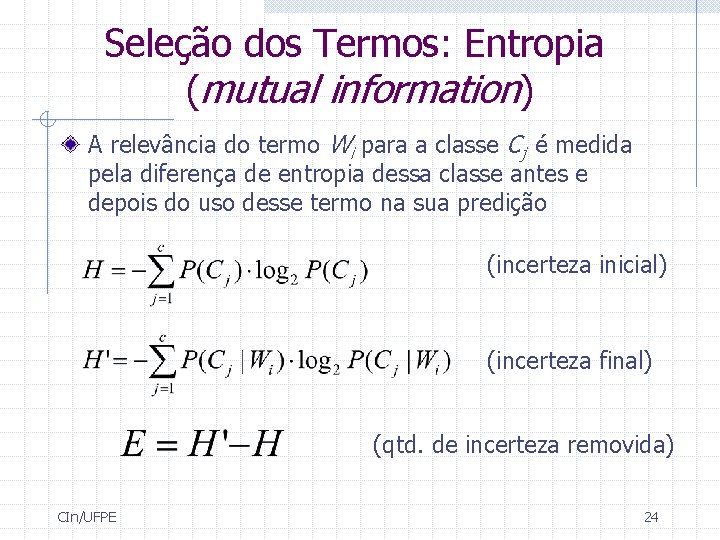

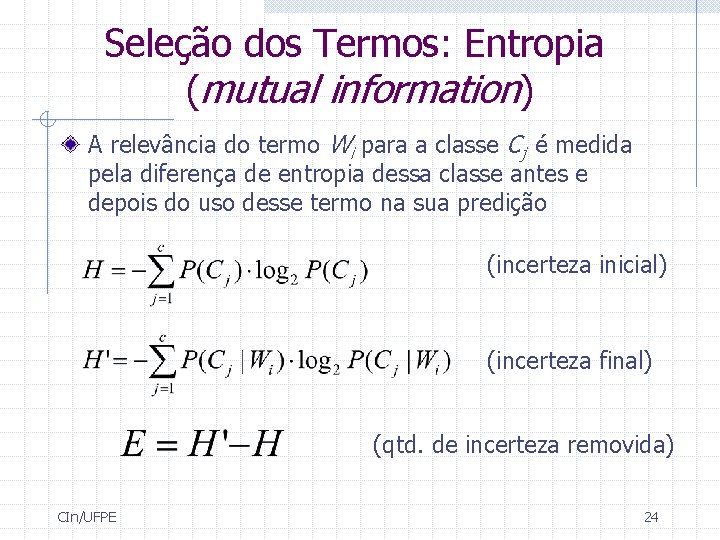

Seleção dos Termos: Entropia (mutual information) A relevância do termo Wi para a classe Cj é medida pela diferença de entropia dessa classe antes e depois do uso desse termo na sua predição (incerteza inicial) (incerteza final) (qtd. de incerteza removida) CIn/UFPE 24

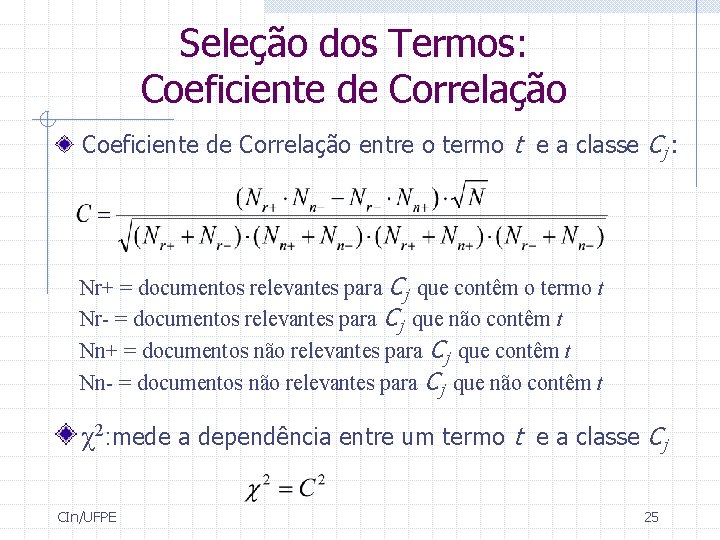

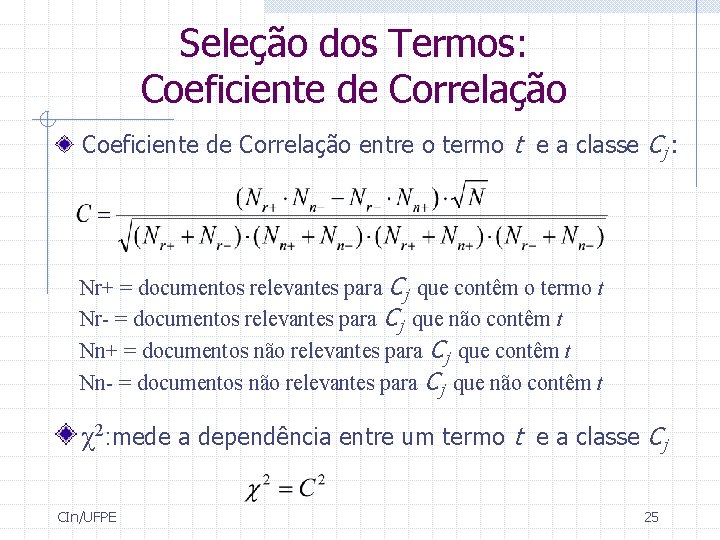

Seleção dos Termos: Coeficiente de Correlação entre o termo t e a classe Cj : Nr+ = documentos relevantes para Cj que contêm o termo t Nr- = documentos relevantes para Cj que não contêm t Nn+ = documentos não relevantes para Cj que contêm t Nn- = documentos não relevantes para Cj que não contêm t χ2: mede a dependência entre um termo t e a classe Cj CIn/UFPE 25

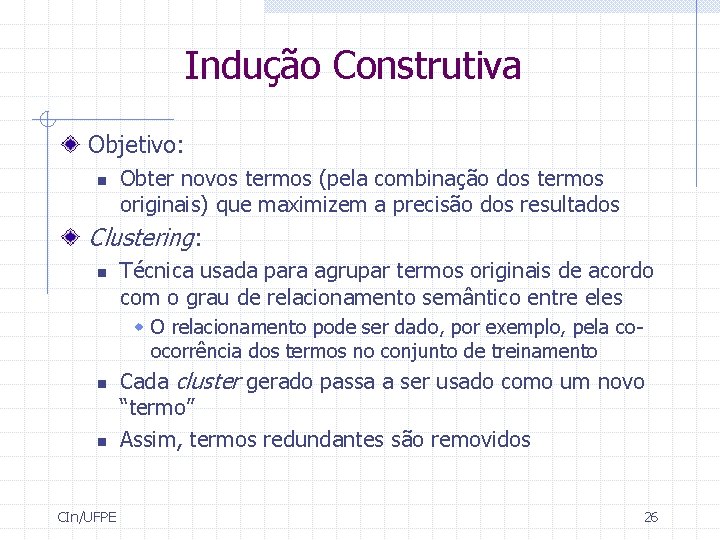

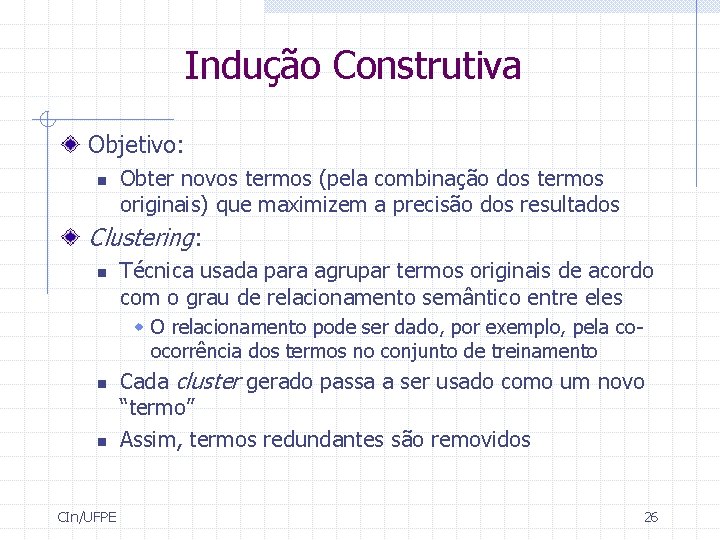

Indução Construtiva Objetivo: n Obter novos termos (pela combinação dos termos originais) que maximizem a precisão dos resultados Clustering: n Técnica usada para agrupar termos originais de acordo com o grau de relacionamento semântico entre eles w O relacionamento pode ser dado, por exemplo, pela coocorrência dos termos no conjunto de treinamento n n CIn/UFPE Cada cluster gerado passa a ser usado como um novo “termo” Assim, termos redundantes são removidos 26

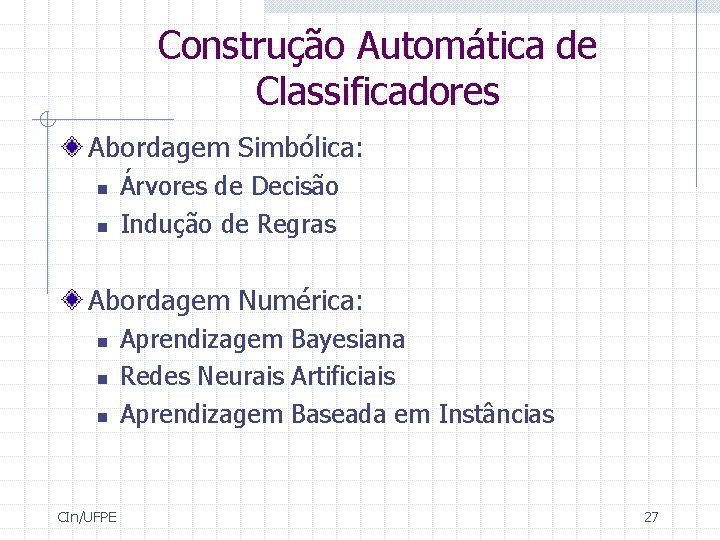

Construção Automática de Classificadores Abordagem Simbólica: n n Árvores de Decisão Indução de Regras Abordagem Numérica: n n n CIn/UFPE Aprendizagem Bayesiana Redes Neurais Artificiais Aprendizagem Baseada em Instâncias 27

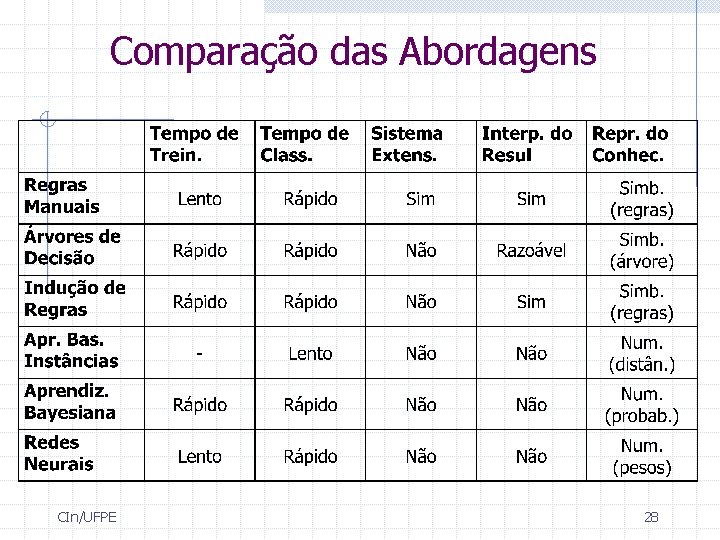

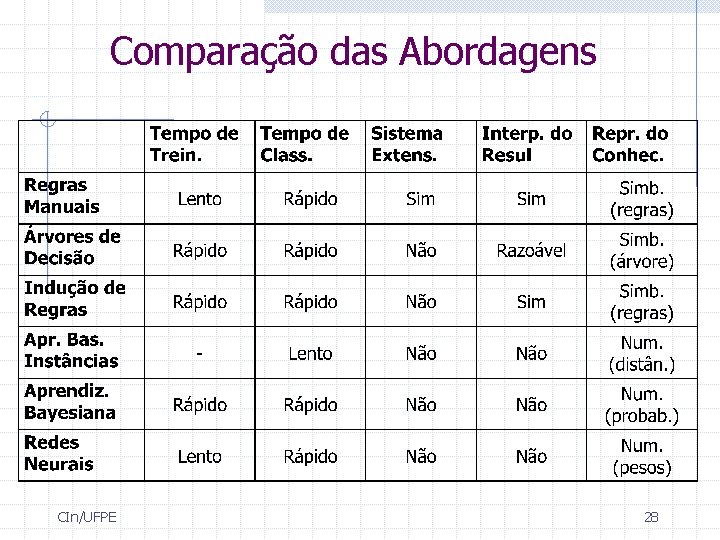

Comparação das Abordagens CIn/UFPE 28

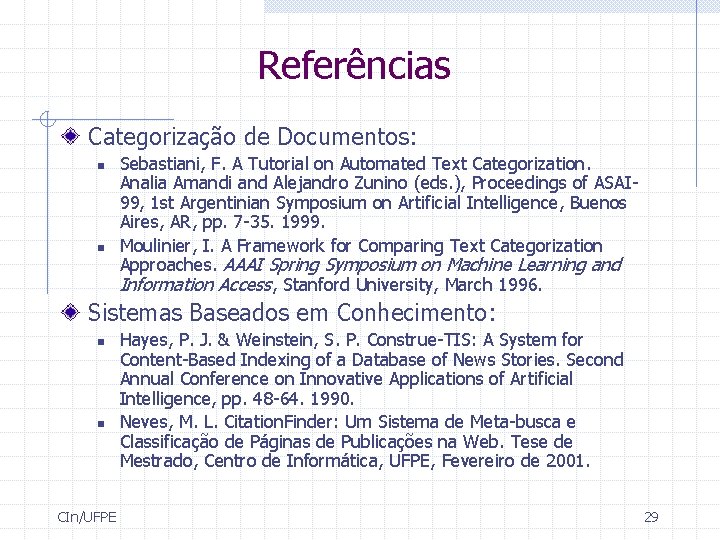

Referências Categorização de Documentos: n n Sebastiani, F. A Tutorial on Automated Text Categorization. Analia Amandi and Alejandro Zunino (eds. ), Proceedings of ASAI 99, 1 st Argentinian Symposium on Artificial Intelligence, Buenos Aires, AR, pp. 7 -35. 1999. Moulinier, I. A Framework for Comparing Text Categorization Approaches. AAAI Spring Symposium on Machine Learning and Information Access, Stanford University, March 1996. Sistemas Baseados em Conhecimento: n n CIn/UFPE Hayes, P. J. & Weinstein, S. P. Construe-TIS: A System for Content-Based Indexing of a Database of News Stories. Second Annual Conference on Innovative Applications of Artificial Intelligence, pp. 48 -64. 1990. Neves, M. L. Citation. Finder: Um Sistema de Meta-busca e Classificação de Páginas de Publicações na Web. Tese de Mestrado, Centro de Informática, UFPE, Fevereiro de 2001. 29

Referências Aprendizagem de Máquina: n Aprendizagem Bayesiana (Naive Bayes): Mc. Callum, A. K. ; Nigam, K. ; Rennie, J. & Seymore, K. Automating the Construction of Internet Portals with Machine Learning. Information Retrieval Journal, volume 3, pages 127 -163. 2000. n Redes Neurais: Wiener, E. ; Pedersen, J. O. & Weigend, A. S. A Neural Network Approach to Topic Spotting. In Proceedings of the 4 th Symposium on Document Analysis and Information Retrieval (SDAIR 95), pages 317332, Las Vegas, NV, USA, April 24 -26. 1995. n Aprendizagem Baseada em Instâncias: Masand, B; Linoff, G. & Waltz, D. Classifying News Stories using Memory Based Reasoning. Proceedings of SIGIR-92, 15 th ACM International Conference on Research and Development in Information Retrieval, pp. 59 -65, Denmark. 1992. CIn/UFPE 30

Referências Aprendizagem de Máquina (cont. ): Árvores de Decisão: n Lewis, D. D. & Ringuette, M. A Comparison of Two Learning Algorithms for Text Categorization. In Third Annual Symposium on Document Analysis and Information Retrieval, pp. 81 -93. 1994. Indução de Regras: n Apté, C. ; Damerau, F. & Weiss, S. Automated Learning of Decision Rules for Text Categorization. ACM Transactions on Information Systems, Vol. 12, No. 3, July 1994, pages 233 -151. 1994. Seleção de Termos: n Ng, H. T. ; Goh, W. B. & Low, K. L. Feature Selection, Perceptron learning and a Usability Case Study for Text Categorization. Proceedings of SIGIR-97, 20 th ACM International Conference on Research and Development in Information Retrieval, pp. 67 -73, Philadelphia, PA, USA. 1997. n CIn/UFPE Maron, M. E. Automatic Indexing: An Experimental Inquiry. Journal of ACM, 8: 404 -417. 1961. 31