BI GING NHP MN KHAI PH D LIU

BÀI GIẢNG NHẬP MÔN KHAI PHÁ DỮ LIỆU CHƯƠNG 3. HIỂU BÀI TOÁN, HIỂU DỮ LIỆU VÀ TIỀN XỬ LÝ DỮ LIỆU PGS. TS. Hà Quang Thụy HÀ NỘI, 09 -2018 TRƯỜNG ĐẠI HỌC CÔNG NGHỆ ĐẠI HỌC QUỐC GIA HÀ NỘI http: //uet. vnu. edu. vn/~thuyhq/ 1

Nội dung n Hiểu bài toán Ø n Hiểu dữ liệu Ø n Vai trò của hiểu dữ liệu, Đối tượng DL và kiểu thuộc tính, Độ đo tương tự và không tương tự của DL, Thu thập dữ liệu, Mô tả thống kê cơ bản của DL, Trực quan hóa DL, Đánh giá và lập hồ sơ DL Tiền xử lý dữ liệu Ø n Năm yếu tố để hiểu bài toán Vai trò của tiền xử lý dữ liệu, Làm sạch dữ liệu, Tích hợp và chuyển dạng dữ liệu, Rút gọn dữ liệu, Rời rạc và sinh kiến trúc khái niệm Một số thách thức về dữ liệu và mô hình Ø June 18, 2021 Thiếu dữ liệu, dữ liệu không đại diện, đặc trưng không đại diện, mô hình quá khớp-không khớp Công nghệ tri thức 2

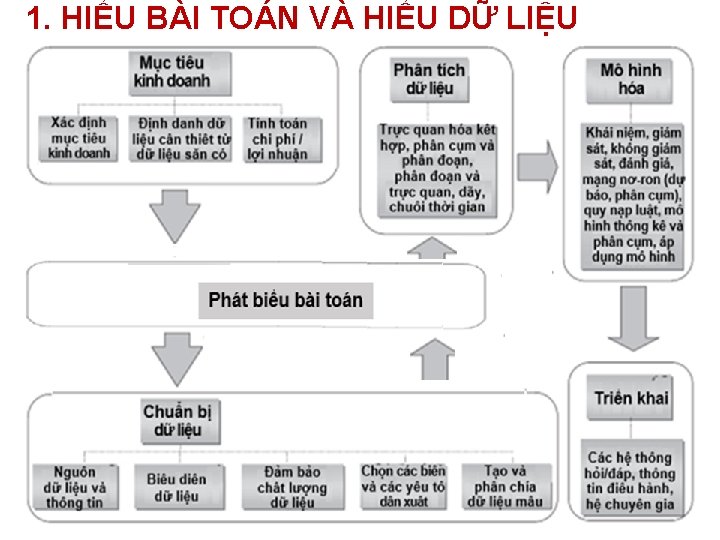

1. HIỂU BÀI TOÁN VÀ HIỂU DỮ LIỆU

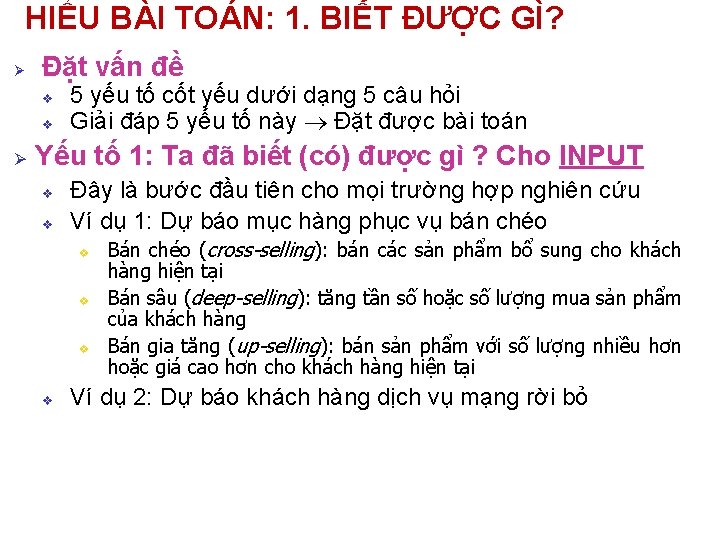

HIỂU BÀI TOÁN: 1. BIẾT ĐƯỢC GÌ? Ø Đặt vấn đề v v Ø 5 yếu tố cốt yếu dưới dạng 5 câu hỏi Giải đáp 5 yếu tố này Đặt được bài toán Yếu tố 1: Ta đã biết (có) được gì ? Cho INPUT v v Đây là bước đầu tiên cho mọi trường hợp nghiên cứu Ví dụ 1: Dự báo mục hàng phục vụ bán chéo v v Bán chéo (cross-selling): bán các sản phẩm bổ sung cho khách hàng hiện tại Bán sâu (deep-selling): tăng tần số hoặc số lượng mua sản phẩm của khách hàng Bán gia tăng (up-selling): bán sản phẩm với số lượng nhiều hơn hoặc giá cao hơn cho khách hàng hiện tại Ví dụ 2: Dự báo khách hàng dịch vụ mạng rời bỏ

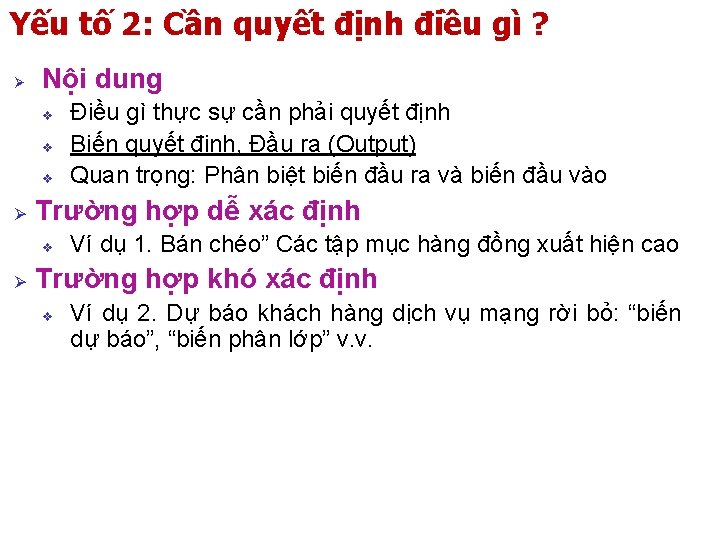

Yếu tố 2: Cần quyết định điều gì ? Ø Nội dung v v v Ø Trường hợp dễ xác định v Ø Điều gì thực sự cần phải quyết định Biến quyết định, Đầu ra (Output) Quan trọng: Phân biệt biến đầu ra và biến đầu vào Ví dụ 1. Bán chéo” Các tập mục hàng đồng xuất hiện cao Trường hợp khó xác định v Ví dụ 2. Dự báo khách hàng dịch vụ mạng rời bỏ: “biến dự báo”, “biến phân lớp” v. v.

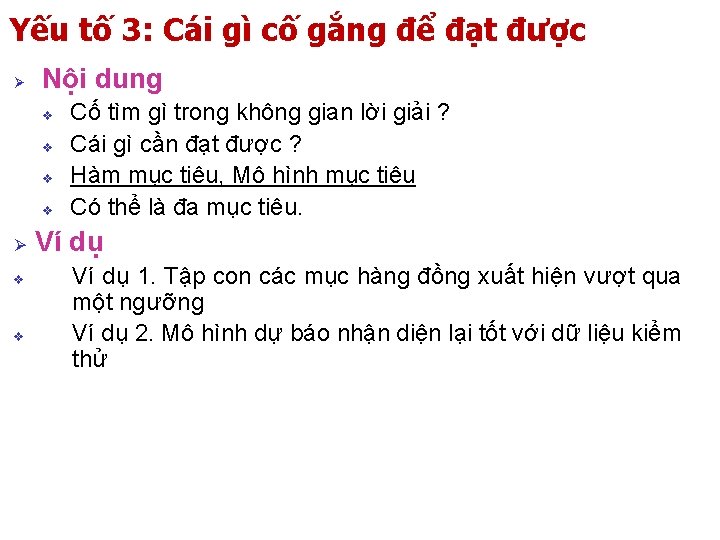

Yếu tố 3: Cái gì cố gắng để đạt được Ø Nội dung v v Ø v v Cố tìm gì trong không gian lời giải ? Cái gì cần đạt được ? Hàm mục tiêu, Mô hình mục tiêu Có thể là đa mục tiêu. Ví dụ 1. Tập con các mục hàng đồng xuất hiện vượt qua một ngưỡng Ví dụ 2. Mô hình dự báo nhận diện lại tốt với dữ liệu kiểm thử

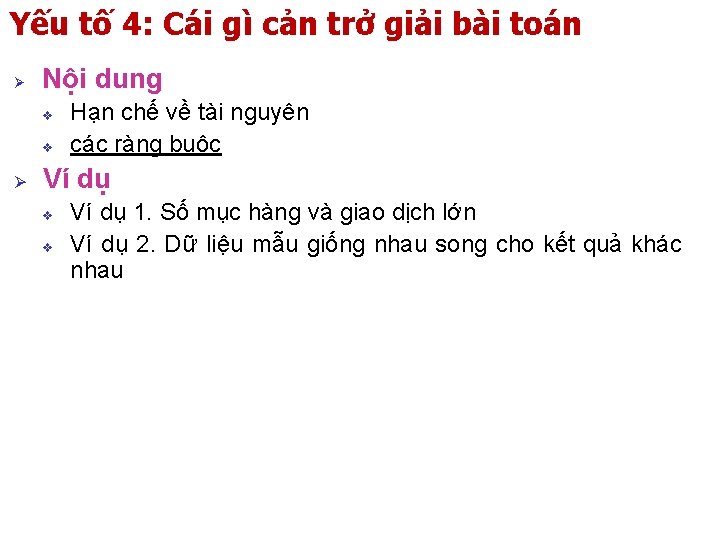

Yếu tố 4: Cái gì cản trở giải bài toán Ø Nội dung v v Ø Hạn chế về tài nguyên các ràng buộc Ví dụ v v Ví dụ 1. Số mục hàng và giao dịch lớn Ví dụ 2. Dữ liệu mẫu giống nhau song cho kết quả khác nhau

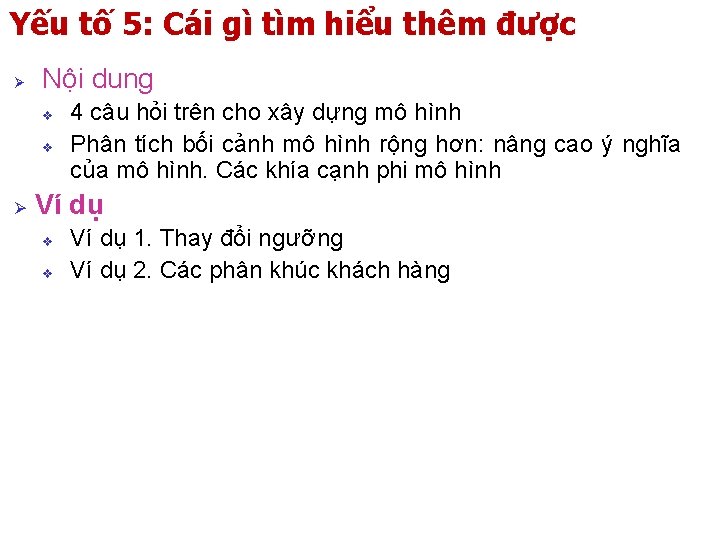

Yếu tố 5: Cái gì tìm hiểu thêm được Ø Nội dung v v Ø 4 câu hỏi trên cho xây dựng mô hình Phân tích bối cảnh mô hình rộng hơn: nâng cao ý nghĩa của mô hình. Các khía cạnh phi mô hình Ví dụ v v Ví dụ 1. Thay đổi ngưỡng Ví dụ 2. Các phân khúc khách hàng

2. Hiểu dữ liệu: hai phiên bản sách n Thay đổi đáng kể phiên bản 2006 tới 2011 n June 18, 2021 Phiên bản 2011 nhấn mạnh Hiểu dữ liệu ! Công nghệ tri thức 9

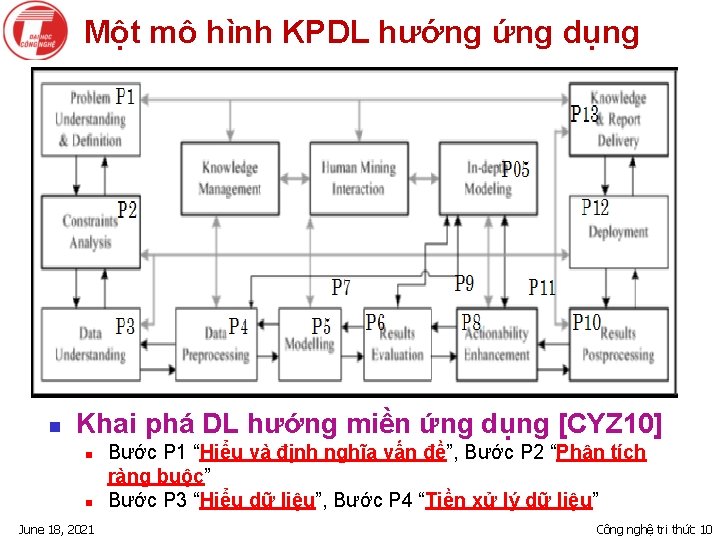

Một mô hình KPDL hướng ứng dụng n Khai phá DL hướng miền ứng dụng [CYZ 10] n n June 18, 2021 Bước P 1 “Hiểu và định nghĩa vấn đề”, Bước P 2 “Phân tích ràng buộc” Bước P 3 “Hiểu dữ liệu”, Bước P 4 “Tiền xử lý dữ liệu” Công nghệ tri thức 10

Vấn đề và ràng buộc n Vấn đề n Câu hỏi mục tiêu kinh doanh (Xem chương 1) n Thường từ 1 -3 mục tiêu cụ thể n Phạm vi dữ liệu liên quan tới câu hỏi n n Đăt bài toán sơ bộ: biến mục tiêu, dữ liệu điều kiện, mô tả sơ bộ ràng buộc dữ liệu điều kiện tới biến mục tiêu Phân tích ràng buộc n n June 18, 2021 Ràng buộc kinh doanh: Làm rõ hơn mối liên quan giữa dữ liệu với mục tiêu kinh doanh Ràng buộc nội tại: Ràng buộc dữ liệu về kiểu, ràng buộc liên quan dữ liệu Công nghệ tri thức 11

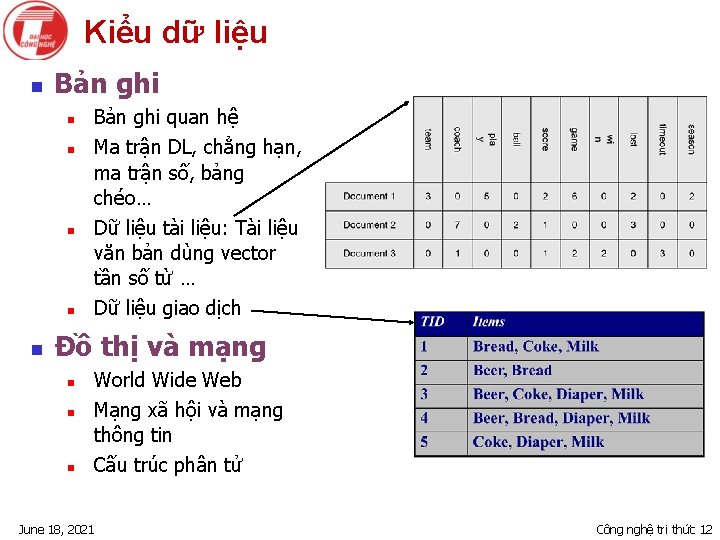

Kiểu dữ liệu n Bản ghi n n n Bản ghi quan hệ Ma trận DL, chẳng hạn, ma trận số, bảng chéo… Dữ liệu tài liệu: Tài liệu văn bản dùng vector tần số từ … Dữ liệu giao dịch Đồ thị và mạng n n n World Wide Web Mạng xã hội và mạng thông tin Cấu trúc phân tử June 18, 2021 Công nghệ tri thức 12

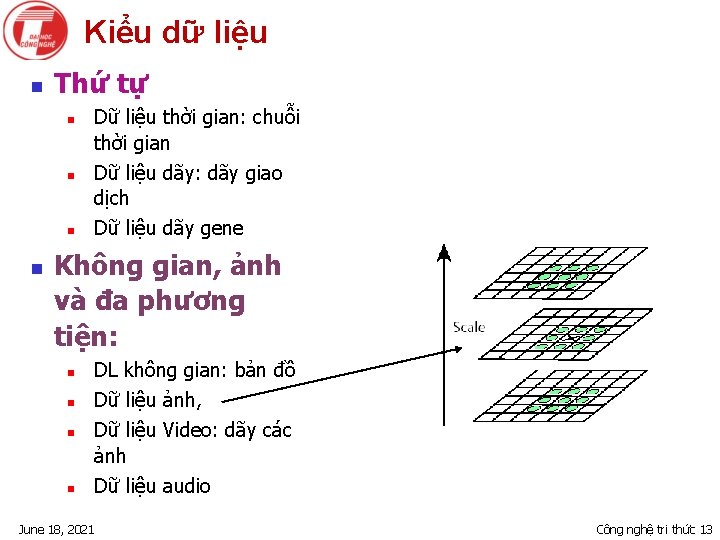

Kiểu dữ liệu n Thứ tự n n Dữ liệu thời gian: chuỗi thời gian Dữ liệu dãy: dãy giao dịch Dữ liệu dãy gene Không gian, ảnh và đa phương tiện: n n DL không gian: bản đồ Dữ liệu ảnh, Dữ liệu Video: dãy các ảnh Dữ liệu audio June 18, 2021 Công nghệ tri thức 13

Đặc trưng quan trọng của DL có cấu trúc n Kích thước n n Thưa n n Chỉ mang tính hiện diện Phân tích n n Tai họa của kích thước lớn Mẫu phụ thuộc quy mô Phân bố n June 18, 2021 Tập trung và phân tán Công nghệ tri thức 14

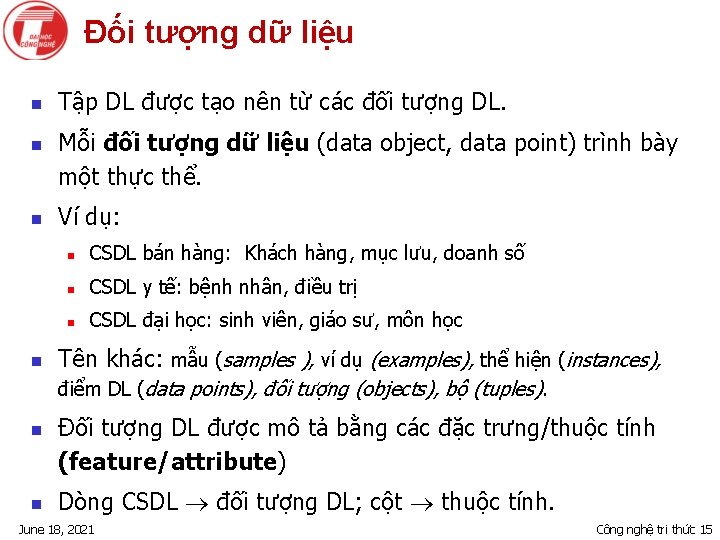

Đối tượng dữ liệu n n Tập DL được tạo nên từ các đối tượng DL. Mỗi đối tượng dữ liệu (data object, data point) trình bày một thực thể. Ví dụ: n CSDL bán hàng: Khách hàng, mục lưu, doanh số n CSDL y tế: bệnh nhân, điều trị n CSDL đại học: sinh viên, giáo sư, môn học Tên khác: mẫu (samples ), ví dụ (examples), thể hiện (instances), điểm DL (data points), đối tượng (objects), bộ (tuples). n n Đối tượng DL được mô tả bằng các đặc trưng/thuộc tính (feature/attribute) Dòng CSDL đối tượng DL; cột thuộc tính. June 18, 2021 Công nghệ tri thức 15

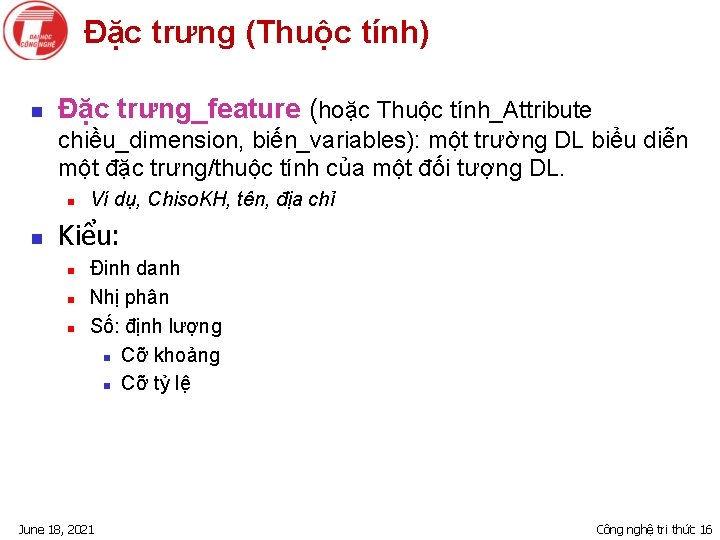

Đặc trưng (Thuộc tính) n Đặc trưng_feature (hoặc Thuộc tính_Attribute chiều_dimension, biến_variables): một trường DL biểu diễn một đặc trưng/thuộc tính của một đối tượng DL. n n Ví dụ, Chiso. KH, tên, địa chỉ Kiểu: n n n Đinh danh Nhị phân Số: định lượng n Cỡ khoảng n Cỡ tỷ lệ June 18, 2021 Công nghệ tri thức 16

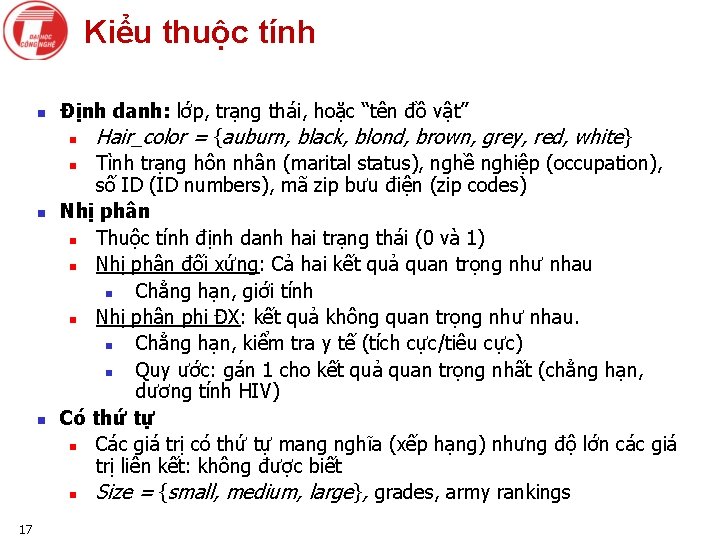

Kiểu thuộc tính n n n 17 Định danh: lớp, trạng thái, hoặc “tên đồ vật” n Hair_color = {auburn, black, blond, brown, grey, red, white} n Tình trạng hôn nhân (marital status), nghề nghiệp (occupation), số ID (ID numbers), mã zip bưu điện (zip codes) Nhị phân n Thuộc tính định danh hai trạng thái (0 và 1) n Nhị phân đối xứng: Cả hai kết quả quan trọng như nhau n Chẳng hạn, giới tính n Nhị phân phi ĐX: kết quả không quan trọng như nhau. n Chẳng hạn, kiểm tra y tế (tích cực/tiêu cực) n Quy ước: gán 1 cho kết quả quan trọng nhất (chẳng hạn, dương tính HIV) Có thứ tự n Các giá trị có thứ tự mang nghĩa (xếp hạng) nhưng độ lớn các giá trị liên kết: không được biết n Size = {small, medium, large}, grades, army rankings

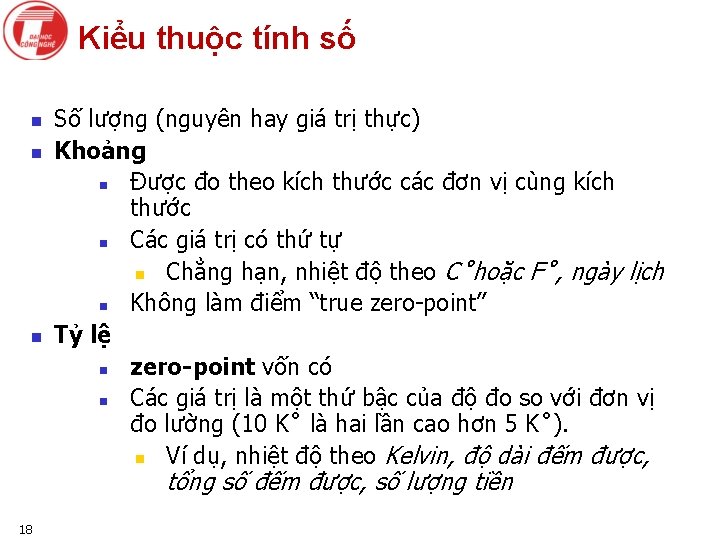

Kiểu thuộc tính số n n n Số lượng (nguyên hay giá trị thực) Khoảng n Được đo theo kích thước các đơn vị cùng kích thước n Các giá trị có thứ tự n Chẳng hạn, nhiệt độ theo C˚hoặc F˚, ngày lịch n Không làm điểm “true zero-point” Tỷ lệ n zero-point vốn có n Các giá trị là một thứ bậc của độ đo so với đơn vị đo lường (10 K˚ là hai lần cao hơn 5 K˚). n Ví dụ, nhiệt độ theo Kelvin, độ dài đếm được, tổng số đếm được, số lượng tiền 18

Thuộc tính rời rạc và liên tục n Thuộc tính rời rạc n n Thuộc tính liên tục n n n 19 Chỉ có một tập hữu hạn hoặc hữu hạn đếm được các giá trị n Chẳng hạn, mã zip, nghề nghiệp hoặc tập các từ trong một tập tài liệu Đôi lúc trình bày như các biến nguyên Lưu ý: Thuộc tính nhị phân là trường hợp riêng của thuộc tính rời rạc Có rất nhiều các giá trị thuộc tính n Như nhiệt độ, chiều cao, trong lượng Thực tế, giá trị thực chỉ tính và trình bảng bằng sử dụng một hữu hạn chữ số Thuộc tính liên tục được trình bày phổ biến như biến dấu phảy động

Tương tự và phân biệt n n n 20 Tương tự n Độ đo bằng số cho biết hai đối tượng giống nhau ra sao n Giá trị càng cao khi hai đối tượng càng giống nhau n Thường thuộc đoạn [0, 1] Phân biệt-Dissimilarity (như khoảng cách) n Độ đo bằng số cho biết hai đối tượng khác nhau ra sao n Càng thấp khi các đối tượng càng giống nhau n Phân biệt tối thiểu là 0 n Giới hạn trên tùy Gần-Proximity chỉ dẫn tới tương tự hoặc phân biệt

Đo khoảng cách thuộc tính định danh n n Có thể đưa ra 2 các trạng thái, như “red, yellow, blue, green” (tổng quát hóa thuộc tính nhị phân) Phương pháp 1: Đối sánh đơn giản n n Phương pháp 2: Dùng lượng lớn TT nhị phân n 21 m: lượng đối sánh, p: tổng số lượng biến Tạo một TT nhị phân mới cho mỗi từ M trạng thái định danh

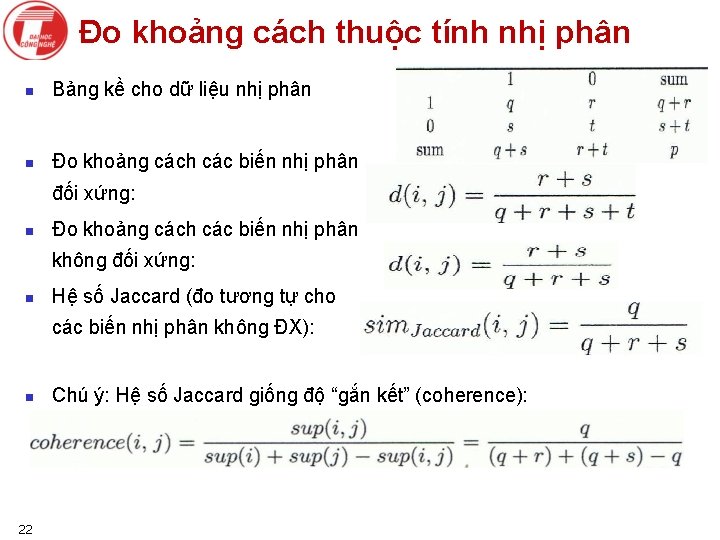

Đo khoảng cách thuộc tính nhị phân n Bảng kề cho dữ liệu nhị phân n Đo khoảng cách các biến nhị phân đối xứng: n Đo khoảng cách các biến nhị phân không đối xứng: n Hệ số Jaccard (đo tương tự cho các biến nhị phân không ĐX): n 22 Chú ý: Hệ số Jaccard giống độ “gắn kết” (coherence):

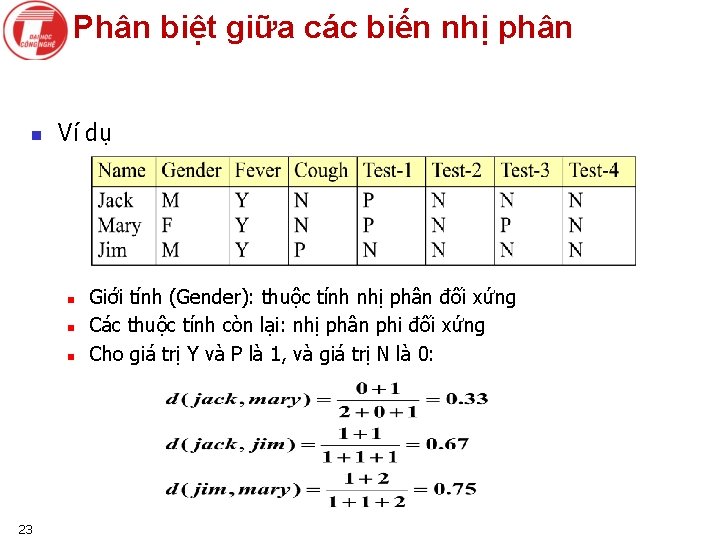

Phân biệt giữa các biến nhị phân n Ví dụ n n n 23 Giới tính (Gender): thuộc tính nhị phân đối xứng Các thuộc tính còn lại: nhị phân phi đối xứng Cho giá trị Y và P là 1, và giá trị N là 0:

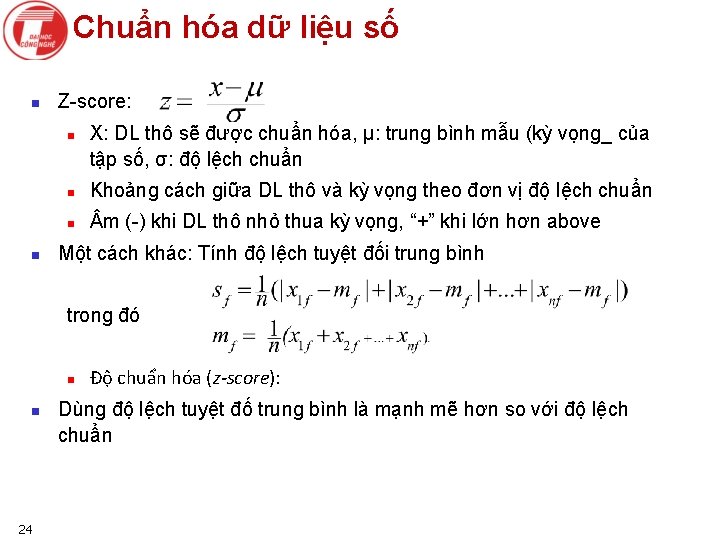

Chuẩn hóa dữ liệu số n Z-score: n n X: DL thô sẽ được chuẩn hóa, μ: trung bình mẫu (kỳ vọng_ của tập số, σ: độ lệch chuẩn n Khoảng cách giữa DL thô và kỳ vọng theo đơn vị độ lệch chuẩn n m (-) khi DL thô nhỏ thua kỳ vọng, “+” khi lớn hơn above Một cách khác: Tính độ lệch tuyệt đối trung bình trong đó n n 24 Độ chuẩn hóa (z-score): Dùng độ lệch tuyệt đố trung bình là mạnh mẽ hơn so với độ lệch chuẩn

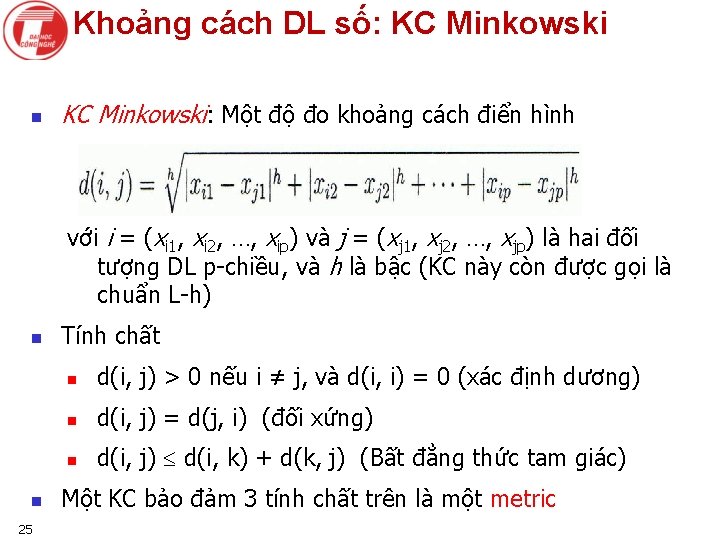

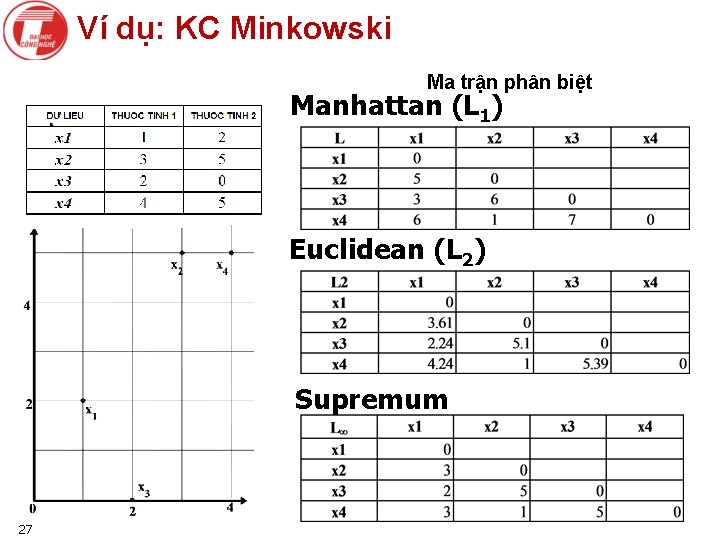

Khoảng cách DL số: KC Minkowski n KC Minkowski: Một độ đo khoảng cách điển hình với i = (xi 1, xi 2, …, xip) và j = (xj 1, xj 2, …, xjp) là hai đối tượng DL p-chiều, và h là bậc (KC này còn được gọi là chuẩn L-h) n n 25 Tính chất n d(i, j) > 0 nếu i ≠ j, và d(i, i) = 0 (xác định dương) n d(i, j) = d(j, i) (đối xứng) n d(i, j) d(i, k) + d(k, j) (Bất đẳng thức tam giác) Một KC bảo đảm 3 tính chất trên là một metric

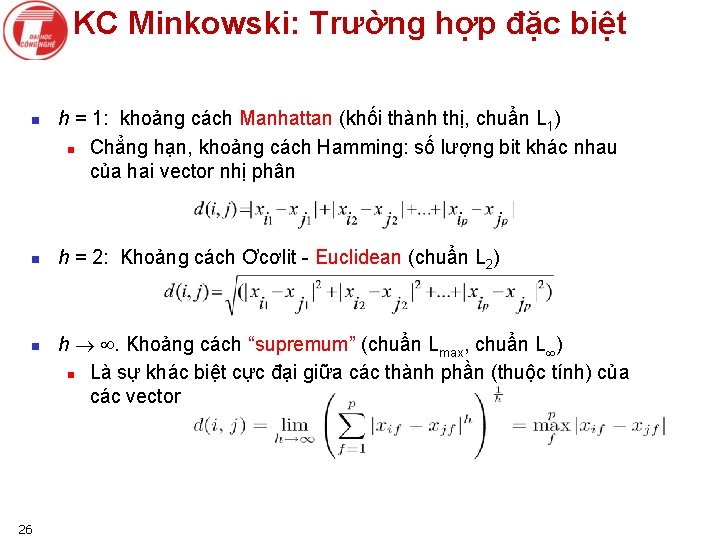

KC Minkowski: Trường hợp đặc biệt n n n 26 h = 1: khoảng cách Manhattan (khối thành thị, chuẩn L 1) n Chẳng hạn, khoảng cách Hamming: số lượng bit khác nhau của hai vector nhị phân h = 2: Khoảng cách Ơcơlit - Euclidean (chuẩn L 2) h . Khoảng cách “supremum” (chuẩn Lmax, chuẩn L ) n Là sự khác biệt cực đại giữa các thành phần (thuộc tính) của các vector

Ví dụ: KC Minkowski Ma trận phân biệt Manhattan (L 1) Euclidean (L 2) Supremum 27

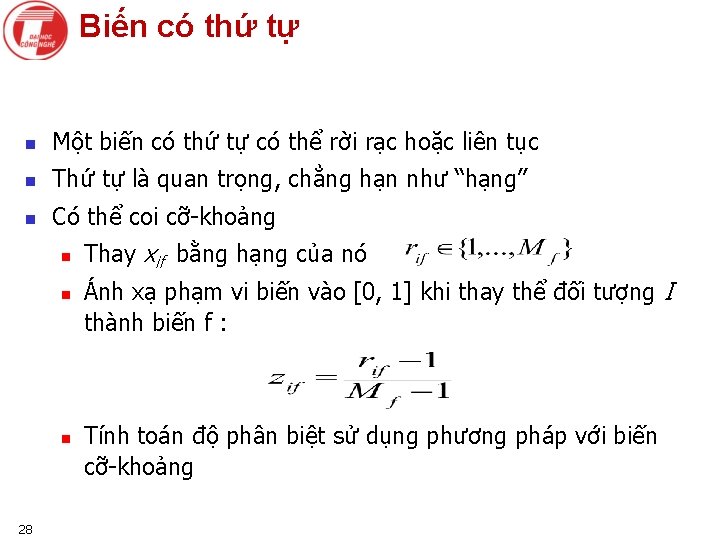

Biến có thứ tự n Một biến có thứ tự có thể rời rạc hoặc liên tục n Thứ tự là quan trọng, chẳng hạn như “hạng” n Có thể coi cỡ-khoảng n n n 28 Thay xif bằng hạng của nó Ánh xạ phạm vi biến vào [0, 1] khi thay thể đối tượng I thành biến f : Tính toán độ phân biệt sử dụng phương pháp với biến cỡ-khoảng

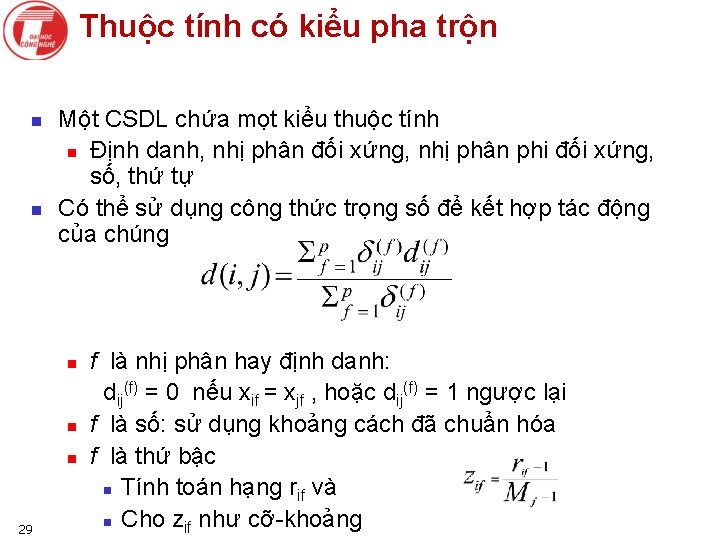

Thuộc tính có kiểu pha trộn n n Một CSDL chứa mọt kiểu thuộc tính n Định danh, nhị phân đối xứng, nhị phân phi đối xứng, số, thứ tự Có thể sử dụng công thức trọng số để kết hợp tác động của chúng n n n 29 f là nhị phân hay định danh: dij(f) = 0 nếu xif = xjf , hoặc dij(f) = 1 ngược lại f là số: sử dụng khoảng cách đã chuẩn hóa f là thứ bậc n Tính toán hạng rif và n Cho zif như cỡ-khoảng

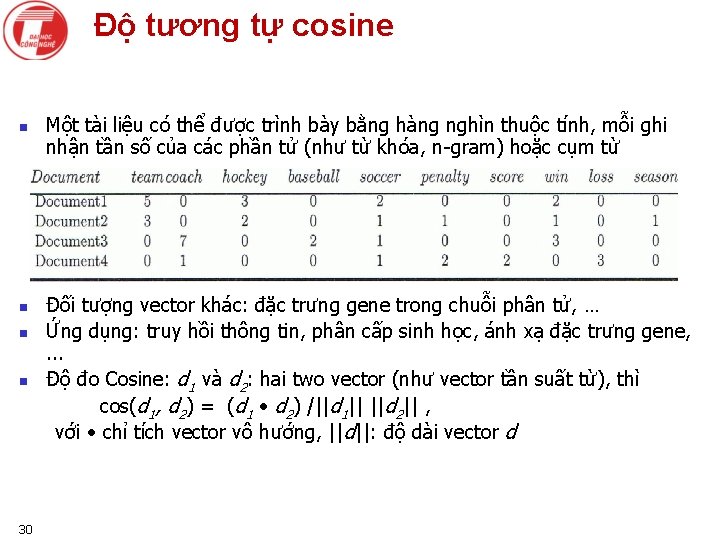

Độ tương tự cosine n n 30 Một tài liệu có thể được trình bày bằng hàng nghìn thuộc tính, mỗi ghi nhận tần số của các phần tử (như từ khóa, n-gram) hoặc cụm từ Đối tượng vector khác: đặc trưng gene trong chuỗi phân tử, … Ứng dụng: truy hồi thông tin, phân cấp sinh học, ánh xạ đặc trưng gene, . . . Độ đo Cosine: d 1 và d 2: hai two vector (như vector tần suất từ), thì cos(d 1, d 2) = (d 1 d 2) /||d 1|| ||d 2|| , với chỉ tích vector vô hướng, ||d||: độ dài vector d

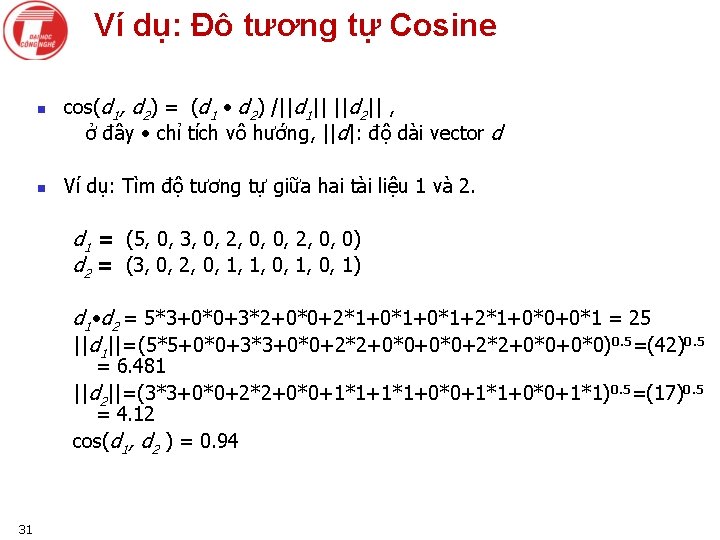

Ví dụ: Đô tương tự Cosine n n cos(d 1, d 2) = (d 1 d 2) /||d 1|| ||d 2|| , ở đây chỉ tích vô hướng, ||d|: độ dài vector d Ví dụ: Tìm độ tương tự giữa hai tài liệu 1 và 2. d 1 = (5, 0, 3, 0, 2, 0, 0) d 2 = (3, 0, 2, 0, 1, 1, 0, 1) d 1 d 2 = 5*3+0*0+3*2+0*0+2*1+0*1+2*1+0*0+0*1 = 25 ||d 1||= (5*5+0*0+3*3+0*0+2*2+0*0+0*0) 0. 5=(42)0. 5 = 6. 481 ||d 2||=(3*3+0*0+2*2+0*0+1*1+0*0+1*1) 0. 5=(17)0. 5 = 4. 12 cos(d 1, d 2 ) = 0. 94 31

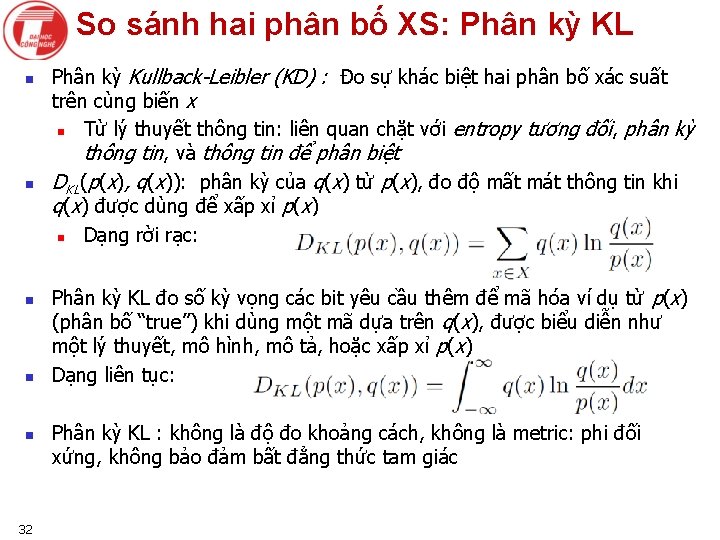

So sánh hai phân bố XS: Phân kỳ KL n n n 32 Phân kỳ Kullback-Leibler (KD) : Đo sự khác biệt hai phân bố xác suất trên cùng biến x n Từ lý thuyết thông tin: liên quan chặt với entropy tương đối, phân kỳ thông tin, và thông tin để phân biệt DKL(p(x), q(x)): phân kỳ của q(x) từ p(x), đo độ mất mát thông tin khi q(x) được dùng để xấp xỉ p(x) n Dạng rời rạc: Phân kỳ KL đo số kỳ vọng các bit yêu cầu thêm để mã hóa ví dụ từ p(x) (phân bố “true”) khi dùng một mã dựa trên q(x), được biểu diễn như một lý thuyết, mô hình, mô tả, hoặc xấp xỉ p(x) Dạng liên tục: Phân kỳ KL : không là độ đo khoảng cách, không là metric: phi đối xứng, không bảo đảm bất đẳng thức tam giác

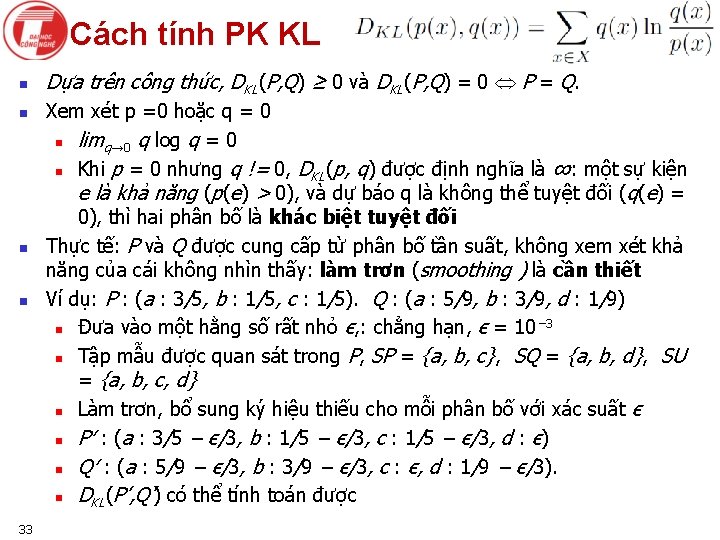

Cách tính PK KL n n 33 Dựa trên công thức, DKL(P, Q) ≥ 0 và DKL(P, Q) = 0 P = Q. Xem xét p =0 hoặc q = 0 n limq→ 0 q log q = 0 n Khi p = 0 nhưng q != 0, DKL(p, q) được định nghĩa là ∞: một sự kiện e là khả năng (p(e) > 0), và dự báo q là không thể tuyệt đối (q(e) = 0), thì hai phân bố là khác biệt tuyệt đối Thực tế: P và Q được cung cấp từ phân bố tần suất, không xem xét khả năng của cái không nhìn thấy: làm trơn (smoothing ) là cần thiết Ví dụ: P : (a : 3/5, b : 1/5, c : 1/5). Q : (a : 5/9, b : 3/9, d : 1/9) − 3 n Đưa vào một hằng số rất nhỏ ϵ, : chẳng hạn, ϵ = 10 n Tập mẫu được quan sát trong P, SP = {a, b, c}, SQ = {a, b, d}, SU = {a, b, c, d} n Làm trơn, bổ sung ký hiệu thiếu cho mỗi phân bố với xác suất ϵ n P′ : (a : 3/5 − ϵ/3, b : 1/5 − ϵ/3, c : 1/5 − ϵ/3, d : ϵ) n Q′ : (a : 5/9 − ϵ/3, b : 3/9 − ϵ/3, c : ϵ, d : 1/9 − ϵ/3). n DKL(P’, Q’) có thể tính toán được

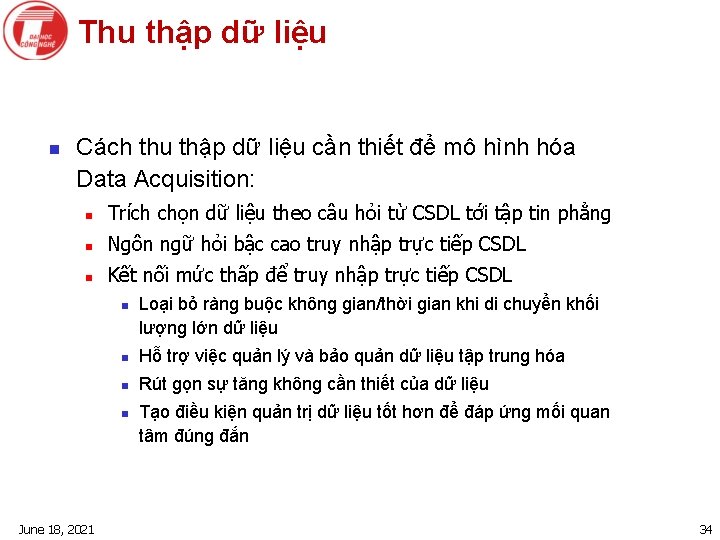

Thu thập dữ liệu n Cách thu thập dữ liệu cần thiết để mô hình hóa Data Acquisition: n Trích chọn dữ liệu theo câu hỏi từ CSDL tới tập tin phẳng n Ngôn ngữ hỏi bậc cao truy nhập trực tiếp CSDL n Kết nối mức thấp để truy nhập trực tiếp CSDL n n Hỗ trợ việc quản lý và bảo quản dữ liệu tập trung hóa n Rút gọn sự tăng không cần thiết của dữ liệu n June 18, 2021 Loại bỏ ràng buộc không gian/thời gian khi di chuyển khối lượng lớn dữ liệu Tạo điều kiện quản trị dữ liệu tốt hơn để đáp ứng mối quan tâm đúng đắn 34

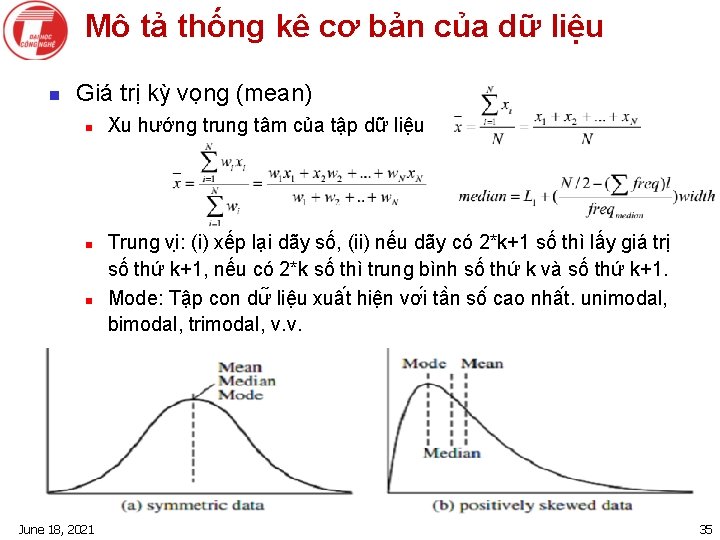

Mô tả thống kê cơ bản của dữ liệu n Giá trị kỳ vọng (mean) n n n June 18, 2021 Xu hướng trung tâm của tập dữ liệu Trung vi : (i) xếp lại dãy số, (ii) nếu dãy có 2*k+1 số thì lấy giá trị số thứ k+1, nếu có 2*k số thì trung bình số thứ k và số thứ k+1. Mode: Tâ p con dư liê u xuâ t hiê n vơ i tâ n sô cao nhâ t. unimodal, bimodal, trimodal, v. v. 35

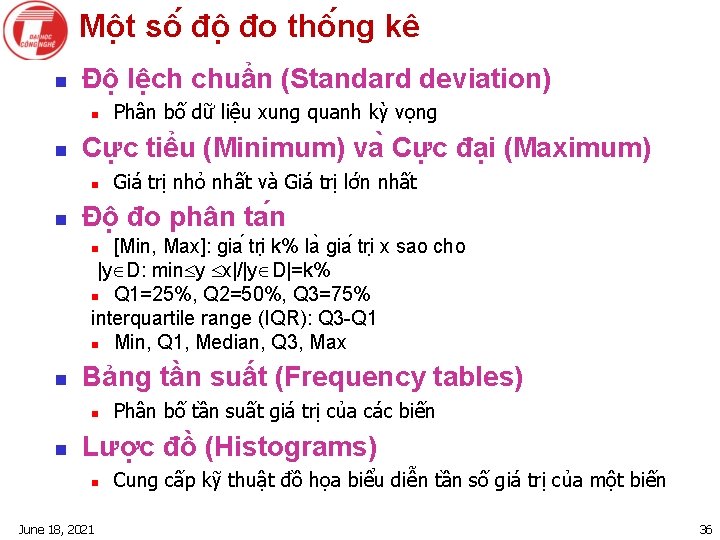

Mô t sô đô đo thô ng kê n Độ lệch chuẩn (Standard deviation) n n Cực tiểu (Minimum) va Cực đại (Maximum) n n Phân bố dữ liệu xung quanh kỳ vọng Giá trị nhỏ nhất va Giá trị lớn nhất Đô đo phân ta n [Min, Max]: gia tri k% la gia tri x sao cho |y D: min y x|/|y D|=k% n Q 1=25%, Q 2=50%, Q 3=75% interquartile range (IQR): Q 3 -Q 1 n Min, Q 1, Median, Q 3, Max n n Bảng tần suất (Frequency tables) n n Phân bố tần suất giá trị của các biến Lược đồ (Histograms) n June 18, 2021 Cung cấp kỹ thuật đồ họa biểu diễn tần số giá trị của một biến 36

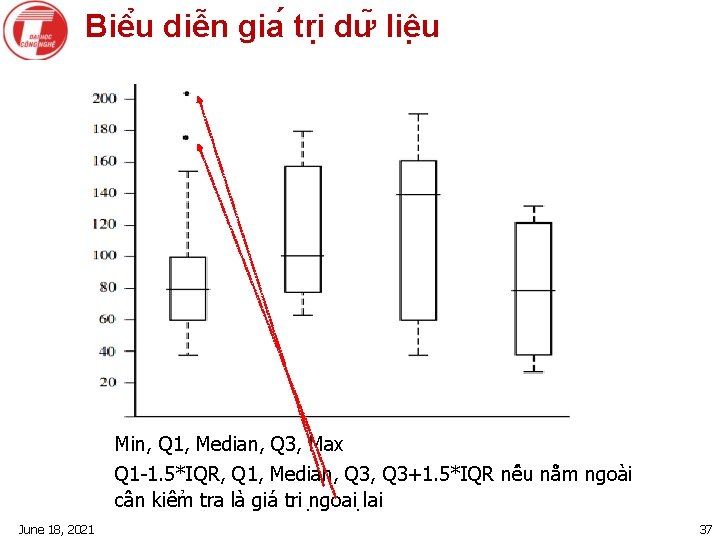

Biê u diê n gia tri dư liê u Min, Q 1, Median, Q 3, Max Q 1 -1. 5*IQR, Q 1, Median, Q 3+1. 5*IQR nê u nă m ngoa i câ n kiê m tra la gia tri ngoa i lai June 18, 2021 37

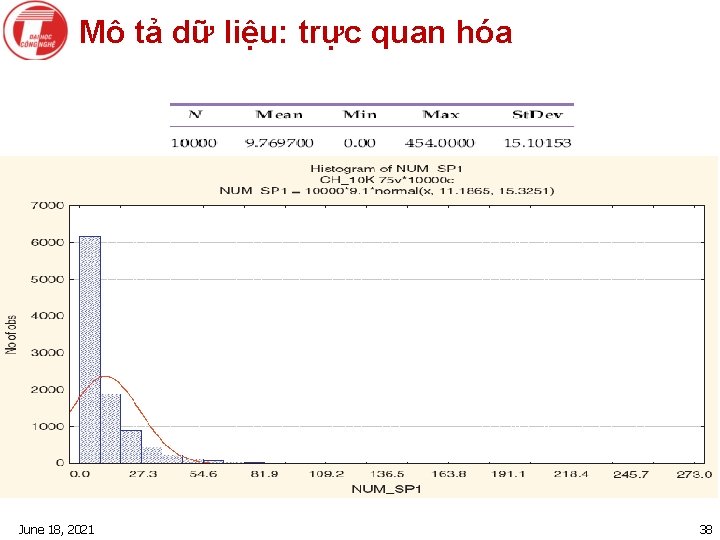

Mô tả dữ liệu: trực quan hóa June 18, 2021 38

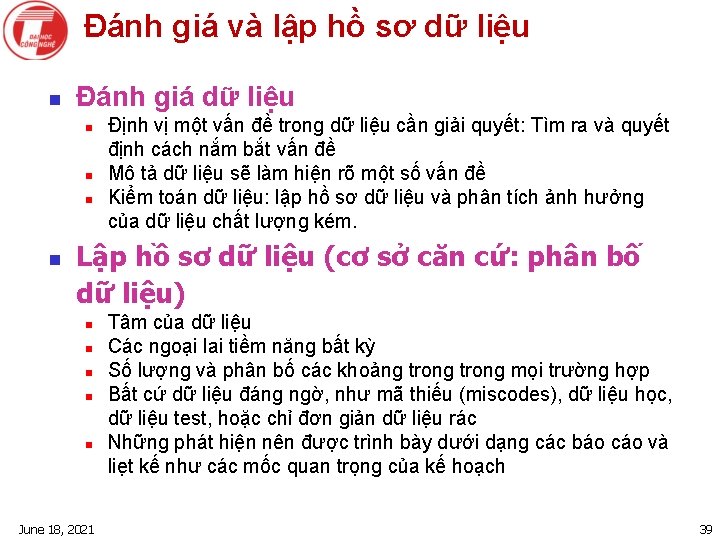

Đánh giá và lập hồ sơ dữ liệu n Đánh giá dữ liệu n n Định vị một vấn đề trong dữ liệu cần giải quyết: Tìm ra và quyết định cách nắm bắt vấn đề Mô tả dữ liệu sẽ làm hiện rõ một số vấn đề Kiểm toán dữ liệu: lập hồ sơ dữ liệu và phân tích ảnh hưởng của dữ liệu chất lượng kém. Lập hồ sơ dữ liệu (cơ sở căn cứ: phân bố dữ liệu) n n n June 18, 2021 Tâm của dữ liệu Các ngoại lai tiềm năng bất kỳ Số lượng và phân bố các khoảng trong mọi trường hợp Bất cứ dữ liệu đáng ngờ, như mã thiếu (miscodes), dữ liệu học, dữ liệu test, hoặc chỉ đơn giản dữ liệu rác Những phát hiện nên được trình bày dưới dạng các báo cáo và liẹt kế như các mốc quan trọng của kế hoạch 39

2. Tiền xử lý dữ liệu n Vai trò của Tiền xử lý dữ liệu n Làm sạch dữ liệu n Tích hợp và chuyển dạng dữ liệu n Rút gọn dữ liệu n Rời rạc hóa và sinh kiến trúc khái niệm June 18, 2021 40

Vai trò của tiền xử lý n Không có dữ liệu tốt, không thể có kết quả khai phá tốt! n Quyết định chất lượng phải dựa trên dữ liệu chất lượng n n Chẳng hạn, dữ liệu bội hay thiếu là nguyên nhân thống không chính xác, thậm chí gây hiểu nhầm. Kho dữ liệu cần tích hợp nhất quán của dữ liệu chất lượng Phân lớn công việc xây dựng một kho dữ liệu là trích chọn, làm sạch và chuyển đổi dữ liệu —Bill Inmon. Dữ liệu có chất lượng cao nếu như phù hợp với mục đích sử dụng trong điều hành, ra quyết định, và lập kế hoạch June 18, 2021 41

![Các vấn đề chất lượng dữ liệu [RD 00] - (Thiếu lược đồ toàn Các vấn đề chất lượng dữ liệu [RD 00] - (Thiếu lược đồ toàn](http://slidetodoc.com/presentation_image_h2/7ad48bebdbf8ea26c8960f99a1d2b7ce/image-42.jpg)

Các vấn đề chất lượng dữ liệu [RD 00] - (Thiếu lược đồ toàn vẹn, thiết kế sơ đồ sơ sài) đơn trị, toàn vẹn tham chiếu… (Lỗi nhập dữ liệu) sai chính tả, dư thừa/sao, giá trị mâu thuẫn… (Mô hình dữ liệu và thiết kế sơ đồ không đồng nhất) xung đột tên, cấu trúc (Dữ liệu chồng chéo, mâu thuẫn và không nhất quán) không nhất quán tích hợp và thời gian [RD 00] Erhard Rahm, Hong Hai Do (2000). Data Cleaning: Problems and Current Approaches, IEEE Data Engineering Bulletin, 23(4): 3 -13, 2000. June 18, 2021 42

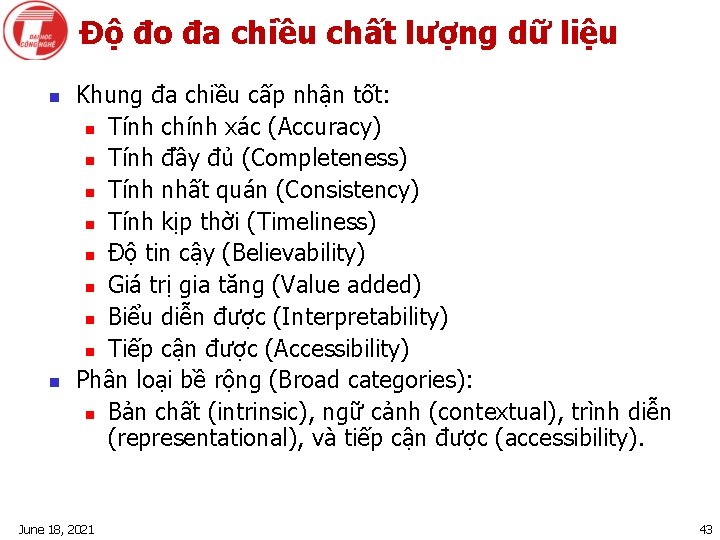

Độ đo đa chiều chất lượng dữ liệu n n Khung đa chiều cấp nhận tốt: n Tính chính xác (Accuracy) n Tính đầy đủ (Completeness) n Tính nhất quán (Consistency) n Tính kịp thời (Timeliness) n Độ tin cậy (Believability) n Giá trị gia tăng (Value added) n Biểu diễn được (Interpretability) n Tiếp cận được (Accessibility) Phân loại bề rộng (Broad categories): n Bản chất (intrinsic), ngữ cảnh (contextual), trình diễn (representational), và tiếp cận được (accessibility). June 18, 2021 43

Các bài toán chính trong tiền XL DL n Làm sạch dữ liệu n n Tích hợp dữ liệu n n Chuẩn hóa và tổng hợp Rút gọn dữ liệu n n Tích hợp CSDL, khối dữ liệu hoặc tập tin phức Chuyển dạng dữ liệu n n Điền giá trị thiếu, làm trơn dữ liệu nhiễu, định danh hoặc xóa ngoại lai, và khử tính không nhất quán Thu được trình bày thu gọn về kích thước những sản xuất cùng hoặc tương tự kết quả phân tích Rời rạc dữ liệu n June 18, 2021 Bộ phận của rút gọn dữ liệu nhưng có độ quan trọng riêng, đặc biệt với dữ liệu số 44

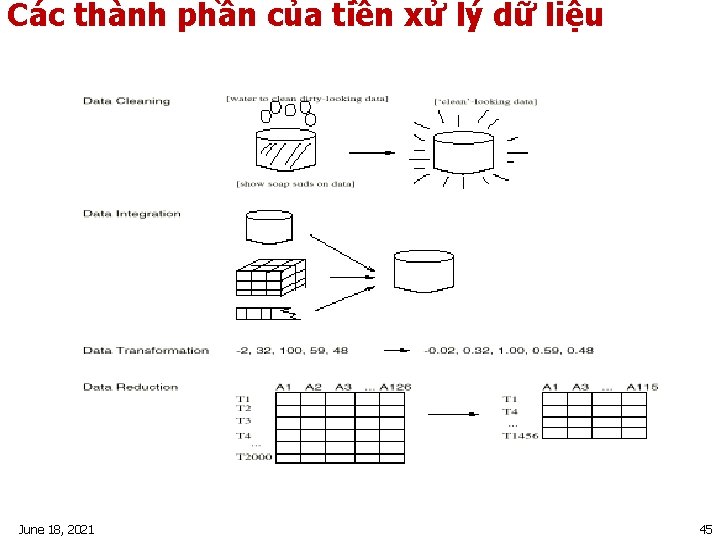

Các thành phần của tiền xử lý dữ liệu June 18, 2021 45

Một số bài toán cụ thể n Cách thức làm sạch dữ liệu: n n Cách thức diễn giải dữ liệu: n n Data Abstraction Cách thức rút gọn dữ liệu để dùng: Data Reduction n n Data Filtering Cách thức nắm bắt dữ liệu thời gian/chuỗi thời gian: n n Data Weighting and Balancing Xử lý dữ liệu ngoại lai và không mong muốn khác: n n Data Imputation Trọng số của các trường hợp: n n Data Transformation Cách thức nắm bắt giá trị thiếu: n n Data Cleaning Bản ghi : Data Sampling Biến: Dimensionality Reduction Giá trị: Data Discretization Cách thức tạo biến mới: Data Derivation June 18, 2021 46

Làm sạch dữ liệu n n Là quá trình n xác định tính không chính xác, không đầy đủ/tính bất hợp lý của dữ liệu n chỉnh sửa các sai sót và thiếu sót được phát hiện n nâng cao chất lượng dữ liệu. Quá trình bao gồm n n kiểm tra định dạng, tính đầy đủ, tính hợp lý, miền giới hạn, xem xét dữ liệu để xác định ngoại lai (địa lý, thống kê, thời gian hay môi trường) hoặc các lỗi khác, đánh giá dữ liệu của các chuyên gia miền chủ đề. Quá trình thường dẫn đến n n June 18, 2021 loại bỏ, lập tài liệu và kiểm tra liên tiếp và hiệu chỉnh đúng bản ghi ngờ. Kiểm tra xác nhận có thể được tiến hành nhằm đạt tính phù hợp với các chuẩn áp dụng, các quy luật, và quy tắc. 47

Làm sạch dữ liệu n n Nguyên lý chất lượng dữ liệu cần được áp dụng ở mọi giai đoạn quá trình quản lý dữ liệu (nắm giữ, số hóa, lưu trữ, phân tích, trình bày và sử dụng). n hai vấn đề cốt lõi để cải thiện chất lượng - phòng ngừa và chỉnh sửa n Phòng ngừa liên quan chặt chẽ với thu thập và nhập dữ liệu vào CSDL. n Tăng cường phòng ngừa lỗi, vẫn/tồn tại sai sót trong bộ dữ liệu lớn (Maletic và Marcus 2000) và không thể bỏ qua việc xác nhận và sửa chữa dữ liệu Vai trò quan trọng n n n “là một trong ba bài toán lớn nhất của kho dữ liệu”—Ralph Kimball “là bài toán “number one” trong kho dữ liệu”—DCI khảo sát Các bài toán thuộc làm sạch dữ liệu n n June 18, 2021 Xử lý giá trị thiếu Dữ liệu nhiễu: định danh ngoại lai và làm trơn. Chỉnh sửa dữ liệu không nhất quán Giải quyết tính dư thừa tạo ra sau tích hợp dữ liệu. 48

Xử lý thiếu giá trị n Bỏ qua bản ghi có giá trị thiếu: n n n Điền giá trị thiếu bằng tay: n n n Thường làm khi thiếu nhãn phân lớp (giả sử bài toán phân lớp) không hiệu quả khi tỷ lệ số lượng giá trị thiếu lớn (bán giám sát) tẻ nhạt tính khả thi Điền giá trị tự động: n n June 18, 2021 Hằng toàn cục: chẳng hạn như“chưa biết - unknown”, có phải một lớp mới Trung bình giá trị thuộc tính các bản ghi hiện có Trung bình giá trị thuộc tính các bản ghi cùng lớp: tinh hơn Giá trị có khả năng nhất: dựa trên suy luận như công thức Bayes hoặc cây quyết định 49

Dữ liệu nhiễu n Nhiễu: n n n Giá trị không chính xác n n n Lỗi ngẫu nhiên Biến dạng của một biến đo được Lỗi do thiết bị thu thập dữ liệu Vấn đề nhập dữ liệu: người dùng hoặc máy có thể sai Vấn đề truyền dữ liệu: sai từ thiết bị gửi/nhận/truyền Hạn chế của công nghệ: ví dụ, phần mềm có thể xử lý không đúng Thiết nhất quán khi đặt tên: cũng một tên song cách viết khác nhau Các vấn đề dữ liệu khác yêu cầu làm sạch dữ liệu n n n June 18, 2021 Bội bản ghi Dữ liệu không đầy đủ Dữ liệu không nhất quán 50

Xử lý dữ liệu nhiễu n n Phương pháp đóng thùng (Binning): n Sắp dữ liệu tăng và chia “đều” vào các thùng n Làm trơn: theo trung bình, theo trung tuyến, theo biên… Phân cụm (Clustering) n Phát hiện và loại bỏ ngoại lai (outliers) Kết hợp kiểm tra máy tính và con người n Phát hiện giá trị nghi ngờ để con người kiểm tra (chẳng hạn, đối phó với ngoại lai có thể) Hồi quy n Làm trơn: ghép dữ liệu theo các hàm hồi quy June 18, 2021 51

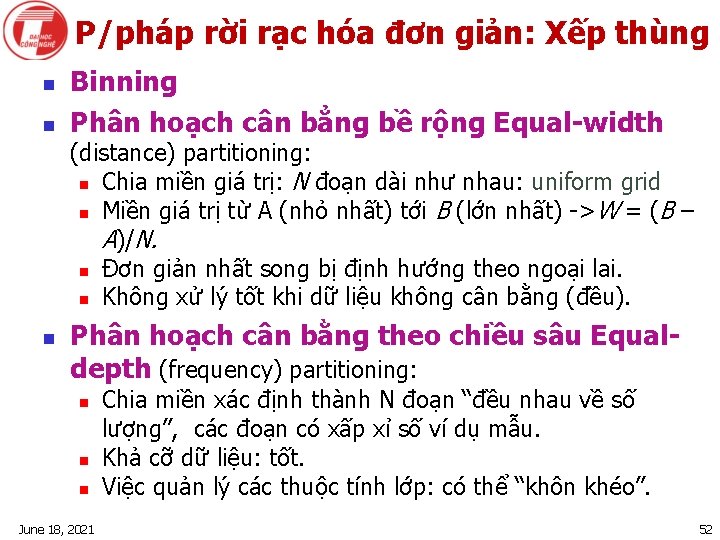

P/pháp rời rạc hóa đơn giản: Xếp thùng n n Binning Phân hoạch cân bẳng bề rộng Equal-width (distance) partitioning: n Chia miền giá trị: N đoạn dài như nhau: uniform grid n Miền giá trị từ A (nhỏ nhất) tới B (lớn nhất) ->W = (B – A)/N. n Đơn giản nhất song bị định hướng theo ngoại lai. n Không xử lý tốt khi dữ liệu không cân bằng (đều). n Phân hoạch cân bằng theo chiều sâu Equaldepth (frequency) partitioning: n n n June 18, 2021 Chia miền xác định thành N đoạn “đều nhau về số lượng”, các đoạn có xấp xỉ số ví dụ mẫu. Khả cỡ dữ liệu: tốt. Việc quản lý các thuộc tính lớp: có thể “khôn khéo”. 52

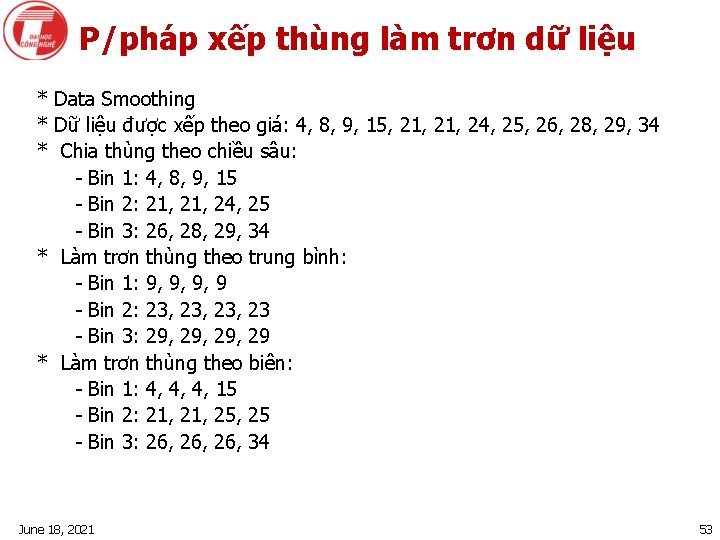

P/pháp xếp thùng làm trơn dữ liệu * Data Smoothing * Dữ liệu được xếp theo giá: 4, 8, 9, 15, 21, 24, 25, 26, 28, 29, 34 * Chia thùng theo chiều sâu: - Bin 1: 4, 8, 9, 15 - Bin 2: 21, 24, 25 - Bin 3: 26, 28, 29, 34 * Làm trơn thùng theo trung bình: - Bin 1: 9, 9, 9, 9 - Bin 2: 23, 23, 23 - Bin 3: 29, 29, 29 * Làm trơn thùng theo biên: - Bin 1: 4, 4, 4, 15 - Bin 2: 21, 25, 25 - Bin 3: 26, 26, 34 June 18, 2021 53

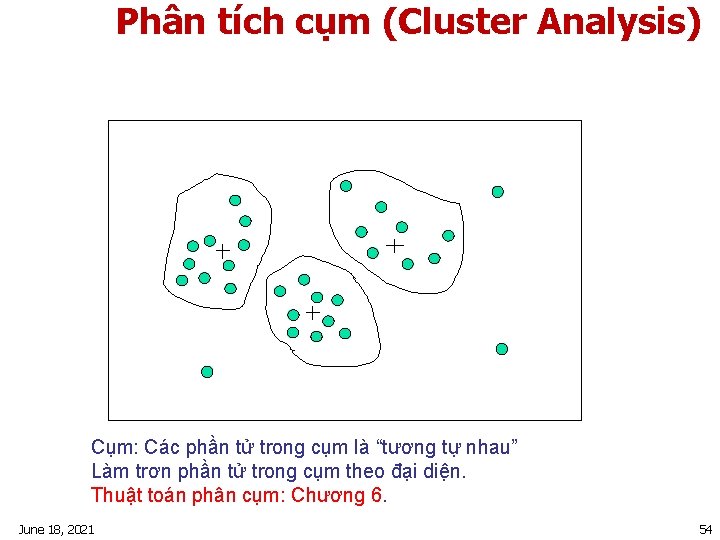

Phân tích cụm (Cluster Analysis) Cụm: Các phần tử trong cụm là “tương tự nhau” Làm trơn phần tử trong cụm theo đại diện. Thuật toán phân cụm: Chương 6. June 18, 2021 54

Hồi quy (Regression) y Y 1 y=x+1 Y 1’ X 1 June 18, 2021 x 55

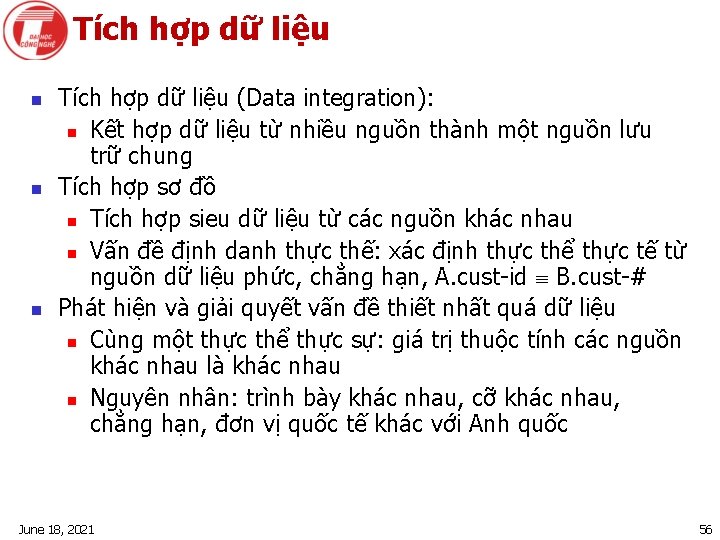

Tích hợp dữ liệu n n n Tích hợp dữ liệu (Data integration): n Kết hợp dữ liệu từ nhiều nguồn thành một nguồn lưu trữ chung Tích hợp sơ đồ n Tích hợp sieu dữ liệu từ các nguồn khác nhau n Vấn đề định danh thực thế: xác định thực thể thực tế từ nguồn dữ liệu phức, chẳng hạn, A. cust-id B. cust-# Phát hiện và giải quyết vấn đề thiết nhất quá dữ liệu n Cùng một thực thể thực sự: giá trị thuộc tính các nguồn khác nhau là khác nhau n Nguyên nhân: trình bày khác nhau, cỡ khác nhau, chẳng hạn, đơn vị quốc tế khác với Anh quốc June 18, 2021 56

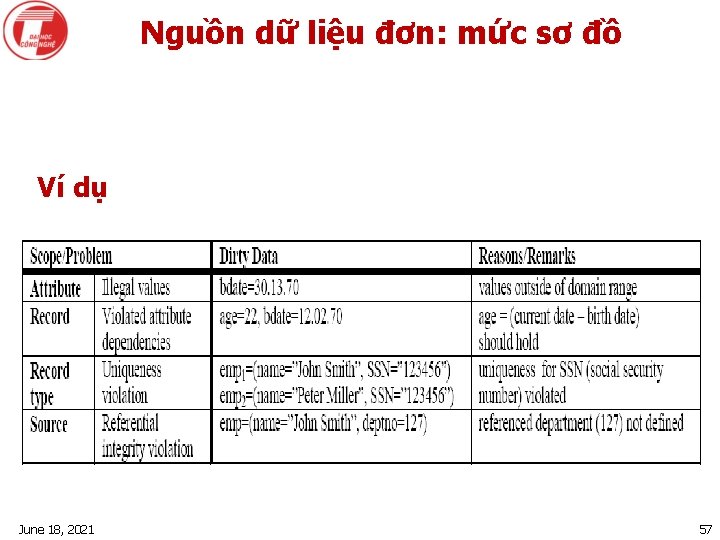

Nguồn dữ liệu đơn: mức sơ đồ Ví dụ June 18, 2021 57

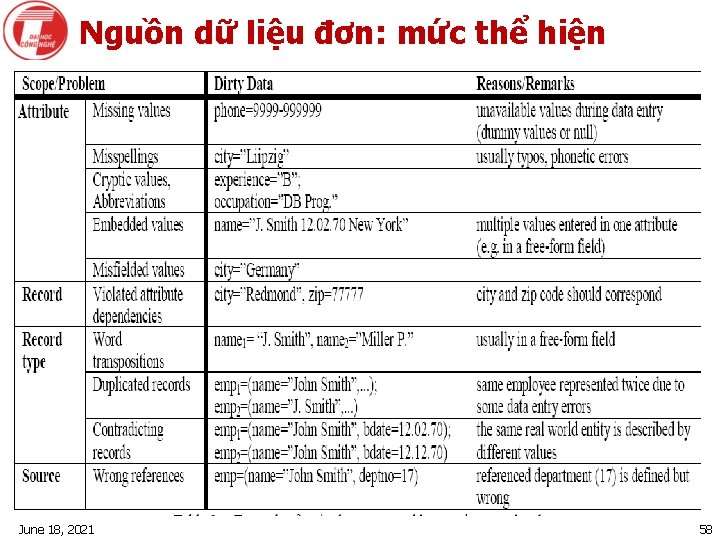

Nguồn dữ liệu đơn: mức thể hiện June 18, 2021 58

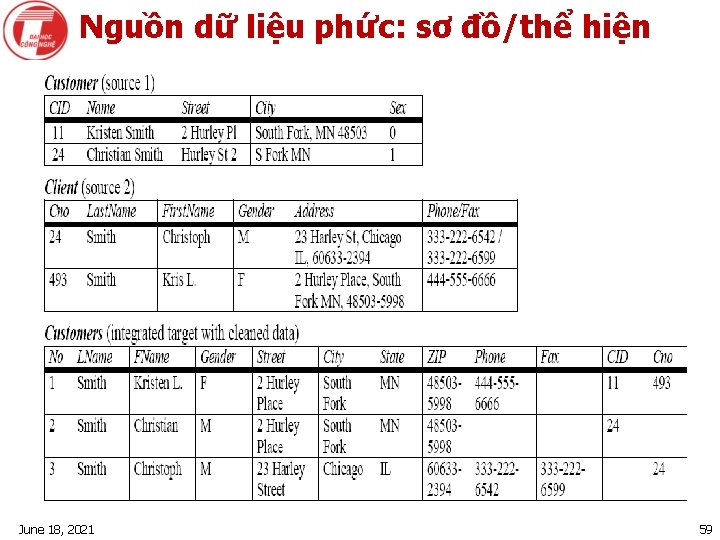

Nguồn dữ liệu phức: sơ đồ/thể hiện June 18, 2021 59

Nắm bắt dư thừa trong tích hợp dữ liệu n Dư thừa dữ liệu: thường có khi tích hợp từ nhiều nguồn khác nhau n n Một thuộc tính có nhiều tên khác nhau ở các CSDL khác nhau Một thuộc tính: thuộc tính “nguồn gốc” trong CSDL khác, chẳng hạn, doanh thu hàng năm Dữ liệu dư thừa có thể được phát hiện khi phân tích tương quan Tích hợp cẩn trọng dữ liệu nguồn phức giúp giảm/tránh dư thừa, thiếu nhất quán và tăng hiệu quả tốc độ và chất lượng June 18, 2021 60

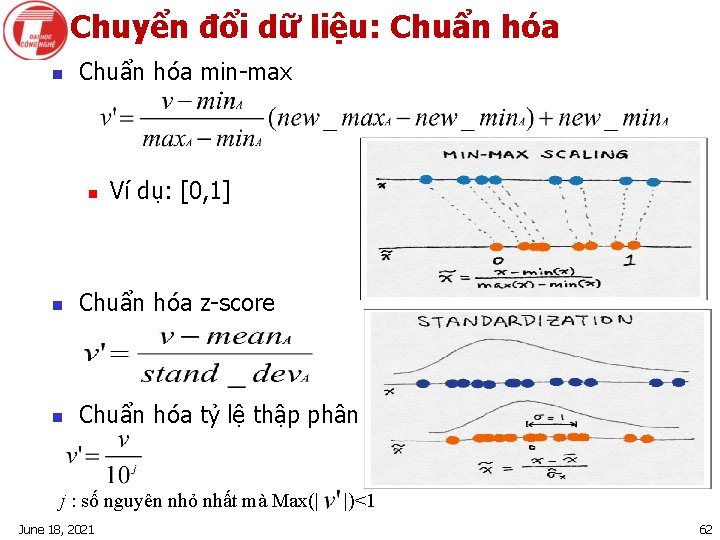

Chuyển dạng dữ liệu n Làm trơn (Smoothing): loại bỏ nhiễu từ dữ liệu n Tổng hợp (Aggregation): tóm tắt, xây dựng khối dữ liệu n Tổng quát hóa (Generalization): leo kiến trúc khái niệm n Chuẩn hóa (Normalization): thu nhỏ vào miền nhỏ, riêng n n Chuẩn hóa min-max n Chuẩn hóa z-score n Chuẩn hóa tỷ lệ thập phân Xây dựng thuộc tính/đặc trưng n June 18, 2021 Thuộc tính mới được xây dựng từ các thuộc tính đã có 61

Chuyển đổi dữ liệu: Chuẩn hóa n Chuẩn hóa min-max n Ví dụ: [0, 1] n Chuẩn hóa z-score n Chuẩn hóa tỷ lệ thập phân j : số nguyên nhỏ nhất mà Max(| June 18, 2021 |)<1 62

Chiến lược rút gọn dữ liệu n Kho chứa dữ liệu chứa tới hàng TB n n Rút gọn dữ liệu n n Phân tích/khai phá dữ liệu phức tạp mất nhiều thời gian khi chạy trên tập toàn bộ dữ liệu Có trình bày gọn tập dữ liệu mà nhỏ hơn nhiều về dung lượng mà sinh ra cùng (hoặc hầu như cùng) kết quả. Chiến lược rút gọn dữ liệu n n n Tập hợp vào khối dữ liệu Rút gọn đặc trưng (Giảm chiều): Lựa chọn và trích xuất đặc trưng Nén dữ liệu Giảm giá trị số hóa – dữ liệu thành mô hình Rời rạc hóa và sinh cây khái niệm June 18, 2021 63

Tổng hợp khối dữ liệu n Data. Cube Aggregation n Mức thấp nhất của khối dữ liệu n n n Giảm thêm kích thước dữ liệu Tham khảo mức thích hợp n n Chẳng hạn, một khách hàng trong kho dữ liệu gọi điện thoại. Các mức phức hợp của tích hợp thành khối dữ liệu n n Tổng hợp dữ liệu thành một cá thể quan tâm Sử dụng trình diễn nhỏ nhất đủ để giải bài toán Nên sử dụng dữ liệu khối lập phương khi trả lời câu hỏi tổng hợp thông tin June 18, 2021 64

Lựa chọn đặc trưng n Khái niệm n n n Lựa chọn tập nhỏ nhất đặc trưng mà phân bố xác suất các lớp khác nhau cho giá trị gần như phân bổ vốn có các giá trị các đặc trưng Kỳ vọng Ø Tăng tốc độ thực thi Ø Tăng chất lượng mẫu? các đặc trưng “nhiễu” Ø Hoặc cả hai mục tiêu trên Phương pháp Heuristic (# mũ phép chọn) : Chọn tiến/lùi n n Kết hợp chon tiến/lùi lên trước và loại bỏ lạc hậu. Rút gọn bằng cây quyết định Hai tiếp cận điển hình Ø Tiếp cận lọc Tiếp cận bao gói Ø June 18, 2021 65

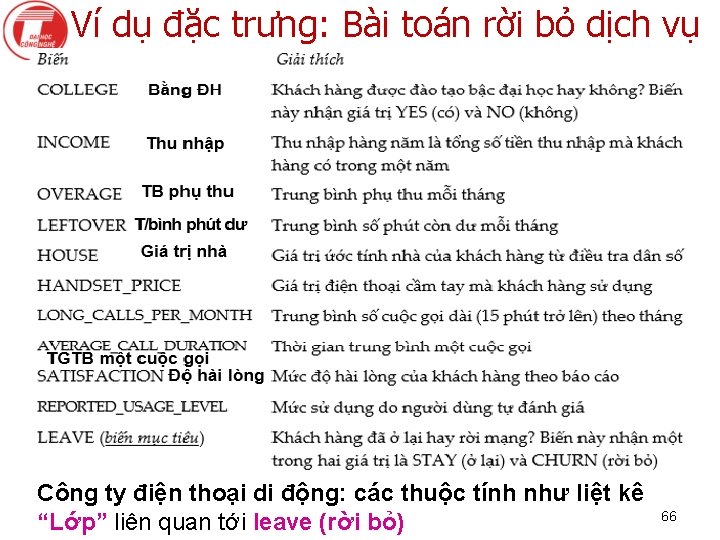

Ví dụ đặc trưng: Bài toán rời bỏ dịch vụ Công ty điện thoại di động: các thuộc tính như liệt kê “Lớp” liên quan tới leave (rời bỏ) 66

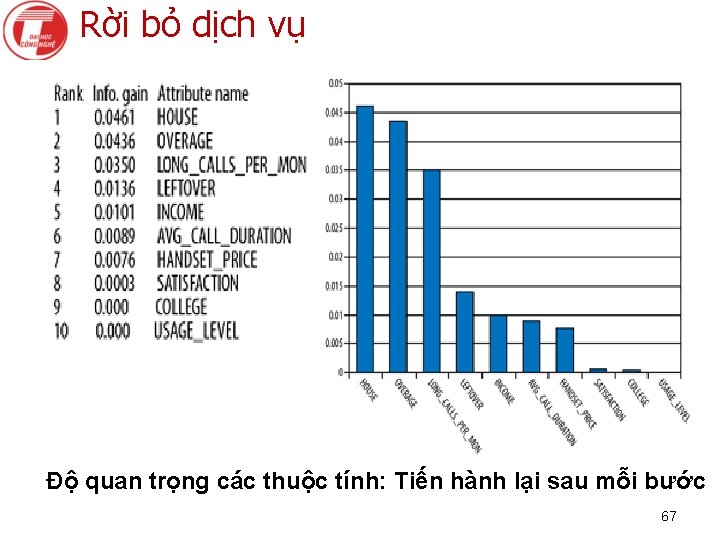

Rời bỏ dịch vụ Độ quan trọng các thuộc tính: Tiến hành lại sau mỗi bước 67

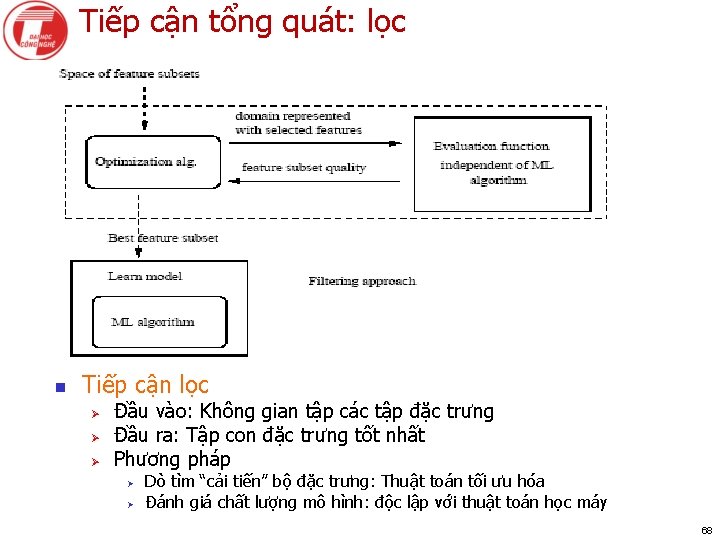

Tiếp cận tổng quát: lọc n Tiếp cận lọc Ø Ø Ø Đầu vào: Không gian tập các tập đặc trưng Đầu ra: Tập con đặc trưng tốt nhất Phương pháp Ø Ø Dò tìm “cải tiến” bộ đặc trưng: Thuật toán tối ưu hóa Đánh giá chất lượng mô hình: độc lập với thuật toán học máy 68

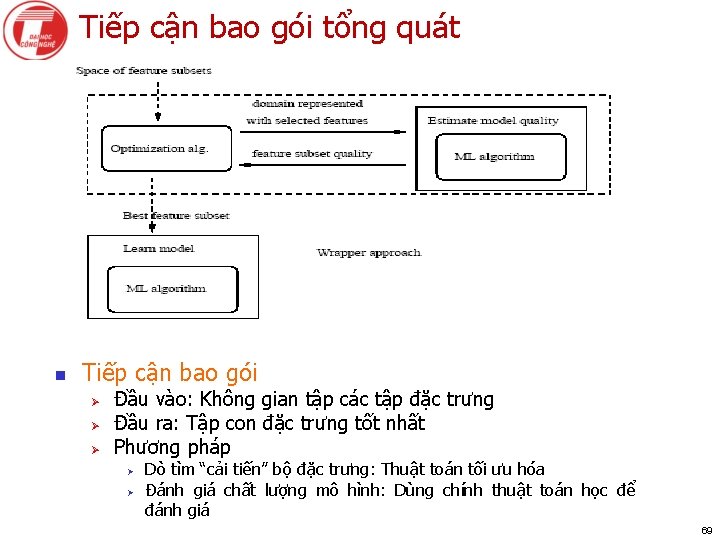

Tiếp cận bao gói tổng quát n Tiếp cận bao gói Ø Ø Ø Đầu vào: Không gian tập các tập đặc trưng Đầu ra: Tập con đặc trưng tốt nhất Phương pháp Ø Ø Dò tìm “cải tiến” bộ đặc trưng: Thuật toán tối ưu hóa Đánh giá chất lượng mô hình: Dùng chính thuật toán học để đánh giá 69

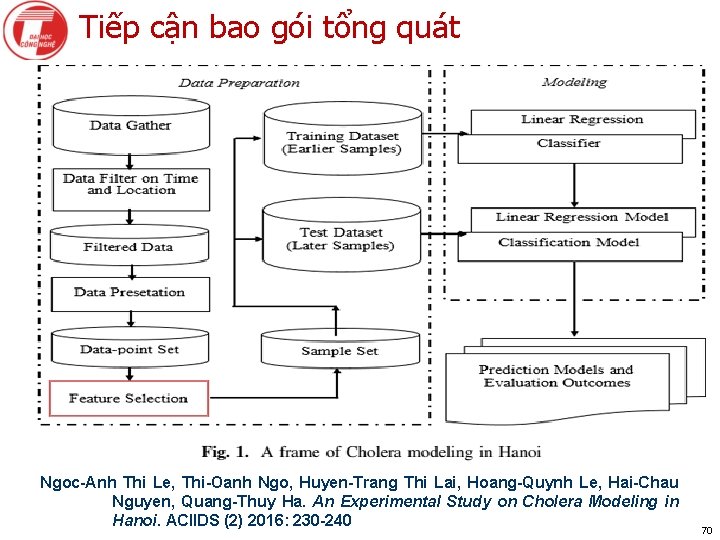

Tiếp cận bao gói tổng quát Ngoc-Anh Thi Le, Thi-Oanh Ngo, Huyen-Trang Thi Lai, Hoang-Quynh Le, Hai-Chau Nguyen, Quang-Thuy Ha. An Experimental Study on Cholera Modeling in Hanoi. ACIIDS (2) 2016: 230 -240 70

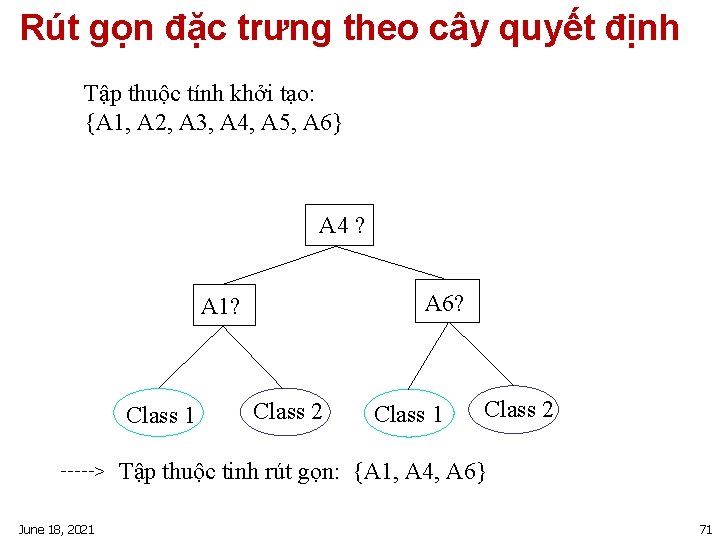

Rút gọn đặc trưng theo cây quyết định Tập thuộc tính khởi tạo: {A 1, A 2, A 3, A 4, A 5, A 6} A 4 ? A 6? A 1? Class 1 > June 18, 2021 Class 2 Class 1 Class 2 Tập thuộc tinh rút gọn: {A 1, A 4, A 6} 71

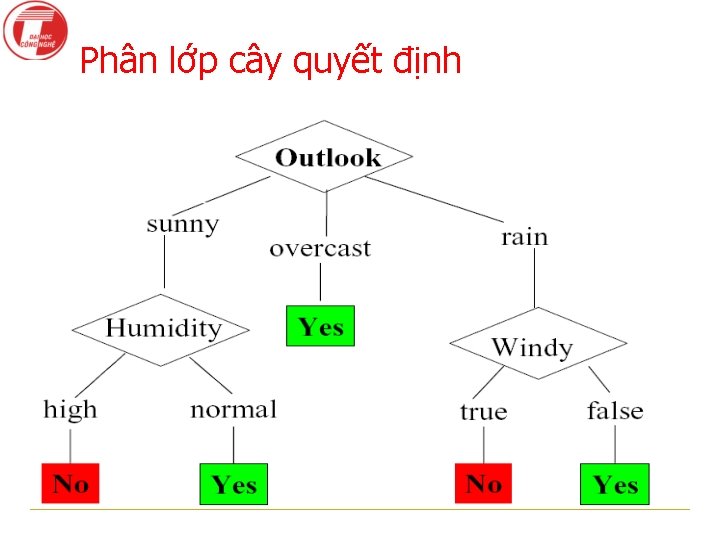

Phân lớp cây quyết định n n n Đồ thị dạng cây Đỉnh trong là một hàm test Các nhánh tương ứng với kết quả kiểm tra tại đỉnh trong Các lá là các nhãn, hoặc các lớp. Xem Chương 5

Phân lớp cây quyết định

Phân lớp cây quyết định n Xây dựng cây quyết định: n Xây dựng cây quyết định n n Cắt tỉa cây (pruning) n n Phương pháp top-down Phương pháp bottom-up: xác định và loại bỏ những nhánh rườm rà tăng độ chính xác khi phân lớp những đối tượng mới Sử dụng cây quyết định: phân lớp các đối tượng chưa được gán nhãn

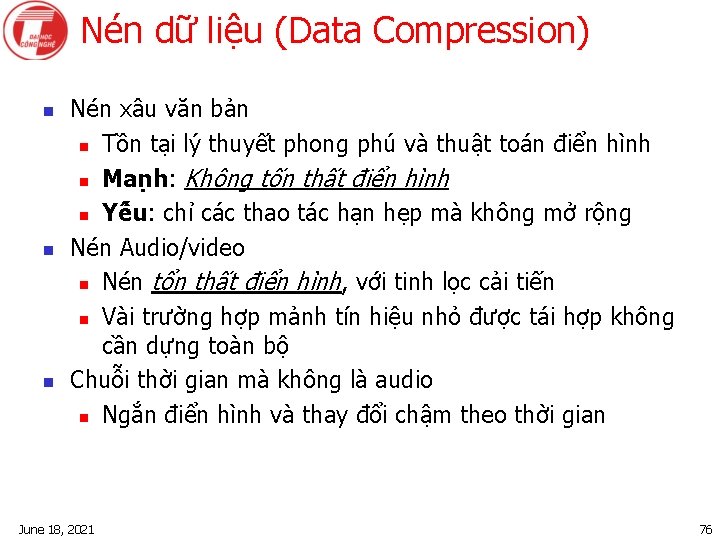

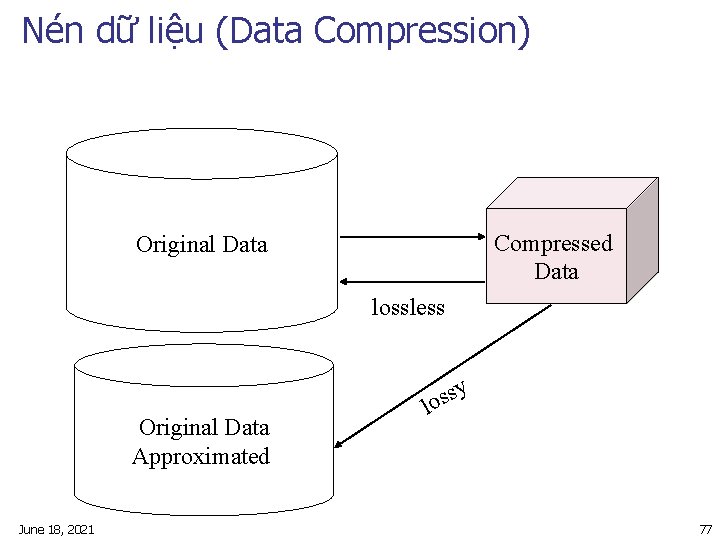

Nén dữ liệu (Data Compression) n n n Nén xâu văn bản n Tồn tại lý thuyết phong phú và thuật toán điển hình n Ma nh: Không tốn thất điển hình n Yê u: chỉ các thao tác hạn hẹp mà không mở rộng Nén Audio/video n Nén tổn thất điển hình, với tinh lọc cải tiến n Vài trường hợp mảnh tín hiệu nhỏ được tái hợp không cần dựng toàn bộ Chuô i thời gian mà không là audio n Ngắn điển hình và thay đổi chậm theo thời gian June 18, 2021 76

Nén dữ liệu (Data Compression) Compressed Data Original Data lossless Original Data Approximated June 18, 2021 y s s lo 77

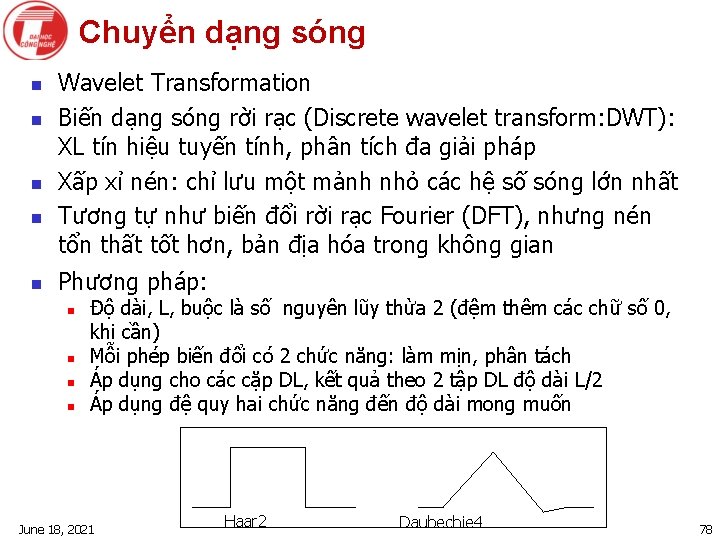

Chuyển dạng sóng n n n Wavelet Transformation Biến dạng sóng rời rạc (Discrete wavelet transform: DWT): XL tín hiệu tuyến tính, phân tích đa giải pháp Xấp xỉ nén: chỉ lưu một mảnh nhỏ các hệ số sóng lớn nhất Tương tự như biến đổi rời rạc Fourier (DFT), nhưng nén tổn thất tốt hơn, bản địa hóa trong không gian Phương pháp: n n Độ dài, L, buộc là số nguyên lũy thừa 2 (đệm thêm các chữ số 0, khi cần) Mỗi phép biến đổi có 2 chức năng: làm mịn, phân tách Áp dụng cho các cặp DL, kết quả theo 2 tập DL độ dài L/2 Áp dụng đệ quy hai chức năng đến độ dài mong muốn June 18, 2021 Haar 2 Daubechie 4 78

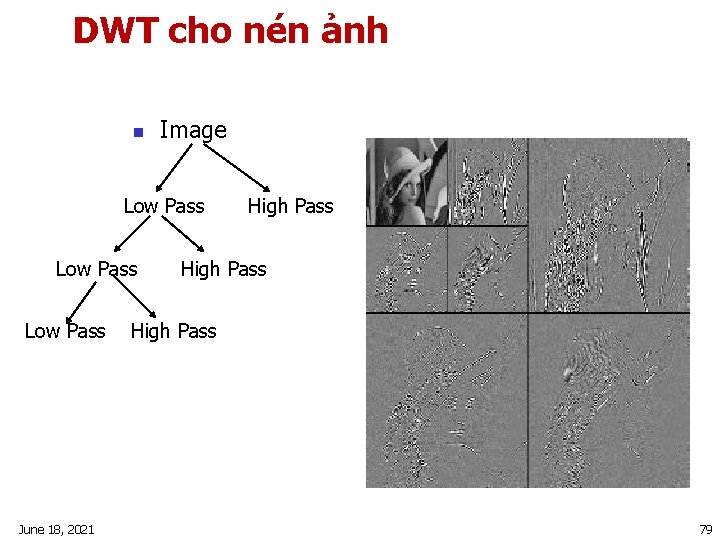

DWT cho nén ảnh n Image Low Pass June 18, 2021 High Pass 79

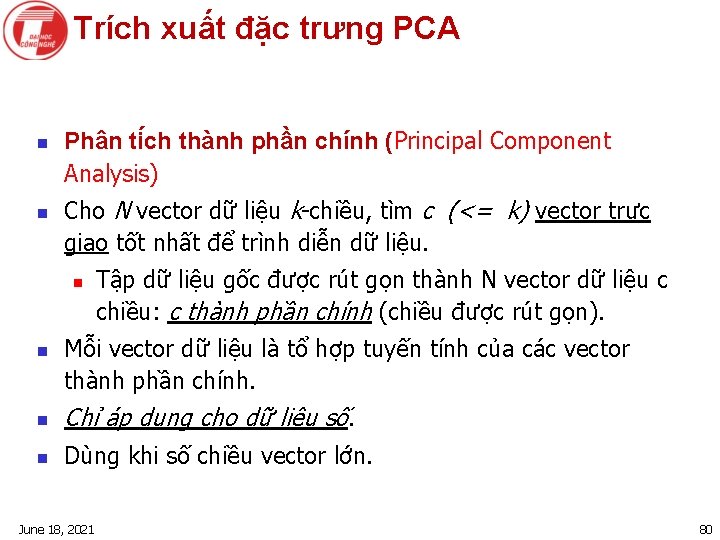

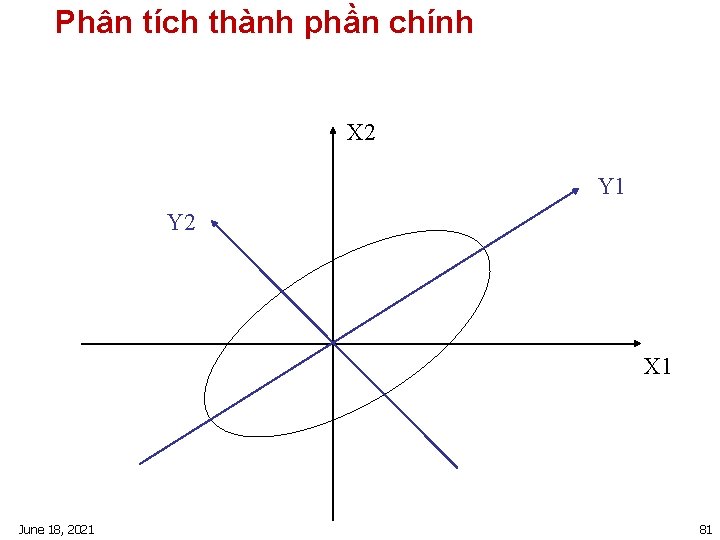

Trích xuất đặc trưng PCA n n Phân ti ch thành phần chính (Principal Component Analysis) Cho N vector dữ liệu k-chiều, tìm c (<= k) vector trực giao tốt nhất để trình diễn dữ liệu. n n Tập dữ liệu gốc được rút gọn thành N vector dữ liệu c chiều: c thành phần chính (chiều được rút gọn). Mỗi vector dữ liệu là tổ hợp tuyến tính của các vector thành phần chính. n Chỉ áp dụng cho dữ liệu số. n Dùng khi số chiều vector lớn. June 18, 2021 80

Phân tích thành phần chính X 2 Y 1 Y 2 X 1 June 18, 2021 81

Rút gọn kích thước số n Phương pháp tham số n Giả sử dữ liệu phù hợp với mô hình nào đó, ước lượng tham số mô hình, lưu chỉ các tham số, và không lưu dữ liệu (ngoại trừ các ngoại lai có thể có) n n Mô hình tuyến tính loga (Log-linear models): lấy giá trị tại một điểm trong không gian M-chiều như là tích của các không gian con thích hợp Phương pháp không tham số n n June 18, 2021 Không giả thiết mô hình Tập hợp chính: biểu đồ (histograms), phân cụm (clustering), lấy mẫu (sampling) 82

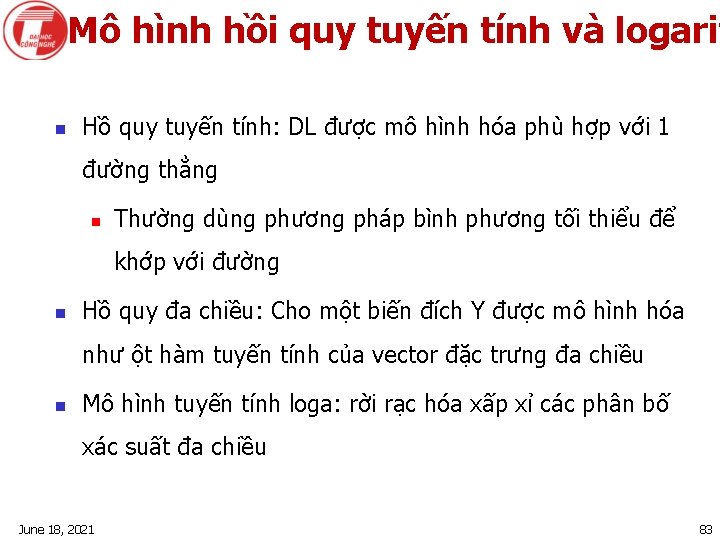

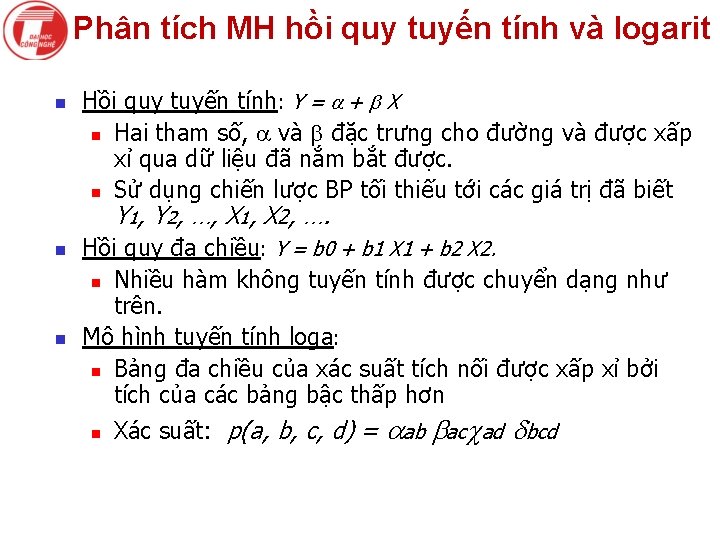

Mô hình hồi quy tuyến tính và logarit n Hồ quy tuyến tính: DL được mô hình hóa phù hợp với 1 đường thẳng n Thường dùng phương pháp bình phương tối thiểu để khớp với đường n Hồ quy đa chiều: Cho một biến đích Y được mô hình hóa như ột hàm tuyến tính của vector đặc trưng đa chiều n Mô hình tuyến tính loga: rời rạc hóa xấp xỉ các phân bố xác suất đa chiều June 18, 2021 83

Phân tích MH hồi quy tuyến tính và logarit n Hồi quy tuyến tính: Y = + X n Hai tham số, và đặc trưng cho đường và được xấp xỉ qua dữ liệu đã nắm bắt được. n Sử dụng chiến lược BP tối thiếu tới các giá trị đã biết Y 1, Y 2, …, X 1, X 2, …. n n Hồi quy đa chiều: Y = b 0 + b 1 X 1 + b 2 X 2. n Nhiều hàm không tuyến tính được chuyển dạng như trên. Mô hình tuyến tính loga: n Bảng đa chiều của xác suất tích nối được xấp xỉ bởi tích của các bảng bậc thấp hơn n Xác suất: p(a, b, c, d) = ab ac ad bcd

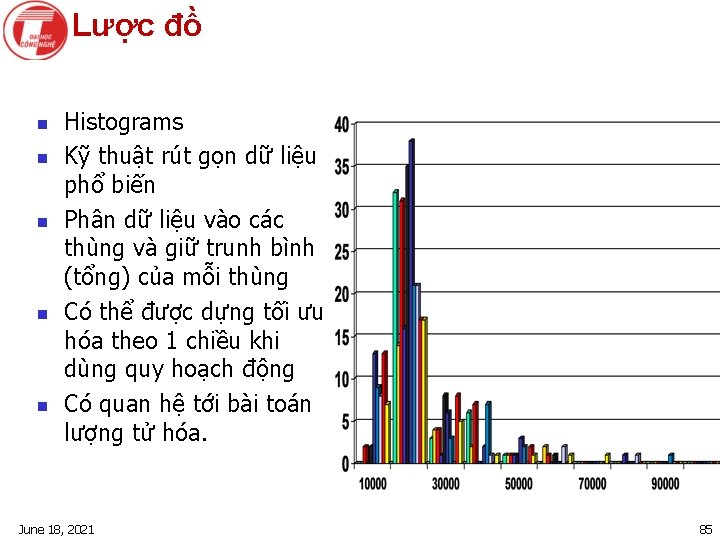

Lược đồ n n n Histograms Kỹ thuật rút gọn dữ liệu phổ biến Phân dữ liệu vào các thùng và giữ trunh bình (tổng) của mỗi thùng Có thể được dựng tối ưu hóa theo 1 chiều khi dùng quy hoạch động Có quan hệ tới bài toán lượng tử hóa. June 18, 2021 85

Phân cụm n Phân tập DL thành các cụm, và chỉ cần lưu trữ đại diện của cụm n Có thể rất hiệu quả nếu DL là được phân cụm mà không chứa dữ liệu “bẩn” n Có thể phân cụm phân cấp và được lưu trữ trong cấu trúc cây chỉ số đa chiều n Tồn tài nhiều lựa chọn cho xác định phân cụm và thuật toán phân cụm June 18, 2021 86

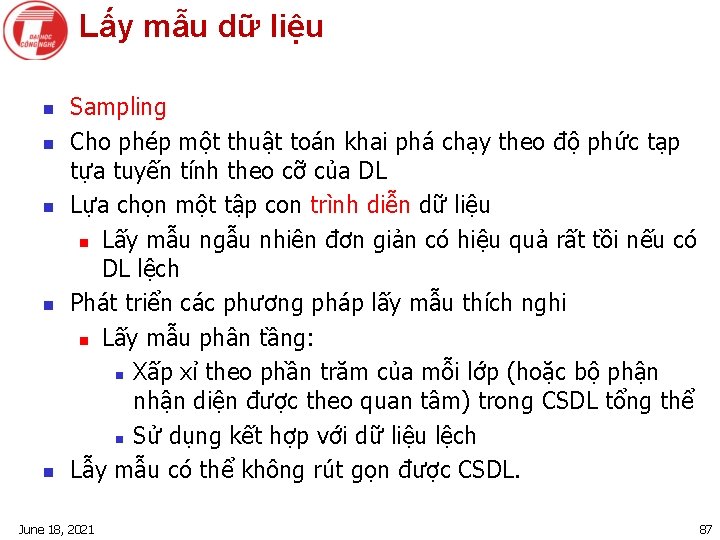

Lấy mẫu dữ liệu n n n Sampling Cho phép một thuật toán khai phá chạy theo độ phức tạp tựa tuyến tính theo cỡ của DL Lựa chọn một tập con trình diễn dữ liệu n Lấy mẫu ngẫu nhiên đơn giản có hiệu quả rất tồi nếu có DL lệch Phát triển các phương pháp lấy mẫu thích nghi n Lấy mẫu phân tầng: n Xấp xỉ theo phần trăm của mỗi lớp (hoặc bộ phận nhận diện được theo quan tâm) trong CSDL tổng thể n Sử dụng kết hợp với dữ liệu lệch Lẫy mẫu có thể không rút gọn được CSDL. June 18, 2021 87

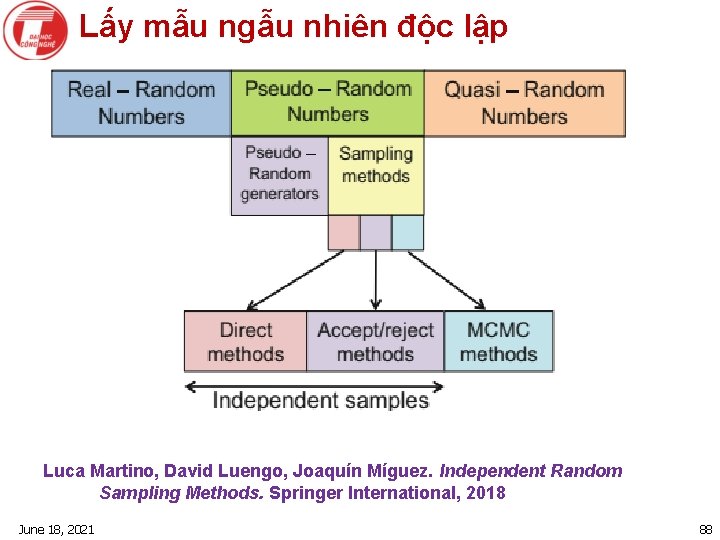

Lấy mẫu ngẫu nhiên độc lập Luca Martino, David Luengo, Joaquín Míguez. Independent Random Sampling Methods. Springer International, 2018 June 18, 2021 88

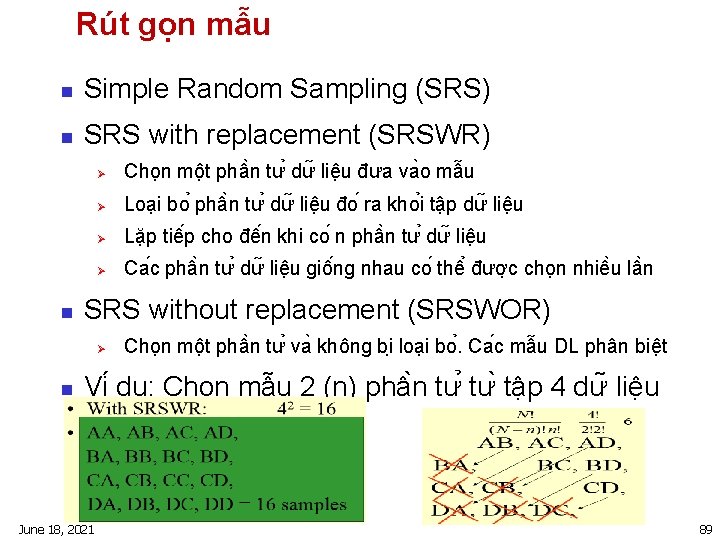

Rút gọn mẫu n Simple Random Sampling (SRS) n SRS with replacement (SRSWR) n Ø Cho n mô t phâ n tư dư liê u đưa va o mâ u Ø Loa i bo phâ n tư dư liê u đo ra kho i tâ p dư liê u Ø Lă p tiê p cho đê n khi co n phâ n tư dư liê u Ø Ca c phâ n tư dư liê u giô ng nhau co thê đươ c cho n nhiê u lâ n SRS without replacement (SRSWOR) Ø n Cho n mô t phâ n tư va không bi loa i bo. Ca c mâ u DL phân biê t Vi du : Cho n mâ u 2 (n) phâ n tư tư tâ p 4 dư liê u June 18, 2021 89

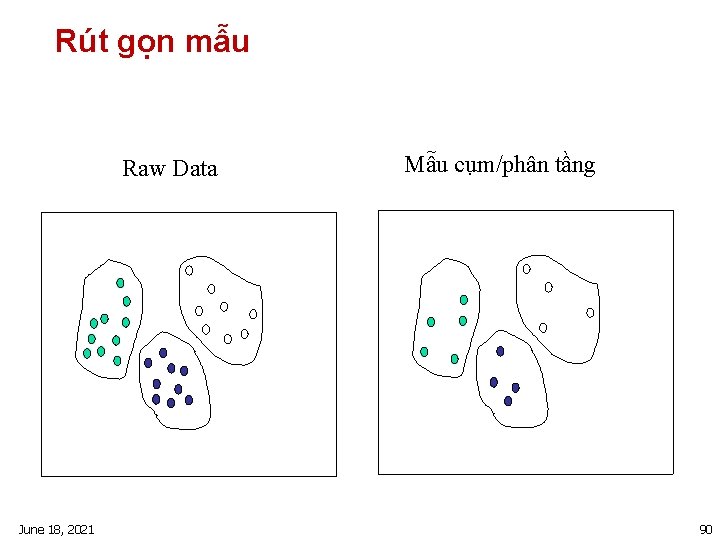

Rút gọn mẫu Raw Data June 18, 2021 Mẫu cụm/phân tầng 90

Rút gọn phân cấp n n Dùng cấu trúc đa phân giải với các mức độ khác nhau của rút gọn Phân cụm phân cấp thường được thi hành song có khuynh hướng xác định phân vùng DL hớn là “phân cụm” Phương pháp tham số thường không tuân theo trình bày phân cấp Tích hợp phân cấp n Một cây chỉ số được chia phân cấp một tập DL thành các vùng bởi miền giá trị của một vài thuộc tính n Mỗi vùng được coi như một thùng n Như vậy, cây chỉ số với tích hợp lưu trữ mỗi nút là một sơ đồ phân cấp June 18, 2021 91

Rời rạc hóa n n Ba kiểu thuộc tính: n Định danh — giá trị từ một tập không có thứ tự n Thứ tự — giá trị từ một tập được sắp n Liên tục — số thực Rời rạc hóa: n Chia miền thuộc tính liên tục thành các đoạn n Một vài thuật toán phân lớp chỉ chấp nhận thuộc tính phân loại. n Rút gọn cỡ DL bằng rời rạc hóa n Chuẩn bị cho phân tích tiếp theo June 18, 2021 92

Rời rạc hóa và kiến trúc khái niệm n Rời rạc hóa n n Rút gọn số lượng giá trị của thuộc tính liên tục bằng cách chia miền giá trị của thuộc tính thành các đoạn. Nhãn đoạn sau đó được dùng để thay thế giá trị thực. Phân cấp khái niệm n June 18, 2021 Rút gọn DL bằng tập hợp và thay thế các khái niệm mức thấp (như giá trị số của thuộc tính tuổi) bằng khái niệm ở mức cao hơn (như trẻ, trung niên, hoặc già) 93

Rời rạc hóa & kiến trúc khái niệm DL số n Phân thùng (xem làm trơn khử nhiễu) n Phân tích sơ đồ (đã giới thiệu) n Phân tích cụm (đã giới thiệu) n Rời rạc hóa dựa theo Entropy n Phân đoạn bằng phân chia tự nhiên June 18, 2021 94

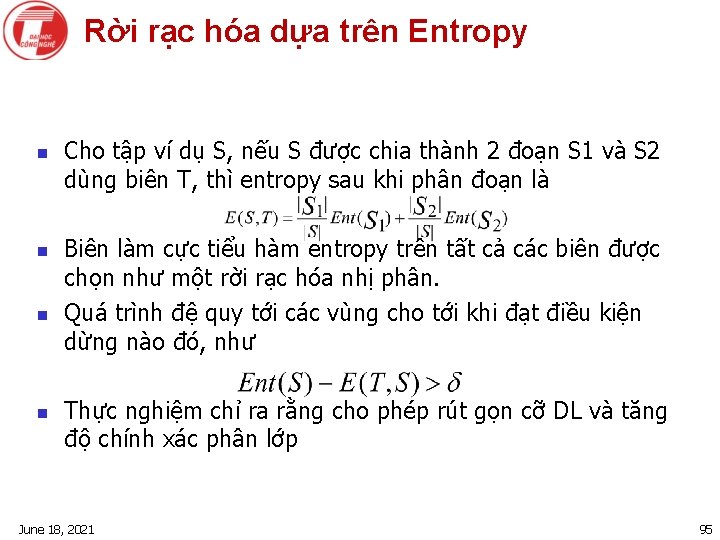

Rời rạc hóa dựa trên Entropy n n Cho tập ví dụ S, nếu S được chia thành 2 đoạn S 1 và S 2 dùng biên T, thì entropy sau khi phân đoạn là Biên làm cực tiểu hàm entropy trên tất cả các biên được chọn như một rời rạc hóa nhị phân. Quá trình đệ quy tới các vùng cho tới khi đạt điều kiện dừng nào đó, như Thực nghiệm chỉ ra rằng cho phép rút gọn cỡ DL và tăng độ chính xác phân lớp June 18, 2021 95

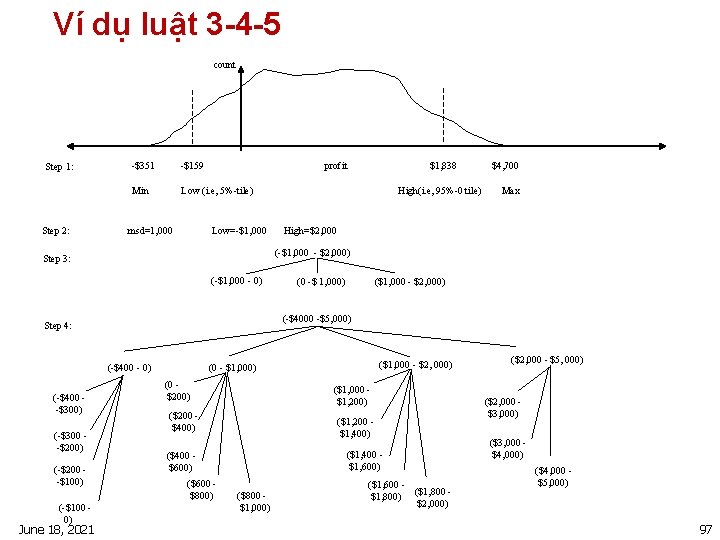

Phân đoạn bằng phân hoạch tự nhiên n Quy tắc đơn giản 3 -4 -5 được dùng để phân đoạn dữ liệu số thành các đoạn tương đối thống nhất, “tự nhiên”. n Hướng tới số giá trị khác biệt ở vùng quan trọng nhất n Nếu 3, 6, 7 hoặc 9 giá trị khác biệt thì chia miền thành 3 đoạn tương đương. n Nếu phủ 2, 4, hoặc 8 giá trị phân biệt thì chia thành 4. n Nếu phủ 1, 5, hoặc 10 giá trị phân biệt thì chia thành 5. June 18, 2021 96

Ví dụ luật 3 -4 -5 count Step 1: Step 2: -$351 -$159 Min Low (i. e, 5%-tile) msd=1, 000 profit Low=-$1, 000 (-$1, 000 - 0) (-$400 - 0) (-$200 -$100) (-$100 0) June 18, 2021 Max High=$2, 000 ($1, 000 - $2, 000) (0 -$ 1, 000) (-$4000 -$5, 000) Step 4: (-$300 -$200) High(i. e, 95%-0 tile) $4, 700 (-$1, 000 - $2, 000) Step 3: (-$400 -$300) $1, 838 ($1, 000 - $2, 000) (0 - $1, 000) (0 $200) ($1, 000 $1, 200) ($200 $400) ($1, 200 $1, 400) ($1, 400 $1, 600) ($400 $600) ($600 $800) ($800 $1, 000) ($1, 600 ($1, 800) $2, 000) ($2, 000 - $5, 000) ($2, 000 $3, 000) ($3, 000 $4, 000) ($4, 000 $5, 000) 97

Sinh kiến trúc khái niệm dữ liệu phân loại n n n Đặc tả một thứ tự bộ phận giá trị thuộc tính theo mức sơ đồ do người dùng hoặc chuyên gias n street<city<state<country Đặc tả thành cấu trúc phân cấp nhờ nhóm dữ liệu n {Urbana, Champaign, Chicago}<Illinois Đặc tả theo tập các thuộc tính. n Tự động sắp xếp một phần bằng cách phân tích số lượng các giá trị khác biệt Như, street < city <state < country Đặc tả một phần thứ tự bộ phận n Như, chỉ street < city mà không có cái khác n n June 18, 2021 98

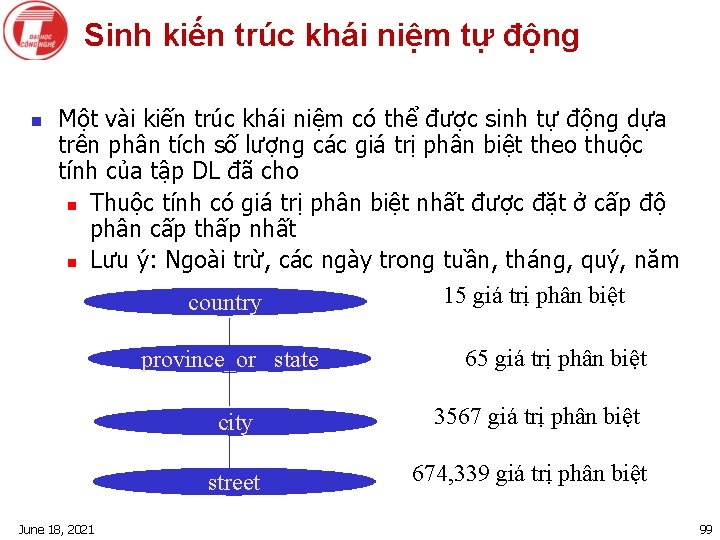

Sinh kiến trúc khái niệm tự động n Một vài kiến trúc khái niệm có thể được sinh tự động dựa trên phân tích số lượng các giá trị phân biệt theo thuộc tính của tập DL đã cho n Thuộc tính có giá trị phân biệt nhất được đặt ở cấp độ phân cấp thấp nhất n Lưu ý: Ngoài trừ, các ngày trong tuần, tháng, quý, năm 15 giá trị phân biệt country province_or_ state city street June 18, 2021 65 giá trị phân biệt 3567 giá trị phân biệt 674, 339 giá trị phân biệt 99

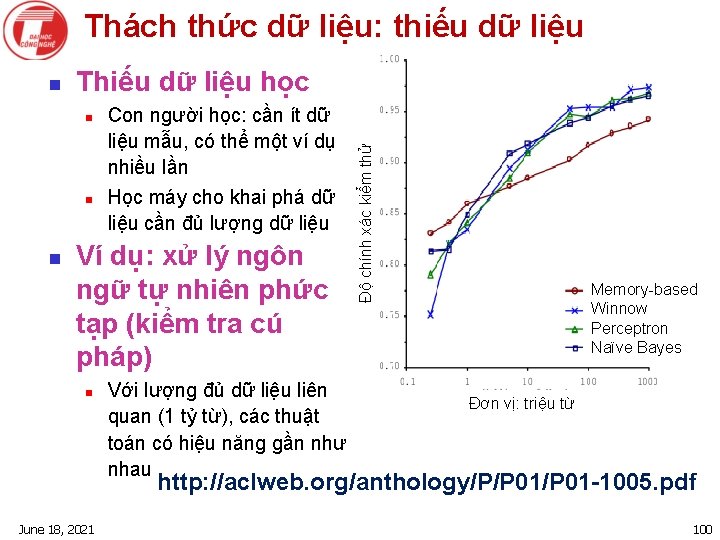

Thách thức dữ liệu: thiếu dữ liệu Thiếu dữ liệu học n n n Con người học: cần ít dữ liệu mẫu, có thể một ví dụ nhiều lần Học máy cho khai phá dữ liệu cần đủ lượng dữ liệu Ví dụ: xử lý ngôn ngữ tự nhiên phức tạp (kiểm tra cú pháp) n Với lượng đủ dữ liệu liên quan (1 tỷ từ), các thuật toán có hiệu năng gần như nhau Độ chính xác kiểm thử n Memory-based Winnow Perceptron Naïve Bayes Đơn vị: triệu từ http: //aclweb. org/anthology/P/P 01 -1005. pdf June 18, 2021 100

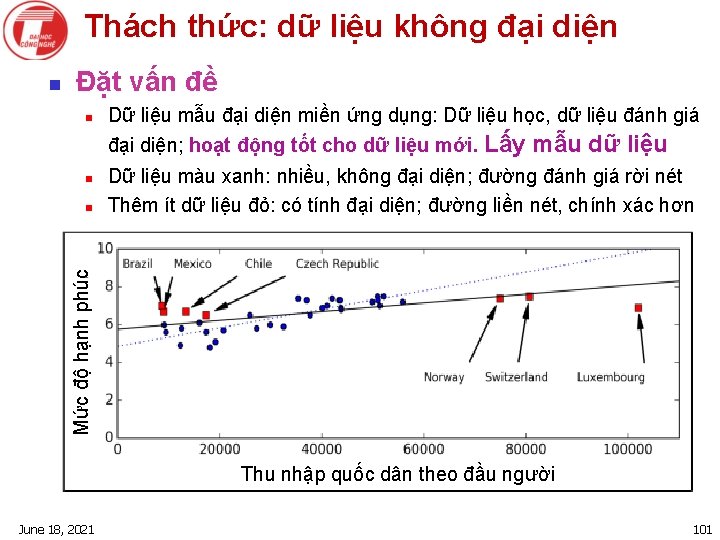

Thách thức: dữ liệu không đại diện n Đặt vấn đề n Dữ liệu mẫu đại diện miền ứng dụng: Dữ liệu học, dữ liệu đánh giá đại diện; hoạt động tốt cho dữ liệu mới. Lấy n Mức độ hạnh phúc n mẫu dữ liệu Dữ liệu màu xanh: nhiều, không đại diện; đường đánh giá rời nét Thêm ít dữ liệu đỏ: có tính đại diện; đường liền nét, chính xác hơn Thu nhập quốc dân theo đầu người June 18, 2021 101

Thách thức dữ liệu khác n Chất lượng dữ liệu kém n n Dữ liệu chứa lỗi, ngoại lệ, nhiễu Phần công sức lớn trong KPDL Bước tiền xử lý dữ liệu ở Chương này Đặc trưng không liên quan n n June 18, 2021 Có đủ đặc trưng liên quan và không quá nhiều đặc trưng không liên quan Lựa chọn đặc trưng Trích xuất đặc trưng Bổ sung dữ liệu nhằm bổ sung đặc trưng liên quan 102

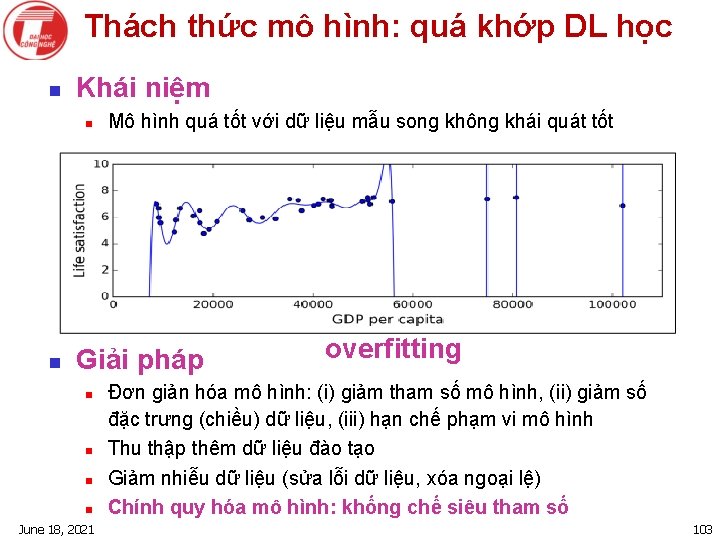

Thách thức mô hình: quá khớp DL học n Khái niệm n n Mô hình quá tốt với dữ liệu mẫu song không khái quát tốt Giải pháp n n June 18, 2021 overfitting Đơn giản hóa mô hình: (i) giảm tham số mô hình, (ii) giảm số đặc trưng (chiều) dữ liệu, (iii) hạn chế phạm vi mô hình Thu thập thêm dữ liệu đào tạo Giảm nhiễu dữ liệu (sửa lỗi dữ liệu, xóa ngoại lệ) Chính quy hóa mô hình: khống chế siêu tham số 103

Cùng tập dữ liệu: quá khớp và không khớp Quá khớp: Chính quy hóa tham số mô hình Khống chế miền giá trị tham số để giảm số lượng tham số Overfitting Rất tinh: Khó đoán chính xác đối với dữ liệu mới June 18, 2021 Underfitting Rất thô: khó đoán chính xác đối với dữ liệu mới 104

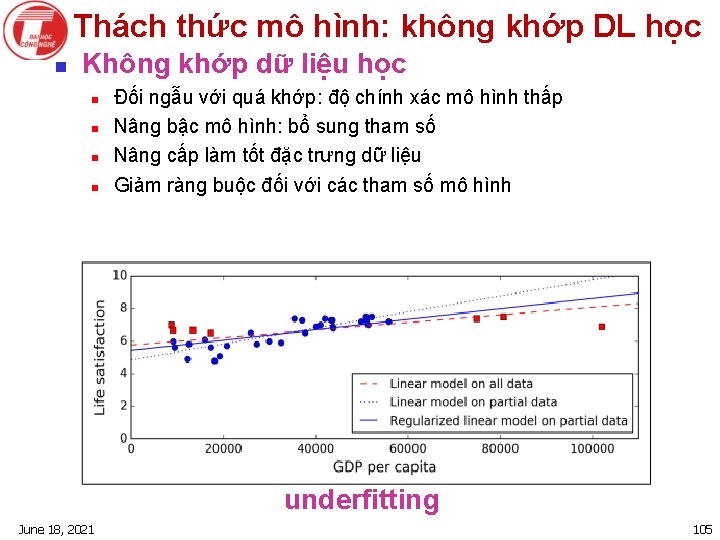

Thách thức mô hình: không khớp DL học n Không khớp dữ liệu học n n Đối ngẫu với quá khớp: độ chính xác mô hình thấp Nâng bậc mô hình: bổ sung tham số Nâng cấp làm tốt đặc trưng dữ liệu Giảm ràng buộc đối với các tham số mô hình underfitting June 18, 2021 105

Thách thức mô hình: dùng một kỹ thuật n Giới thiệu § § n “Đưa cho một cậu bé một chiếc búa, cả thế giới chỉ là cái đinh” Nhiều người quen sử dụng một công cụ. Cần bộ công cụ Ví dụ § § § June 18, 2021 Ít nhất so sánh phương pháp lựa chọn với phương pháp thông thường base-line Nghiên cứu bài đăng tạp chí về mạng nơron: chỉ 17% tránh được hai sai lầm 1 và 2 Không sử dụng phương pháp khác đổ lỗi cho thuật toán Lưu ý: Không có một mô hình cụ thể làm việc với sự khác biệt lớn Tốt nhất: Nên sử dụng một bộ công cụ đầy đủ (Chỉ thêm có 510% nỗ lực). 106

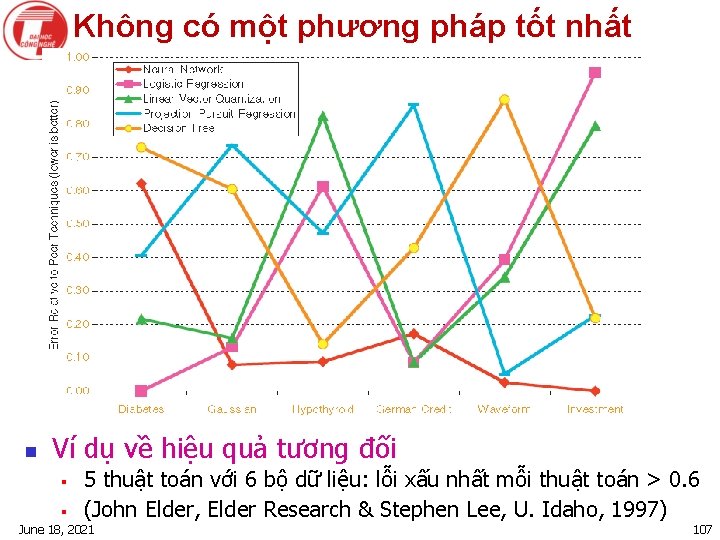

Không có một phương pháp tốt nhất n Ví dụ về hiệu quả tương đối § 5 thuật toán với 6 bộ dữ liệu: lỗi xấu nhất mỗi thuật toán > 0. 6 (John Elder, Elder Research & Stephen Lee, U. Idaho, 1997) § June 18, 2021 107

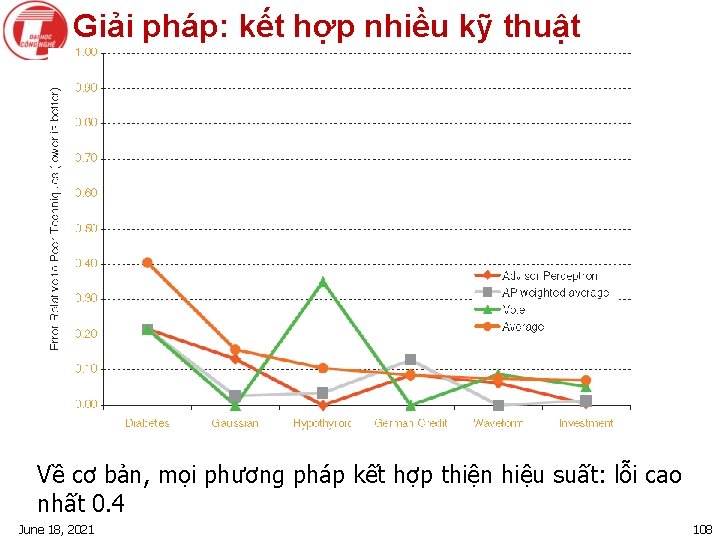

Giải pháp: kết hợp nhiều kỹ thuật Về cơ bản, mọi phương pháp kết hợp thiện hiệu suất: lỗi cao nhất 0. 4 June 18, 2021 108

- Slides: 107