Back Propagation Dana Nejedlov Katedra informatiky Ekonomick fakulta

Back. Propagation Dana Nejedlová Katedra informatiky Ekonomická fakulta Technická univerzita v Liberci

Delta Rule • Pravidlo učení vah pro neuronovou síť s jednou vrstvou • Taková síť má stejnou architekturu jako Perceptron. • To znamená, že dokáže řešit jen lineárně separabilní problémy a klasifikuje vstupní vektory do 2 tříd. • Pokud je problém lineárně separabilní, algoritmus Perceptron najde řešení rychleji. • Pokud problém není lineárně separabilní, algoritmus Delta Rule konverguje k optimální klasifikaci, tedy minimalizuje celkovou velikost chyby, viz https: //www. mldawn. com/what-is-the-delta-rule-part 1/. • Dnes slouží algoritmus Delta Rule především jako úvod do pochopení algoritmu Backpropagation.

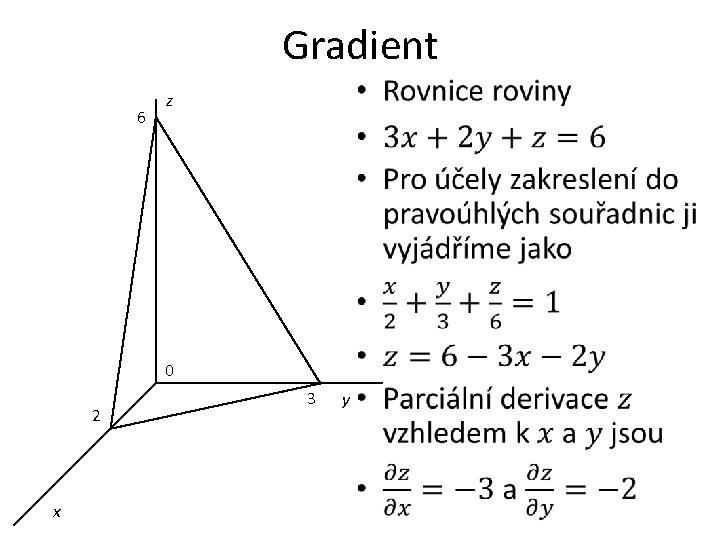

Gradient 6 • z 0 2 x 3 y

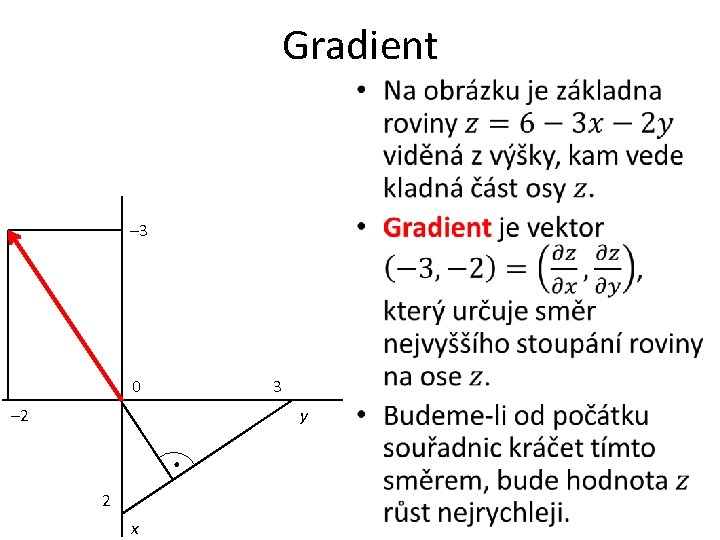

Gradient • – 3 0 – 2 3 y 2 x

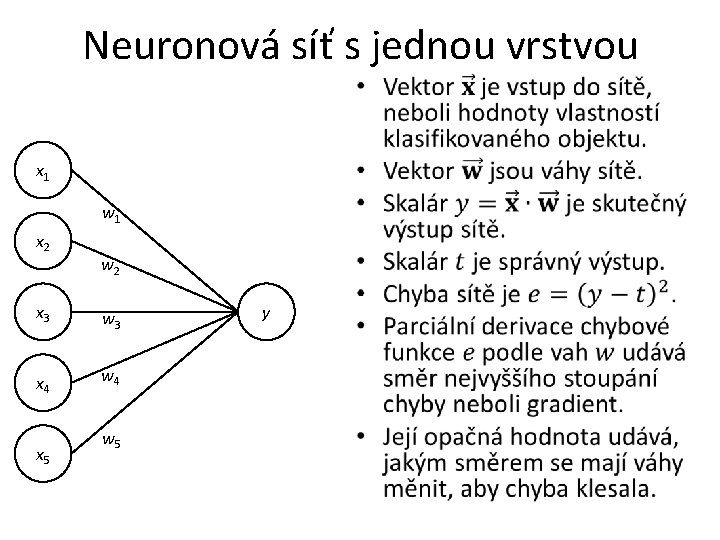

Neuronová síť s jednou vrstvou • x 1 w 1 x 2 w 2 x 3 w 3 x 4 w 4 x 5 w 5 y

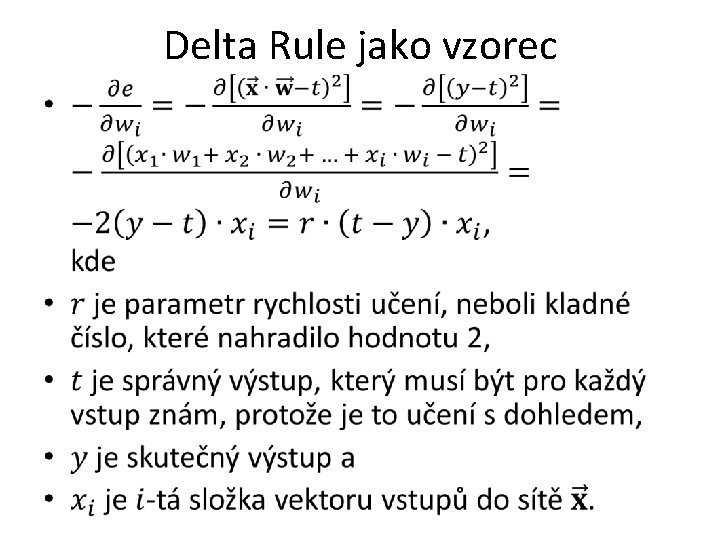

• Delta Rule jako vzorec

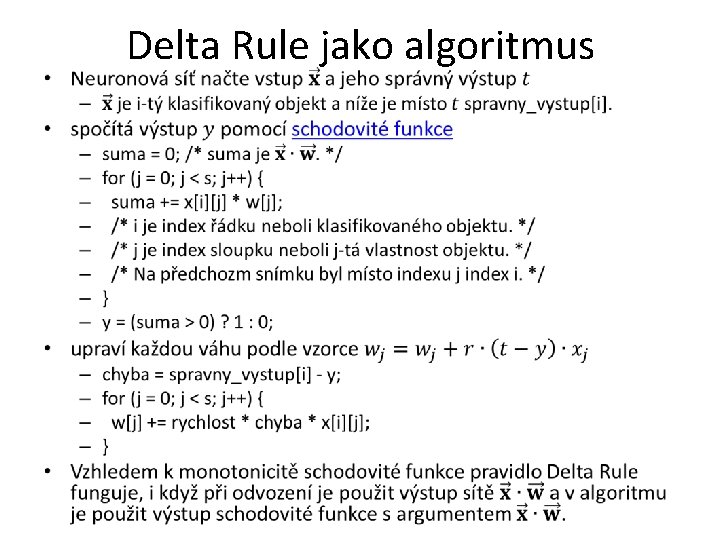

• Delta Rule jako algoritmus

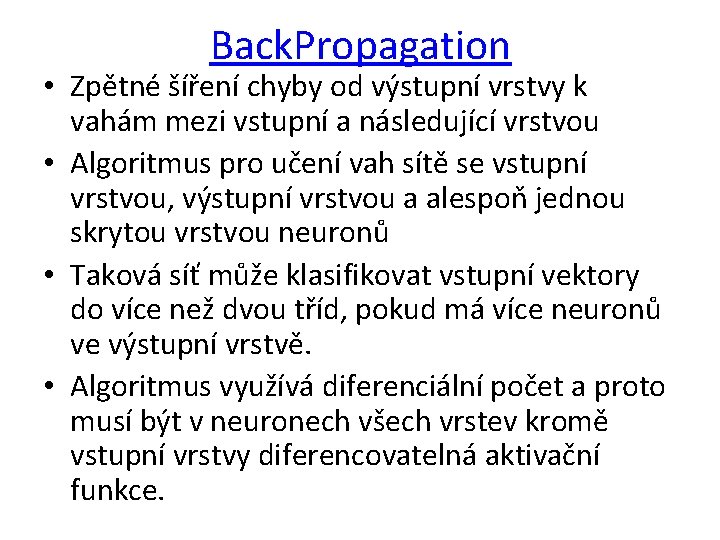

Back. Propagation • Zpětné šíření chyby od výstupní vrstvy k vahám mezi vstupní a následující vrstvou • Algoritmus pro učení vah sítě se vstupní vrstvou, výstupní vrstvou a alespoň jednou skrytou vrstvou neuronů • Taková síť může klasifikovat vstupní vektory do více než dvou tříd, pokud má více neuronů ve výstupní vrstvě. • Algoritmus využívá diferenciální počet a proto musí být v neuronech všech vrstev kromě vstupní vrstvy diferencovatelná aktivační funkce.

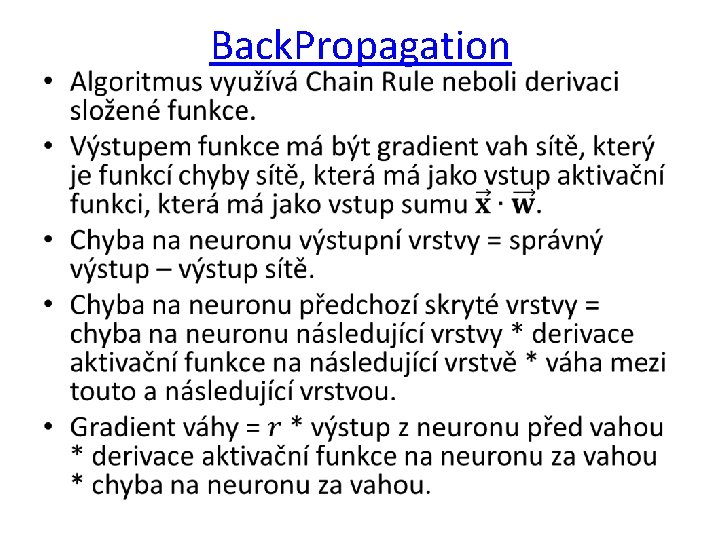

• Back. Propagation

- Slides: 9