Aula 2 2 Semestre de 2015 Esclarecimentos sobre

Aula 2 2º. Semestre de 2015 Esclarecimentos sobre o livro: Informação: Uma história, uma teoria, uma enxurrada. Prof. Dr. Marcos L. Mucheroni 1

Problema: número computáveis Devem existir problemas indecidíveis Problema é decidir se uma cadeia pertence a uma linguagem O número de linguagens diferentes sobre um alfabeto com mais do que um símbolo não é numerável Os programas são numeráveis Não é possível estabelecer uma correspondência biunívoca com Cadeias finitas sobre alfabetos finitos Ordenar por comprimento e por ordem lexicográfica Podem ser contados, embora em número infinito. Há infinitamente menos programas do que problemas Linguagem ao acaso dá provavelmente um problema indecidível A maioria dos problemas parecem decidíveis porque são escolhidos

Teoria da Informação I Motivação Problemas indecidíveis Problemas intratáveis Não existe algoritmo (lógico) para tudo. Os algoritmos conhecidos são demasiado dispendiosos Simplificação; heurísticas Necessidade de um modelo simples de computador para estudar a computabilidade Máquinas de Turing Modelo de computador, mais do que de linguagem

Contexto histórico – neologicismo também Popper. Contexto David Hilbert (início do séc. XX) Kurt Gödel (1931) Teorema da incompletude: construiu uma fórmula que não pode ser provada nem refutada Técnica semelhante ao programa contraditório H 2 Alan Turing (1936) Há alguma maneira de determinar se qualquer fórmula da lógica de predicados de primeira ordem, aplicada aos inteiros, é verdadeira? Máquina de Turing: modelo de qualquer computação possível Foi desenvolvido, durante a 2ª Guerra, no esforço de construção de máquinas de quais emergiram os computadores Hipótese de Church (tese de Church-Turing, não demonstrável) Todos os modelos gerais de computação são equivalentes às funções parciais recursivas e às máquinas de Turing (mesmo os computadores actuais)

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Novos fios e nova lógica Infância de Shannon na pequena cidade de Gaylord, interesse por matemática e códigos, vai para Universidade de Michigan em 1932. 1936 vê anuncio d emprego para alunos de pósgraduação Massachusetts Institute of Technology. Vannevar Bush era o chefe do departamento de engenharia e procurava um assistente para sua máquina: Analisador Diferencial, computador de Charles Babbage, descrito no livro de Gleick: ”Ao contrário da máquina de Babbage, esta não manipulava os números. Funcionava com base nas quantidades – gerando curvas, como Bush gostava de dizer, para representar o futuro de um sistema dinâmico. Diríamos hoje que o aparato era analógico em vez de digital. ” (Gleick, 2013, p. 181).

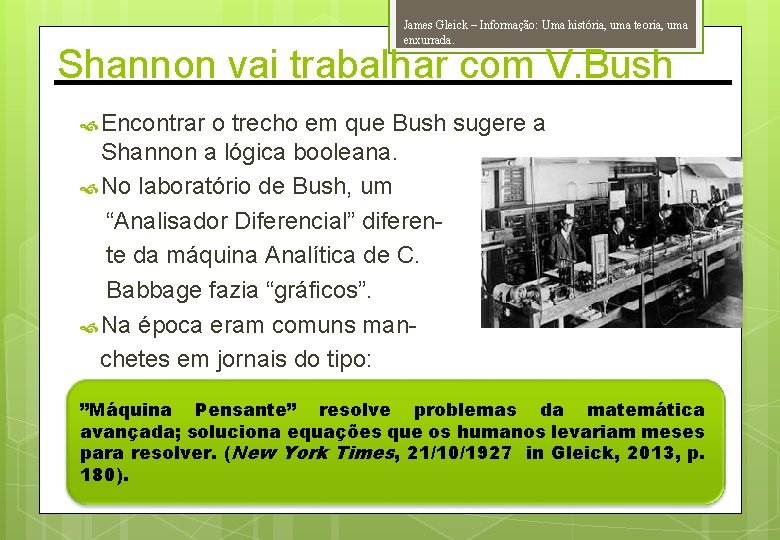

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Shannon vai trabalhar com V. Bush Encontrar o trecho em que Bush sugere a Shannon a lógica booleana. No laboratório de Bush, um “Analisador Diferencial” diferente da máquina Analítica de C. Babbage fazia “gráficos”. Na época eram comuns manchetes em jornais do tipo: ”Máquina Pensante” resolve problemas da matemática avançada; soluciona equações que os humanos levariam meses para resolver. (New York Times, 21/10/1927 in Gleick, 2013, p. 180).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Novos fios e nova lógica Vannevar B. - dispositivos de transmissão, e, portanto trata-se de informação nos dispositivos, e também o modelo de Shannon será isto. Desenvolve em ligação com a escrita desde o já é esta lógica (Bertrand Russel e Alfred N. Withehead): ” A invenção da escrita, catalisou a lógica, tornando possível raciocinar a respeito do raciocínio – trazer diante dos olhos um encadeamento de ideias para um exame atento – e então, tantos séculos mais tarde, a lógica era reanimada com a invenção de máquinas capazes de trabalhar a partir de símbolos. Na lógica e na matemática, as formas mais elevadas de raciocínio, todas as peças pareciam estar se encaixando” (Gleick, 2013, p. 185).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Nascimento do computador Este aparato além de dispositivos comuns: engrenagens e polias, novos dispositivos eletromecânicos que são os relés, e eles são os primeiros dispositivos a simularem bits, dígitos binários, inicialmente SIM e NÃO, e depois 0 e 1. Ideia inicial era que informação nas pessoas seria igual se codificássemos o pensamento: ” Esse fugidio objetivo foi buscado por Boole, e, antes dele, por Babbage, e muito antes de ambos por Leibniz, e todos acreditavam que a perfeição do raciocínio poderia advir da codificação perfeita do pensamento” (Gleick, 2013, p. 186). Ver Olga Pombo “Leibniz” – Characteristica Universalis – em “três projetos complementares.

Teoria da Informação Problema teórico importante Kurt Gödel que formulou que qualquer teorema pode ser demonstrado por regras mecânicas: ” “Qualquer teorema: pois o sistema era completo, ou afirmava sê-lo. Regras mecânicas, pois a lógica operava inexoravelmente, sem espaço para as variações da interpretação humana. Seus símbolos tinham sido exauridos de significado. Qualquer pessoa poderia verificar uma comprovação passo a passo simplesmente seguindo as regras, sem compreender o processo” (Gleick, 2013, pg. 190). Mas isto pode ser formulado de modo mais completo, uma vez que isto vai interessar a Shannon e Turing:

Teorema de Gödel Teorema James Gleick – Informação: Uma história, uma teoria, uma enxurrada. 1: "Qualquer teoria axiomática recursivamente enumerável e capaz de expressar algumas verdades básicas de aritmética não pode ser, ao mesmo tempo, completa e consistente. Ou seja, sempre há em uma teoria consistente proposições verdadeiras que não podem ser demonstradas nem negadas. " Teorema 2: "Uma teoria, recursivamente enumerável e capaz de expressar verdades básicas da aritmética e alguns enunciados da teoria da prova, pode provar sua própria consistência se, e somente se, for inconsistente. " Isto significa na prática que o determinismo caiu por terra. Também W. Eisenberg com seu "principio da incerteza”.

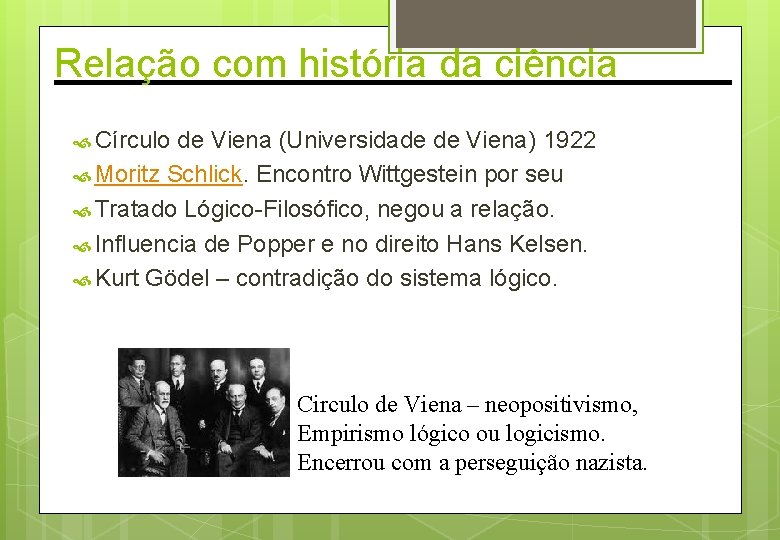

Relação com história da ciência Círculo de Viena (Universidade de Viena) 1922 Moritz Schlick. Encontro Wittgestein por seu Tratado Lógico-Filosófico, negou a relação. Influencia de Popper e no direito Hans Kelsen. Kurt Gödel – contradição do sistema lógico. Circulo de Viena – neopositivismo, Empirismo lógico ou logicismo. Encerrou com a perseguição nazista.

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Shannon e Turing, se encontram Claude Shannon trabalha no MIT – com V. Bush, sugeriu trocar a engenharia pela Matemática e este vai ao a Bell Laboratories, onde Alain Turing trabalhava secretamente em decifrar o código da Máquina Enigma, enquanto Shannon codificar Sistema X. ”. . Eles falavam indiretamento a respeito de uma noção de Turing que envolvia uma forma de medir tudo aquilo” (Gleick, 2013, p. 222). ” Shannon tinha chegado a uma noção parecida. . . sua “análise de algumas propriedades fundamentais dos sistemas gerais de transmissão de informações” (Gleick, 2013, p. 223).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Laboratório Bell – segredos Alain Turing: decodificar a alemã Enigma Claude Shannon – Máquina X codificar as conversas Roosevelt x Churchill Nos intervalos – conversas sobre Hilbert-Gödel ” Aquilo que Marshall Mc. Luhan chamou se meio era para Shannon o canal, e o canal estava sujeito a um rigoroso tratamento matemático” (Gleick, 2013, p. 272).

James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Um cérebro mundano Ao debater o problema de Hilbert, Shannon e Turing – a máquina pode pensar ? Diz como uma piada – na verdade quero um cérebro humano - Presidente da Bell Labs ! Então partem para um problema mais simples Jogar xadrez, Shannon cria o seu labirinto. Ratos – mecanismos (vetores) Norbert Wiener – Há pensamento

Computador: Turing-Church Norbert Wiener seu professor via nisto um “pensar” algo como a teoria do behaviorismo da psicologia, que vê tudo no formado do controle, professor de Shannon, Vannevar Bush com o qual trabalhou em seu laboratório escreveu: Como podemos pensar ? referindo-se ao futuro. Também tinha clareza que este era um novo início de uma batalha “Esta não foi uma guerra de cientistas; foi uma guerra onde todos tiveram seu papel” BUSH, V. As we may thing ? 1945. -Shannon trabalhou em sua máquina analítica, a qual muitos estudantes e professores recorriam no desespero para fazer gráficos de seus ensaios laboratoriais.

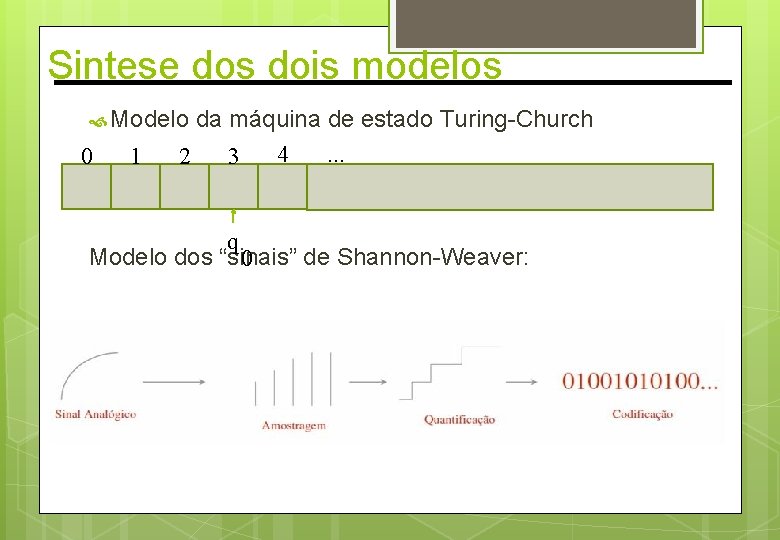

Sintese dos dois modelos Modelo 0 1 da máquina de estado Turing-Church. . . 4 2 3 q Modelo dos “sinais” de Shannon-Weaver: 0

A informação física e “enxurrada” A informação ontológica ganha natureza física. Do ser ao bit – informação ou sinal “ôntico”. A “abundância” e a “virada informacional” foi devido a ciência e de certa forma ao neopositivismo – decada de 40. A “enxurrada” é a “abundância” mais o uso da máquina. Duas naturezas: A organização do conhecimento no ser. depende da “visão de mundo” e da “visão do Ser”. Organização da dinâmica da máquina – algoritmos. .

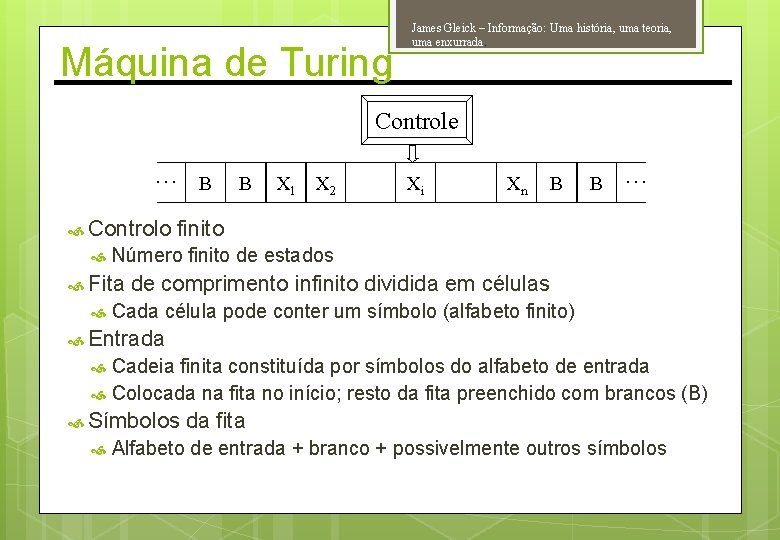

Máquina de Turing James Gleick – Informação: Uma história, uma teoria, uma enxurrada. Controle … B Controlo X 1 X 2 Xi Xn B B … finito Número finito de estados Fita B de comprimento infinito dividida em células Cada célula pode conter um símbolo (alfabeto finito) Entrada Cadeia finita constituída por símbolos do alfabeto de entrada Colocada na fita no início; resto da fita preenchido com brancos (B) Símbolos da fita Alfabeto de entrada + branco + possivelmente outros símbolos

Teoria da Informação Máquina de Turing Cabeça da fita Sempre posicionada numa célula No início, está na célula mais à esquerda da entrada Movimento ou passo da máquina função do estado do controlo e do símbolo a ser varrido pela cabeça 1. Mudança de estado Pode 2. Escrita de um símbolo na célula onde está a cabeça Pode ser o mesmo 3. Deslocação da cabeça de uma célula à esquerda ou à direita Não restringe: sequência de passos com a cabeça parada seguida de um com movimento pode ser resumida neste

Conclusões – depois Importantes para a T. I. Nem tudo é computável A teoria da decisão, não é científica. Todo formulação sistemática tem uma contradição. A teoria da informação também pode ser pensada assim. A entropia é a expansão infinita do conhecimento por situações de contradição. Apesar disto a entropia pode ser formulada logicamente. Todo problema de linguagem e codificação é finito, portanto limitado. Video (se quiserem ver): http: //globotv. globo. com/gnt/saia-justa/v/james-gleick-afirma-queinformacao-nao-e-conhecimento/2641704

- Slides: 20