Algoritmo Robusto de Aprendizaje para el Modelo Mezcla

Algoritmo Robusto de Aprendizaje para el Modelo Mezcla de Expertos n. Expositor: Romina Torres n. Comisión: Dr. Héctor Allende (Guía) Dr. Horst von Brand (Correferente) Dr. Max Chacón (Externo) 14 Noviembre 20035 -Nov-03 Romina Torres

Agenda n n n Introducción Modelo Mezcla de Expertos Algoritmos de Aprendizaje MLE basado en el gradiente ¨ MLE basado en el algoritmo EM ¨ n n n Algoritmo Robusto de Aprendizaje Especificación Algoritmo EM Teoría de Estimación robusta de parámetros ¨ n M-estimadores Algoritmos Robustos de Aprendizaje RMLE ¨ REM ¨ n n Experimentos y Resultados Conclusiones y Extensiones 14 Noviembre 2003 Romina Torres 2

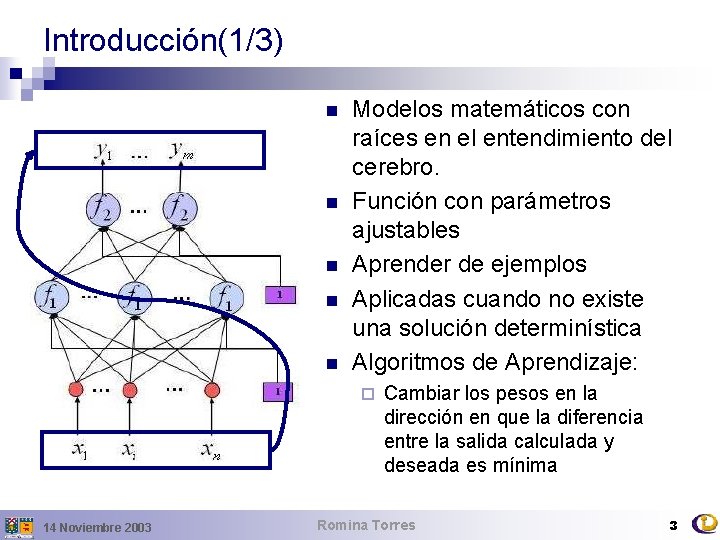

Introducción(1/3) n n n Modelos matemáticos con raíces en el entendimiento del cerebro. Función con parámetros ajustables Aprender de ejemplos Aplicadas cuando no existe una solución determinística Algoritmos de Aprendizaje: ¨ 14 Noviembre 2003 Cambiar los pesos en la dirección en que la diferencia entre la salida calculada y deseada es mínima Romina Torres 3

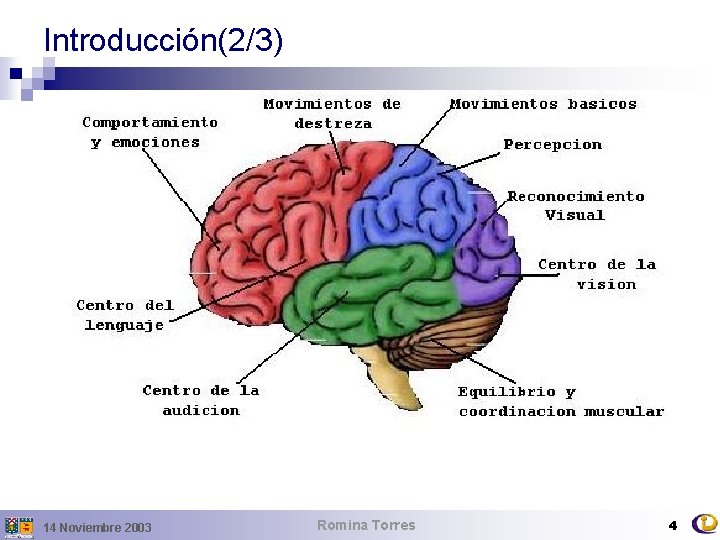

Introducción(2/3) n Interferencia SI BP es usado para entrenar una única red multicapa para realizar diferentes subtareas en diferentes ocasiones ¨ Pobre generalización, lento aprendizaje ¨ n Conocimiento a priori ¨ n Conjunto de entrenamiento naturalmente dividido en subconjuntos que corresponden a distintas subtareas El cerebro es una colección de módulos neuronales especializados funcionalmente: Existe una correspondencia entre las propiedades estructurales de un módulo y las funciones capaz de realizar. ¨ Diferentes regiones del cerebro compiten por la habilidad de realizar un conjunto de tareas (competencia sesgada). ¨ 14 Noviembre 2003 Romina Torres 4

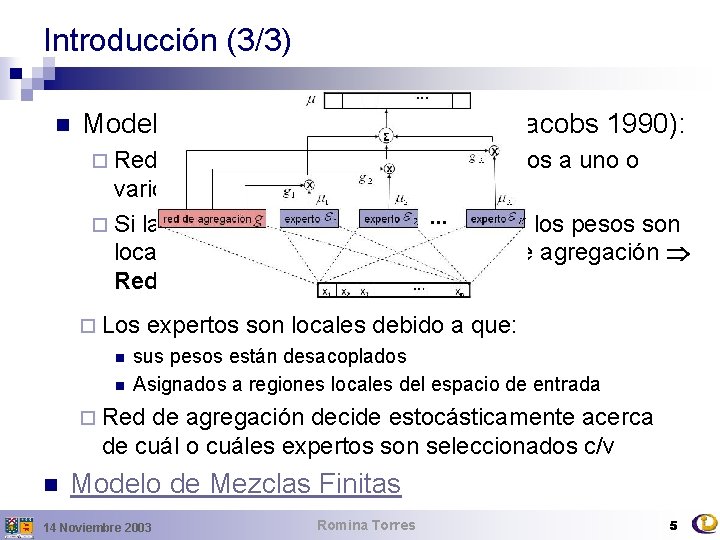

Introducción (3/3) n Modelo Mezcla de expertos (ME) (Jacobs 1990): ¨ Red agregación aprende a asignar casos a uno o varios expertos ¨ Si la salida es incorrecta los cambios a los pesos son locales sólo a esos expertos y la red de agregación Reducción de interferencia ¨ Los n n expertos son locales debido a que: sus pesos están desacoplados Asignados a regiones locales del espacio de entrada ¨ Red de agregación decide estocásticamente acerca de cuál o cuáles expertos son seleccionados c/v n Modelo de Mezclas Finitas 14 Noviembre 2003 Romina Torres 5

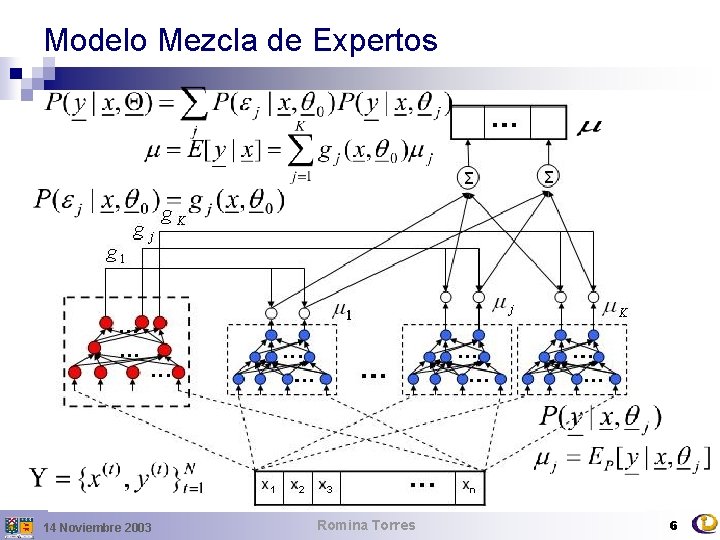

Modelo Mezcla de Expertos … … … 14 Noviembre 2003 Romina Torres 6

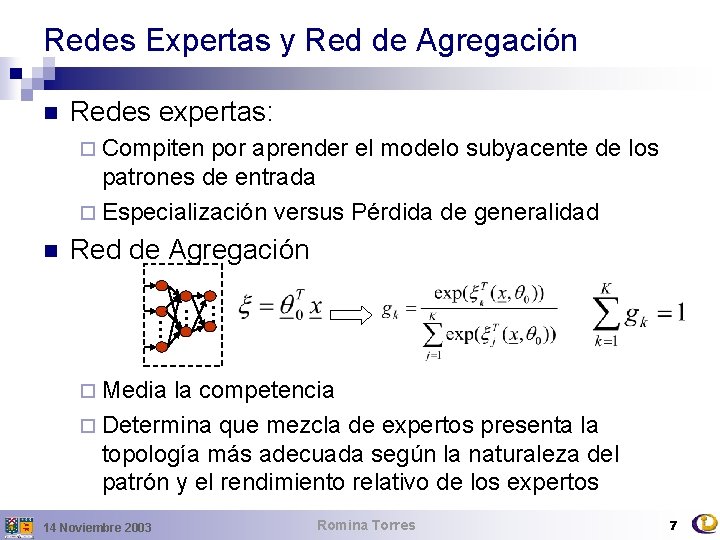

Redes Expertas y Red de Agregación n Redes expertas: ¨ Compiten por aprender el modelo subyacente de los patrones de entrada ¨ Especialización versus Pérdida de generalidad n Red de Agregación … … … ¨ Media la competencia ¨ Determina que mezcla de expertos presenta la topología más adecuada según la naturaleza del patrón y el rendimiento relativo de los expertos 14 Noviembre 2003 Romina Torres 7

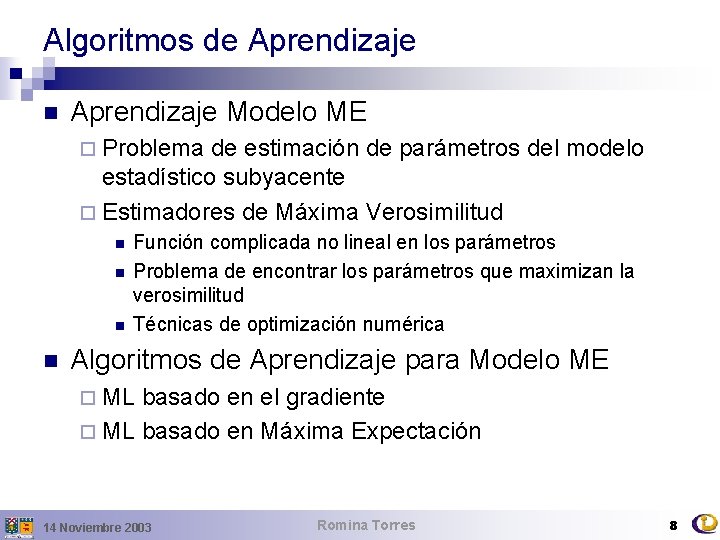

Algoritmos de Aprendizaje n Aprendizaje Modelo ME ¨ Problema de estimación de parámetros del modelo estadístico subyacente ¨ Estimadores de Máxima Verosimilitud n n Función complicada no lineal en los parámetros Problema de encontrar los parámetros que maximizan la verosimilitud Técnicas de optimización numérica Algoritmos de Aprendizaje para Modelo ME ¨ ML basado en el gradiente ¨ ML basado en Máxima Expectación 14 Noviembre 2003 Romina Torres 8

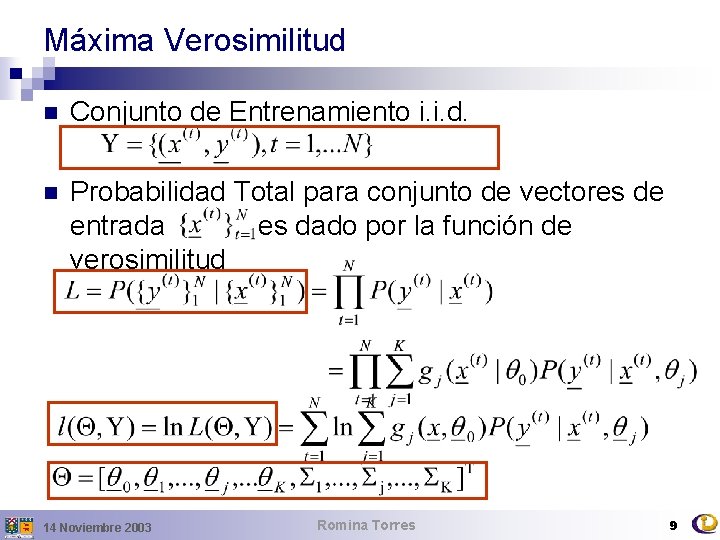

Máxima Verosimilitud n Conjunto de Entrenamiento i. i. d. n Probabilidad Total para conjunto de vectores de entrada es dado por la función de verosimilitud 14 Noviembre 2003 Romina Torres 9

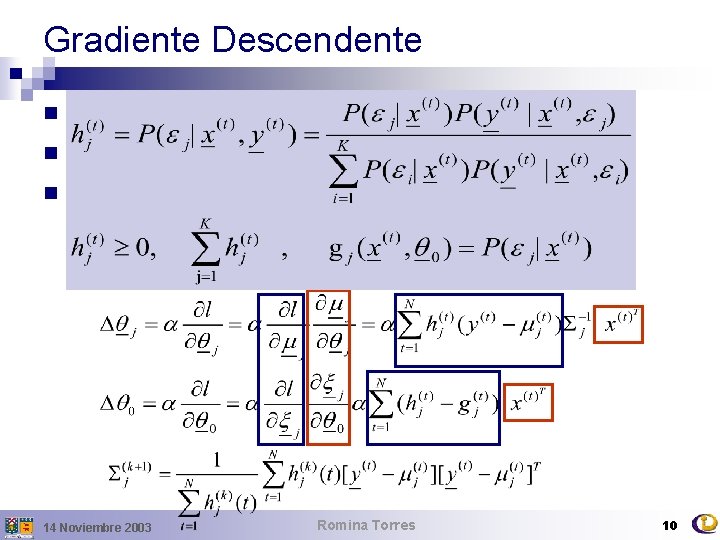

Gradiente Descendente n n n Red de agregación Red Experta Modelo de Probabilidad 14 Noviembre 2003 Romina Torres 10

![Algoritmo de Máxima Expectación (EM) n n n Dempster, Laird, Rubin [DLR] [1976] EM Algoritmo de Máxima Expectación (EM) n n n Dempster, Laird, Rubin [DLR] [1976] EM](http://slidetodoc.com/presentation_image_h/17a1f1bdcfaefa0277896a0ff12ed040/image-11.jpg)

Algoritmo de Máxima Expectación (EM) n n n Dempster, Laird, Rubin [DLR] [1976] EM es un enfoque iterativo para estimar la máxima verosimilitud EM basado en la idea de resolver una sucesión de problemas simplificados que son obtenidos por aumentar las variables observadas originalmente con un conjunto de variables adicionales escondidas o perdidas La incompletitud de los datos puede ser no natural o evidente Cada iteración está compuesta de dos pasos ¨ Paso M que maximiza la función de verosimilitud que es redefinida en cada iteración del paso E 14 Noviembre 2003 Romina Torres 11

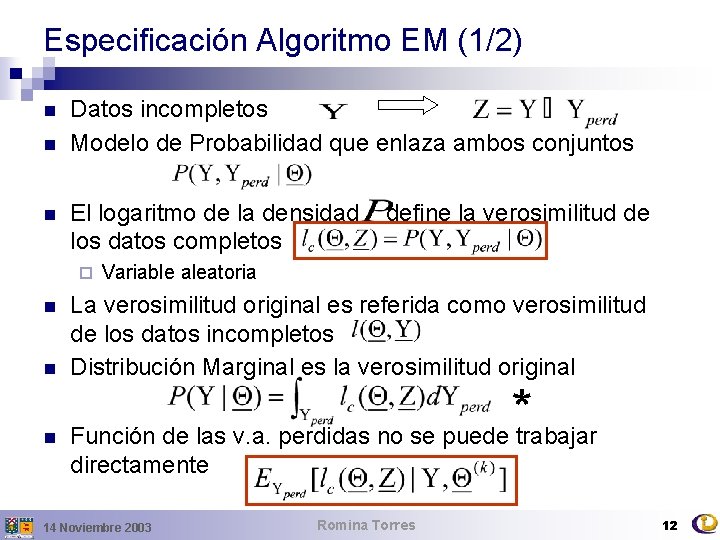

Especificación Algoritmo EM (1/2) n n n Datos incompletos Modelo de Probabilidad que enlaza ambos conjuntos El logaritmo de la densidad los datos completos ¨ n n n define la verosimilitud de Variable aleatoria La verosimilitud original es referida como verosimilitud de los datos incompletos Distribución Marginal es la verosimilitud original * Función de las v. a. perdidas no se puede trabajar directamente 14 Noviembre 2003 Romina Torres 12

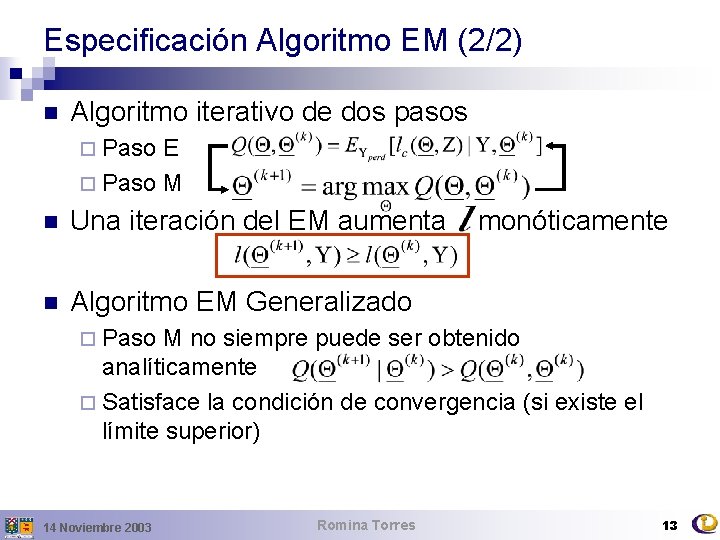

Especificación Algoritmo EM (2/2) n Algoritmo iterativo de dos pasos ¨ Paso E ¨ Paso M n Una iteración del EM aumenta n Algoritmo EM Generalizado monóticamente ¨ Paso M no siempre puede ser obtenido analíticamente ¨ Satisface la condición de convergencia (si existe el límite superior) 14 Noviembre 2003 Romina Torres 13

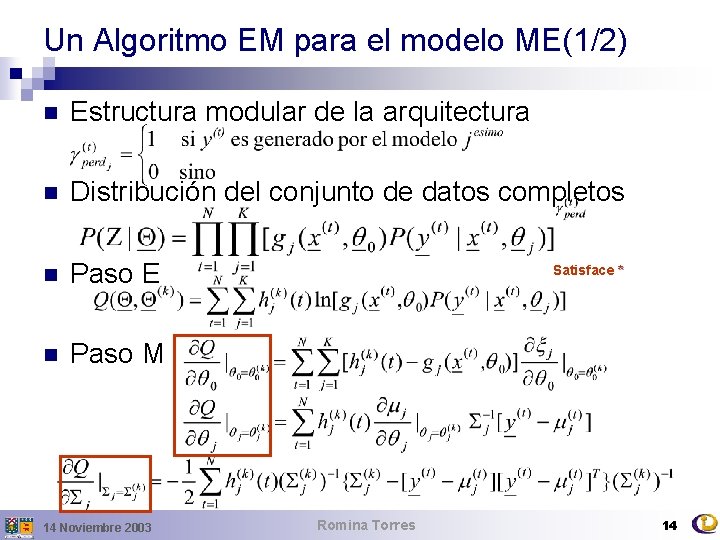

Un Algoritmo EM para el modelo ME(1/2) n Estructura modular de la arquitectura n Distribución del conjunto de datos completos n Paso E n Paso M 14 Noviembre 2003 Satisface * Romina Torres 14

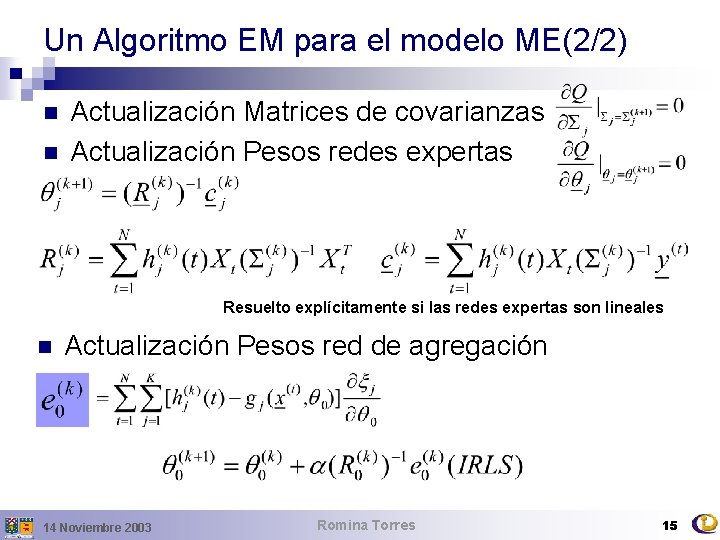

Un Algoritmo EM para el modelo ME(2/2) n n Actualización Matrices de covarianzas Actualización Pesos redes expertas Resuelto explícitamente si las redes expertas son lineales n Actualización Pesos red de agregación 14 Noviembre 2003 Romina Torres 15

![Estimación Robusta de Parámetros n n Teoría de Estimación robusta [Huber, 1964] Modelo ME Estimación Robusta de Parámetros n n Teoría de Estimación robusta [Huber, 1964] Modelo ME](http://slidetodoc.com/presentation_image_h/17a1f1bdcfaefa0277896a0ff12ed040/image-16.jpg)

Estimación Robusta de Parámetros n n Teoría de Estimación robusta [Huber, 1964] Modelo ME sensible a datos atípicos ¨ n n Pequeñas desviaciones no deberían afectar fuertemente los métodos de estimación La robustez ayuda a evaluar y mejorar la estabilidad de las técnicas de estimación cuando los datos se desvían del supuesto distribucional. Hampel argumenta que la ocurrencia de datos atípicos son la regla no la excepción Provocados por una fuente de desviación del modelo subyacente que actúa ocasionalmente pero que tiene gran influencia Se desea evitar el riesgo de rechazar datos necesarios, pero limitando a la vez la influencia de los datos atípicos en la obtención de los estimadores ML. 14 Noviembre 2003 Romina Torres 16

![M-estimadores [Huber 1964] n n M-estimadores son una generalización del MLE Un M-Estimador es M-estimadores [Huber 1964] n n M-estimadores son una generalización del MLE Un M-Estimador es](http://slidetodoc.com/presentation_image_h/17a1f1bdcfaefa0277896a0ff12ed040/image-17.jpg)

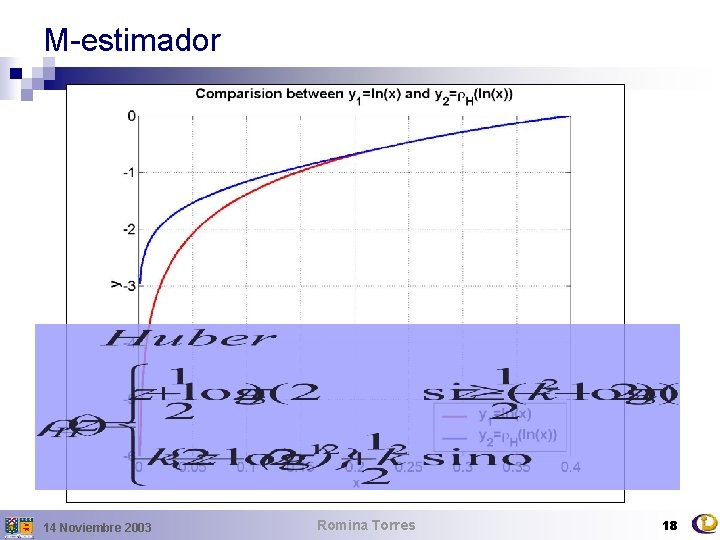

M-estimadores [Huber 1964] n n M-estimadores son una generalización del MLE Un M-Estimador es el estadístico que minimiza la función de costo ¨ n Función real derivable en O la solución de la ecuación de estimación de primer orden 14 Noviembre 2003 Romina Torres 17

M-estimador 14 Noviembre 2003 Romina Torres 18

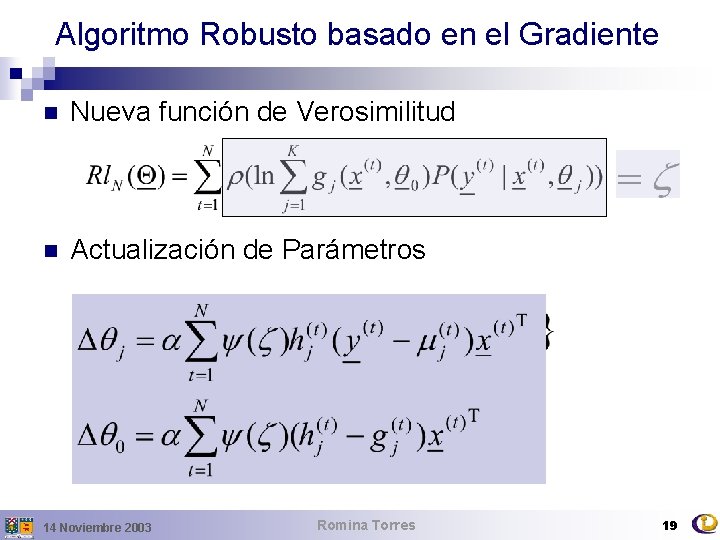

Algoritmo Robusto basado en el Gradiente n Nueva función de Verosimilitud n Actualización de Parámetros 14 Noviembre 2003 Romina Torres 19

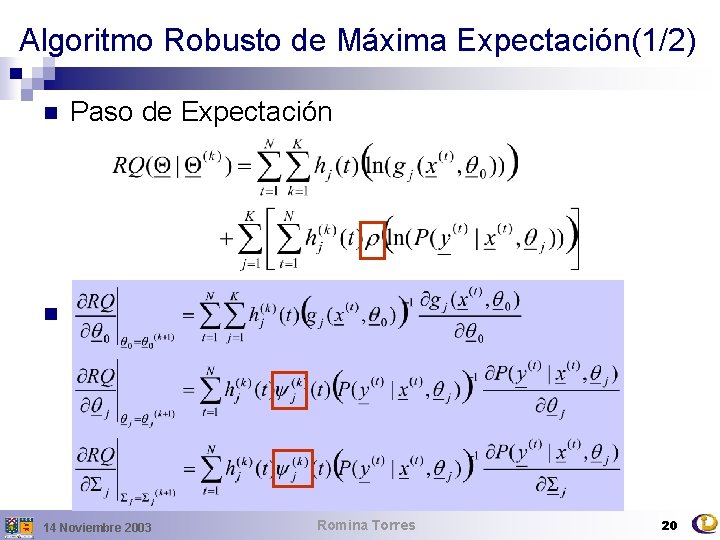

Algoritmo Robusto de Máxima Expectación(1/2) n Paso de Expectación n Paso de Maximización 14 Noviembre 2003 Romina Torres 20

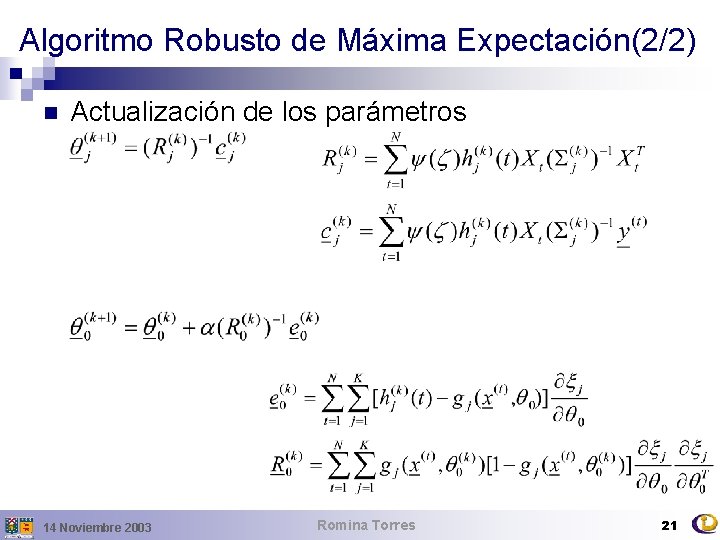

Algoritmo Robusto de Máxima Expectación(2/2) n Actualización de los parámetros 14 Noviembre 2003 Romina Torres 21

Diseño de Experimentos 14 Noviembre 20035 -Nov-03 Romina Torres

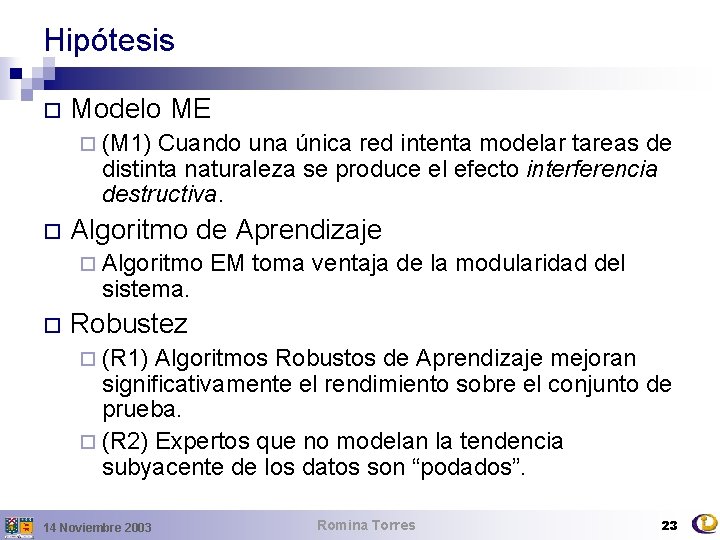

Hipótesis ¨ Modelo ME ¨ (M 1) Cuando una única red intenta modelar tareas de distinta naturaleza se produce el efecto interferencia destructiva. ¨ Algoritmo de Aprendizaje ¨ Algoritmo sistema. ¨ EM toma ventaja de la modularidad del Robustez ¨ (R 1) Algoritmos Robustos de Aprendizaje mejoran significativamente el rendimiento sobre el conjunto de prueba. ¨ (R 2) Expertos que no modelan la tendencia subyacente de los datos son “podados”. 14 Noviembre 2003 Romina Torres 23

Conjuntos de Datos n Boston Original (Boston Housing Data) ¨ N= 506 muestras, 13 entradas, 1 salida. ¨ Valor promedio de una casa en miles de dólares en un vecindario de Boston ¨ Presencia de valores anómalos y datos alejados de la mayoría del conjunto ¨ Ordenamiento por vecindario n Building 2 (PROBEN 1) ¨ Problema de predicción del consumo de energía en un edificio ¨ N= 4208 datos, 6 atributos reales son codificados en 13 entradas para el modelo ¨ 3 Salidas: Energía eléctrica, agua caliente y agua fría. 14 Noviembre 2003 Romina Torres 24

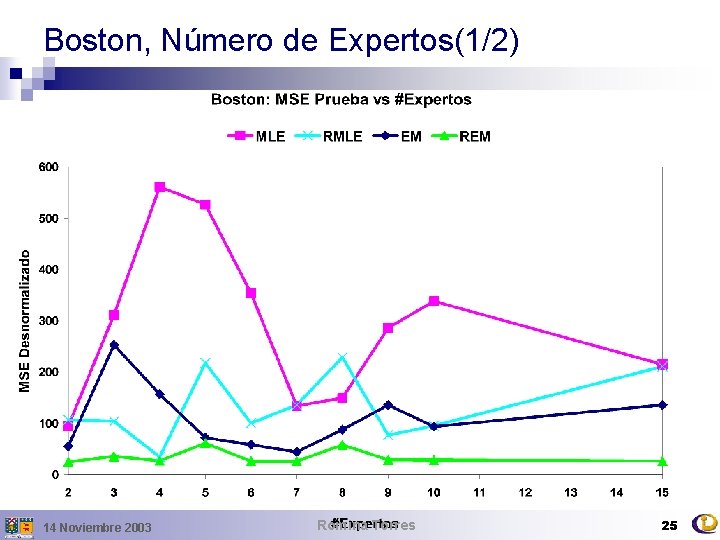

Boston, Número de Expertos(1/2) 14 Noviembre 2003 Romina Torres 25

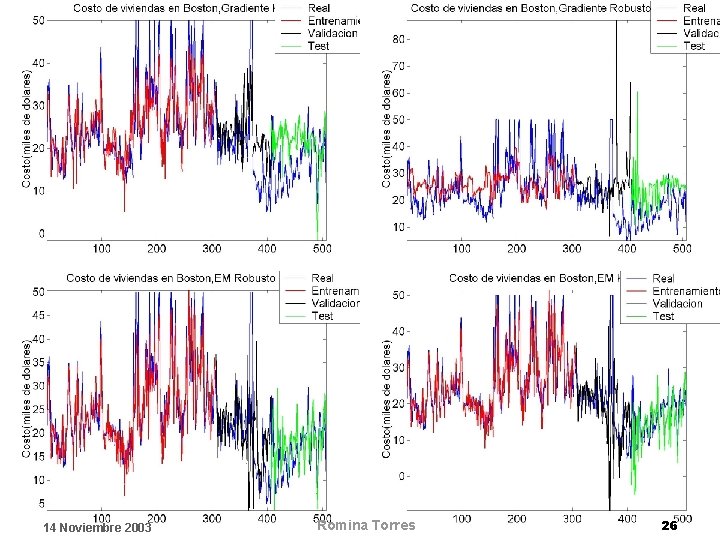

14 Noviembre 2003 Romina Torres 26

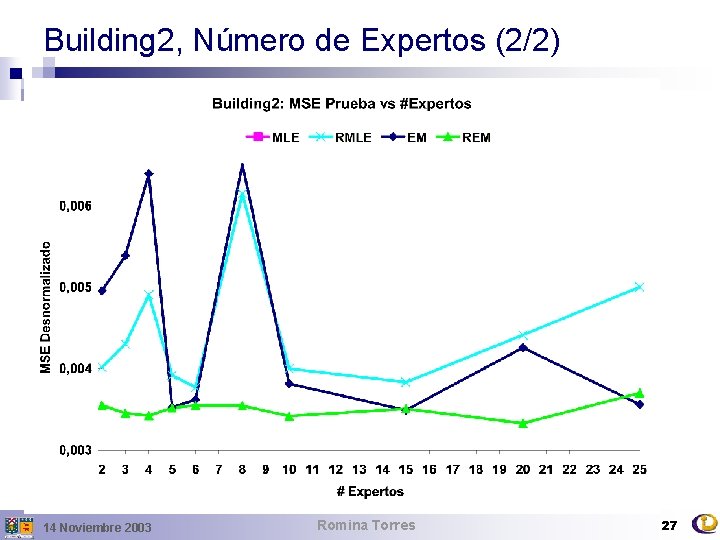

Building 2, Número de Expertos (2/2) 14 Noviembre 2003 Romina Torres 27

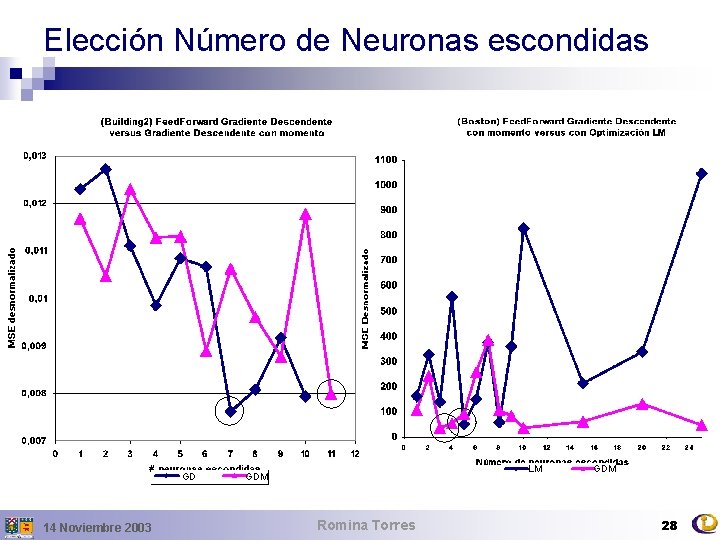

Elección Número de Neuronas escondidas GD 14 Noviembre 2003 LM GDM Romina Torres GDM 28

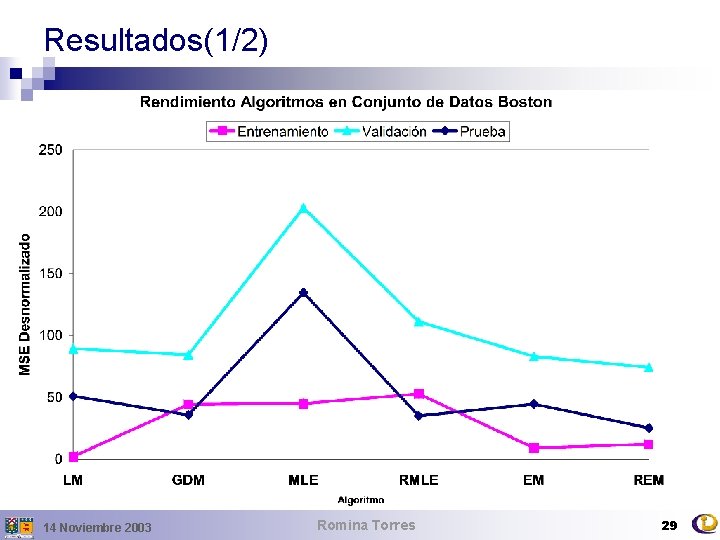

Resultados(1/2) 14 Noviembre 2003 Romina Torres 29

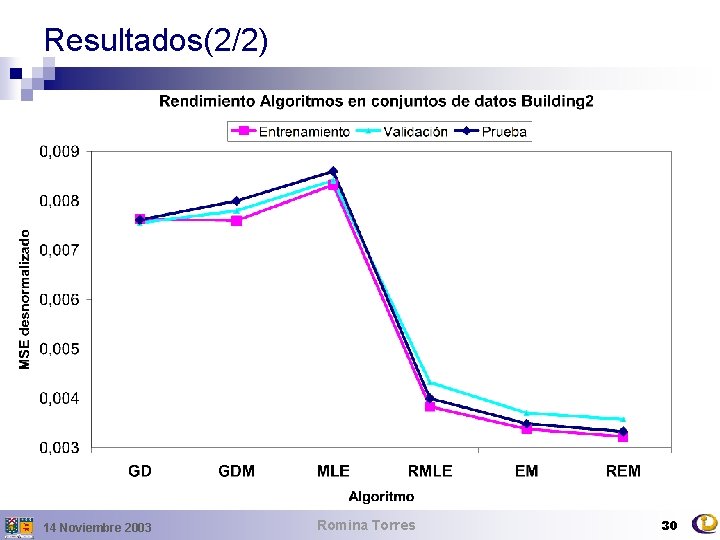

Resultados(2/2) 14 Noviembre 2003 Romina Torres 30

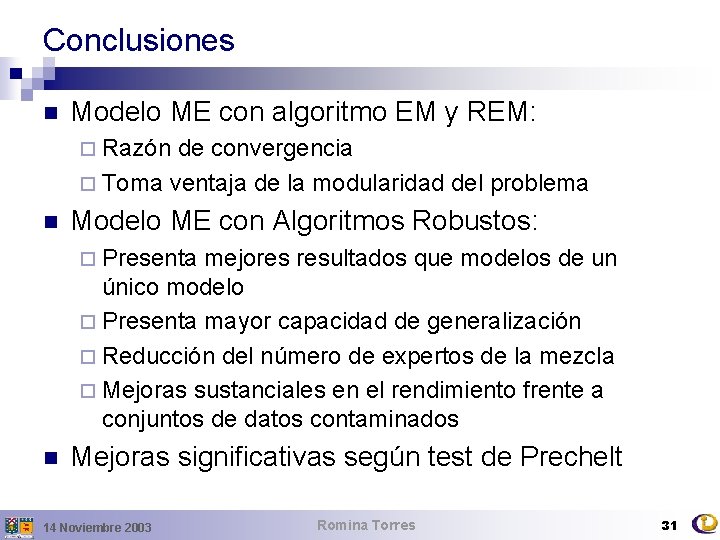

Conclusiones n Modelo ME con algoritmo EM y REM: ¨ Razón de convergencia ¨ Toma ventaja de la modularidad del problema n Modelo ME con Algoritmos Robustos: ¨ Presenta mejores resultados que modelos de un único modelo ¨ Presenta mayor capacidad de generalización ¨ Reducción del número de expertos de la mezcla ¨ Mejoras sustanciales en el rendimiento frente a conjuntos de datos contaminados n Mejoras significativas según test de Prechelt 14 Noviembre 2003 Romina Torres 31

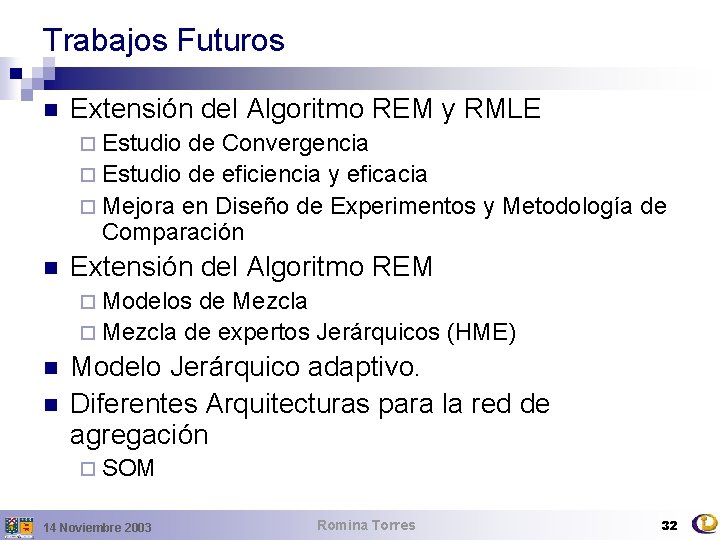

Trabajos Futuros n Extensión del Algoritmo REM y RMLE ¨ Estudio de Convergencia ¨ Estudio de eficiencia y eficacia ¨ Mejora en Diseño de Experimentos y Metodología de Comparación n Extensión del Algoritmo REM ¨ Modelos de Mezcla ¨ Mezcla de expertos Jerárquicos (HME) n n Modelo Jerárquico adaptivo. Diferentes Arquitecturas para la red de agregación ¨ SOM 14 Noviembre 2003 Romina Torres 32

Consultas 14 Noviembre 20035 -Nov-03 Romina Torres

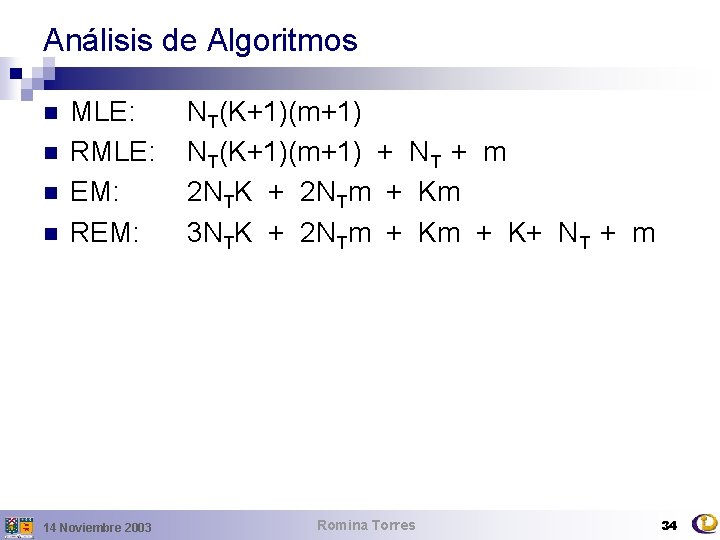

Análisis de Algoritmos n n MLE: RMLE: EM: REM: 14 Noviembre 2003 NT(K+1)(m+1) + NT + m 2 NTK + 2 NTm + Km 3 NTK + 2 NTm + K+ NT + m Romina Torres 34

- Slides: 34