Aktivasyon fonksiyonunu lineer alrsak Bir de girileri normalize

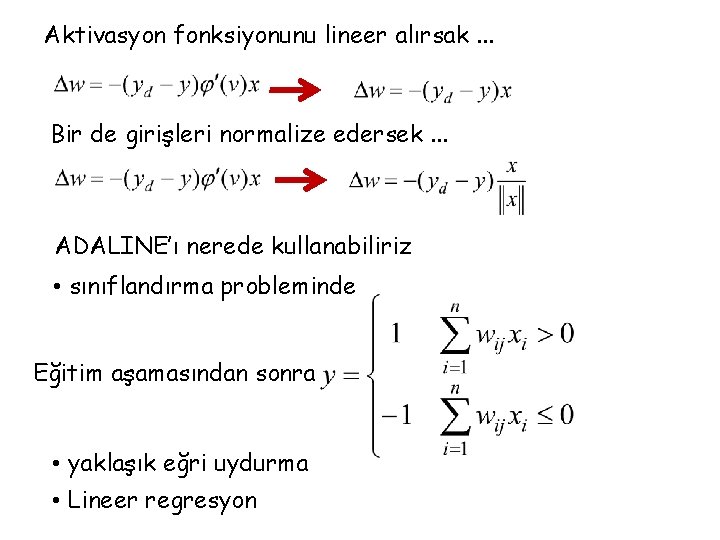

Aktivasyon fonksiyonunu lineer alırsak. . . Bir de girişleri normalize edersek. . . ADALINE’ı nerede kullanabiliriz • sınıflandırma probleminde Eğitim aşamasından sonra • yaklaşık eğri uydurma • Lineer regresyon

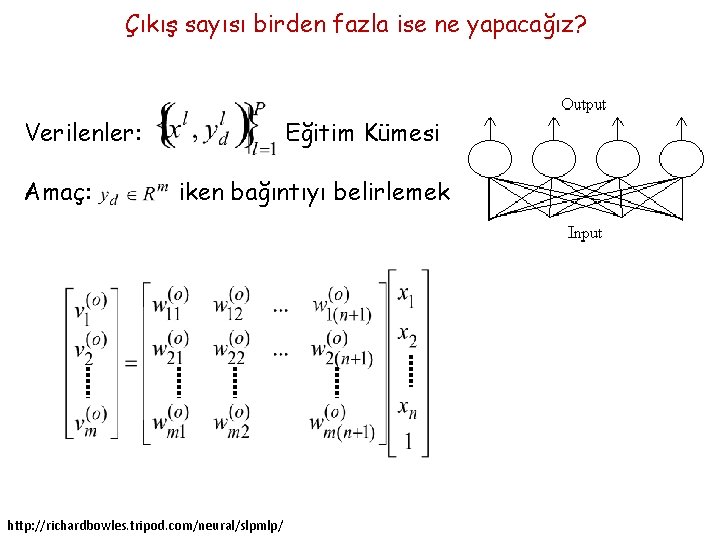

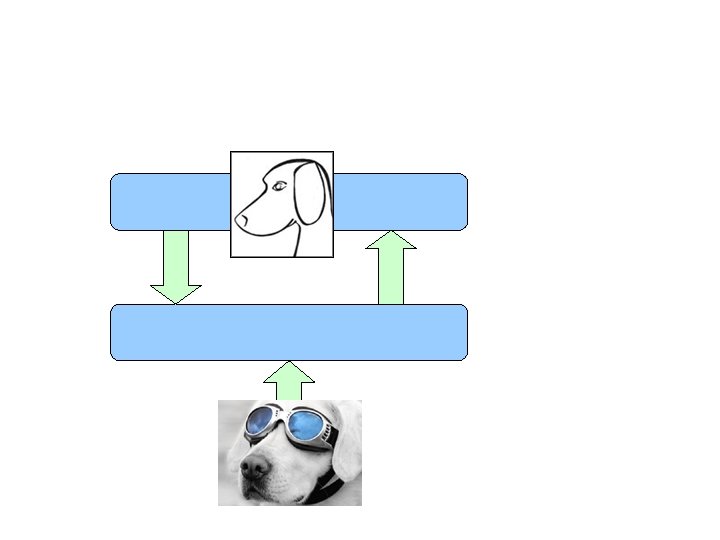

Çıkış sayısı birden fazla ise ne yapacağız? Verilenler: Amaç: Eğitim Kümesi iken bağıntıyı belirlemek http: //richardbowles. tripod. com/neural/slpmlp/

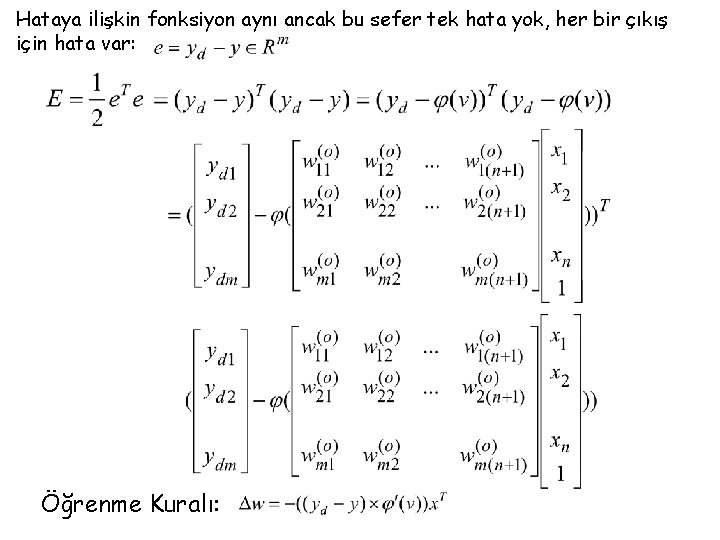

Hataya ilişkin fonksiyon aynı ancak bu sefer tek hata yok, her bir çıkış için hata var: Öğrenme Kuralı:

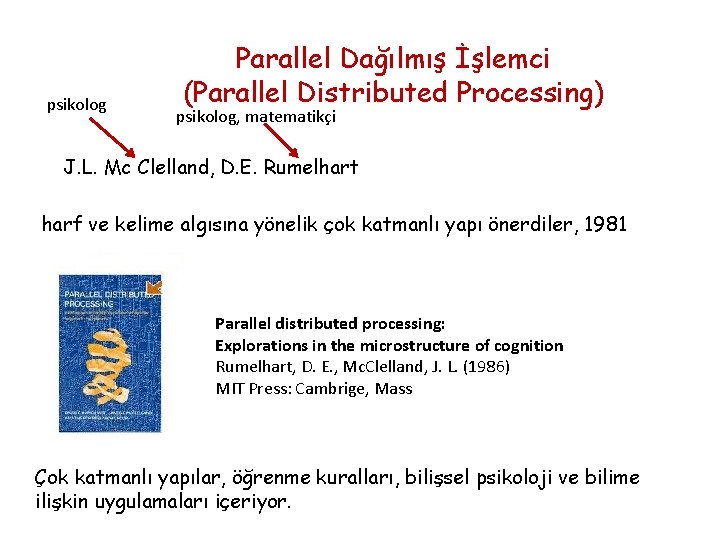

psikolog Parallel Dağılmış İşlemci (Parallel Distributed Processing) psikolog, matematikçi J. L. Mc Clelland, D. E. Rumelhart harf ve kelime algısına yönelik çok katmanlı yapı önerdiler, 1981 Parallel distributed processing: Explorations in the microstructure of cognition Rumelhart, D. E. , Mc. Clelland, J. L. (1986) MIT Press: Cambrige, Mass Çok katmanlı yapılar, öğrenme kuralları, bilişsel psikoloji ve bilime ilişkin uygulamaları içeriyor.

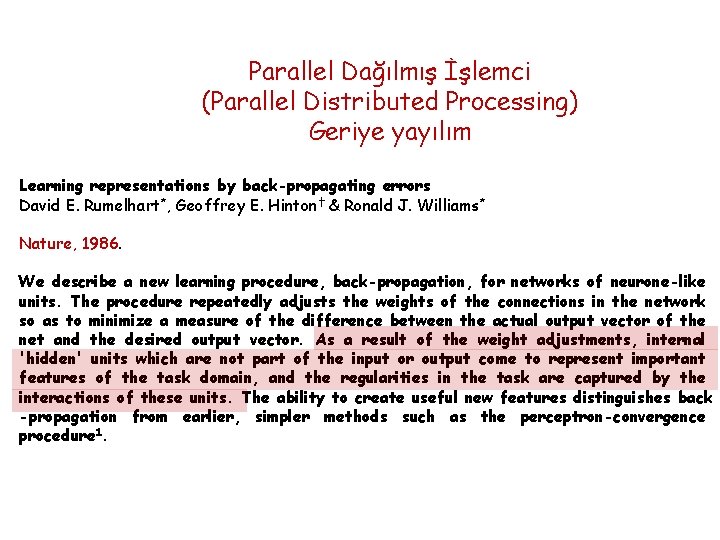

Parallel Dağılmış İşlemci (Parallel Distributed Processing) Geriye yayılım Learning representations by back-propagating errors David E. Rumelhart*, Geoffrey E. Hinton† & Ronald J. Williams* Nature, 1986. We describe a new learning procedure, back-propagation, for networks of neurone-like units. The procedure repeatedly adjusts the weights of the connections in the network so as to minimize a measure of the difference between the actual output vector of the net and the desired output vector. As a result of the weight adjustments, internal 'hidden' units which are not part of the input or output come to represent important features of the task domain, and the regularities in the task are captured by the interactions of these units. The ability to create useful new features distinguishes back -propagation from earlier, simpler methods such as the perceptron-convergence procedure 1.

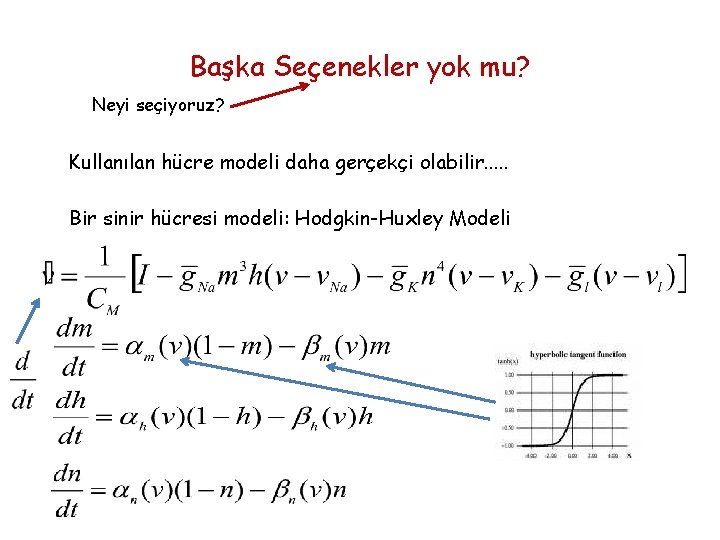

Başka Seçenekler yok mu? Neyi seçiyoruz? Kullanılan hücre modeli daha gerçekçi olabilir. . . Bir sinir hücresi modeli: Hodgkin-Huxley Modeli

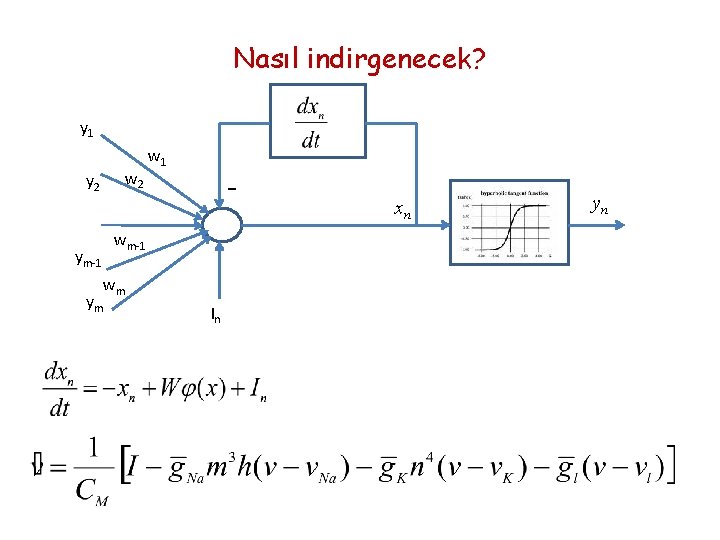

Nasıl indirgenecek? y 1 w 2 y 2 w 1 - wm-1 ym-1 wm ym In xn yn

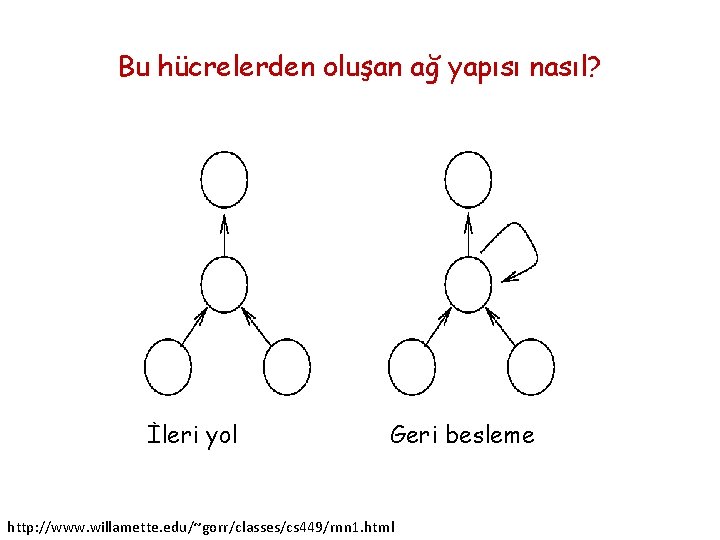

Bu hücrelerden oluşan ağ yapısı nasıl? İleri yol Geri besleme http: //www. willamette. edu/~gorr/classes/cs 449/rnn 1. html

Bu ağ yapılarının genel adı: Yinelemeli ağlar (Recurrent Networks) Dinamik yapılar Çıkışlarda geçmişe ait verilerin de katkısı var Kaotik davranış da dahil çok farklı davranışları modellemek mümkün

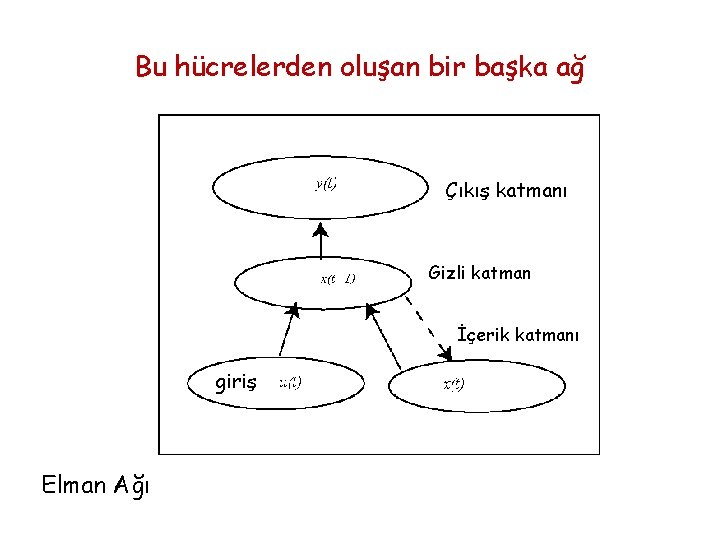

Bu hücrelerden oluşan bir başka ağ Çıkış katmanı Gizli katman İçerik katmanı giriş Elman Ağı

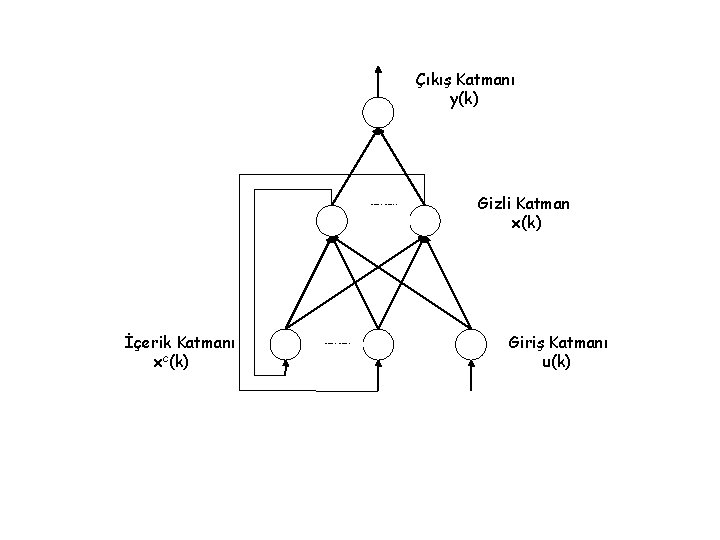

Çıkış Katmanı y(k) …. . İçerik Katmanı xc(k) …. . Gizli Katman x(k) Giriş Katmanı u(k)

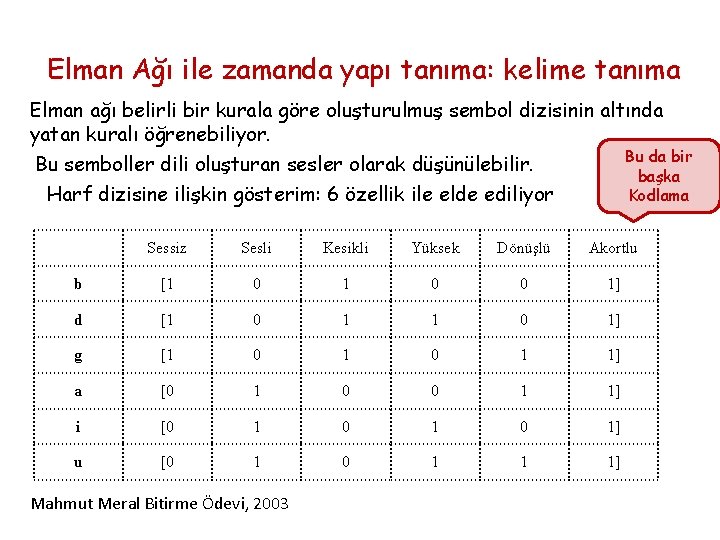

Elman Ağı ile zamanda yapı tanıma: kelime tanıma Elman ağı belirli bir kurala göre oluşturulmuş sembol dizisinin altında yatan kuralı öğrenebiliyor. Bu da bir başka Kodlama Bu semboller dili oluşturan sesler olarak düşünülebilir. Harf dizisine ilişkin gösterim: 6 özellik ile elde ediliyor Sessiz Sesli Kesikli Yüksek Dönüşlü Akortlu b [1 0 0 1] d [1 0 1] g [1 0 1 1] a [0 1 0 0 1 1] i [0 1 0 1] u [0 1 1 1] Mahmut Meral Bitirme Ödevi, 2003

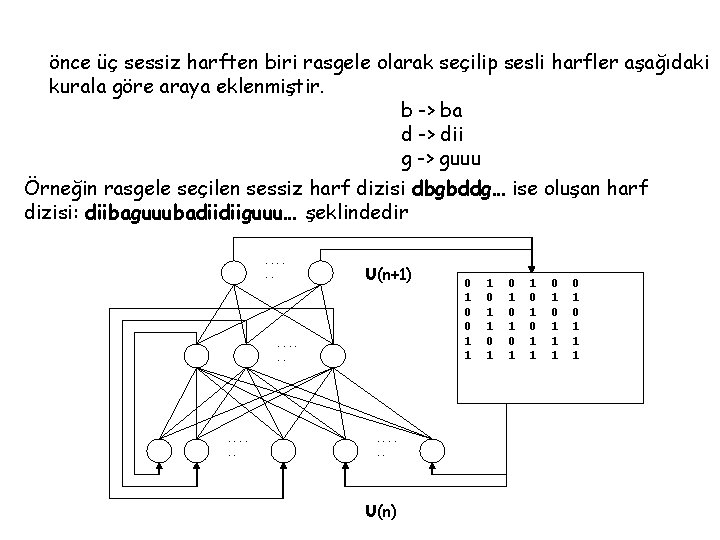

önce üç sessiz harften biri rasgele olarak seçilip sesli harfler aşağıdaki kurala göre araya eklenmiştir. b -> ba d -> dii g -> guuu Örneğin rasgele seçilen sessiz harf dizisi dbgbddg… ise oluşan harf dizisi: diibaguuubadiidiiguuu… şeklindedir. . . U(n+1) . . . . U(n) 0 1 0 0 1 1 1 0 1 0 1 0 1 1 1 0 1 1 1

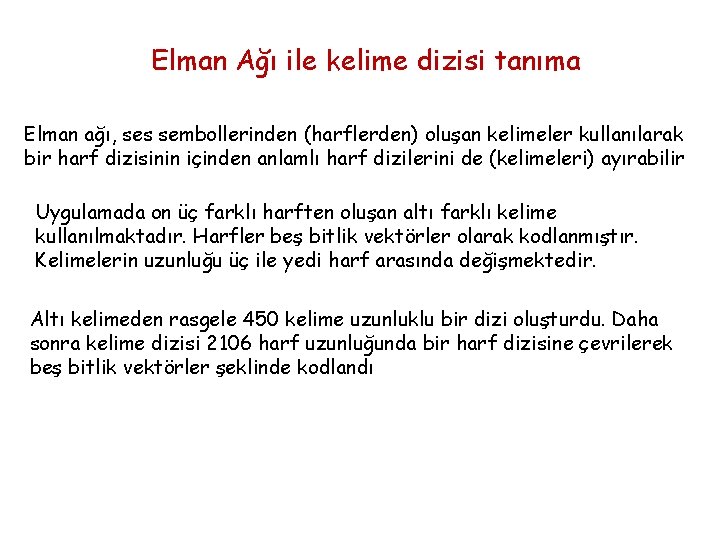

Elman Ağı ile kelime dizisi tanıma Elman ağı, ses sembollerinden (harflerden) oluşan kelimeler kullanılarak bir harf dizisinin içinden anlamlı harf dizilerini de (kelimeleri) ayırabilir Uygulamada on üç farklı harften oluşan altı farklı kelime kullanılmaktadır. Harfler beş bitlik vektörler olarak kodlanmıştır. Kelimelerin uzunluğu üç ile yedi harf arasında değişmektedir. Altı kelimeden rasgele 450 kelime uzunluklu bir dizi oluşturdu. Daha sonra kelime dizisi 2106 harf uzunluğunda bir harf dizisine çevrilerek beş bitlik vektörler şeklinde kodlandı

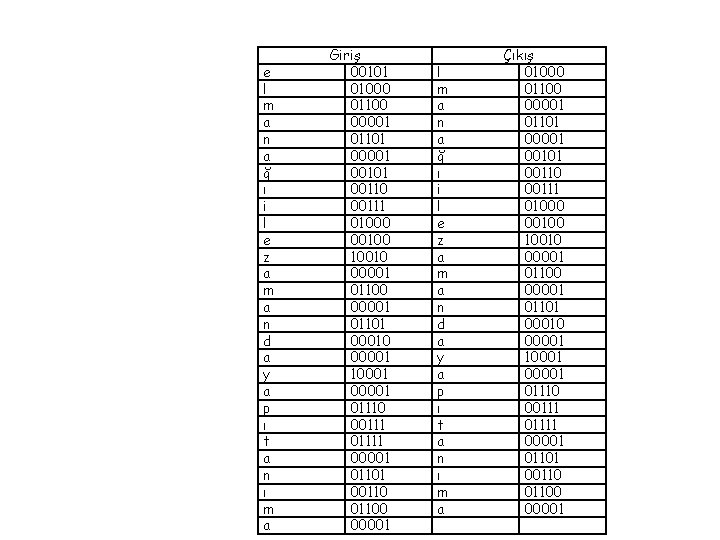

e l m a n a ğ ı i l e z a m a n d a y a p ı t a n ı m a Giriş 00101 01000 01100 00001 01101 00001 00110 00111 01000 00100 10010 00001 01101 00010 00001 10001 01110 001111 00001 01101 001100 00001 l m a n a ğ ı i l e z a m a n d a y a p ı t a n ı m a Çıkış 01000 01100 00001 01101 00001 00110 00111 01000 00100 10010 00001 01101 00010 00001 10001 01110 001111 00001 01101 001100 00001

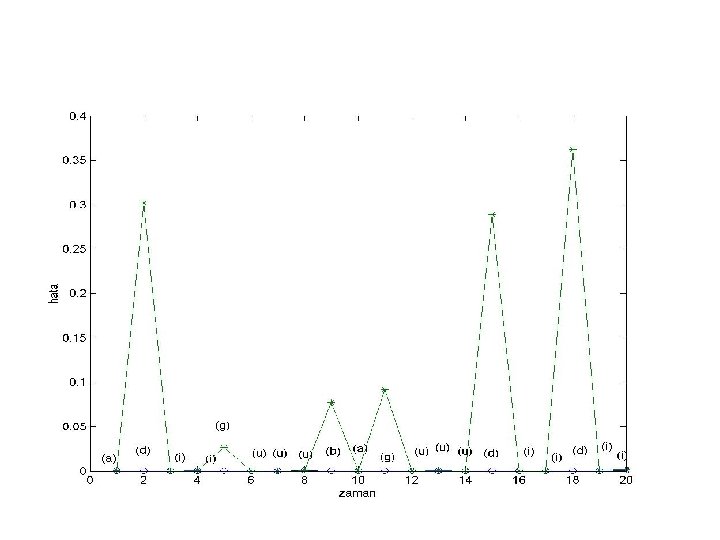

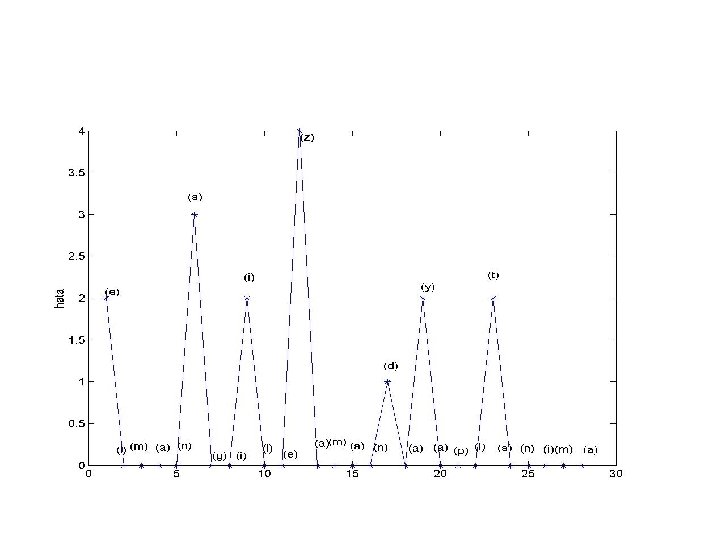

Kelimeler arası sınırlarda iki ve üzerinde hatalı bit oluşmaktadır. Bir nokta hariç ara noktalarda ise hatalı bit yoktur. Sadece “zamanda” kelimesindeki “d” harfinin tahmininde bir hatalı bit oluşmaktadır. Bu durumun sebebi “elman” ve “zamanda” kelimelerinin her ikisinde de “man” dizisinin bulunmasıdır. ”zamanda” kelimesindeki “man” dizisinden sonra “d” gelmesi beklenirken, “elman” kelimesindeki “man” dizisinden sonra altı kelime içinden herhangi birinin ilk harfi (e, a, i, z, y, t) gelebilmektedir. Bu durum eğitimi olumsuz yönde etkileyerek hatanın yeterince azalmasını önlemektedir

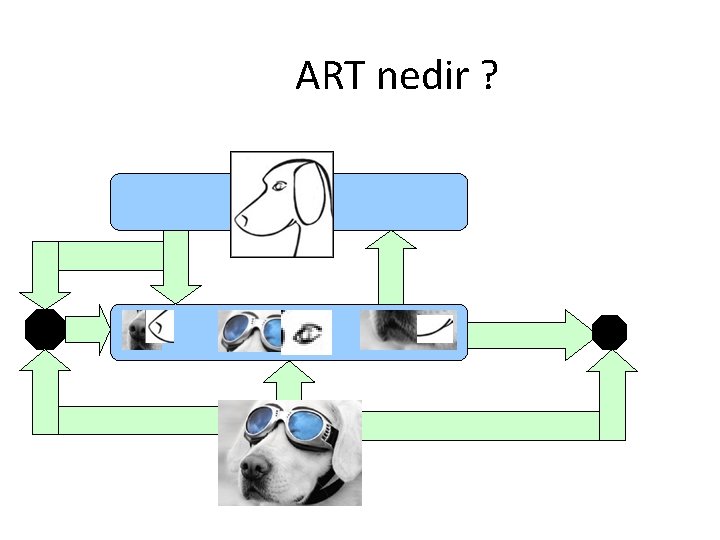

Uyarlanabilir Yankılaşım Teorisi (Adaptive Resonance Theory- Grossberg ) http: //cns. bu. edu/~steve/

A crucial metatheoretical constraint is to insist upon understanding the behavioral data –which comes to us as static numbers or curves on a page – as the emergent properties of a dynamical process which is taking place moment-by-moment in an individual mind. One also needs to respect the fact that our minds can adapt on their own to changing environmental conditions without being told that these conditions have changed. One thus needs to frontally attack the problem of how an intelligent being can autonomously adapt to a changing world. Knowing how to do this, as with many other theoretical endeavors in science, is presently an art form. There are no known algorithms with which to point the way. Whenever we have attempted this task in the past, we have resisted every temptation to use homunculi, or else the crucial constraint on autonomous adaptation would be violated. The result has regularly been the discovery of new organizational principles and mechanisms, which we have then realized as a minimal model operating according to only locally defined laws that are capable of operating on their own in real time. The remarkable fact is that, when such a behaviorallyderived model has been written down, it has always been interpretable as a neural network. These neural networks have always included known brain mechanisms. The functional interpretation of these mechanisms has, however, often been novel because of the light thrown upon them by the behavioral analysis. The networks have also typically predicted the existence of unknown neural mechanisms, and many of these predictions have been supported by subsequent neurophysiological, anatomical, and even biochemical experiments over the years. Stephen Grossberg 20

Grossberg ‘e göre: • Algılama ve Bilişe İlişkin Temel Problem: – İnsanlar içinde bulundukları ortamın değişmez özelliklerini nasıl keşfediyor, öğreniyor ve tanıyor ? – Yaşam boyunca sürekli öğrenmeyi nasıl başarıyoruz ?

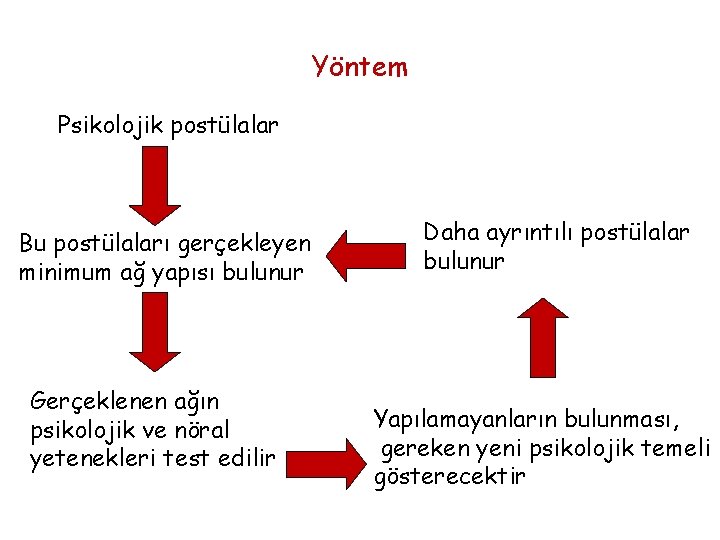

Yöntem Psikolojik postülalar Bu postülaları gerçekleyen minimum ağ yapısı bulunur Gerçeklenen ağın psikolojik ve nöral yetenekleri test edilir Daha ayrıntılı postülalar bulunur Yapılamayanların bulunması, gereken yeni psikolojik temeli gösterecektir

• Adaptif Rezonans Teorisi (ART) – Klasik şartlanma çalışmalarına dayanır – Sağlam matematiksel altyapı – Gerçek zamanda gerçek dünya verileri ile çalışma yeteneği – Temel düşünce birçok olayı açıklamak için genişletilerek yeni yapılar önerilmiştir

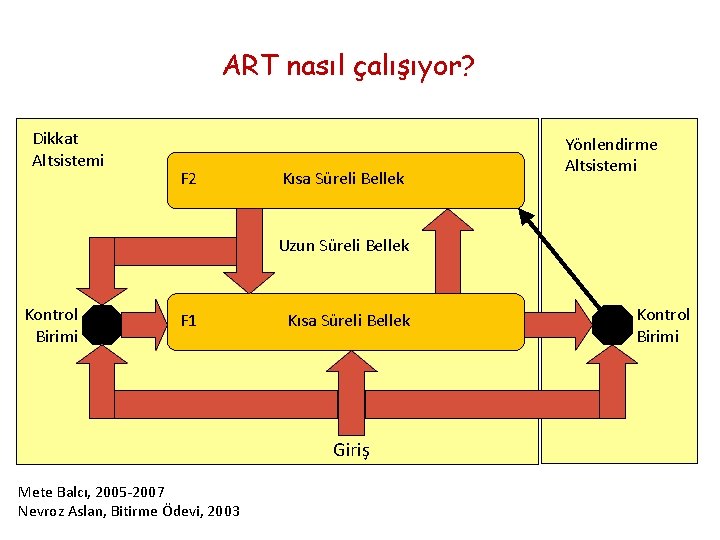

ART nasıl çalışıyor? Dikkat Altsistemi F 2 Kısa Süreli Bellek Yönlendirme Altsistemi Uzun Süreli Bellek Kontrol Birimi F 1 Kısa Süreli Bellek Giriş Mete Balcı, 2005 -2007 Nevroz Aslan, Bitirme Ödevi, 2003 Kontrol Birimi

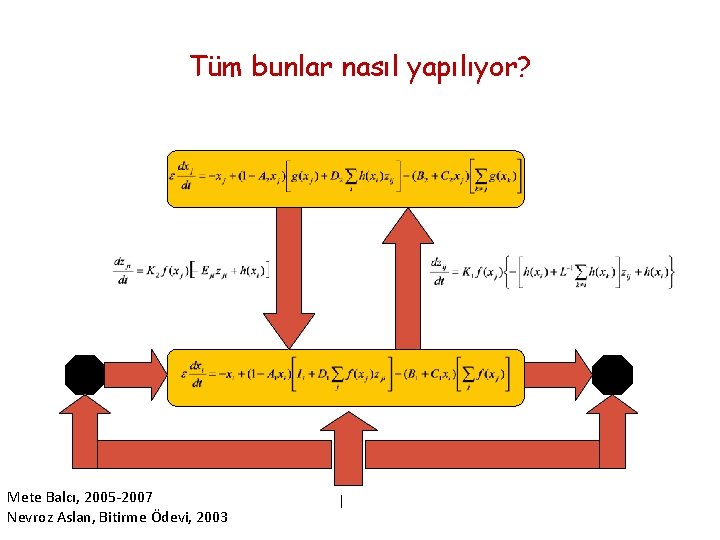

Tüm bunlar nasıl yapılıyor? Mete Balcı, 2005 -2007 Nevroz Aslan, Bitirme Ödevi, 2003 I

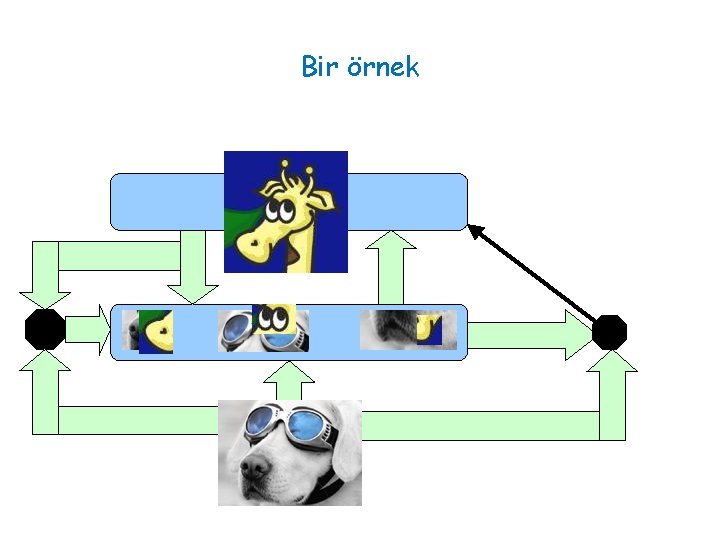

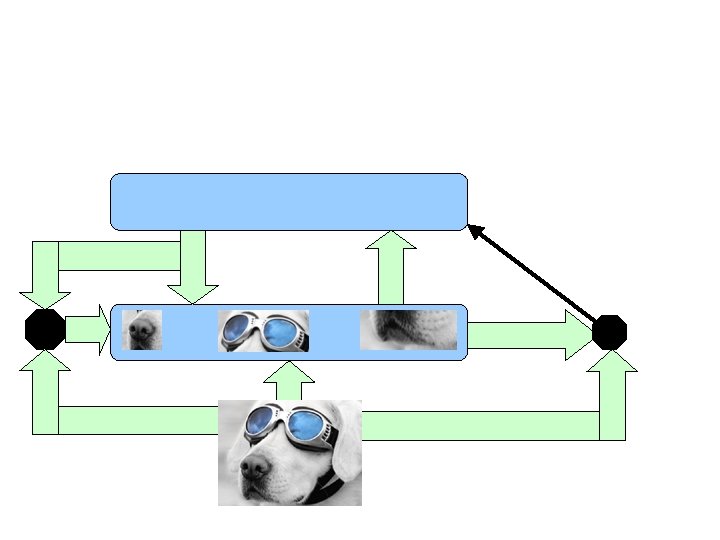

Bir örnek

ART nedir ?

• Bilişsel Bilim – Neokorteks Hippokampüs – LGN (Lateral Geniculate Nucleus) Görsel Korteks • Mühendislik – Örüntü Sınıflandırma

- Slides: 30