Adaptive Modellierung und Simulation Kapitel 2 BlackBox Modellierung

Adaptive Modellierung und Simulation Kapitel 2: Black-Box. Modellierung Rüdiger Brause

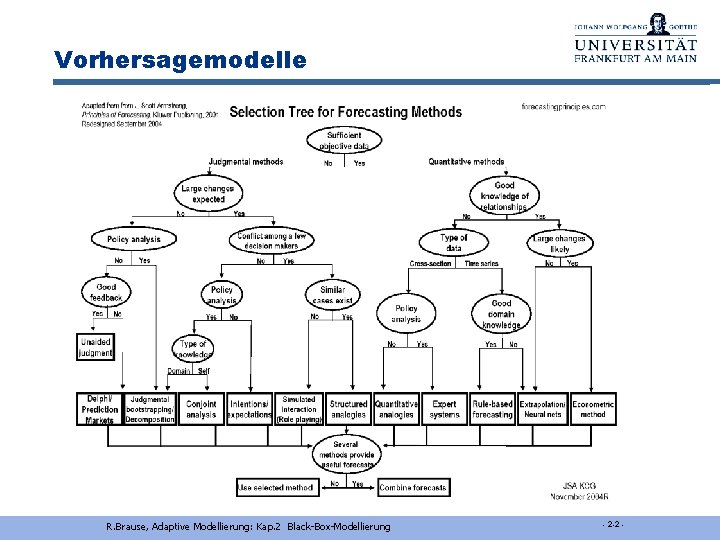

Vorhersagemodelle R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -2 -

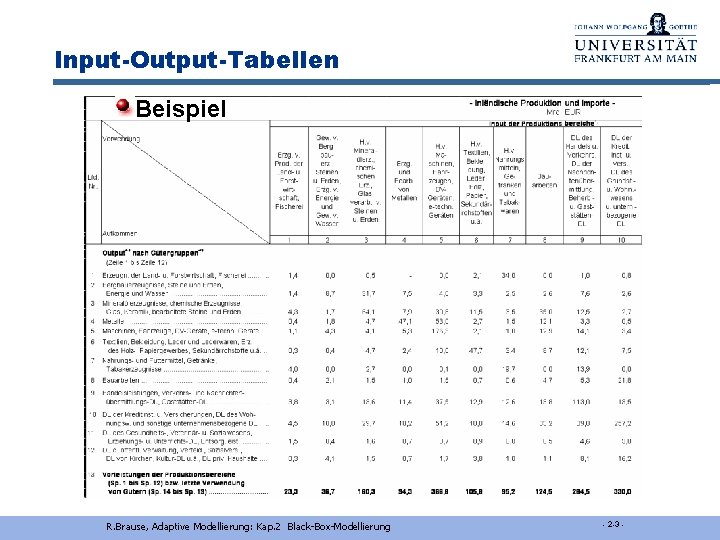

Input-Output-Tabellen Beispiel R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -3 -

Black-Box- Modellierung Lineare Modellierung Nichtlin. Modellierung: MLP Nichtlin. Modellierung: RBF Eigenschaften von NN R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -4 -

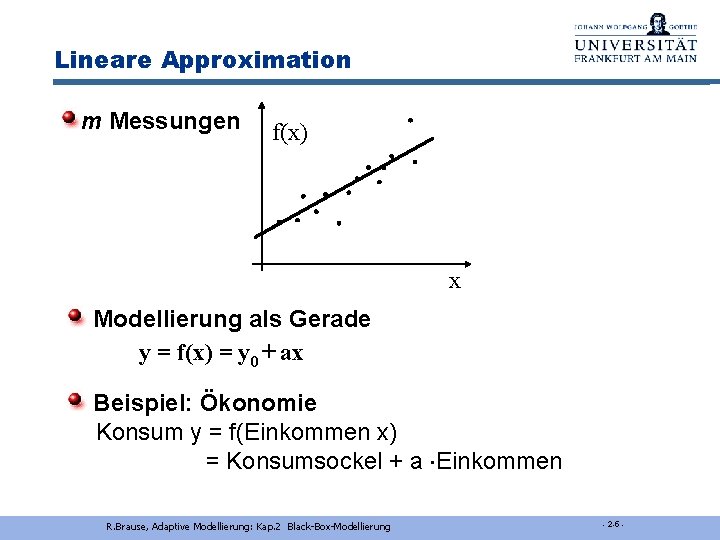

Lineare Approximation m Messungen f(x) x Modellierung als Gerade y = f(x) = y 0 + ax Beispiel: Ökonomie Konsum y = f(Einkommen x) = Konsumsockel + a Einkommen R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -5 -

Lineare Approximation - rauschfrei Parameterbestimmung 2 Messwerte y 1(x), y 2 (x) reichen aus für a, y 0 RECHNUNG x, y, y 0 sind n-dim Vektoren, a eine n n-Matrix m = n 2+n Parameter m Datenpunkte bei n Variablen nötig R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -6 -

Lineare Approximation - verrauscht Modellierung als verrauschte Gerade yt = y 0 + axt + ut Parameterbestimmung Rechnung aus Varianz und Kovarianz Parameterbestimmung Rechnung mittels Gauß-Methode R(a) = (yt – f(a))2 t R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -7 -

Lineare Approximation - verrauscht Mehrere Variable Multiple Regression y(t) = f(x 1, x 2, …, xk) = a 0 + a 1 x 1 + a 2 x 2 + … + akxk + u Zusammenfassung zu yt = (1, x 1(t), …, xk(t) ) (a 0, a 1, …, ak)T + ut = xa. T + ut. y = (y 1, …, y. T)T = Xa. T + u T Zeilen für T Messungen, rang(X) = k+1 Parameterbestimmung R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung Rechnung - 2 -8 -

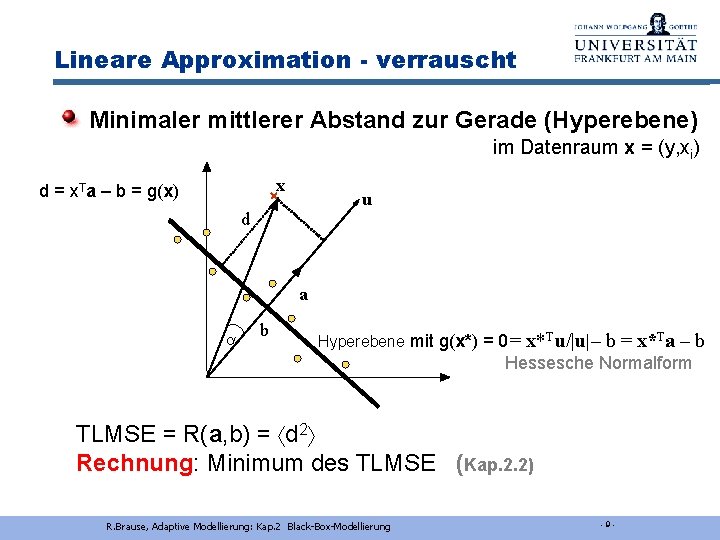

Lineare Approximation - verrauscht Minimaler mittlerer Abstand zur Gerade (Hyperebene) im Datenraum x = (y, xi) x d = x. Ta – b = g(x) u d a b Hyperebene mit g(x*) = 0 = x*Tu/|u|– b = x*Ta – b Hessesche Normalform TLMSE = R(a, b) = d 2 Rechnung: Minimum des TLMSE (Kap. 2. 2) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung -9 -

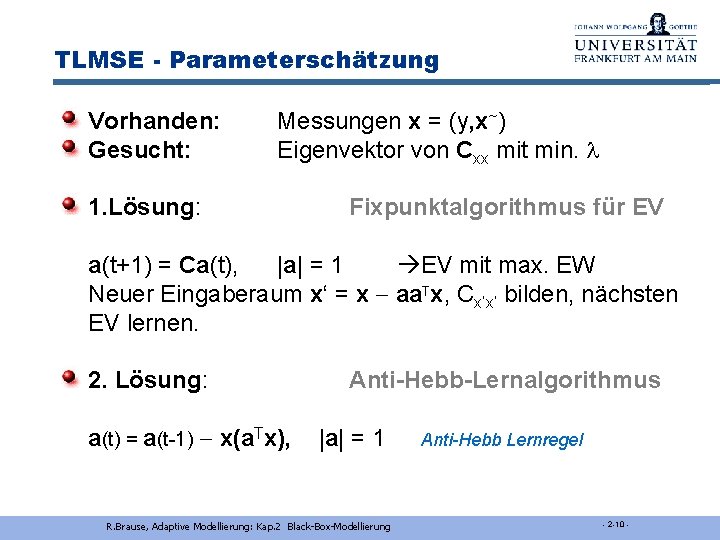

TLMSE - Parameterschätzung Vorhanden: Gesucht: Messungen x = (y, x~) Eigenvektor von Cxx mit min. l 1. Lösung: Fixpunktalgorithmus für EV a(t+1) = Ca(t), |a| = 1 EV mit max. EW Neuer Eingaberaum x‘ = x aa. Tx, Cx‘x‘ bilden, nächsten EV lernen. 2. Lösung: a(t) = a(t-1) x(a. Tx), Anti-Hebb-Lernalgorithmus |a| = 1 R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung Anti-Hebb Lernregel - 2 -10 -

Lineare Approximation - Grenzen des linearen Modells § linearer Zusammenhang der Daten ? Linearisieren! § Parameter sind konstant (oder zeitabhängig? ) § Einflüsse von x 1, x 2, . . . sind nur eingebildet ? R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -11 -

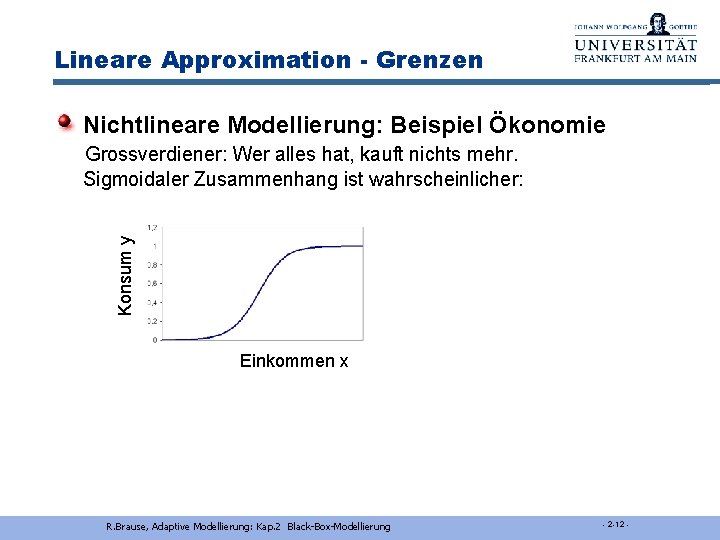

Lineare Approximation - Grenzen Nichtlineare Modellierung: Beispiel Ökonomie Konsum y Grossverdiener: Wer alles hat, kauft nichts mehr. Sigmoidaler Zusammenhang ist wahrscheinlicher: Einkommen x R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -12 -

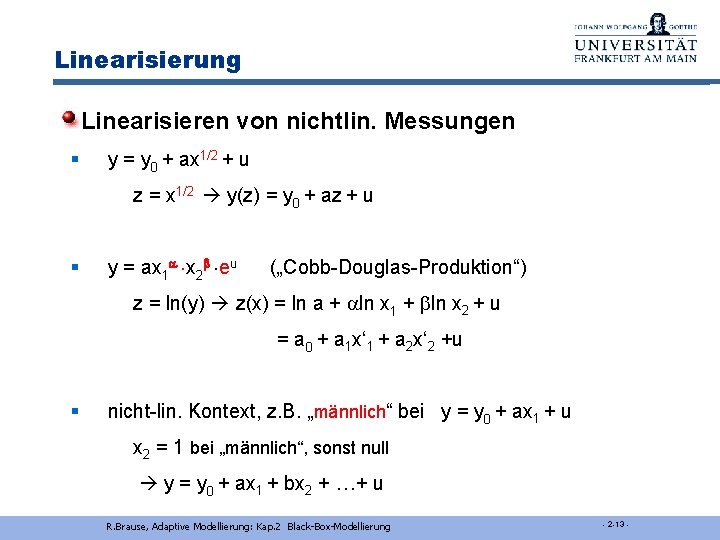

Linearisierung Linearisieren von nichtlin. Messungen § y = y 0 + ax 1/2 + u z = x 1/2 y(z) = y 0 + az + u § y = ax 1 a x 2 b eu („Cobb-Douglas-Produktion“) z = ln(y) z(x) = ln a + ln x 1 + bln x 2 + u = a 0 + a 1 x‘ 1 + a 2 x‘ 2 +u § nicht-lin. Kontext, z. B. „männlich“ bei y = y 0 + ax 1 + u x 2 = 1 bei „männlich“, sonst null y = y 0 + ax 1 + bx 2 + …+ u R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -13 -

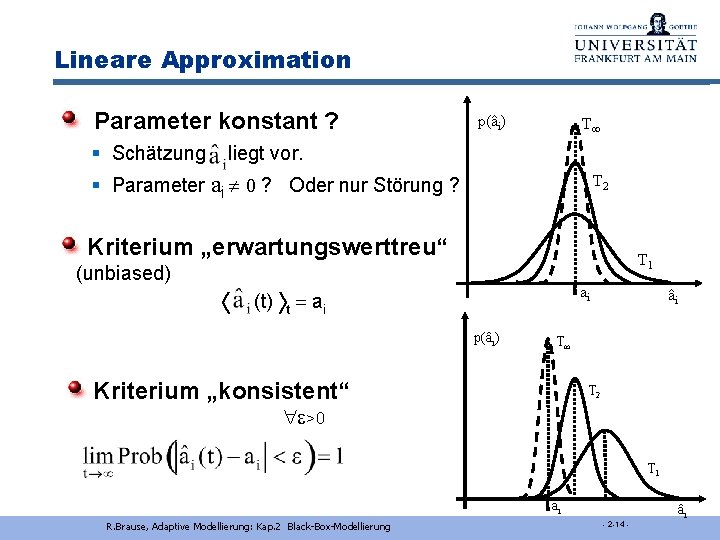

Lineare Approximation Parameter konstant ? § Schätzung p(âi) T liegt vor. § Parameter ai 0 ? Oder nur Störung ? T 2 Kriterium „erwartungswerttreu“ T 1 (unbiased) (t) t = ai ai p(âi) T Kriterium „konsistent“ âi T 2 e>0 T 1 ai R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung âi - 2 -14 -

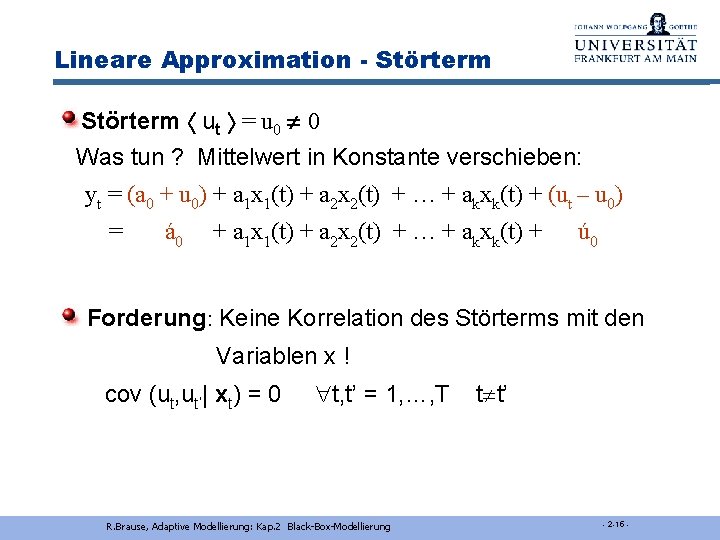

Lineare Approximation - Störterm ut = u 0 0 Was tun ? Mittelwert in Konstante verschieben: yt = (a 0 + u 0) + a 1 x 1(t) + a 2 x 2(t) + … + akxk(t) + (ut – u 0) = á 0 + a 1 x 1(t) + a 2 x 2(t) + … + akxk(t) + ú 0 Forderung: Keine Korrelation des Störterms mit den Variablen x ! cov (ut, ut’| xt) = 0 t, t’ = 1, …, T R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung t t’ - 2 -15 -

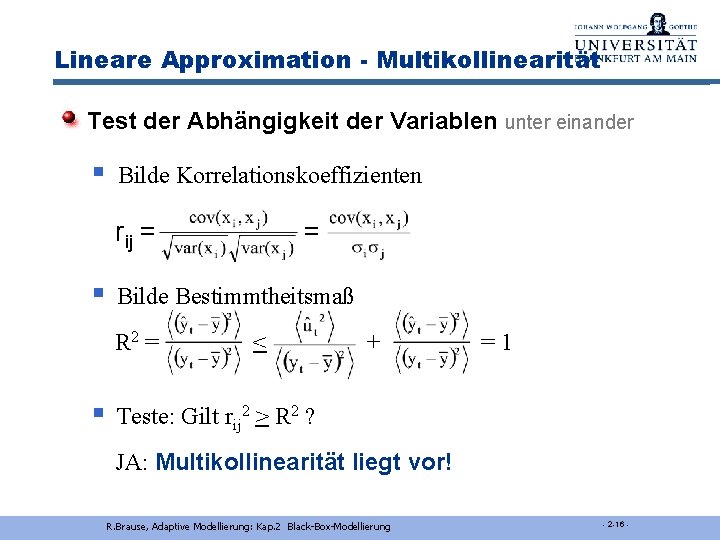

Lineare Approximation - Multikollinearität Test der Abhängigkeit der Variablen unter einander § Bilde Korrelationskoeffizienten rij = § Bilde Bestimmtheitsmaß R 2 = § = < + = 1 Teste: Gilt rij 2 > R 2 ? JA: Multikollinearität liegt vor! R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -16 -

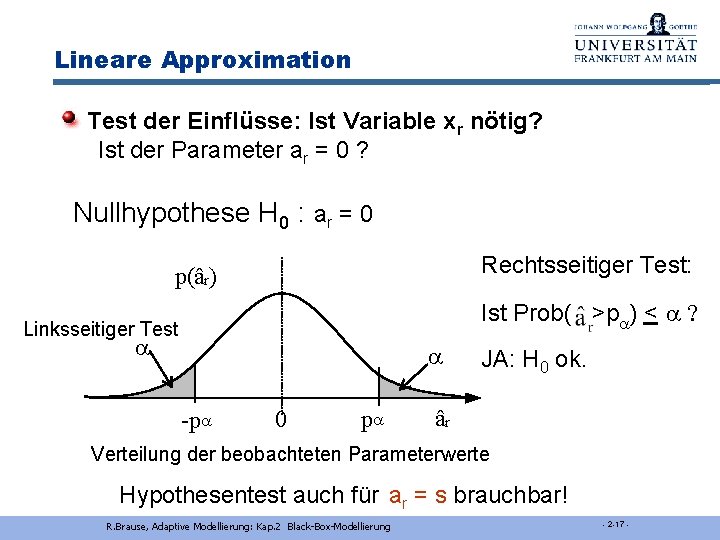

Lineare Approximation Test der Einflüsse: Ist Variable xr nötig? Ist der Parameter ar = 0 ? Nullhypothese H 0 : ar = 0 Rechtsseitiger Test: p(âr) Ist Prob( >p ) < ? Linksseitiger Test -p 0 p JA: H 0 ok. âr Verteilung der beobachteten Parameterwerte Hypothesentest auch für ar = s brauchbar! R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -17 -

Black-Box- Modellierung Lineare Modellierung Nichtlin. Modellierung: MLP Nichtlin. Modellierung: RBF Eigenschaften von NN R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -18 -

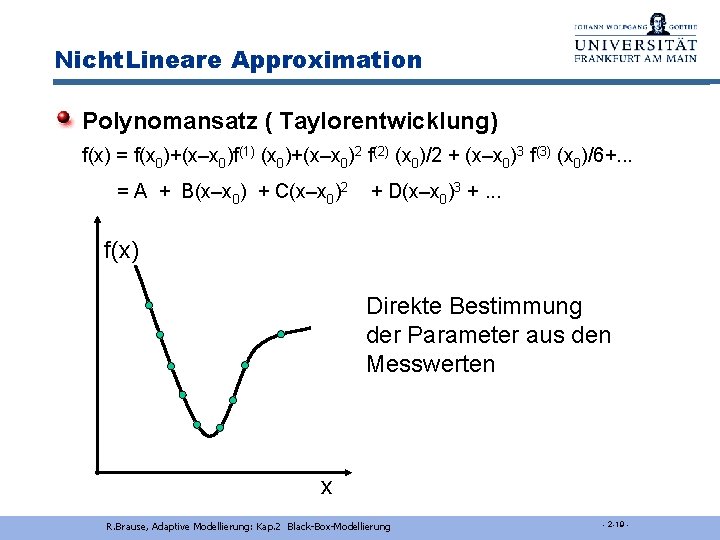

Nicht. Lineare Approximation Polynomansatz ( Taylorentwicklung) f(x) = f(x 0)+(x–x 0)f(1) (x 0)+(x–x 0)2 f(2) (x 0)/2 + (x–x 0)3 f(3) (x 0)/6+. . . = A + B(x–x 0) + C(x–x 0)2 + D(x–x 0)3 +. . . f(x) Direkte Bestimmung der Parameter aus den Messwerten x R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -19 -

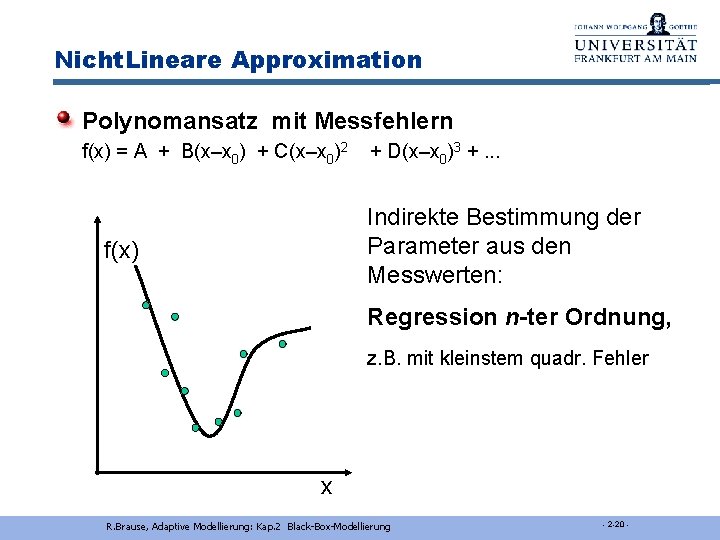

Nicht. Lineare Approximation Polynomansatz mit Messfehlern f(x) = A + B(x–x 0) + C(x–x 0)2 + D(x–x 0)3 +. . . Indirekte Bestimmung der Parameter aus den Messwerten: f(x) Regression n-ter Ordnung, z. B. mit kleinstem quadr. Fehler x R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -20 -

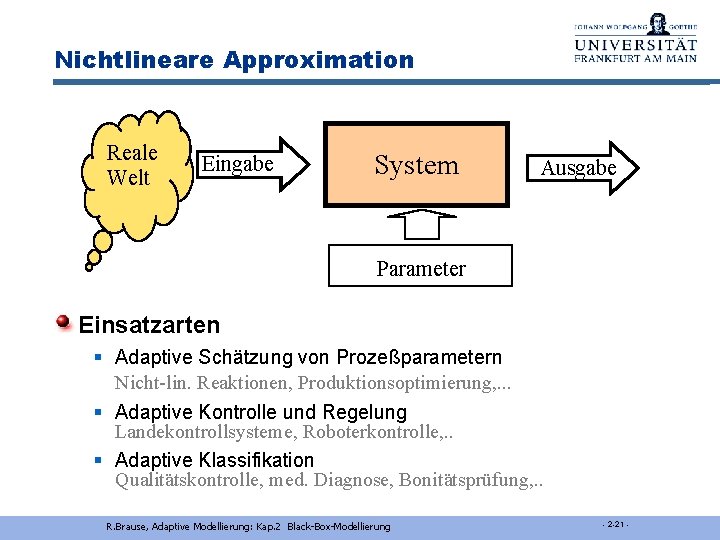

Nichtlineare Approximation Reale Welt Eingabe System Ausgabe Parameter Einsatzarten § Adaptive Schätzung von Prozeßparametern Nicht-lin. Reaktionen, Produktionsoptimierung, . . . § Adaptive Kontrolle und Regelung Landekontrollsysteme, Roboterkontrolle, . . § Adaptive Klassifikation Qualitätskontrolle, med. Diagnose, Bonitätsprüfung, . . R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -21 -

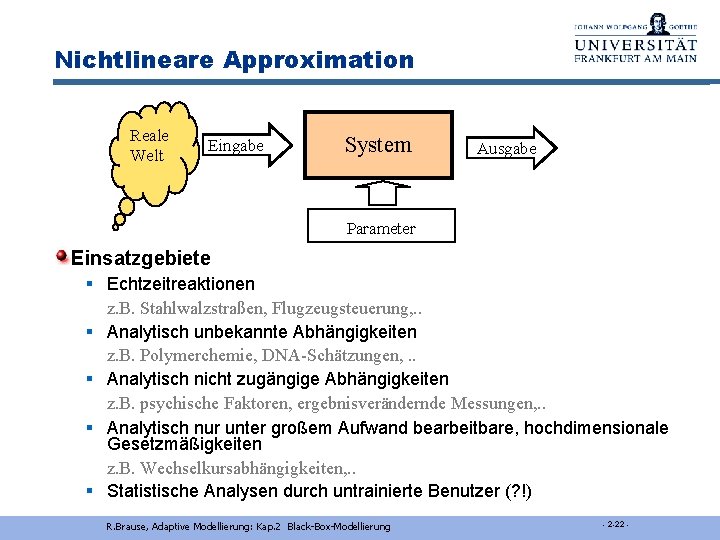

Nichtlineare Approximation Reale Welt Eingabe System Ausgabe Parameter Einsatzgebiete § Echtzeitreaktionen z. B. Stahlwalzstraßen, Flugzeugsteuerung, . . § Analytisch unbekannte Abhängigkeiten z. B. Polymerchemie, DNA-Schätzungen, . . § Analytisch nicht zugängige Abhängigkeiten z. B. psychische Faktoren, ergebnisverändernde Messungen, . . § Analytisch nur unter großem Aufwand bearbeitbare, hochdimensionale Gesetzmäßigkeiten z. B. Wechselkursabhängigkeiten, . . § Statistische Analysen durch untrainierte Benutzer (? !) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -22 -

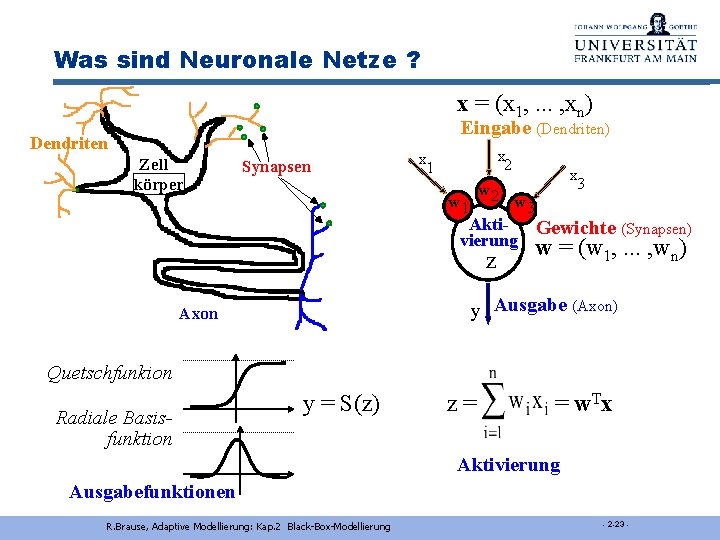

Was sind Neuronale Netze ? x = (x 1, . . . , xn) Eingabe (Dendriten) Dendriten Zell körper Synapsen x 2 x 1 w 2 w 1 x 3 w 3 Akti- Gewichte (Synapsen) vierung w = (w , . . . , w ) 1 z y Ausgabe (Axon) Axon Quetschfunkion Radiale Basisfunktion y = S(z) z = = w. Tx Aktivierung Ausgabefunktionen R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -23 - n

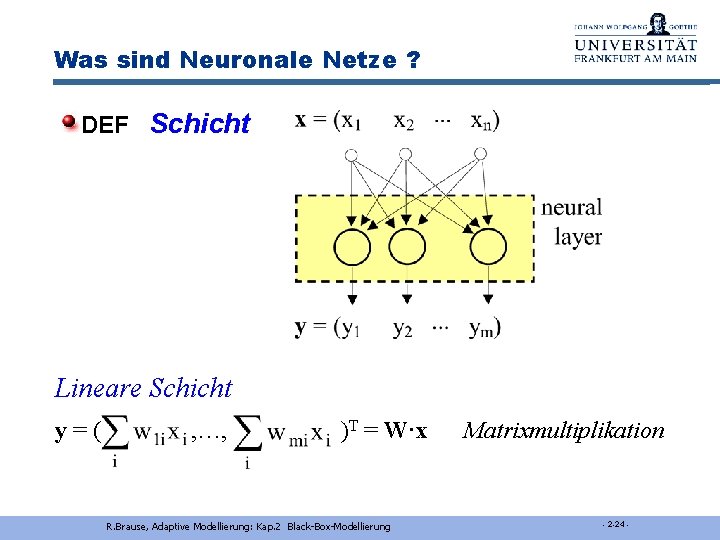

Was sind Neuronale Netze ? DEF Schicht Lineare Schicht y = ( , …, )T = W·x R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung Matrixmultiplikation - 2 -24 -

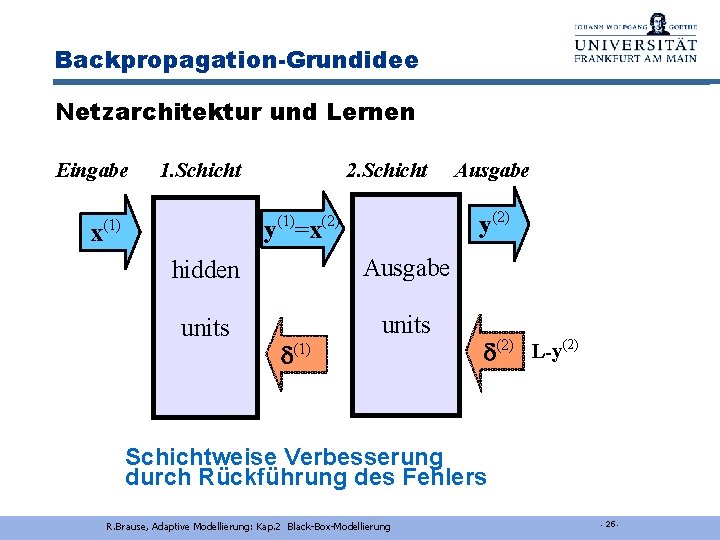

Backpropagation-Grundidee Netzarchitektur und Lernen Eingabe (1) x 1. Schicht hidden units 2. Schicht (1) Ausgabe (2) y =x Ausgabe units (1) y(2) L-y(2) Schichtweise Verbesserung durch Rückführung des Fehlers R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 25 -

Anwendung - Net. Talk Sejnowsky-Rosenberg 1986 Automatisches System Text -> Sprache Vorläufer: DECtalk, 20 Mann-Jahre, 95% Genauigkeit Net. Talk: 15 CPU-Stunden, 98% Genauigkeit Eingabe: Texte R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -26 -

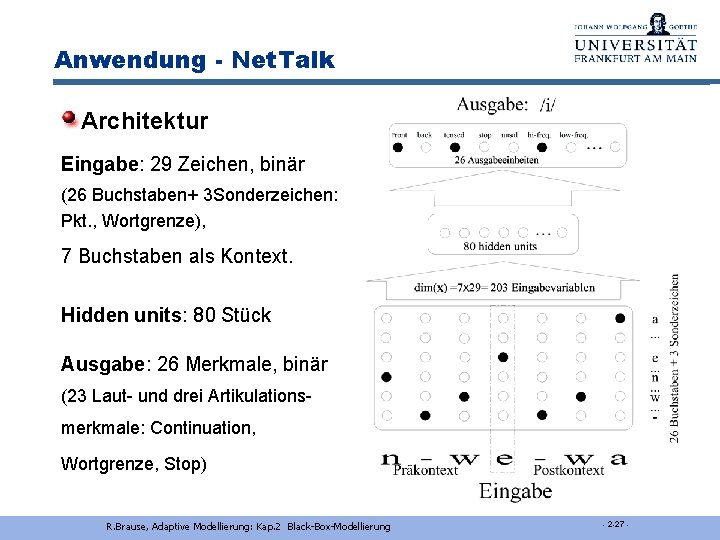

Anwendung - Net. Talk Architektur Eingabe: 29 Zeichen, binär (26 Buchstaben+ 3 Sonderzeichen: Pkt. , Wortgrenze), 7 Buchstaben als Kontext. Hidden units: 80 Stück Ausgabe: 26 Merkmale, binär (23 Laut- und drei Artikulationsmerkmale: Continuation, Wortgrenze, Stop) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -27 -

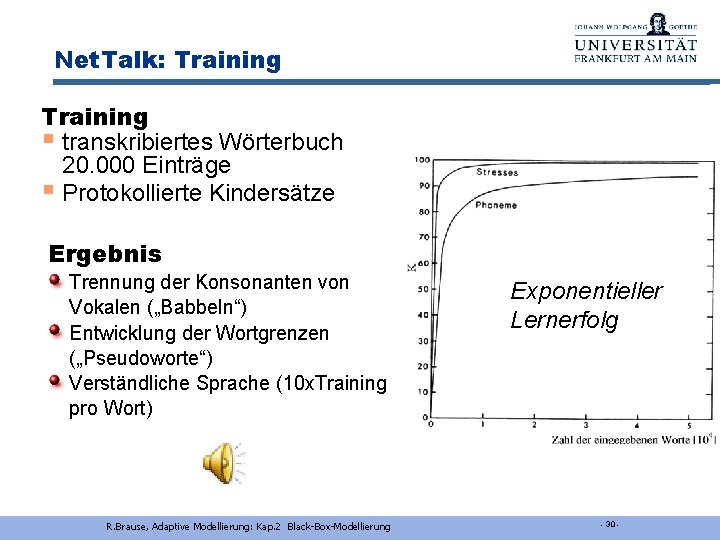

Anwendung - Net. Talk Training § protokollierte, von Kindern gesprochenen Sätze, § zufallsmäßig eingegebene Worte eines Wörterbuchs aus 20. 000 Einträgen Eingabe x: Buchstabe eines Worts im Kontext Lehrervorgabe L(x): Phonologische Transkription Einfügen eines Sonderzeichens „Continuation“, wenn Buchstabe nicht gesprochen wird (!) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -28 -

Anwendung - Net. Talk Ergebnisse: 3 Phasen des Sprachlernens § Zuerst wurden die Konsonanten und Vokale als Klassen getrennt. Innerhalb der Klassen blieben die Phoneme aber noch gemischt, so dass sich die Laute wie "Babbeln" anhörten. § Dann wurden die Wortgrenzen als Merkmale entwickelt, so dass "Pseudoworte" erkennbar wurden. § Zuletzt, nach ca. 10 Durchgängen pro Wort, entstand eine verständliche Sprache, die sich mit fortlaufender Erfahrung weiter verbesserte R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -29 -

Net. Talk: Training § transkribiertes Wörterbuch 20. 000 Einträge § Protokollierte Kindersätze Ergebnis Trennung der Konsonanten von Vokalen („Babbeln“) Entwicklung der Wortgrenzen („Pseudoworte“) Verständliche Sprache (10 x. Training pro Wort) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung Exponentieller Lernerfolg - 30 -

Backpropagation-Grundidee Zielfunktion minimieren Ziel = minimaler quadrat. Fehler R(w) = (L(x) -y(2)(x))2 x = minw Wie erreichen? R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -31 -

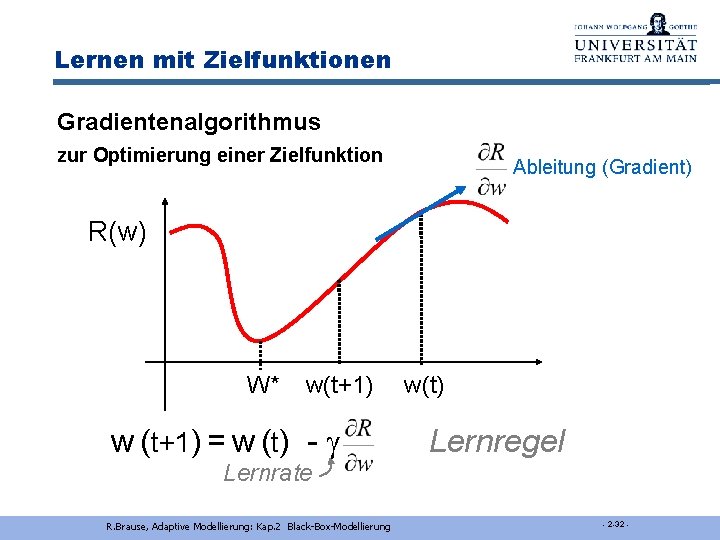

Lernen mit Zielfunktionen Gradientenalgorithmus zur Optimierung einer Zielfunktion Ableitung (Gradient) R(w) W* w(t+1) w (t+1) = w (t) - w(t) Lernregel Lernrate R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -32 -

Stochastisches Lernen mit Zielfunktion R(w) = Rx(w, x) x w(t) = w(t-1) - (t) w Rx(w(t-1)) wird ersetzt durch Lernen mit stochast. Zielfunktion Rx(w, x) w(t) = w(t-1) - (t) w Rx(w(t-1), x(t)) stochastisches Lernen Wieso darf man das?

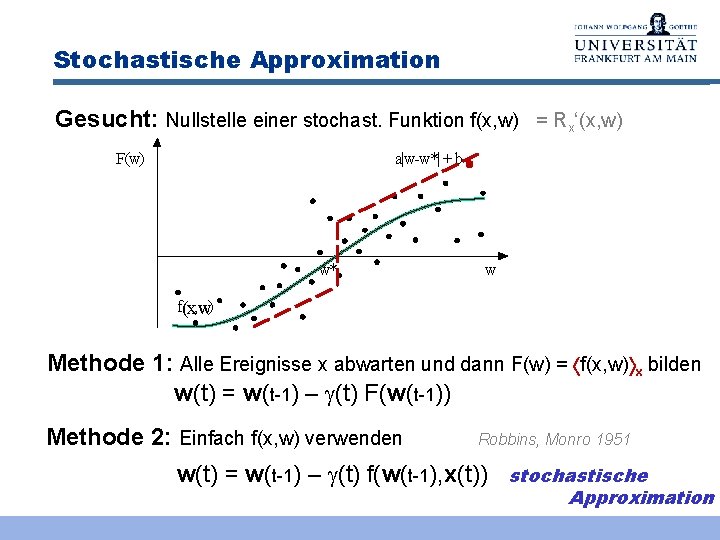

Stochastische Approximation Gesucht: Nullstelle einer stochast. Funktion f(x, w) = Rx‘(x, w) F(w) a|w-w*| + b w* w f(x, w) Methode 1: Alle Ereignisse x abwarten und dann F(w) = f(x, w) x bilden w(t) = w(t-1) – (t) F(w(t-1)) Methode 2: Einfach f(x, w) verwenden Robbins, Monro 1951 w(t) = w(t-1) – (t) f(w(t-1), x(t)) stochastische Approximation

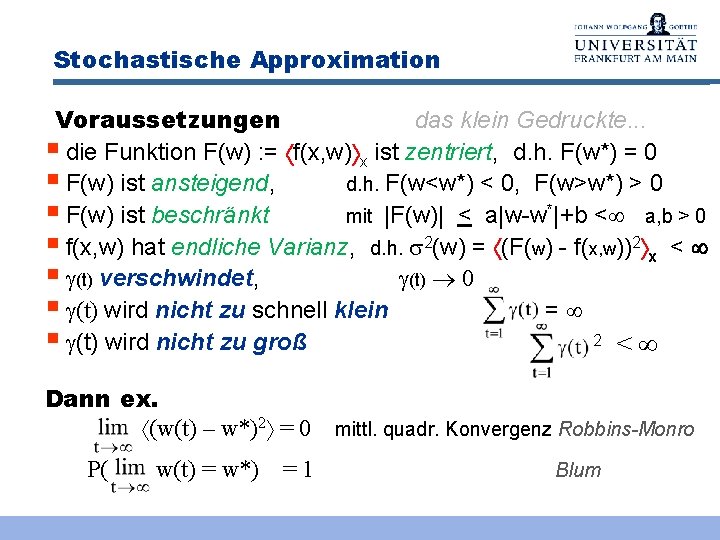

Stochastische Approximation Voraussetzungen das klein Gedruckte. . . § die Funktion F(w) : = f(x, w) x ist zentriert, d. h. F(w*) = 0 § F(w) ist ansteigend, d. h. F(w<w*) < 0, F(w>w*) > 0 § F(w) ist beschränkt mit |F(w)| < a|w-w*|+b < a, b > 0 § f(x, w) hat endliche Varianz, d. h. 2(w) = (F(w) - f(x, w))2 x < § (t) verschwindet, (t) 0 § (t) wird nicht zu schnell klein = 2 < § (t) wird nicht zu groß Dann ex. (w(t) – w*)2 = 0 P( w(t) = w*) = 1 mittl. quadr. Konvergenz Robbins-Monro Blum

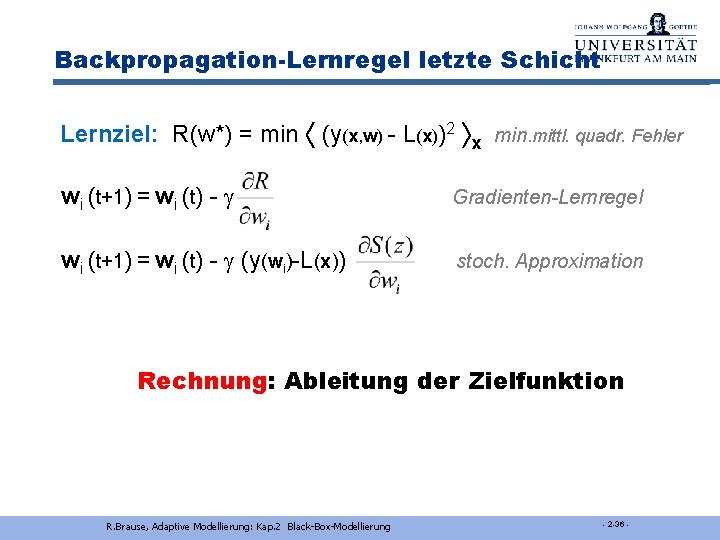

Backpropagation-Lernregel letzte Schicht Lernziel: R(w*) = min (y(x, w) - L(x))2 x min. mittl. quadr. Fehler wi (t+1) = wi (t) - Gradienten-Lernregel wi (t+1) = wi (t) - (y(wi)-L(x)) stoch. Approximation Rechnung: Ableitung der Zielfunktion R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -36 -

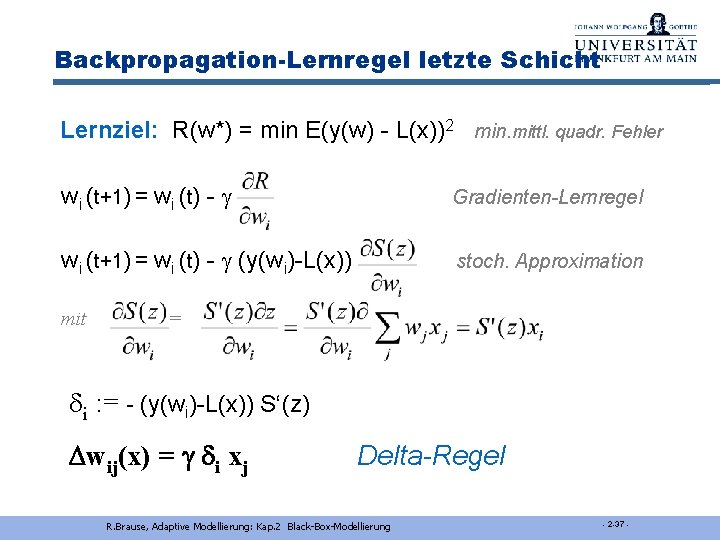

Backpropagation-Lernregel letzte Schicht Lernziel: R(w*) = min E(y(w) - L(x))2 min. mittl. quadr. Fehler wi (t+1) = wi (t) - Gradienten-Lernregel wi (t+1) = wi (t) - (y(wi)-L(x)) stoch. Approximation mit = i : = - (y(wi)-L(x)) S‘(z) wij(x) = i xj Delta-Regel R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -37 -

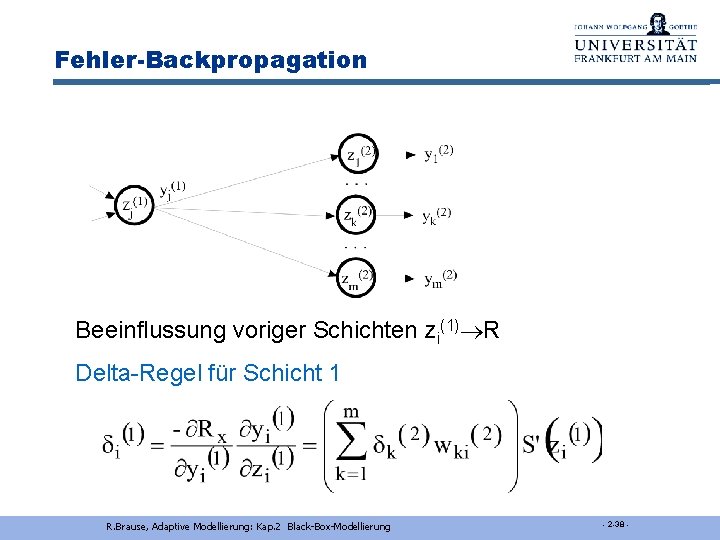

Fehler-Backpropagation Beeinflussung voriger Schichten zi(1) R Delta-Regel für Schicht 1 R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -38 -

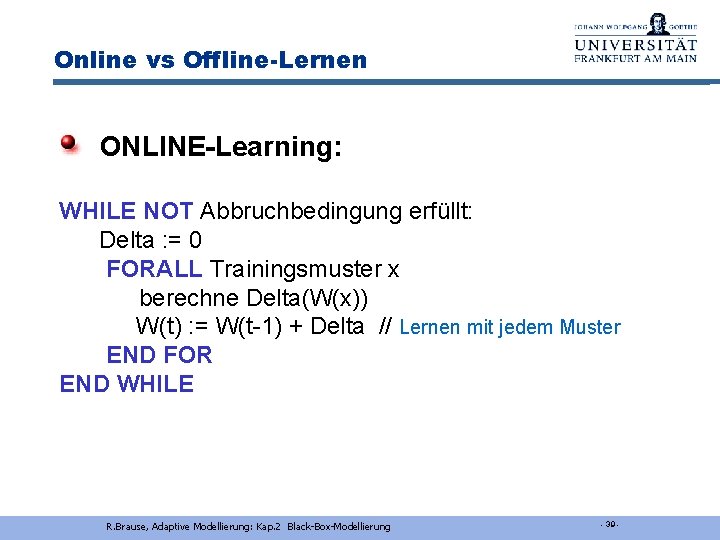

Online vs Offline-Lernen ONLINE-Learning: WHILE NOT Abbruchbedingung erfüllt: Delta : = 0 FORALL Trainingsmuster x berechne Delta(W(x)) W(t) : = W(t-1) + Delta // Lernen mit jedem Muster END FOR END WHILE R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 39 -

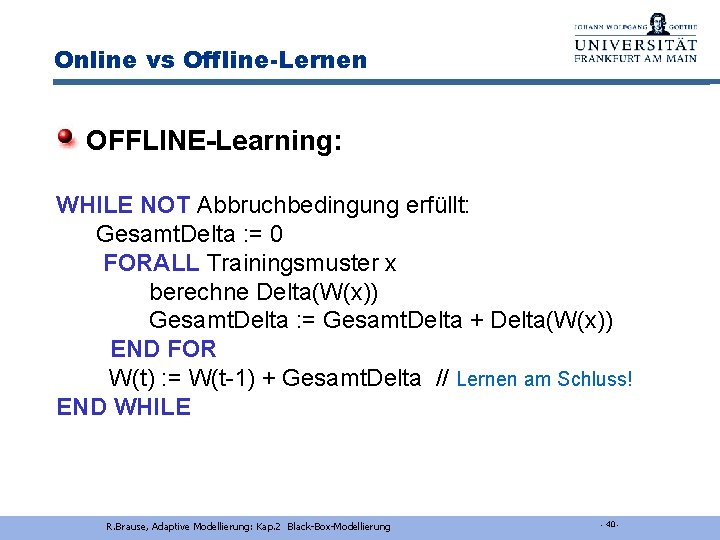

Online vs Offline-Lernen OFFLINE-Learning: WHILE NOT Abbruchbedingung erfüllt: Gesamt. Delta : = 0 FORALL Trainingsmuster x berechne Delta(W(x)) Gesamt. Delta : = Gesamt. Delta + Delta(W(x)) END FOR W(t) : = W(t-1) + Gesamt. Delta // Lernen am Schluss! END WHILE R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 40 -

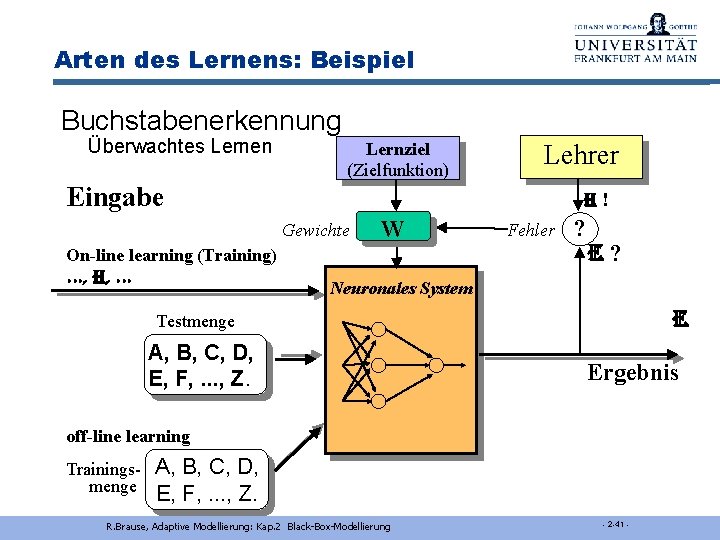

Arten des Lernens: Beispiel Buchstabenerkennung Überwachtes Lernen Lernziel (Zielfunktion) Lehrer Eingabe H! Gewichte W Fehler ? On-line learning (Training) . . . , H, . . . E ? Neuronales System E Testmenge A, B, C, D, E, F, . . . , Z. Ergebnis off-line learning Trainings menge A, B, C, D, E, F, . . . , Z. R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -41 -

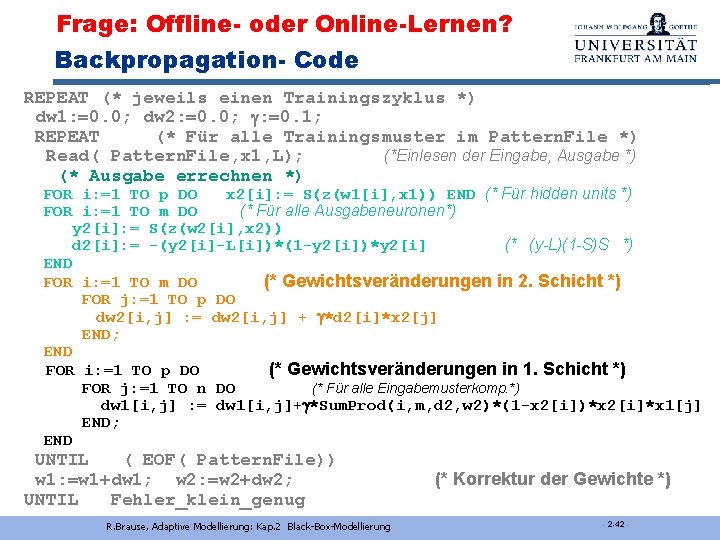

Frage: Offline- oder Online-Lernen? Backpropagation- Code REPEAT (* jeweils einen Trainingszyklus *) dw 1: =0. 0; dw 2: =0. 0; : =0. 1; REPEAT (* Für alle Trainingsmuster im Pattern. File *) Read( Pattern. File, x 1, L); (*Einlesen der Eingabe, Ausgabe *) (* Ausgabe errechnen *) FOR i: =1 TO p DO x 2[i]: = S(z(w 1[i], x 1)) END (* Für hidden units *) FOR i: =1 TO m DO (* Für alle Ausgabeneuronen*) y 2[i]: = S(z(w 2[i], x 2)) d 2[i]: = -(y 2[i]-L[i])*(1 -y 2[i])*y 2[i] (* (y-L)(1 -S)S *) END FOR i: =1 TO m DO (* Gewichtsveränderungen in 2. Schicht *) FOR j: =1 TO p DO dw 2[i, j] : = dw 2[i, j] + *d 2[i]*x 2[j] END; END FOR i: =1 TO p DO (* Gewichtsveränderungen in 1. Schicht *) FOR j: =1 TO n DO (* Für alle Eingabemusterkomp. *) dw 1[i, j] : = dw 1[i, j]+ *Sum. Prod(i, m, d 2, w 2)*(1 -x 2[i])*x 2[i]*x 1[j] END; END UNTIL ( EOF( Pattern. File)) w 1: =w 1+dw 1; w 2: =w 2+dw 2; UNTIL Fehler_klein_genug R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung (* Korrektur der Gewichte *) - 2 -42 -

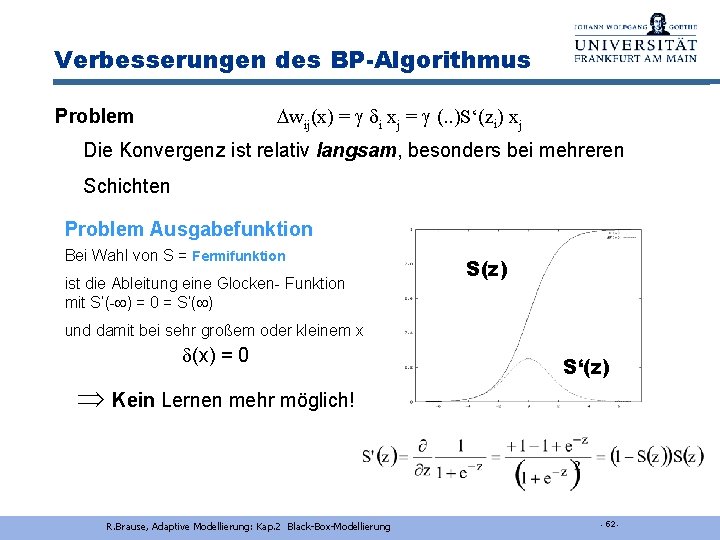

Lernen - Probleme Die Konvergenz ist relativ langsam, besonders bei mehreren Schichten Das System kann in einem lokalen Optimum "stecken" bleiben Trotz guter Trainingsleistung zeigt der Test schlechte Ergebnisse R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -43 -

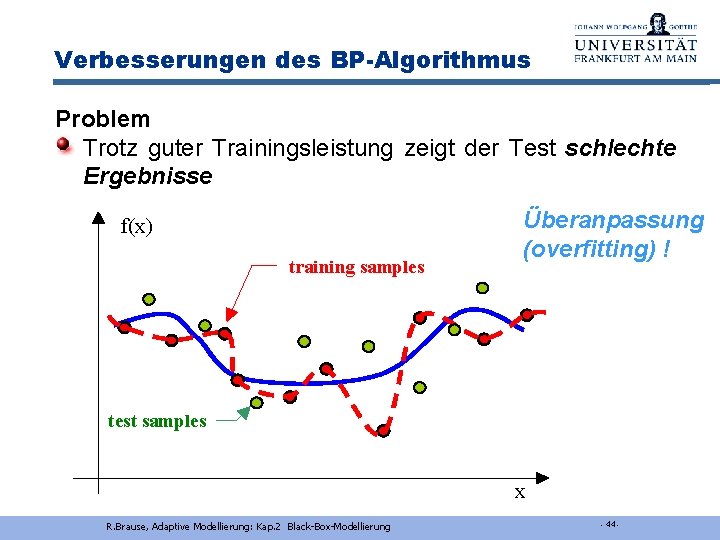

Verbesserungen des BP-Algorithmus Problem Trotz guter Trainingsleistung zeigt der Test schlechte Ergebnisse f(x) training samples Überanpassung (overfitting) ! test samples x R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 44 -

Verbesserungen des BP-Algorithmus Lösung: Stopped Training R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 45 -

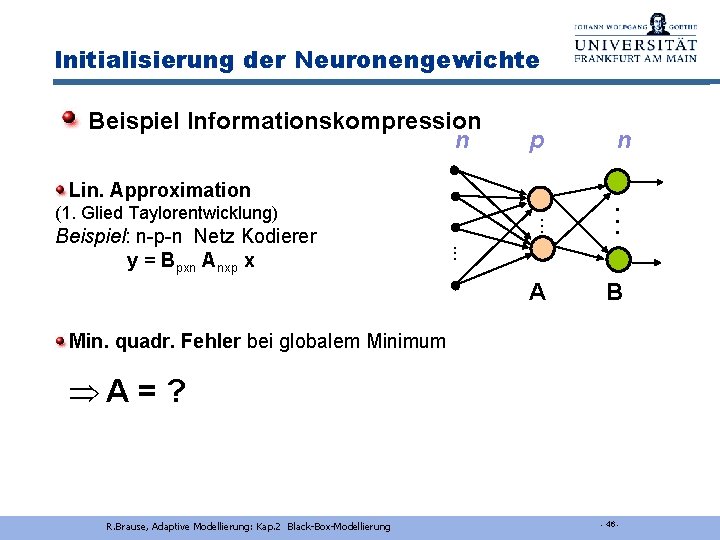

Initialisierung der Neuronengewichte Beispiel Informationskompression n Lin. Approximation (1. Glied Taylorentwicklung) Beispiel: n-p-n Netz Kodierer y = Bpxn Anxp x . . . p n . . . A B Min. quadr. Fehler bei globalem Minimum A = ? R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 46 -

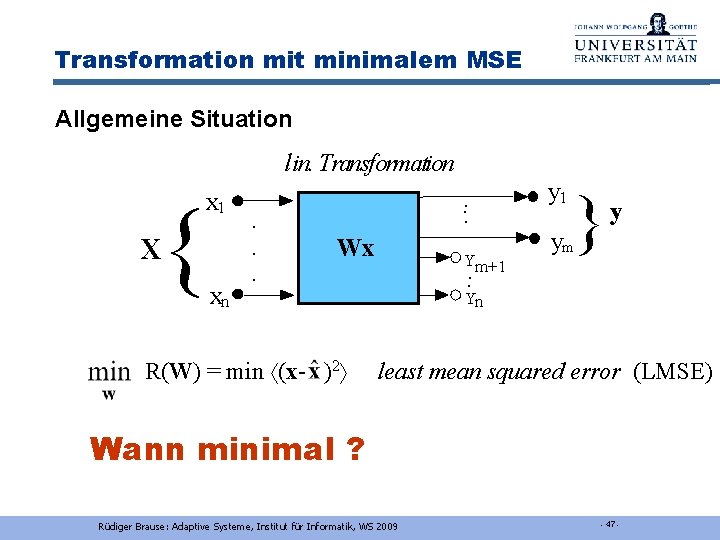

Transformation mit minimalem MSE Allgemeine Situation l in . T r a n sf o r m at i o n x 1 { X x n · · · . . . W x Ym+1. y 1 } y m y . Yn R(W) = min (x- )2 least mean squared error (LMSE) Wann minimal ? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2009 - 47 -

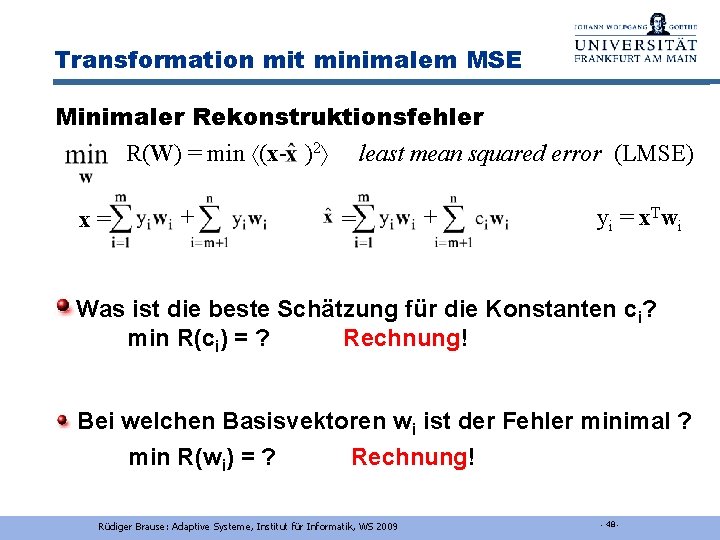

Transformation mit minimalem MSE Minimaler Rekonstruktionsfehler R(W) = min (x- )2 least mean squared error (LMSE) x = + yi = x. Twi Was ist die beste Schätzung für die Konstanten ci? min R(ci) = ? Rechnung! Bei welchen Basisvektoren wi ist der Fehler minimal ? min R(wi) = ? Rechnung! Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2009 - 48 -

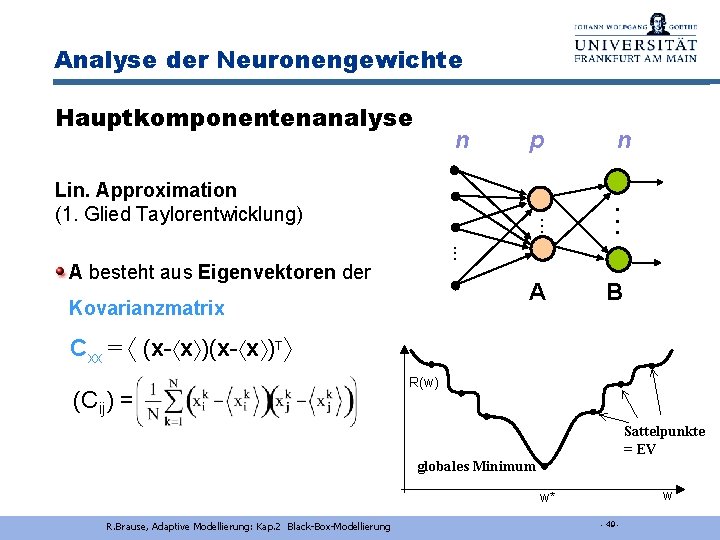

Analyse der Neuronengewichte Hauptkomponentenanalyse n p n . . . A B Lin. Approximation (1. Glied Taylorentwicklung) . . . A besteht aus Eigenvektoren der Kovarianzmatrix Cxx = (x- x )T (Cij) = R(w) Sattelpunkte = EV globales Minimum w w* R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 49 -

![Normierung der Eingangsvariablen Problem: unterschiedliche Skalierungen z. B. x 1 : Weg in [m] Normierung der Eingangsvariablen Problem: unterschiedliche Skalierungen z. B. x 1 : Weg in [m]](http://slidetodoc.com/presentation_image/4bdf8b3fc961acd41c36f3ddf2df85cb/image-50.jpg)

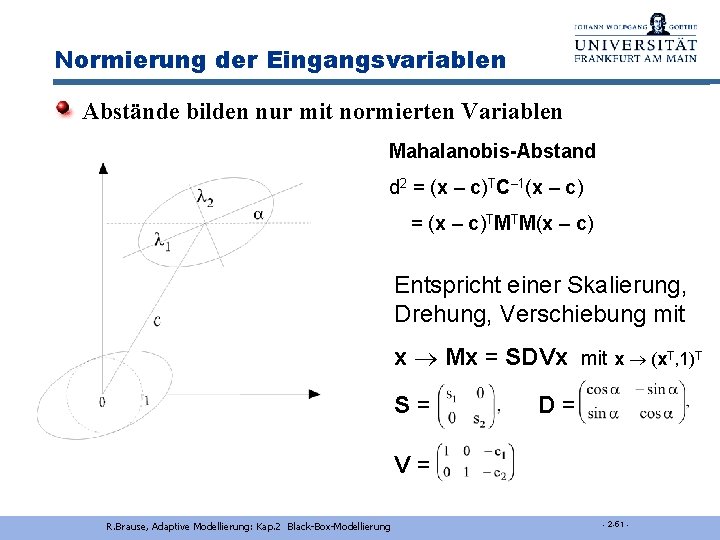

Normierung der Eingangsvariablen Problem: unterschiedliche Skalierungen z. B. x 1 : Weg in [m] x 2 : Grösse in [cm] x 3 : Gewicht in [kg] x 4 : Farbwert in [RGB-Zahl] Normierung aller numerischen Werte auf gleiche Skala ! § Gleichen Mittelwert, etwa x = 0 § Gleiche Varianz = 1 R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -50 -

Normierung der Eingangsvariablen Abstände bilden nur mit normierten Variablen Mahalanobis-Abstand d 2 = (x – c)TC– 1(x – c) = (x – c)TMTM(x – c) Entspricht einer Skalierung, Drehung, Verschiebung mit x Mx = SDVx mit x (x. T, 1)T S= D= V= R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -51 -

Verbesserungen des BP-Algorithmus wij(x) = i xj = (. . )S‘(zi) xj Problem Die Konvergenz ist relativ langsam, besonders bei mehreren Schichten Problem Ausgabefunktion Bei Wahl von S = Fermifunktion ist die Ableitung eine Glocken- Funktion mit S‘(- ) = 0 = S‘( ) S(z) und damit bei sehr großem oder kleinem x (x) = 0 Kein Lernen mehr möglich! R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung S‘(z) - 52 -

Problem Ausgabefunktion Abhilfen: Andere Ausgabefunktion wählen (z. B. Sinus) Andere Zielfunktion wählen (Information statt quadr. Fehler) Andere Lernfunktion wählen, z. B. Ergänzung durch Backpropagation Trägheitsmoment (t+1) = (t) + (1 - ) (t-1) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung z. B. = 0. 9 - 2 -53 -

Black-Box- Modellierung Lineare Modellierung Nichtlin. Modellierung: MLP Nichtlin. Modellierung: RBF Eigenschaften von NN R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -54 -

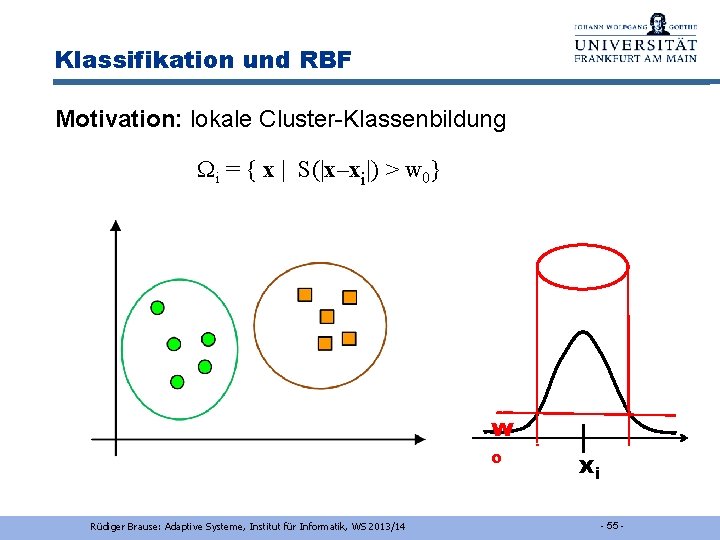

Klassifikation und RBF Motivation: lokale Cluster-Klassenbildung i = { x | S(|x–xi|) > w 0} w o Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013/14 xi - 55 -

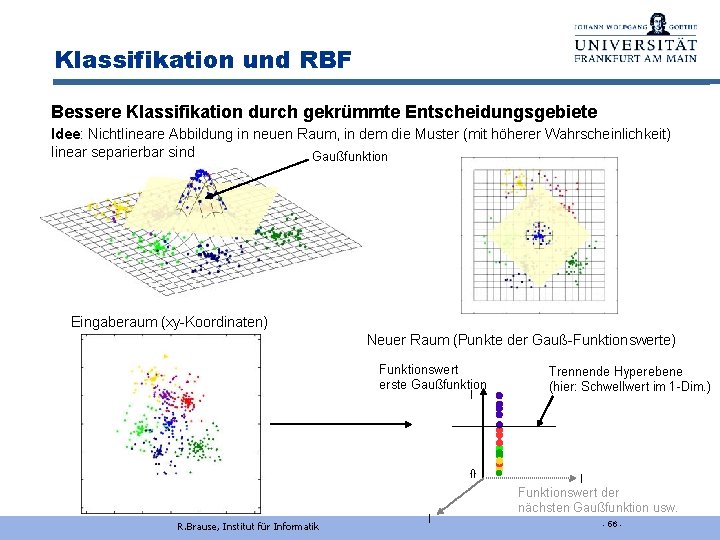

Klassifikation und RBF Bessere Klassifikation durch gekrümmte Entscheidungsgebiete Idee: Nichtlineare Abbildung in neuen Raum, in dem die Muster (mit höherer Wahrscheinlichkeit) linear separierbar sind Gaußfunktion Eingaberaum (xy-Koordinaten) Neuer Raum (Punkte der Gauß-Funktionswerte) Funktionswert erste Gaußfunktion Trennende Hyperebene (hier: Schwellwert im 1 -Dim. ) Funktionswert der nächsten Gaußfunktion usw. R. Brause, Institut für Informatik - 56 -

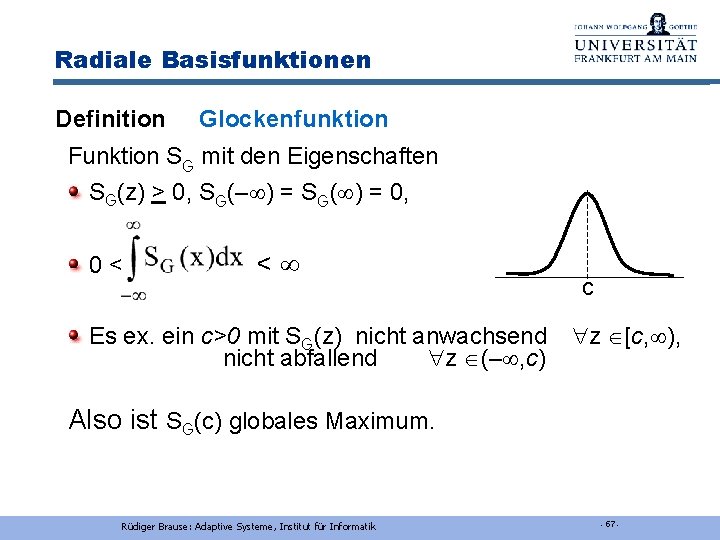

Radiale Basisfunktionen Definition Glockenfunktion Funktion SG mit den Eigenschaften SG(z) > 0, SG(– ) = SG( ) = 0, 0< < Es ex. ein c>0 mit SG(z) nicht anwachsend nicht abfallend z (– , c) c z [c, ), Also ist SG(c) globales Maximum. Rüdiger Brause: Adaptive Systeme, Institut für Informatik - 57 -

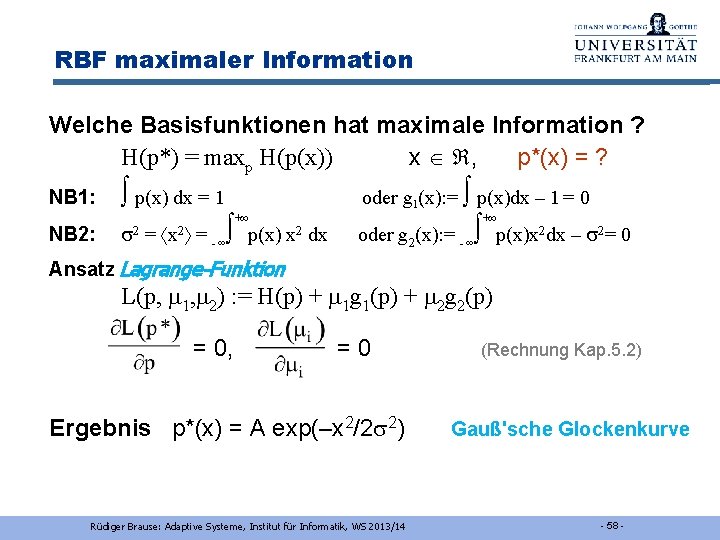

RBF maximaler Information Welche Basisfunktionen hat maximale Information ? H(p*) = maxp H(p(x)) x , p*(x) = ? NB 1: NB 2: p(x) dx = 1 oder g (x): = p(x)dx – 1 = 0 +∞ +∞ 2 2 2 = x = -∞ p(x) x dx oder g 2(x): = -∞ p(x)x 2 dx – 2= 0 1 Ansatz Lagrange-Funktion L(p, 1, 2) : = H(p) + 1 g 1(p) + 2 g 2(p) = 0, =0 Ergebnis p*(x) = A exp(–x 2/2 2) Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013/14 (Rechnung Kap. 5. 2) Gauß'sche Glockenkurve - 58 -

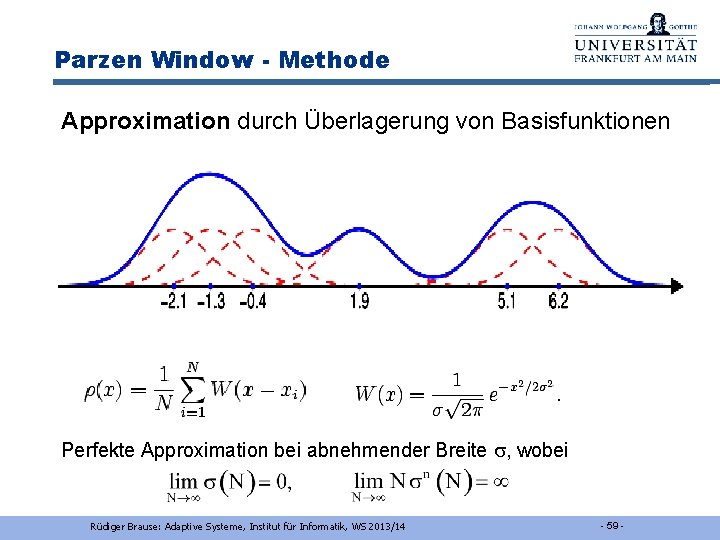

Parzen Window - Methode Approximation durch Überlagerung von Basisfunktionen Perfekte Approximation bei abnehmender Breite , wobei Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013/14 - 59 -

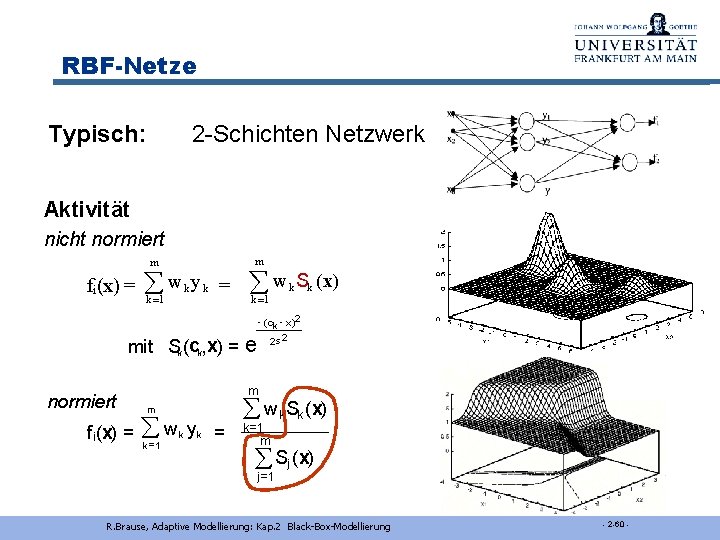

RBF-Netze Typisch: 2 -Schichten Netzwerk Aktivität nicht normiert m fi(x) = å w k y k =1 m åw k =1 k Sk (x) - ( ck - x) 2 mit Sk(ck, x) = e normiert f i (x) = 2 s 2 m m åw k =1 k yk = å w k. Sk (x) k =1 m å Sj (x) j =1 R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -60 -

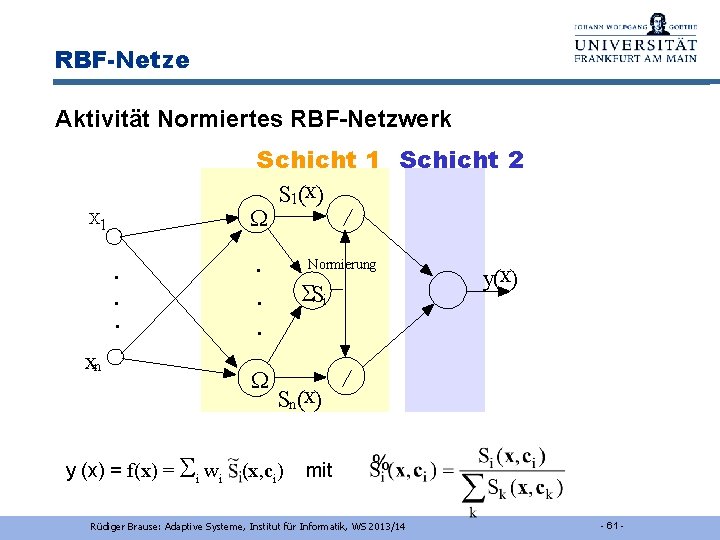

RBF-Netze Aktivität Normiertes RBF-Netzwerk 1 Schicht 2 Schicht S 1(X) / X 1 · · · xn Normierung · · · Si Sn(X) y (x) = f(x) = i wi (x, ci) y(X) / mit Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013/14 - 61 -

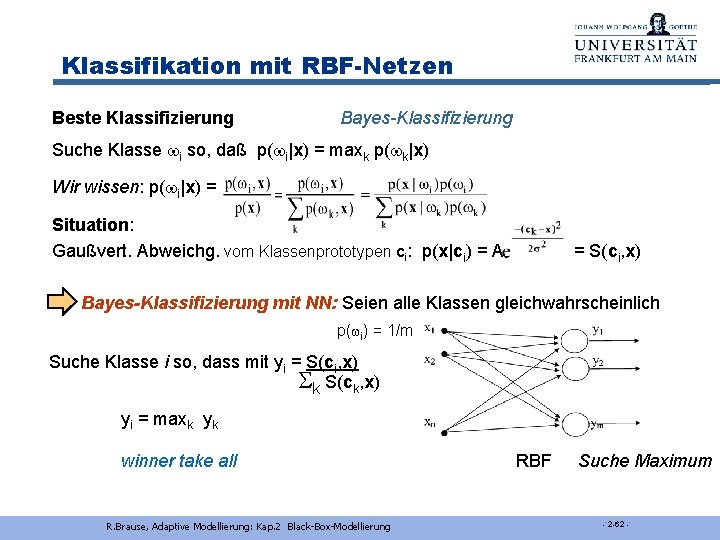

Klassifikation mit RBF-Netzen Beste Klassifizierung Bayes-Klassifizierung Suche Klasse wi so, daß p(wi|x) = maxk p(wk|x) Wir wissen: p(wi|x) = Situation: Gaußvert. Abweichg. vom Klassenprototypen ci: p(x|ci) = A = S(ci, x) Bayes-Klassifizierung mit NN: Seien alle Klassen gleichwahrscheinlich p(wi) = 1/m Suche Klasse i so, dass mit yi = S(ci, x) k S(ck, x) yi = maxk yk winner take all R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung RBF Suche Maximum - 2 -62 -

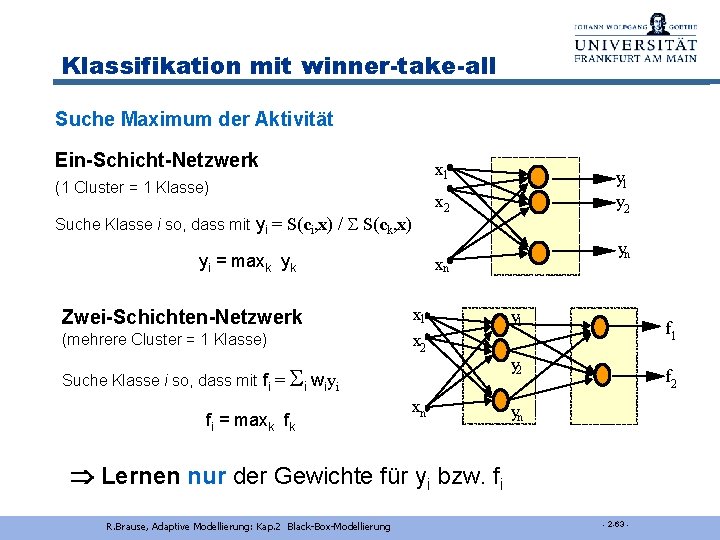

Klassifikation mit winner-take-all Suche Maximum der Aktivität Ein-Schicht-Netzwerk x 1 (1 Cluster = 1 Klasse) x 2 Suche Klasse i so, dass mit yi = S(ci, x) / S(ck, x) yi = maxk yk Zwei-Schichten-Netzwerk (mehrere Cluster = 1 Klasse) yn xn x 1 x 2 Suche Klasse i so, dass mit fi = i wiyi fi = maxk fk y 1 y 2 xn y 1 f 1 y 2 f 2 yn Lernen nur der Gewichte für yi bzw. fi R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -63 -

Frage Was ist das Ziel der Bayes-Klassifikation? Antwort 1. 2. 3. 4. Die minimale Fehlerwahrscheinlichkeit Die maximale bedingte Wahrscheinlichkeit für eine Entscheidung Die minimale Abweichung vom korrekten Wert Die maximale Korrelation mit dem korrekten Wert Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013/14 - 64 -

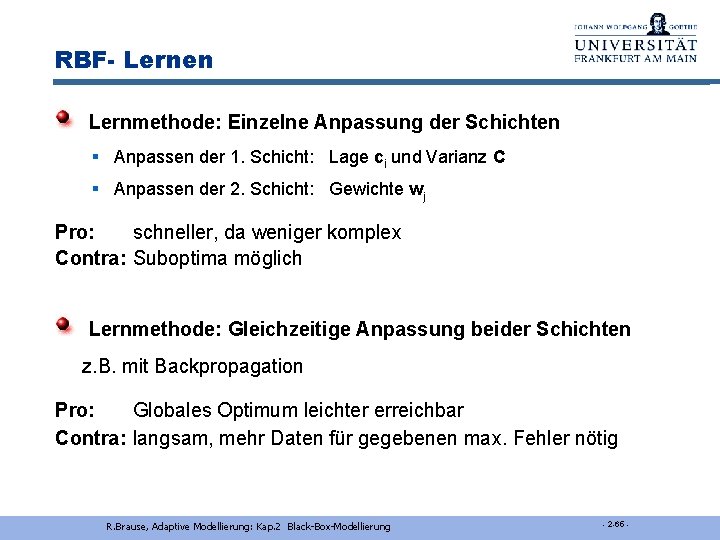

RBF- Lernen Lernmethode: Einzelne Anpassung der Schichten § Anpassen der 1. Schicht: Lage ci und Varianz C § Anpassen der 2. Schicht: Gewichte wj Pro: schneller, da weniger komplex Contra: Suboptima möglich Lernmethode: Gleichzeitige Anpassung beider Schichten z. B. mit Backpropagation Pro: Globales Optimum leichter erreichbar Contra: langsam, mehr Daten für gegebenen max. Fehler nötig R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -65 -

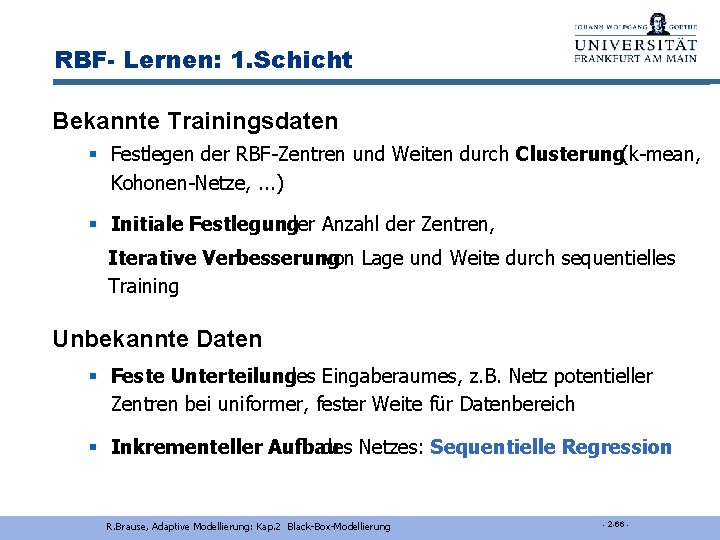

RBF- Lernen: 1. Schicht Bekannte Trainingsdaten § Festlegen der RBF-Zentren und Weiten durch Clusterung(k-mean, Kohonen-Netze, . . . ) § Initiale Festlegung der Anzahl der Zentren, Iterative Verbesserung von Lage und Weite durch sequentielles Training Unbekannte Daten § Feste Unterteilung des Eingaberaumes, z. B. Netz potentieller Zentren bei uniformer, fester Weite für Datenbereich § Inkrementeller Aufbau des Netzes: Sequentielle Regression R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -66 -

RBF-Lernen : 1. Schicht k-means-Clusterung Wähle k zufällige Muster xj A als Clusterzentren cj, bilde Cj = {cj} REPEAT Ordne alle xi A zu den nächstgelegenen Clusterzentren zu: Suche für xi das Cluster cz so, dass |xi-cz| = mink |xi-ck|, und füge xi zu Cz zu. Entferne alle Cluster i mit |Ci| < 1 Bilde für jedes Cluster k ein neues Zentrum ck = x als Mittelwert aller Muster in Ck UNTIL Iterationszahl > Max R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -67 -

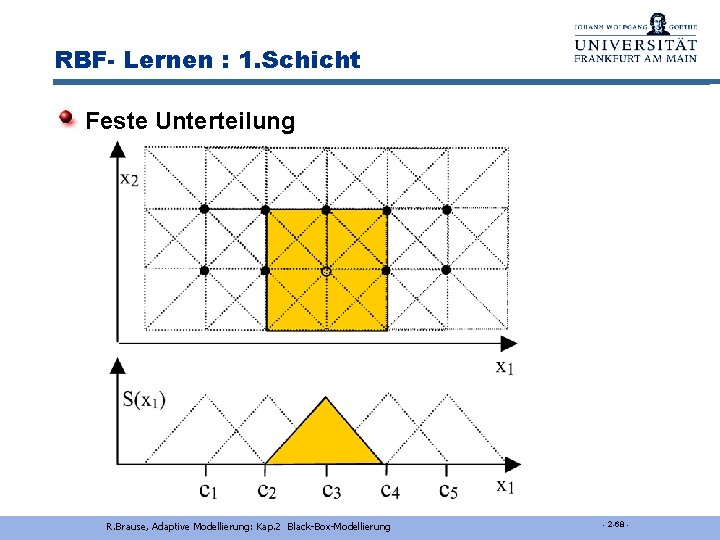

RBF- Lernen : 1. Schicht Feste Unterteilung R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -68 -

RBF- Lernen : 1. Schicht Adaptive Unterteilung R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -69 -

RBF-Lernen Erstellen der 1. Schicht: Sequentielle Regression Start mit einem Neuron Füge ein neues Neuron hinzu für jedes Beispiel mit hohem Fehler (Abweichung vom gewünschten Netz. Ausgabewert) Verändere die Parameter bei den Nachbarn so, dass der Fehler verringert wird (Einpassen des neuen Neurons) Das Netzwerk wächst solange, bis der Approximationsfehler auf das gewünschte Maß zurückgegangen ist. R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -70 -

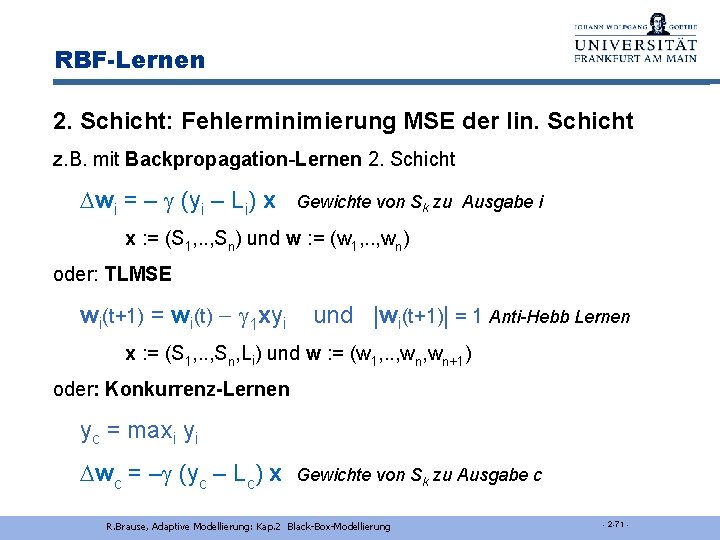

RBF-Lernen 2. Schicht: Fehlerminimierung MSE der lin. Schicht z. B. mit Backpropagation-Lernen 2. Schicht wi = – (yi – Li) x Gewichte von Sk zu Ausgabe i x : = (S 1, . . , Sn) und w : = (w 1, . . , wn) oder: TLMSE wi(t+1) = wi(t) 1 xyi und |wi(t+1)| = 1 Anti-Hebb Lernen x : = (S 1, . . , Sn, Li) und w : = (w 1, . . , wn+1) oder: Konkurrenz-Lernen yc = maxi yi wc = – (yc – Lc) x Gewichte von Sk zu Ausgabe c R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -71 -

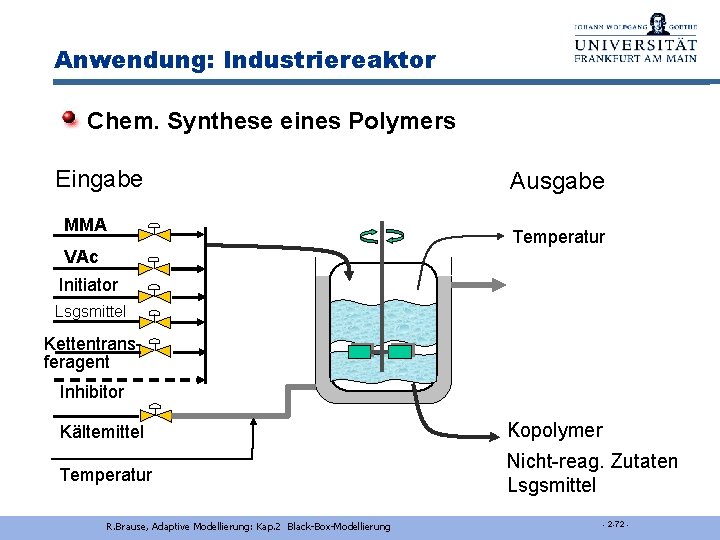

Anwendung: Industriereaktor Chem. Synthese eines Polymers Eingabe MMA VAc Ausgabe Temperatur Initiator Lsgsmittel Kettentransferagent Inhibitor Kältemittel Kopolymer Temperatur Nicht-reag. Zutaten Lsgsmittel R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -72 -

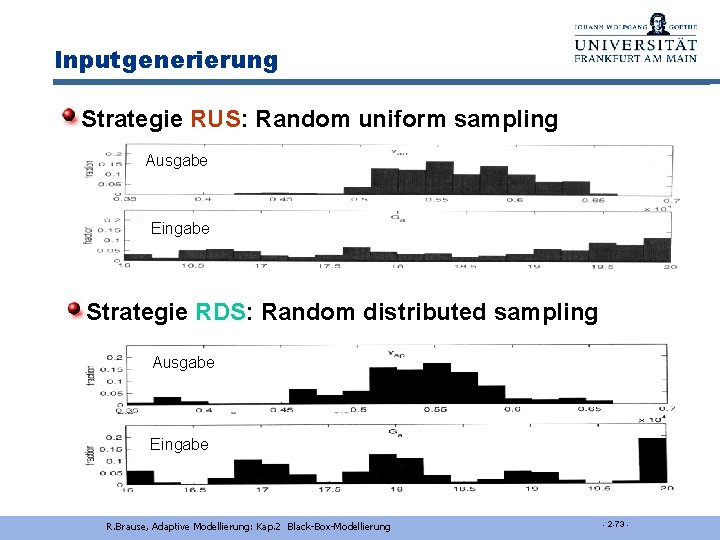

Inputgenerierung Strategie RUS: Random uniform sampling Ausgabe Eingabe Strategie RDS: Random distributed sampling Ausgabe Eingabe R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -73 -

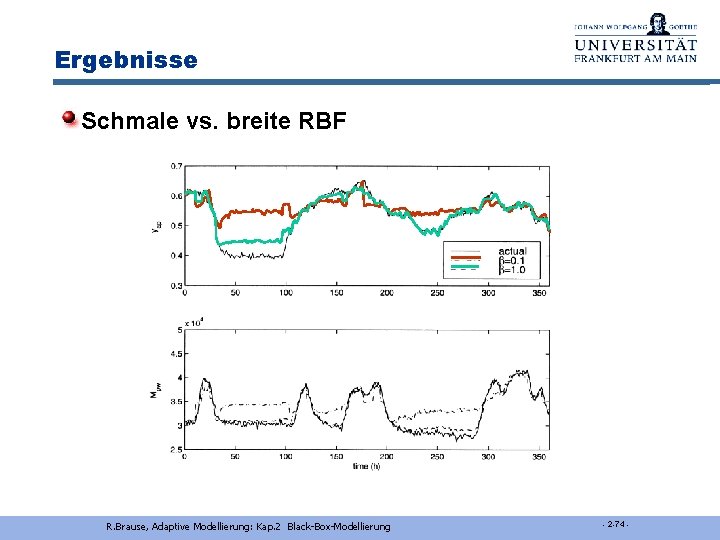

Ergebnisse Schmale vs. breite RBF R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -74 -

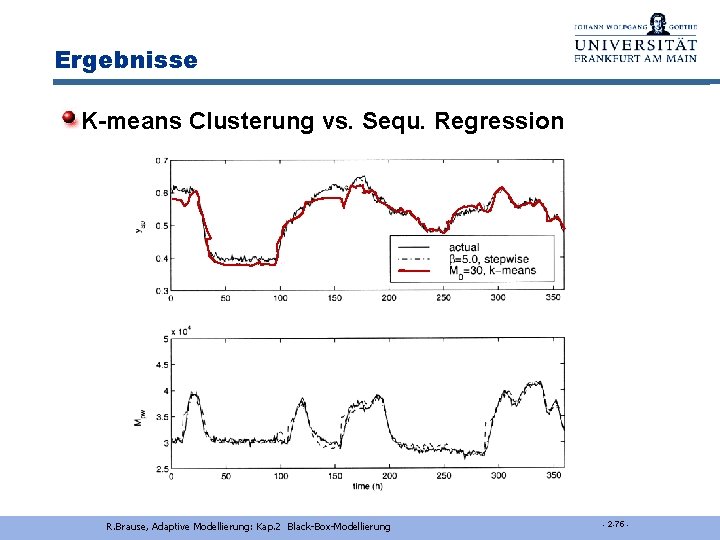

Ergebnisse K-means Clusterung vs. Sequ. Regression R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -75 -

Black-Box- Modellierung Lineare Modellierung Nichtlin. Modellierung: MLP Nichtlin. Modellierung: RBF Eigenschaften von NN R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -76 -

Approximationsleistungen Neuronaler Netze Allgemeine Eigenschaften von NN § Kann man jede beliebige Funktion approximieren? § Wenn ja, mit welcher Architektur ? § Wie viele Schichten benötigt man ? § Wie viele Neuronen pro Schicht braucht man ? R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -77 -

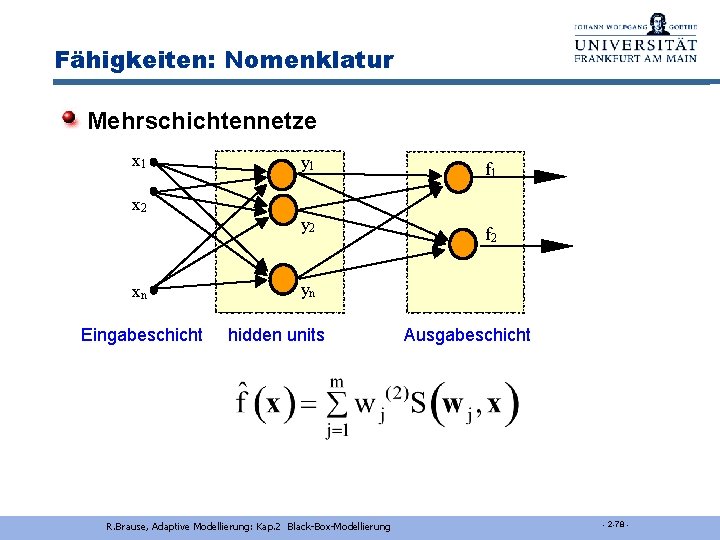

Fähigkeiten: Nomenklatur Mehrschichtennetze x 1 x 2 xn Eingabeschicht y 1 y 2 f 1 f 2 yn hidden units R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung Ausgabeschicht - 2 -78 -

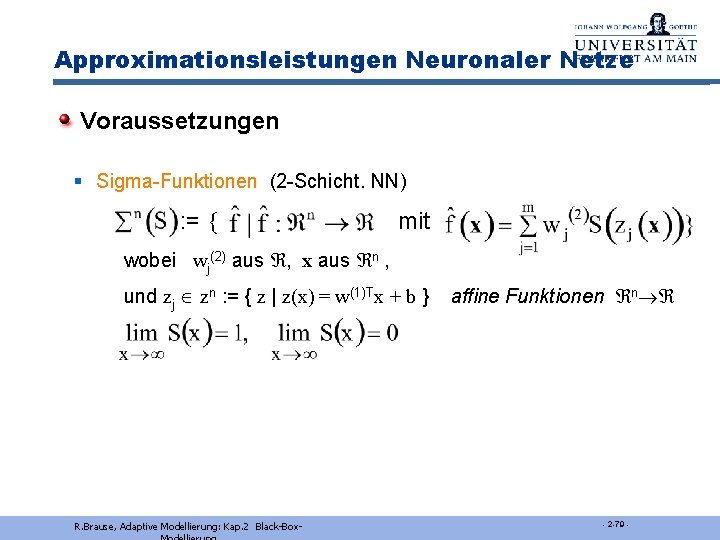

Approximationsleistungen Neuronaler Netze Voraussetzungen § Sigma-Funktionen (2 -Schicht. NN) : = { mit wobei wj(2) aus , x aus n , und zj zn : = { z | z(x) = w(1)Tx + b } R. Brause, Adaptive Modellierung: Kap. 2 Black-Box- affine Funktionen n - 2 -79 -

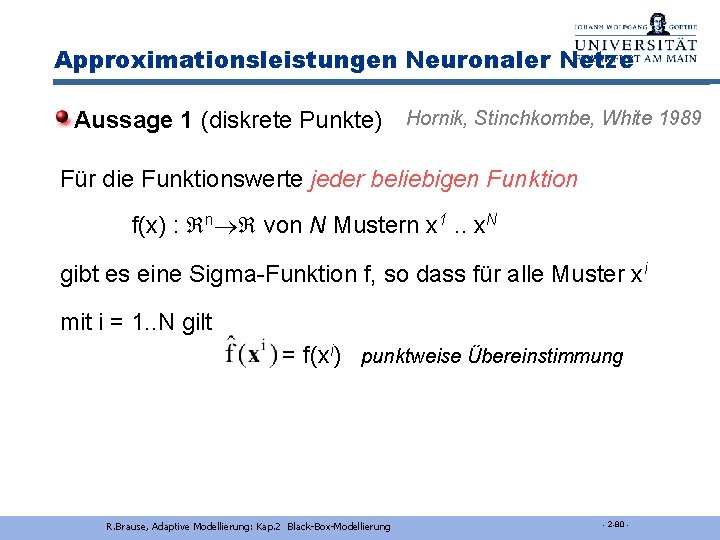

Approximationsleistungen Neuronaler Netze Aussage 1 (diskrete Punkte) Hornik, Stinchkombe, White 1989 Für die Funktionswerte jeder beliebigen Funktion f(x) : n von N Mustern x 1. . x. N gibt es eine Sigma-Funktion f, so dass für alle Muster xi mit i = 1. . N gilt = f(xi) punktweise Übereinstimmung R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 2 -80 -

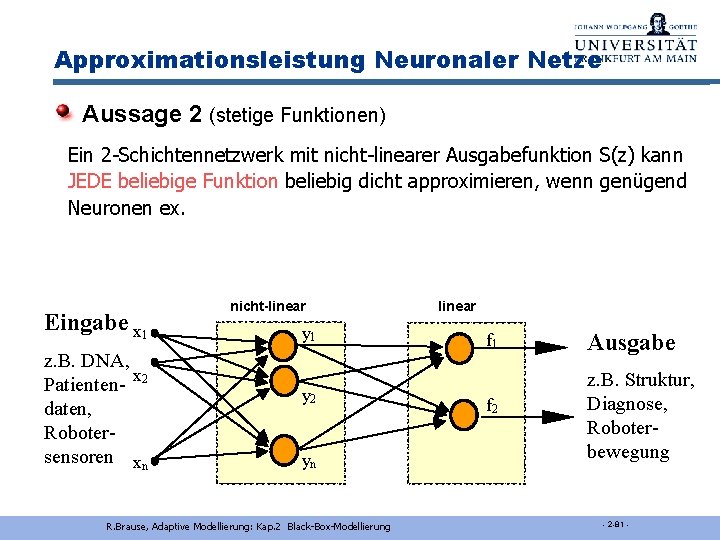

Approximationsleistung Neuronaler Netze Aussage 2 (stetige Funktionen) Ein 2 -Schichtennetzwerk mit nicht-linearer Ausgabefunktion S(z) kann JEDE beliebige Funktion beliebig dicht approximieren, wenn genügend Neuronen ex. Eingabe x 1 z. B. DNA, Patienten- x 2 daten, Robotersensoren xn nicht-linear y 1 y 2 yn R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung linear f 1 f 2 Ausgabe z. B. Struktur, Diagnose, Roboterbewegung - 2 -81 -

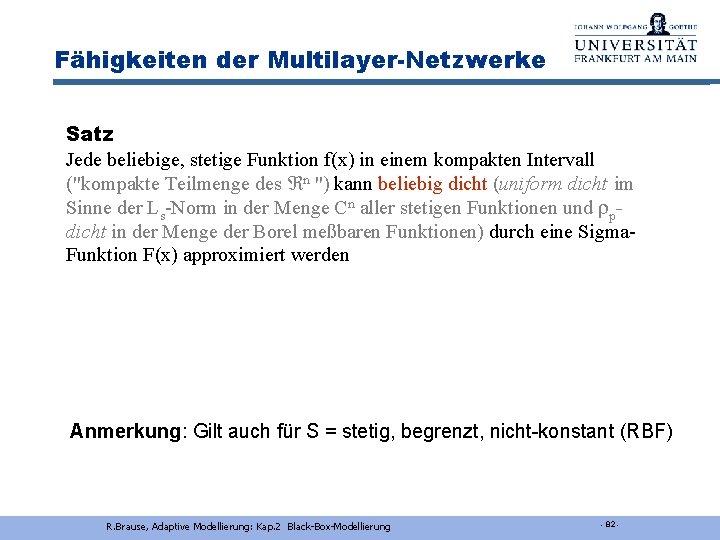

Fähigkeiten der Multilayer-Netzwerke Satz Jede beliebige, stetige Funktion f(x) in einem kompakten Intervall ("kompakte Teilmenge des n ") kann beliebig dicht (uniform dicht im Sinne der Ls-Norm in der Menge Cn aller stetigen Funktionen und pdicht in der Menge der Borel meßbaren Funktionen) durch eine Sigma. Funktion F(x) approximiert werden Anmerkung: Gilt auch für S = stetig, begrenzt, nicht-konstant (RBF) R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 82 -

Fähigkeiten der Multilayer-Netzwerke Frage: Wieviel Schichten muss ein Netzwerk mindestens haben, um eine beliebige Funktion beliebig gut zu approximieren? ? Antworten: eine zwei drei unendlich viele R. Brause, Adaptive Modellierung: Kap. 2 Black-Box-Modellierung - 83 -

- Slides: 83