Adaptive lineare Transformationen AS 1 3 Lineare Schichten

- Slides: 56

Adaptive lineare Transformationen AS 1 -3

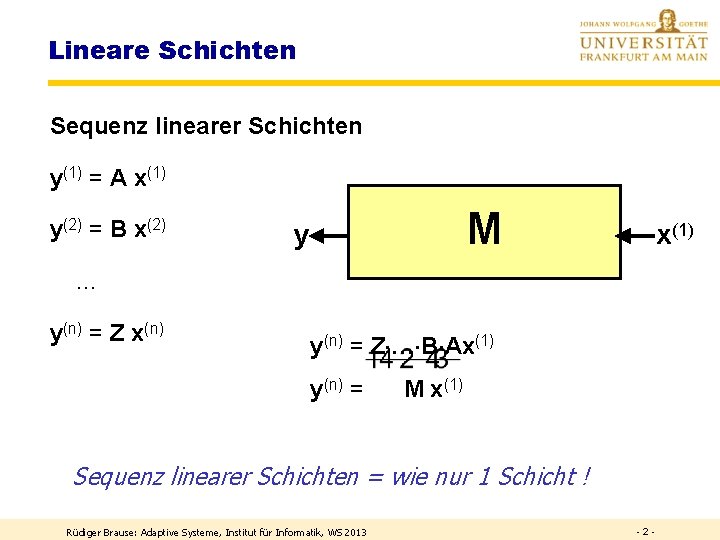

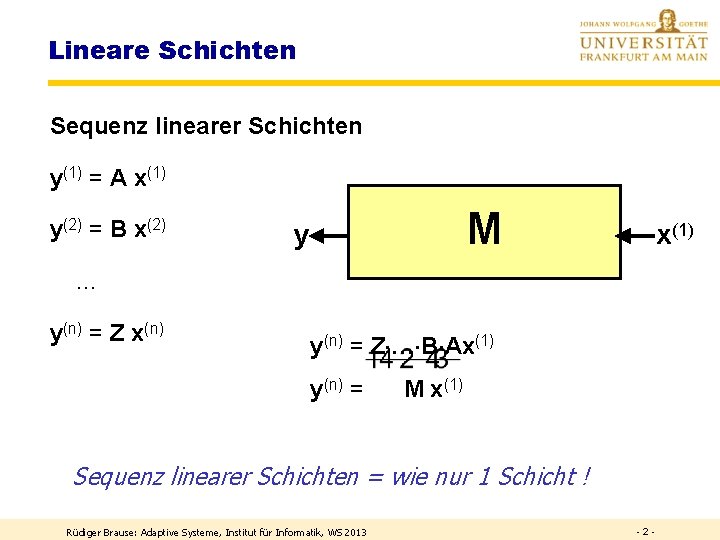

Lineare Schichten Sequenz linearer Schichten y(1) = A x(1) y(2) = B x(2) Z y M B A x(1) . . . y(n) = Z x(n) y(n) = Z B Ax(1) y(n) = M x(1) Sequenz linearer Schichten = wie nur 1 Schicht ! Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 2 -

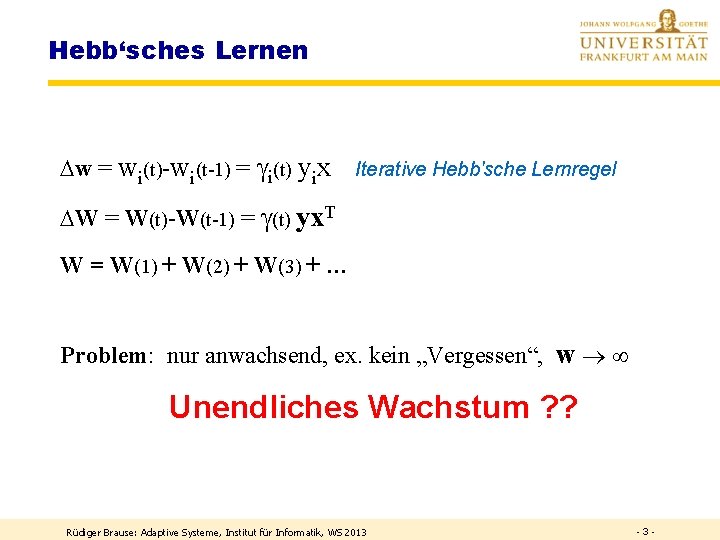

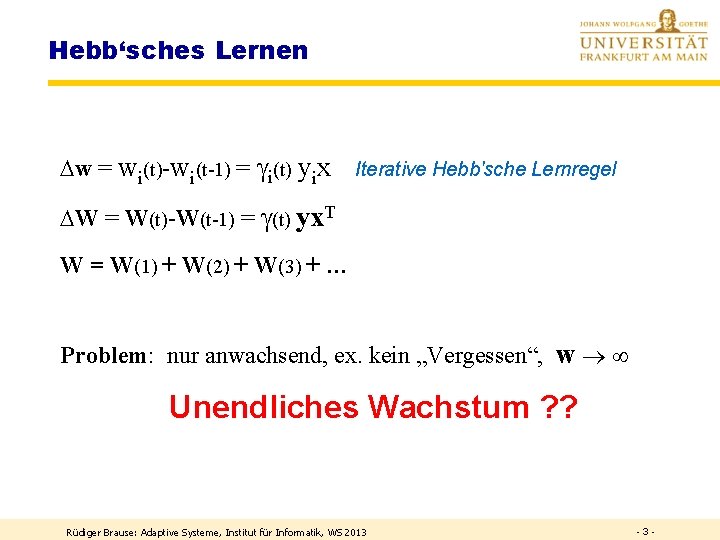

Hebb‘sches Lernen Dw = wi(t)-wi(t-1) = i(t) yix Iterative Hebb'sche Lernregel DW = W(t)-W(t-1) = (t) yx. T W = W(1) + W(2) + W(3) + … Problem: nur anwachsend, ex. kein „Vergessen“, w Unendliches Wachstum ? ? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 -

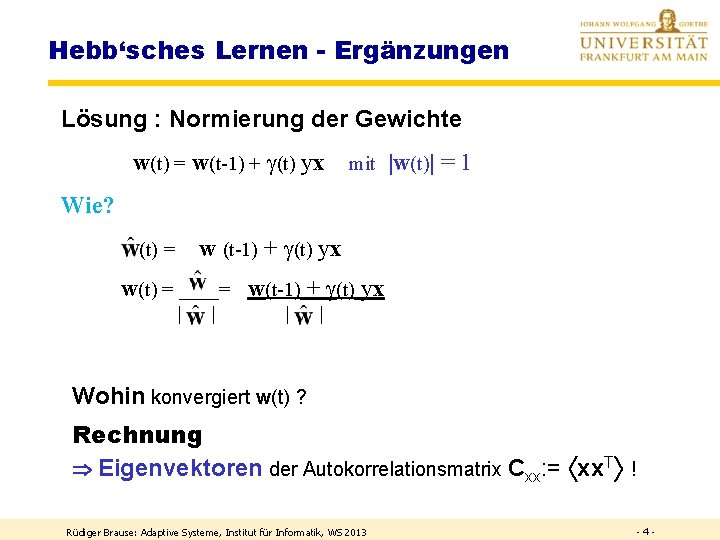

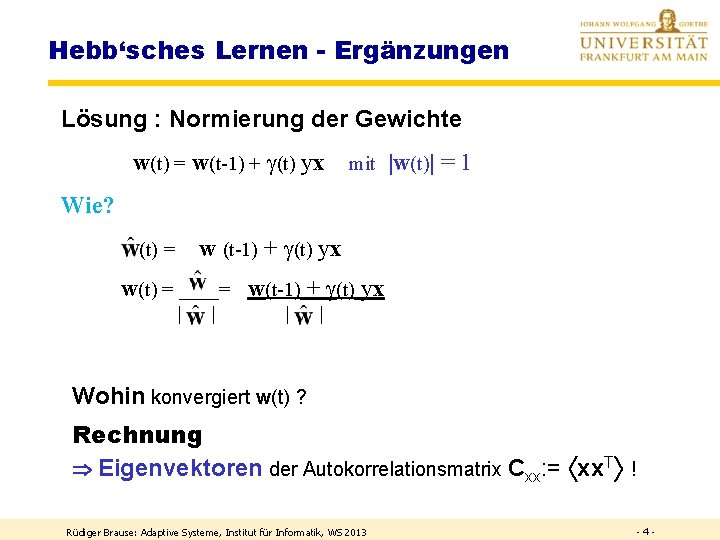

Hebb‘sches Lernen - Ergänzungen Lösung : Normierung der Gewichte w(t) = w(t-1) + (t) yx mit |w(t)| = 1 Wie? w (t-1) + (t) yx (t) = w(t) = ____= w(t-1) + (t) yx | | Wohin konvergiert w(t) ? Rechnung Eigenvektoren der Autokorrelationsmatrix Cxx: = xx. T ! Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 4 -

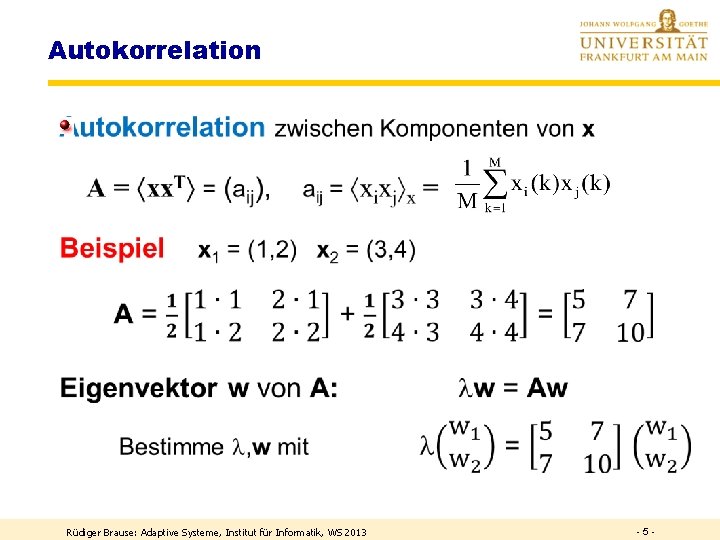

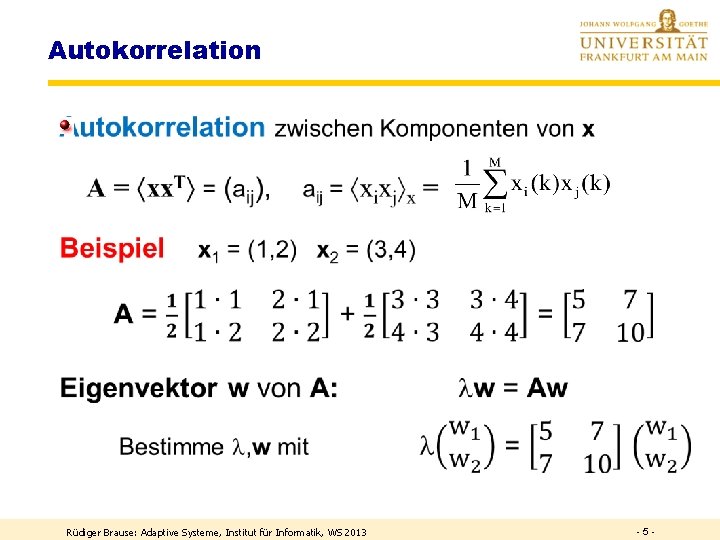

Autokorrelation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 5 -

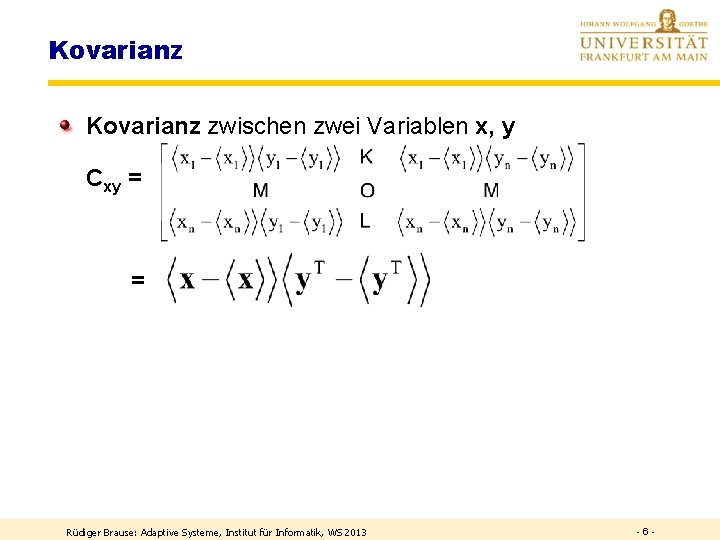

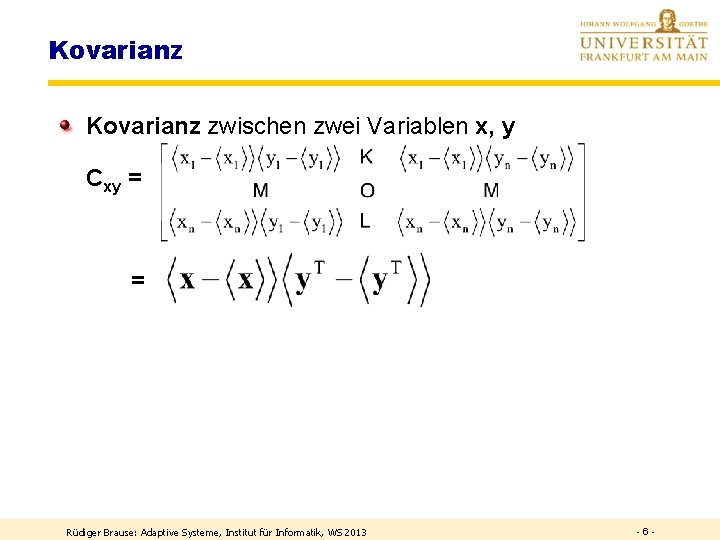

Kovarianz zwischen zwei Variablen x, y Cxy = = Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 6 -

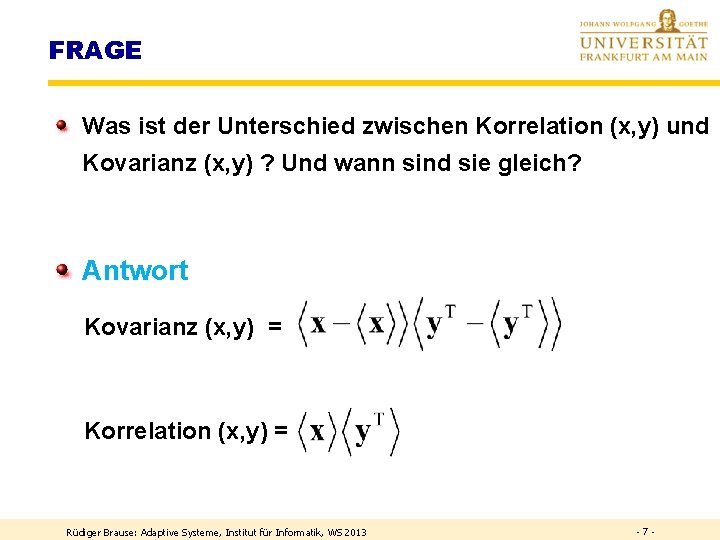

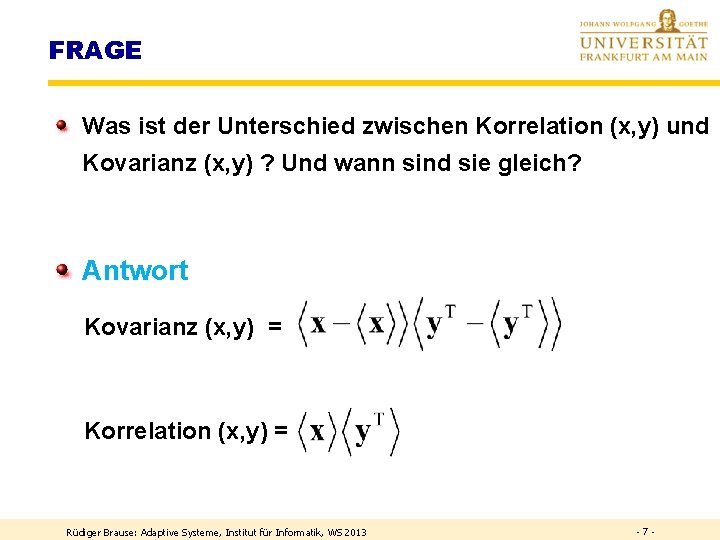

FRAGE Was ist der Unterschied zwischen Korrelation (x, y) und Kovarianz (x, y) ? Und wann sind sie gleich? Antwort Kovarianz (x, y) = Korrelation (x, y) = Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 7 -

PCA-Transformation Transform Coding PCA-Netze Weissen ICA-Transformation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 8 -

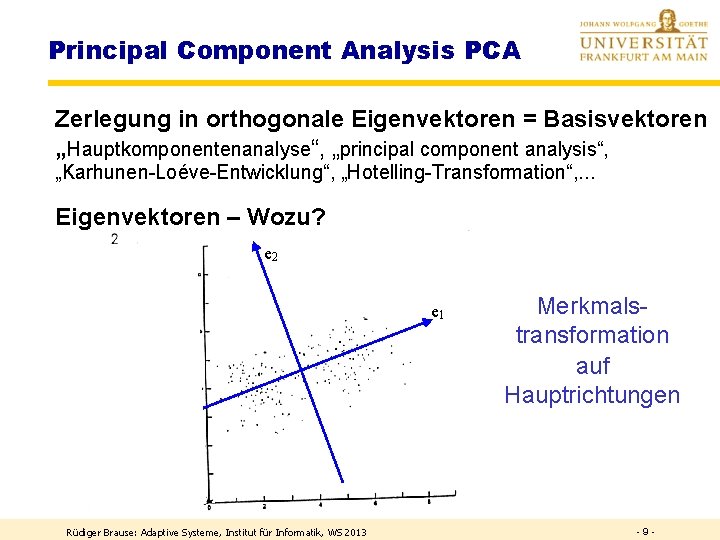

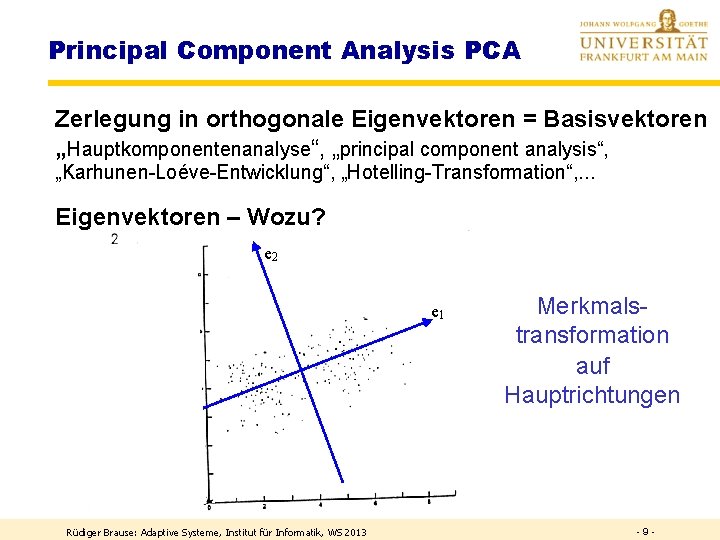

Principal Component Analysis PCA Zerlegung in orthogonale Eigenvektoren = Basisvektoren „Hauptkomponentenanalyse“, „principal component analysis“, „Karhunen-Loéve-Entwicklung“, „Hotelling-Transformation“, . . . Eigenvektoren – Wozu? e 2 e 1 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 Merkmalstransformation auf Hauptrichtungen - 9 -

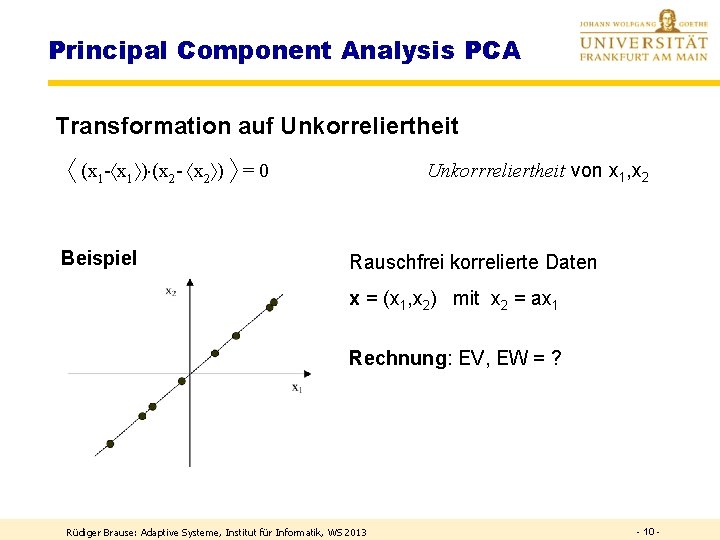

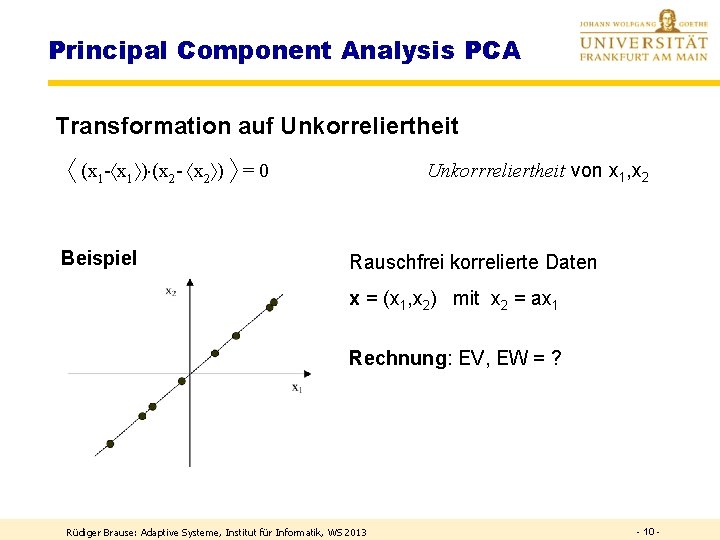

Principal Component Analysis PCA Transformation auf Unkorreliertheit (x 1 - x 1 ) (x 2 - x 2 ) = 0 Beispiel Unkorrreliertheit von x 1, x 2 Rauschfrei korrelierte Daten x = (x 1, x 2) mit x 2 = ax 1 Rechnung: EV, EW = ? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 10 -

Transformation mit minimalem MSE Beispiel: Sprachkodierung Signalanteil in Frequenzbereichen Fouriertranformation x(t) Filter 1 x 1 Filter 2 x 2 Filter 3 x 3 Filter 4 x 4 Filter 5 x 5 Filter 6 x 6 Filter 7 x 7 Filter 8 x 8 Filter 9 x 9 Filter 10 x 10 Merkmalsvektor Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 Zeit - 11 -

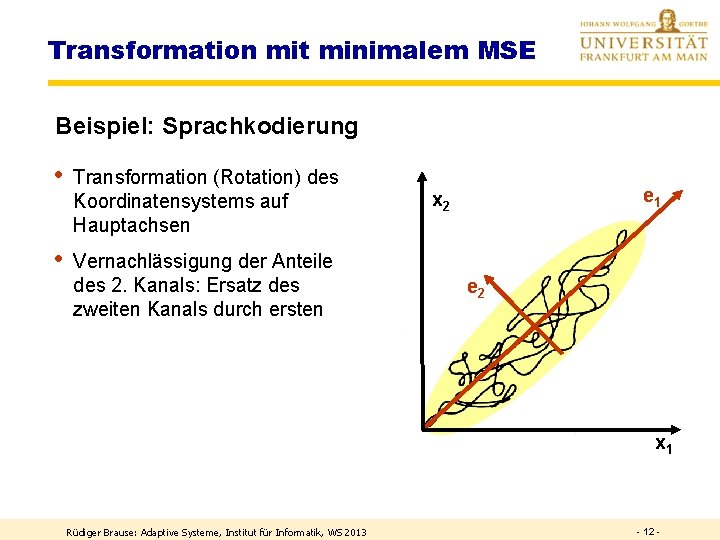

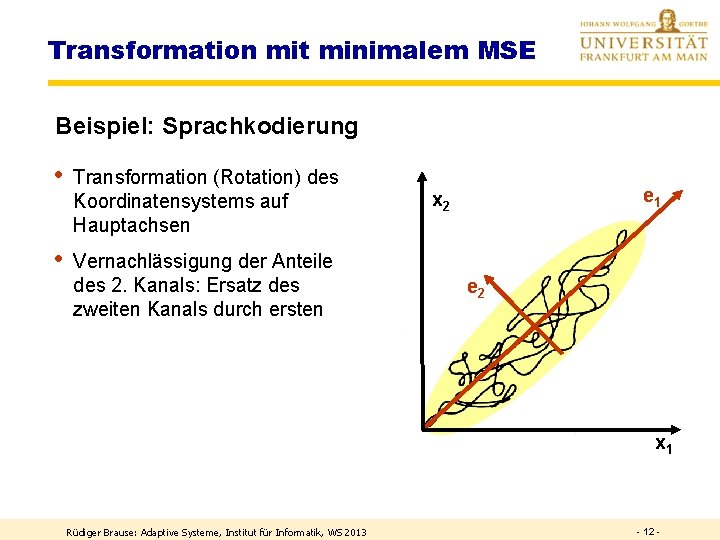

Transformation mit minimalem MSE Beispiel: Sprachkodierung • Transformation (Rotation) des Koordinatensystems auf Hauptachsen • Vernachlässigung der Anteile des 2. Kanals: Ersatz des zweiten Kanals durch ersten e 1 x 2 e 2 x 1 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 12 -

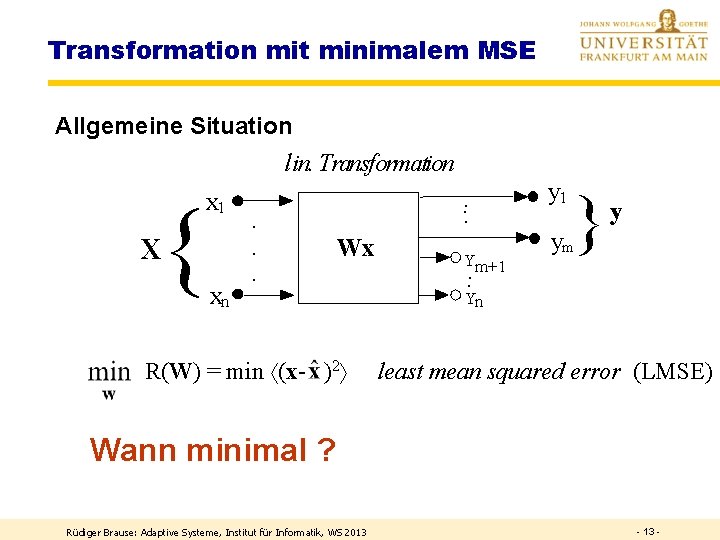

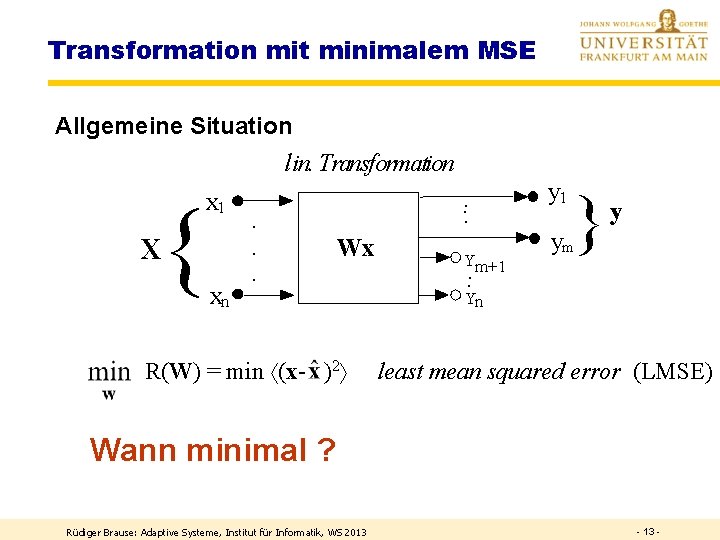

Transformation mit minimalem MSE Allgemeine Situation lin. Transformation x 1 { X xn · · · . . . Wx R(W) = min (x- )2 Ym+1. y 1 } y ym . Yn least mean squared error (LMSE) Wann minimal ? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 -

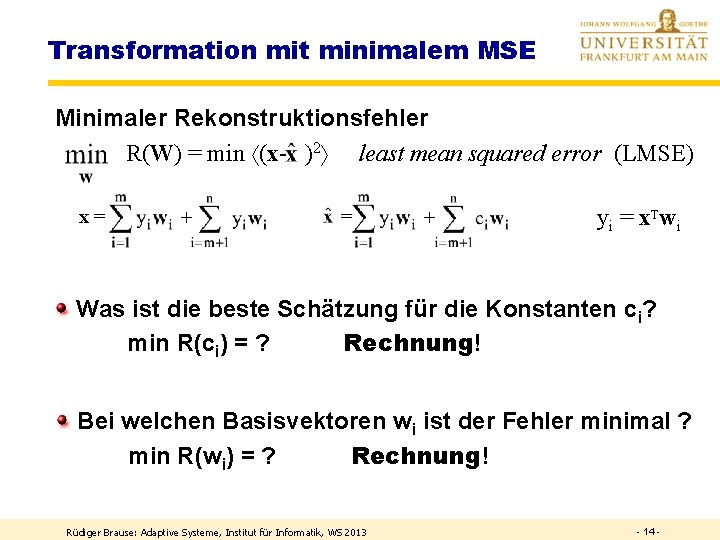

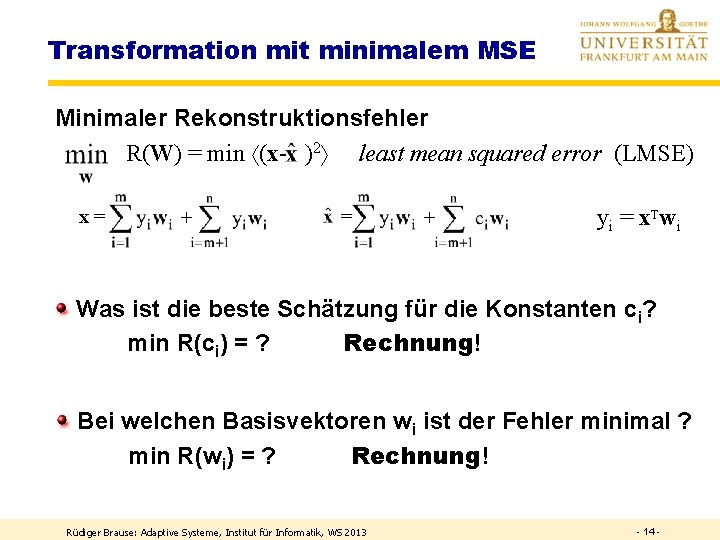

Transformation mit minimalem MSE Minimaler Rekonstruktionsfehler R(W) = min (x- )2 least mean squared error (LMSE) x= + yi = x. Twi Was ist die beste Schätzung für die Konstanten ci? min R(ci) = ? Rechnung! Bei welchen Basisvektoren wi ist der Fehler minimal ? min R(wi) = ? Rechnung! Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 14 -

FRAGE Angenommen, {x} bildet einen Hyperelipsoid. § In welche Richtung gehen die beiden Eigenvektoren? § Wie groß sind die Eigenwerte dazu? Angenommen, {x} bildet eine Hyperkugel mit s 2 = 1. § In welche Richtung gehen die Eigenvektoren? § Wie groß sind die Eigenwerte dazu? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 15 -

PCA-Transformation Transform Coding PCA-Netze Weissen ICA-Transformation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 16 -

Transform coding – Wozu? Verlustfreie Kodierung: Max 1: 2 (Zip). Unnötig bei Telekommunikation (z. B. Bildtelefon) Satellitenübertragung (z. B. Wettersatelliten etc. ) Bilddatenbanken (z. B. Umweltdaten, Medizindaten, Industrieteile, Teleshopping etc. ) Digitale Musik (MP 3) Hochauflösendes Fernsehen (HDTV) Allgemein: Multi-Media Daten (MPEG 7) Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 17 -

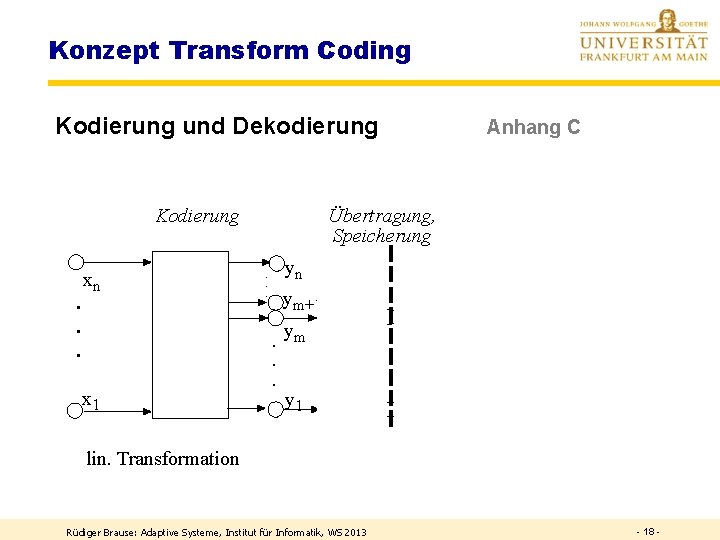

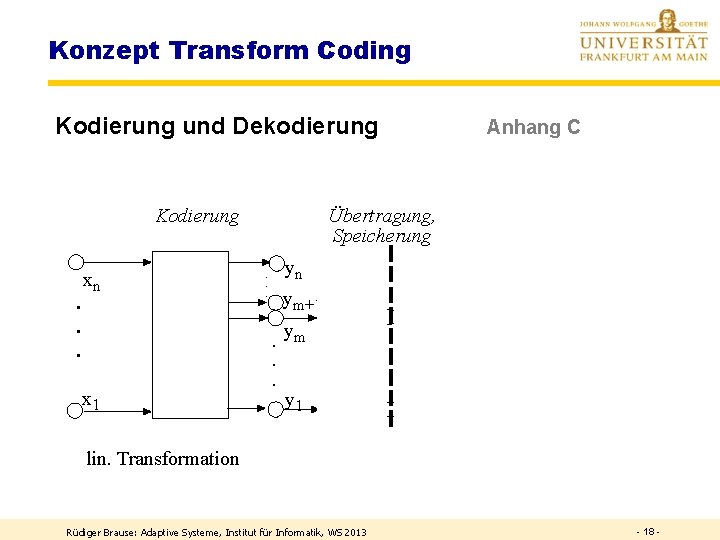

Konzept Transform Coding Kodierung und Dekodierung Kodierung xn · · · x 1 lin. Transformation Anhang C Übertragung, Speicherung Dekodierung yn · · · ^ xn ym+1 · · · ym y 1 · · · Vektorquantisierung · · · ym · · · y 1 ^ x 1 codebook ookup lin. Transformation Klassenprototypen Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 18 -

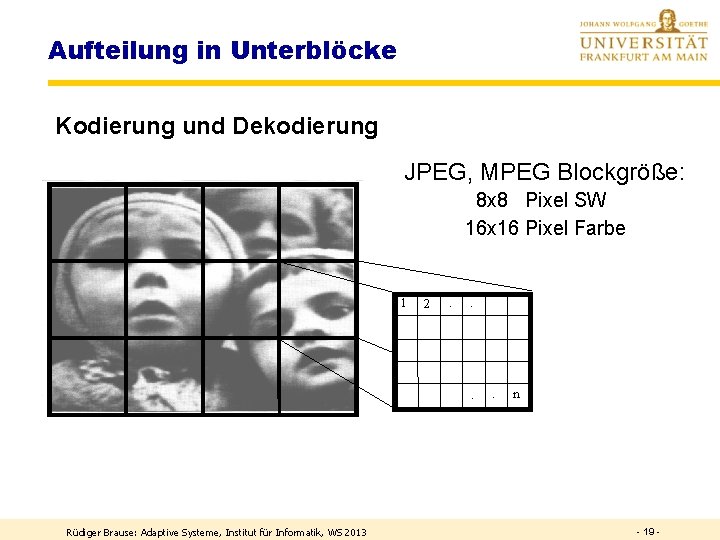

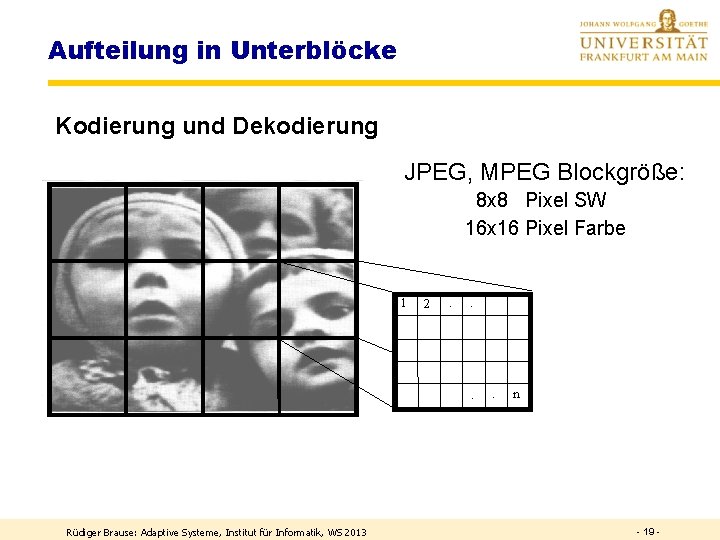

Aufteilung in Unterblöcke Kodierung und Dekodierung JPEG, MPEG Blockgröße: 8 x 8 Pixel SW 16 x 16 Pixel Farbe Schicht 1 2 . y . 1 x · · · Y y. Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 . n m - 19 -

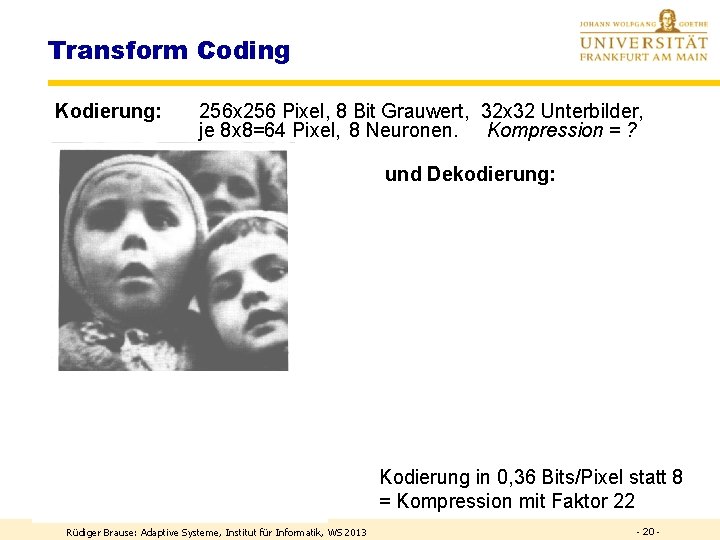

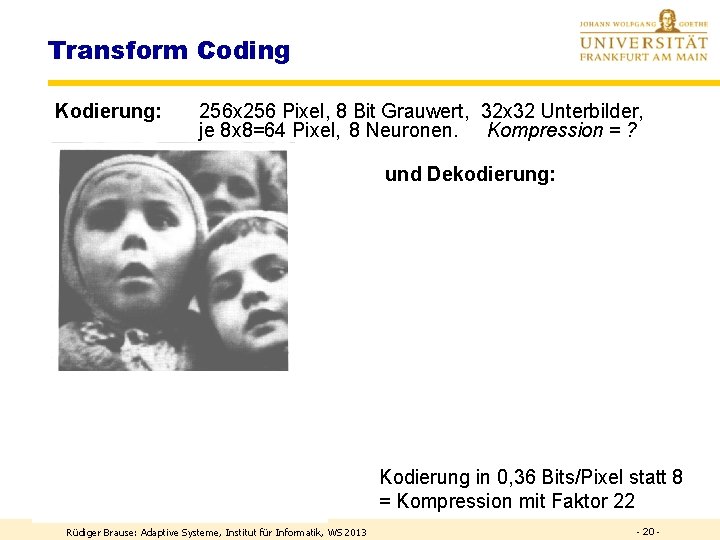

Transform Coding Kodierung: 256 x 256 Pixel, 8 Bit Grauwert, 32 x 32 Unterbilder, je 8 x 8=64 Pixel, 8 Neuronen. Kompression = ? und Dekodierung: e 1 e 2 e 3 e 4 e 5 e 6 e 7 e 8 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 Kodierung in 0, 36 Bits/Pixel statt 8 = Kompression mit Faktor 22 - 20 -

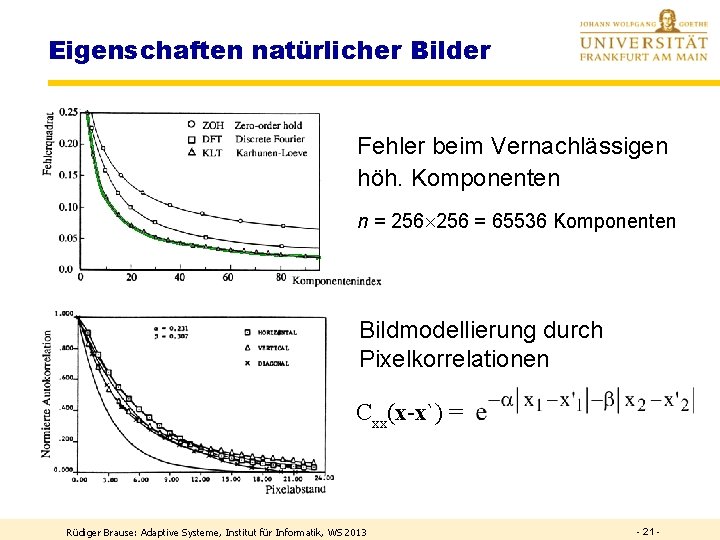

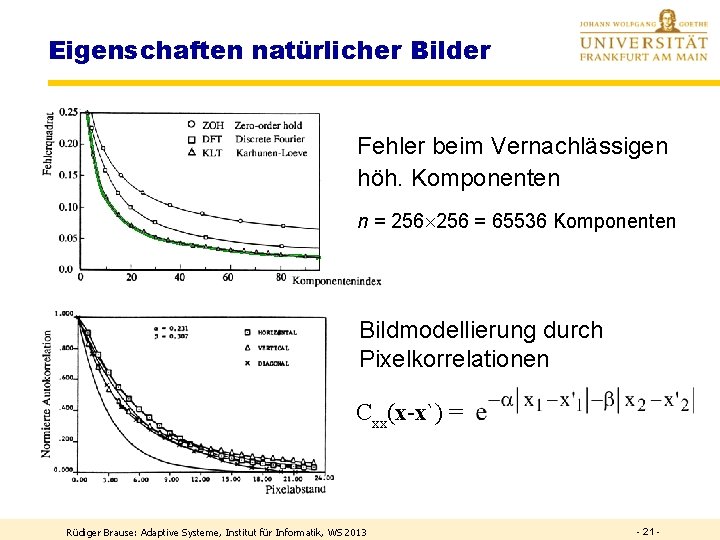

Eigenschaften natürlicher Bilder Fehler beim Vernachlässigen höh. Komponenten n = 256 = 65536 Komponenten Bildmodellierung durch Pixelkorrelationen Cxx(x-x`) = Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 21 -

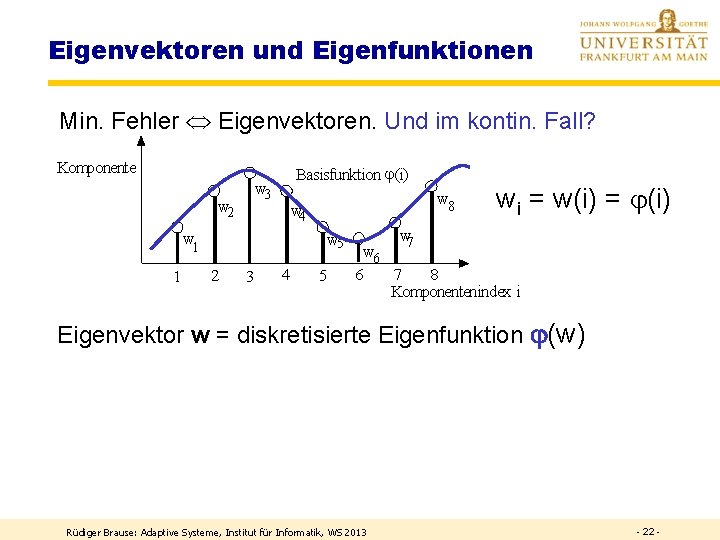

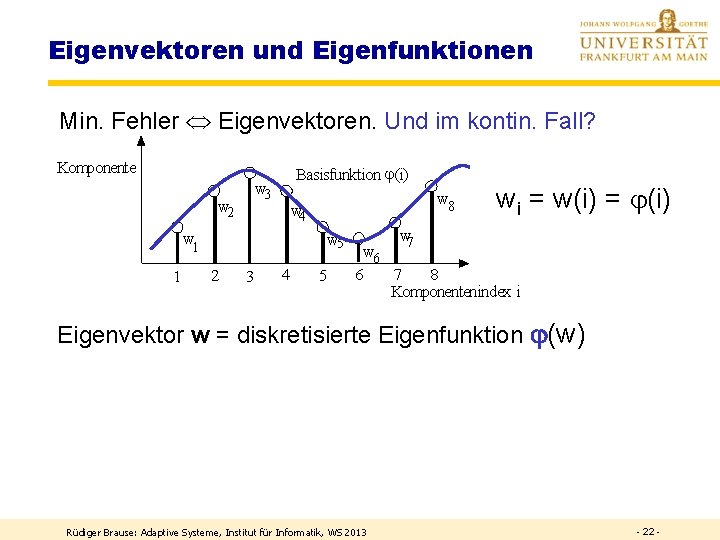

Eigenvektoren und Eigenfunktionen Min. Fehler Eigenvektoren. Und im kontin. Fall? Komponente w 2 Basisfunktion (i) w 3 w 1 1 w 8 w 4 w 5 2 3 4 5 wi = w(i) = (i) w 7 w 6 7 8 6 Komponentenindex i Eigenvektor w = diskretisierte Eigenfunktion (w) Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 22 -

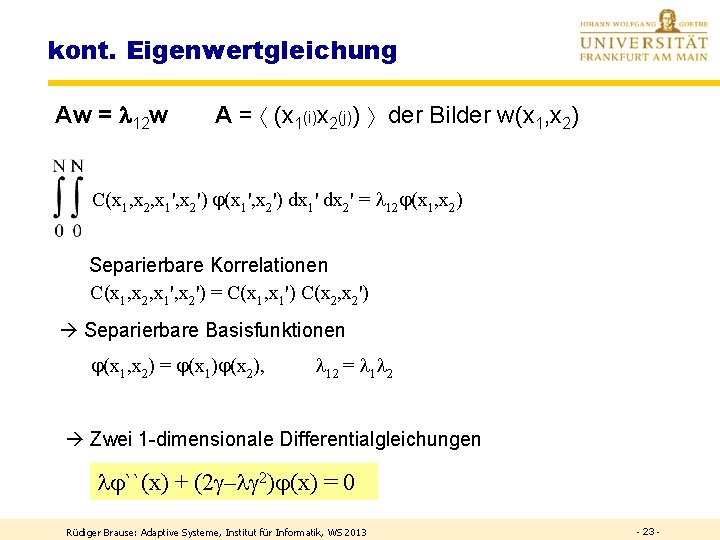

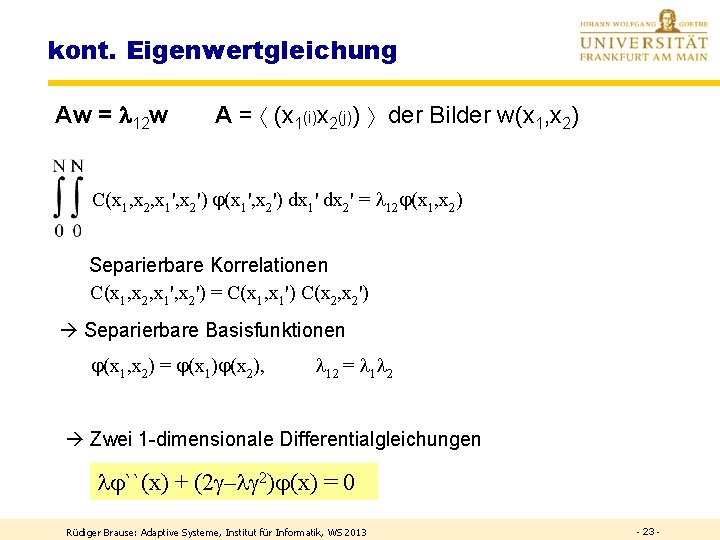

kont. Eigenwertgleichung Aw = 12 w A = (x 1(i)x 2(j)) der Bilder w(x 1, x 2) C(x 1, x 2, x 1', x 2') (x 1', x 2') dx 1' dx 2' = 12 (x 1, x 2) Separierbare Korrelationen C(x 1, x 2, x 1', x 2') = C(x 1, x 1') C(x 2, x 2') Separierbare Basisfunktionen (x 1, x 2) = (x 1) (x 2), 12 = 1 2 Zwei 1 -dimensionale Differentialgleichungen ``(x) + (2 – 2) (x) = 0 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 23 -

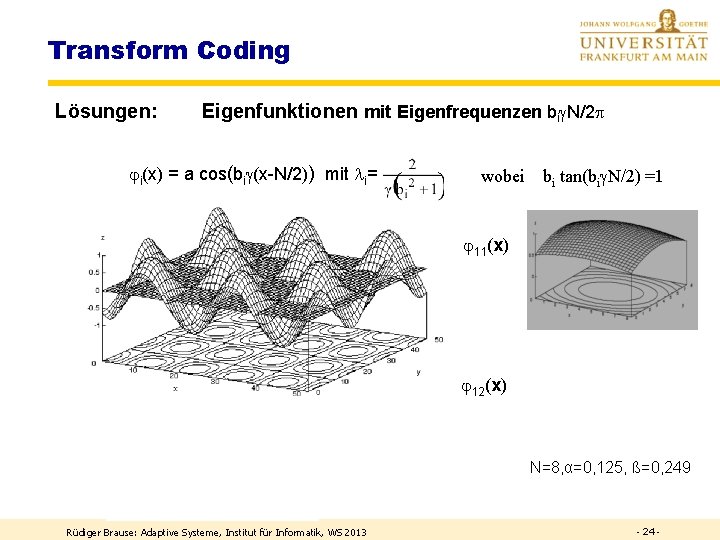

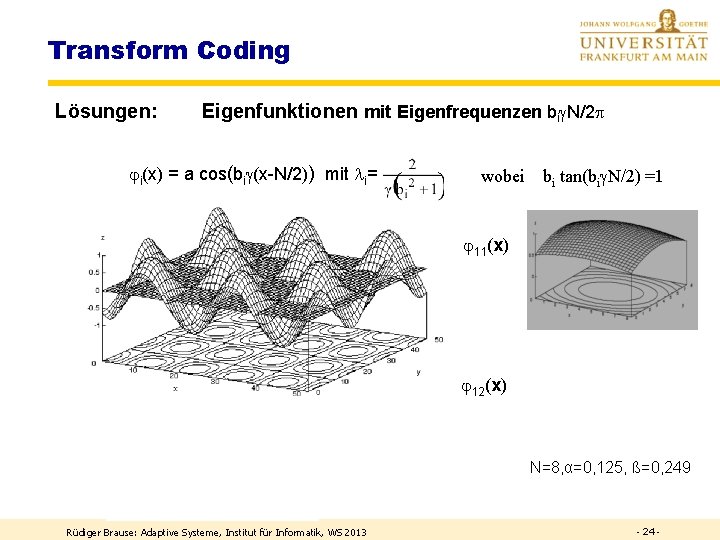

Transform Coding Lösungen: Eigenfunktionen mit Eigenfrequenzen bi N/2 i(x) = a cos(bi (x-N/2)) mit i= wobei bi tan(bi N/2) =1 11(x) e 1 e 2 e 3 e 4 12(x) N=8, α=0, 125, ß=0, 249 e 5 e 6 e 7 e 8 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 24 -

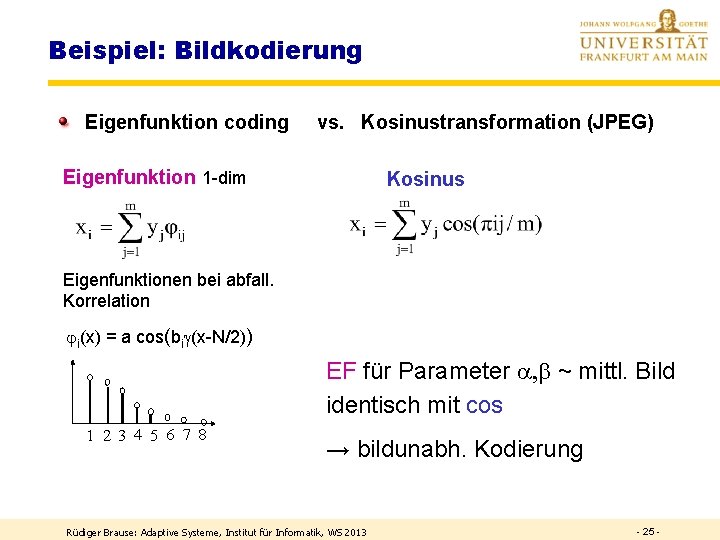

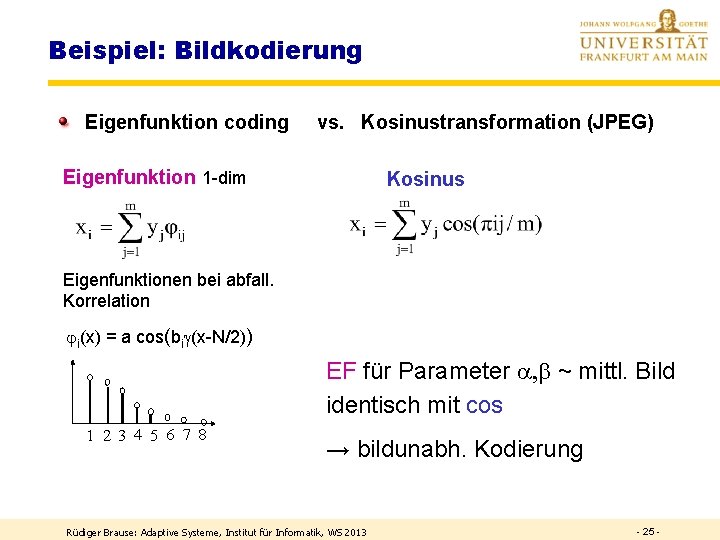

Beispiel: Bildkodierung Eigenfunktion coding vs. Kosinustransformation (JPEG) Eigenfunktion 1 -dim Kosinus Eigenfunktionen bei abfall. Korrelation i(x) = a cos(bi (x-N/2)) EF für Parameter a, b ~ mittl. Bild identisch mit cos 1 23 4 5 6 7 8 → bildunabh. Kodierung Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 25 -

PCA-Transformation Transform Coding PCA-Netze Weissen ICA-Transformation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 26 -

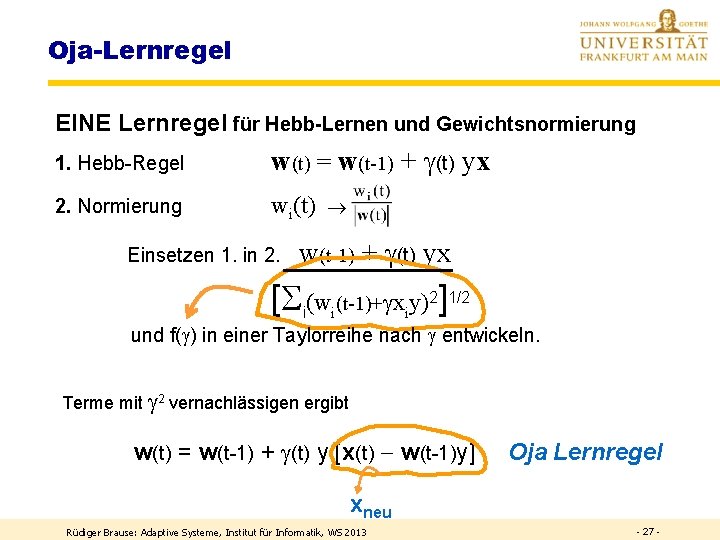

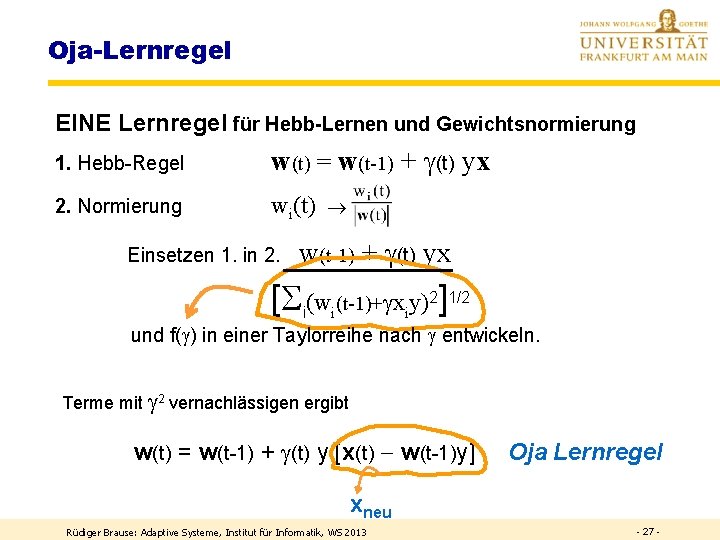

Oja-Lernregel EINE Lernregel für Hebb-Lernen und Gewichtsnormierung 1. Hebb-Regel w(t) = w(t-1) + (t) yx 2. Normierung wi(t) Einsetzen 1. in 2. w(t-1) + (t) yx [ i(wi(t-1)+ xiy)2]1/2 und f( ) in einer Taylorreihe nach entwickeln. Terme mit 2 vernachlässigen ergibt w(t) = w(t-1) + (t) y [x(t) w(t-1)y] Oja Lernregel xneu Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 27 -

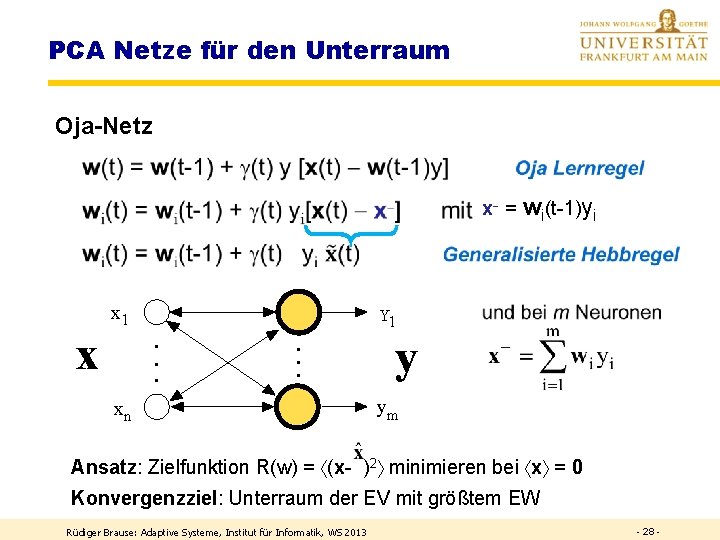

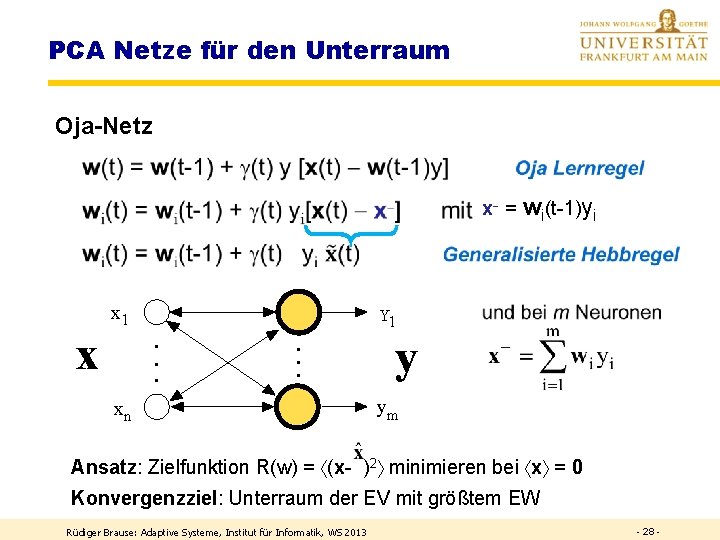

PCA Netze für den Unterraum Oja-Netz x = wi(t-1)yi x x 1 Y 1 · · · xn y ym Ansatz: Zielfunktion R(w) = (x- )2 minimieren bei x = 0 Konvergenzziel: Unterraum der EV mit größtem EW Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 28 -

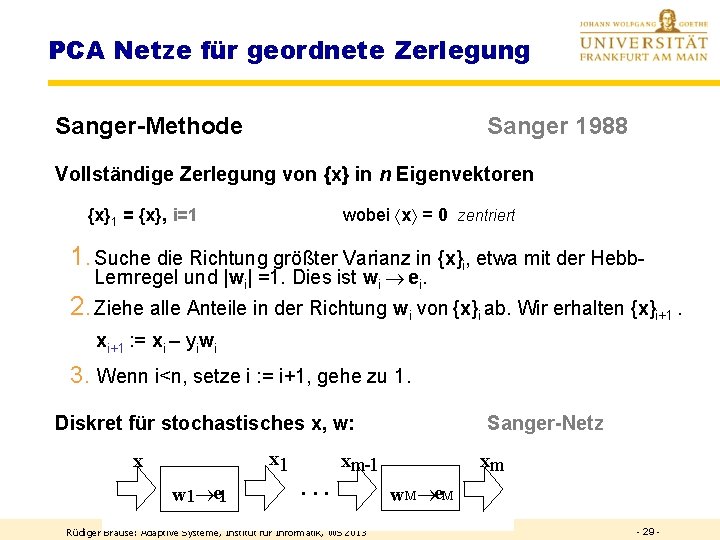

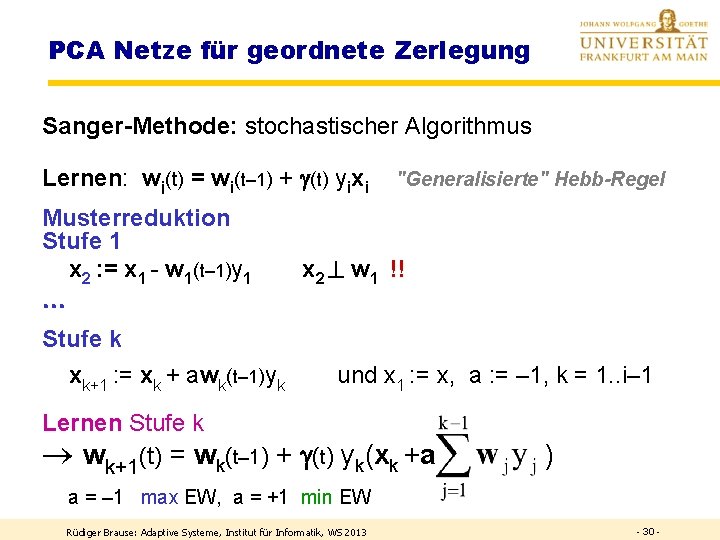

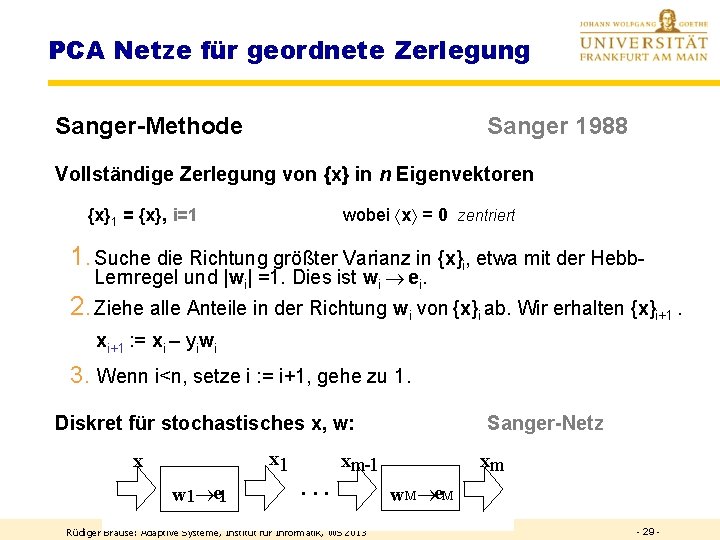

PCA Netze für geordnete Zerlegung Sanger-Methode Sanger 1988 Vollständige Zerlegung von {x} in n Eigenvektoren {x}1 = {x}, i=1 wobei x = 0 zentriert 1. Suche die Richtung größter Varianz in {x}i, etwa mit der Hebb. Lernregel und |wi| =1. Dies ist wi ei. 2. Ziehe alle Anteile in der Richtung wi von {x}i ab. Wir erhalten {x}i+1. xi+1 : = xi – yiwi 3. Wenn i<n, setze i : = i+1, gehe zu 1. Diskret für stochastisches x, w: x 1 x w 1 e 1 Sanger-Netz xm-1 ··· Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 xm w. M e. M - 29 -

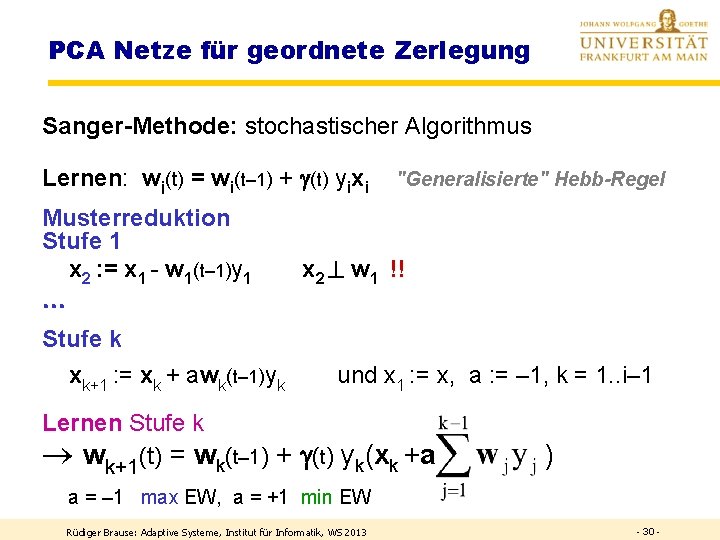

PCA Netze für geordnete Zerlegung Sanger-Methode: stochastischer Algorithmus Lernen: wi(t) = wi(t– 1) + (t) yixi "Generalisierte" Hebb-Regel Musterreduktion Stufe 1 x 2 : = x 1 - w 1(t– 1)y 1 x 2 w 1 !! Stufe k xk+1 : = xk + awk(t– 1)yk und x 1 : = x, a : = – 1, k = 1. . i– 1 Lernen Stufe k wk+1(t) = wk(t– 1) + (t) yk(xk +a ) a = – 1 max EW, a = +1 min EW Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 30 -

PCA-Transformation Transform Coding PCA-Netze Weissen ICA-Transformation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 31 -

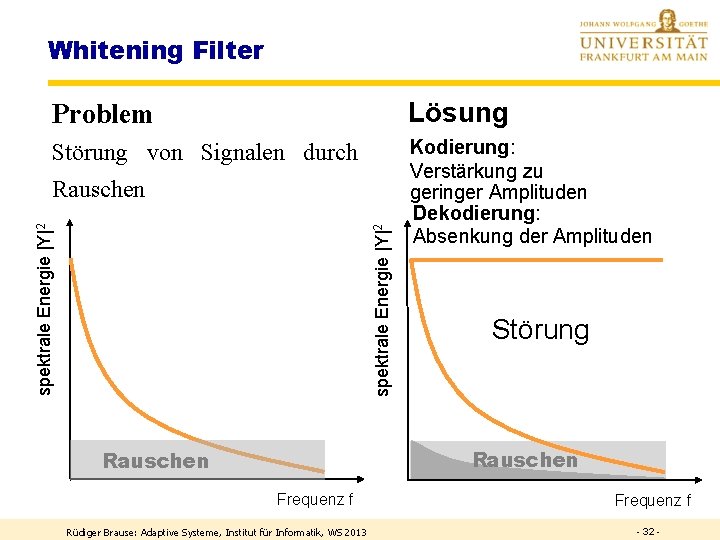

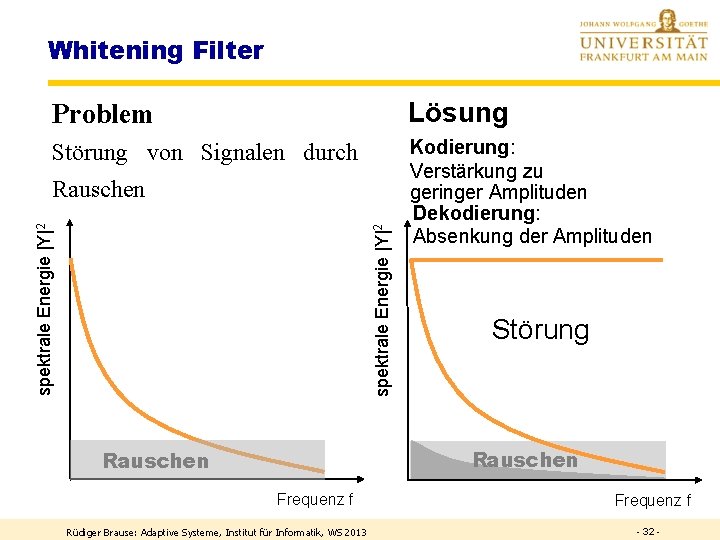

Whitening Filter Problem Lösung Störung von Signalen durch Kodierung: Verstärkung zu geringer Amplituden Dekodierung: Absenkung der Amplituden spektrale Energie |Y|2 Rauschen Störung Rauschen Frequenz f Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 Frequenz f - 32 -

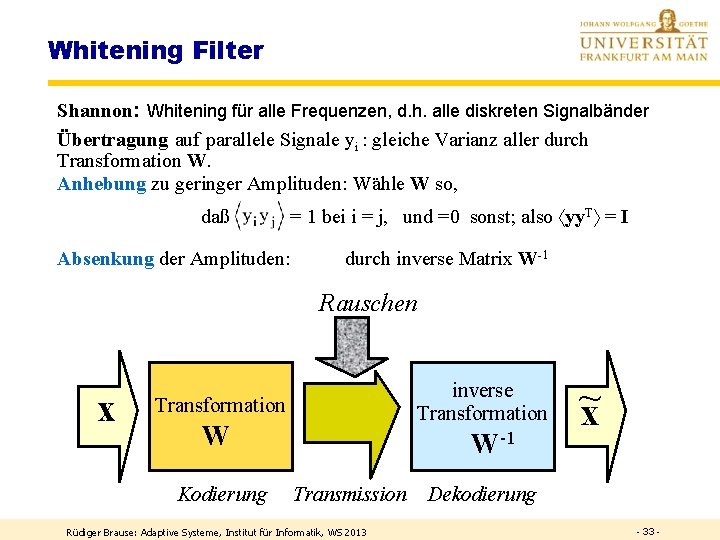

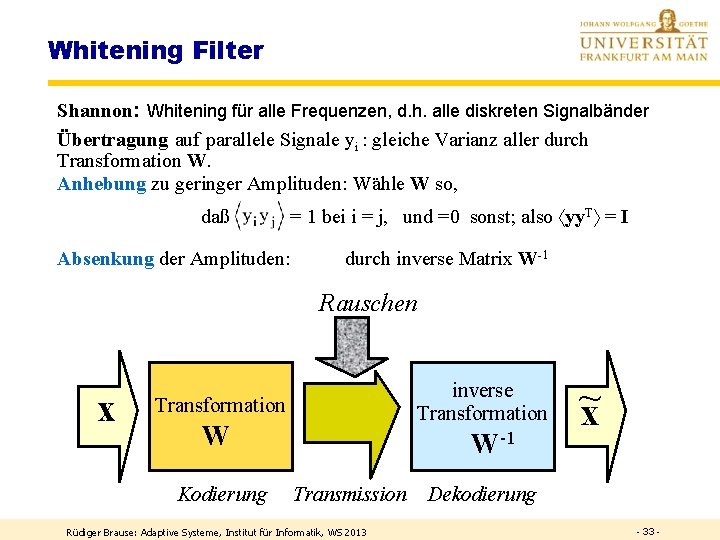

Whitening Filter Shannon: Whitening für alle Frequenzen, d. h. alle diskreten Signalbänder Übertragung auf parallele Signale yi : gleiche Varianz aller durch Transformation W. Anhebung zu geringer Amplituden: Wähle W so, daß = 1 bei i = j, und =0 sonst; also yy. T = I Absenkung der Amplituden: durch inverse Matrix W-1 Rauschen x inverse Transformation W Kodierung W-1 Transmission Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 ~ x Dekodierung - 33 -

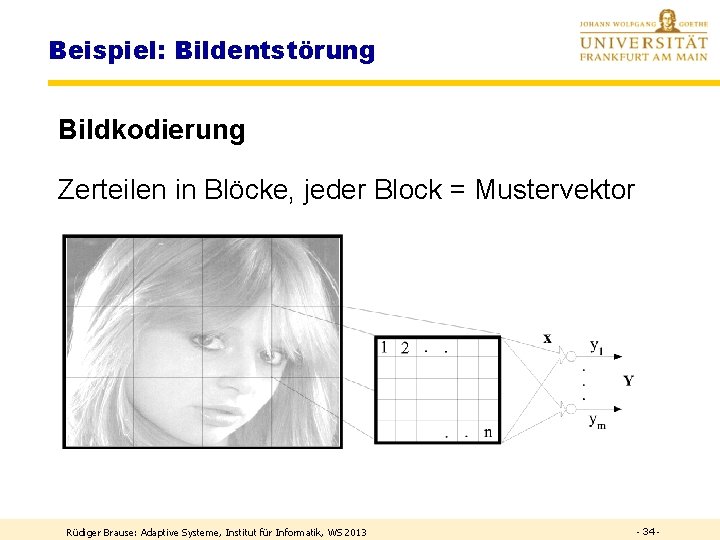

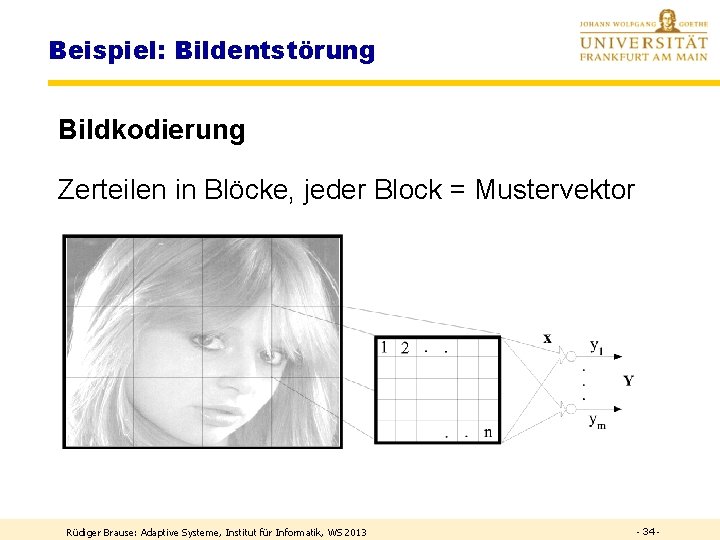

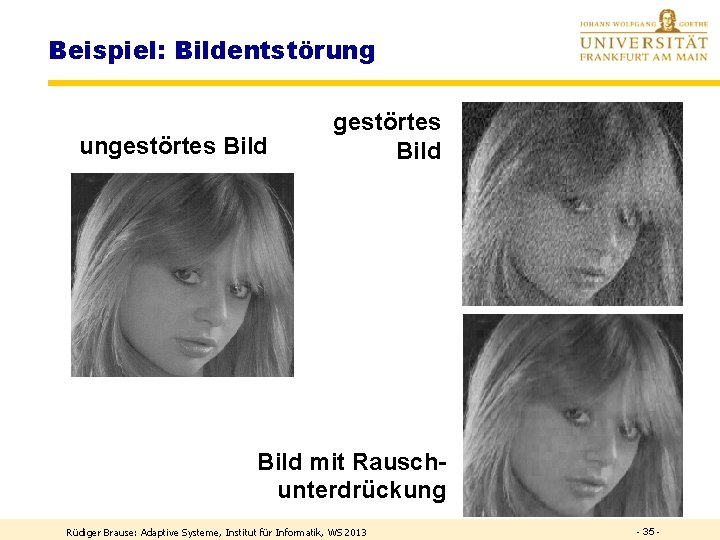

Beispiel: Bildentstörung Bildkodierung Zerteilen in Blöcke, jeder Block = Mustervektor Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 34 -

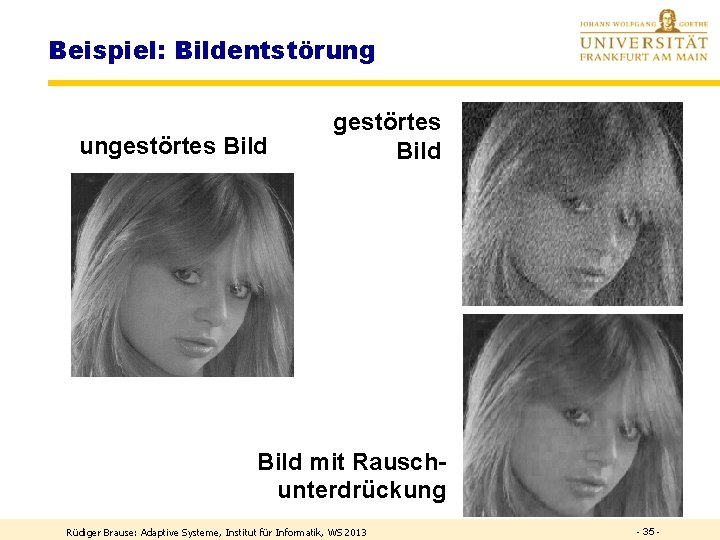

Beispiel: Bildentstörung ungestörtes Bild mit Rauschunterdrückung Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 35 -

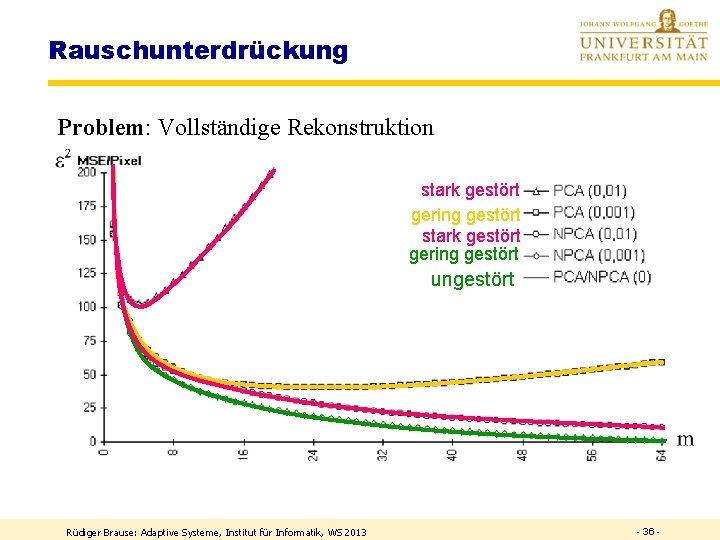

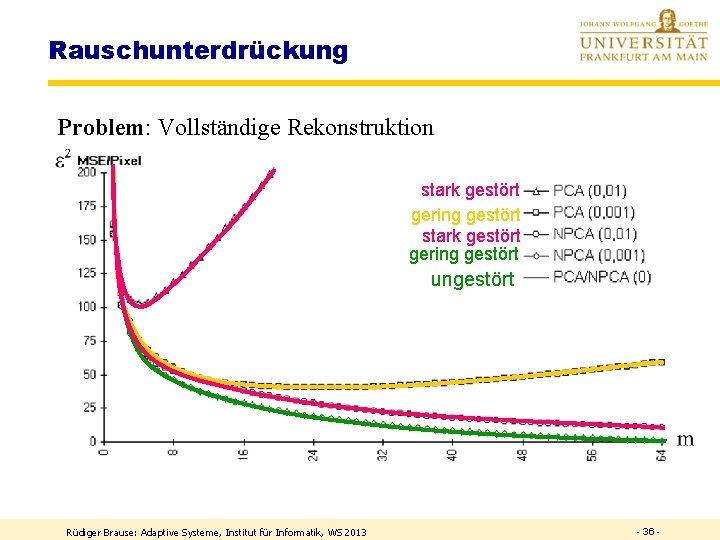

Rauschunterdrückung Problem: Vollständige Rekonstruktion stark gestört gering gestört ungestört Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 36 -

PCA-Transformation Transform Coding PCA-Netze Weissen ICA-Transformation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 37 -

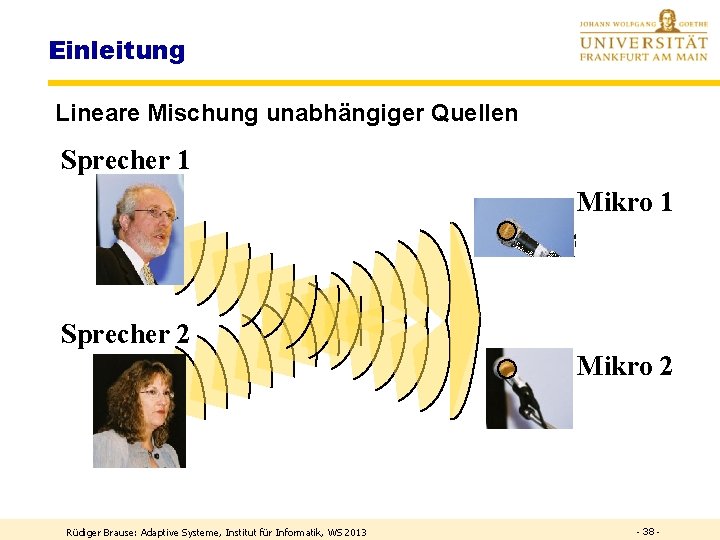

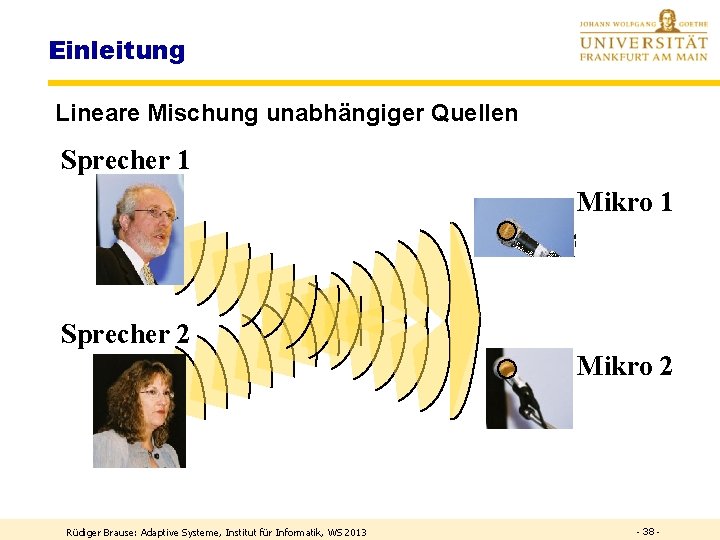

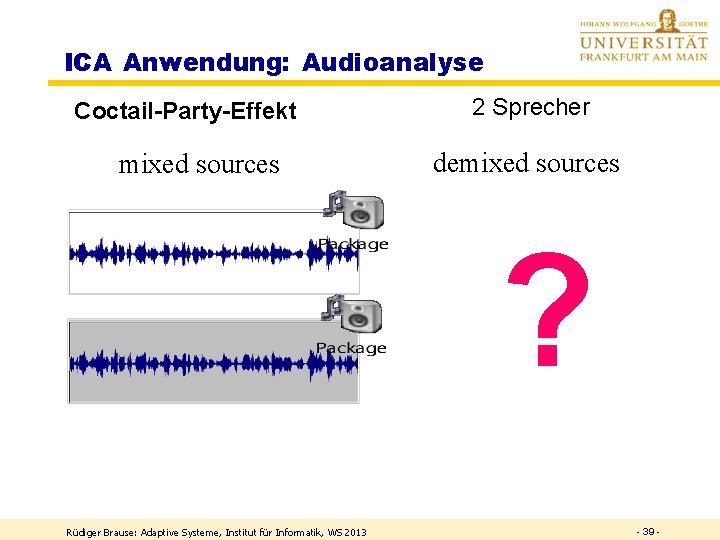

Einleitung Lineare Mischung unabhängiger Quellen Sprecher 1 Mikro 1 Sprecher 2 Mikro 2 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 38 -

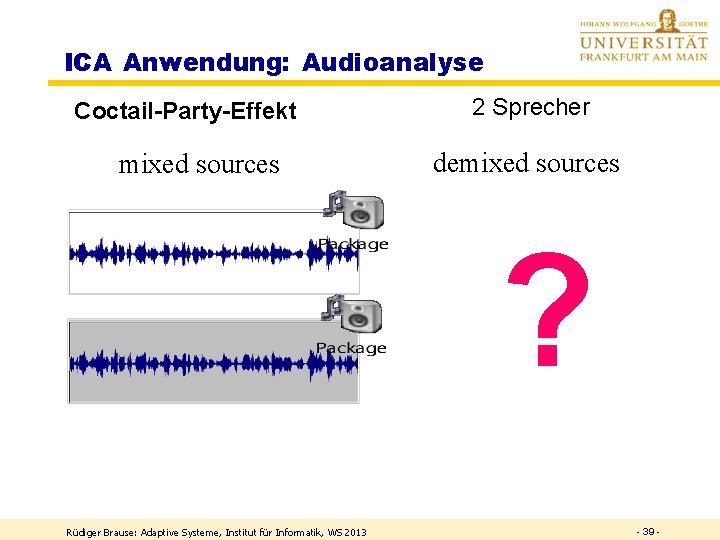

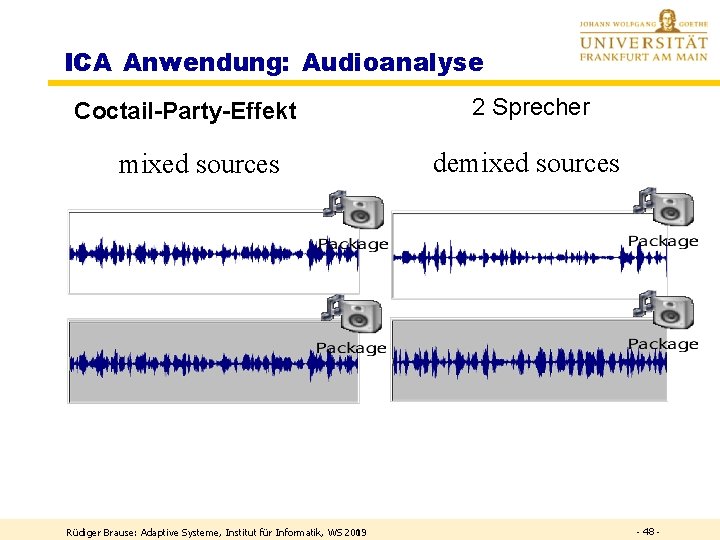

ICA Anwendung: Audioanalyse Coctail-Party-Effekt mixed sources 2 Sprecher demixed sources ? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 39 -

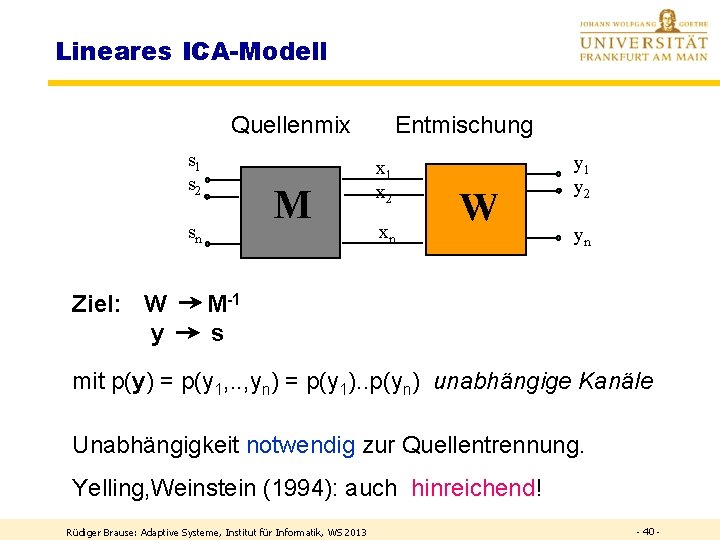

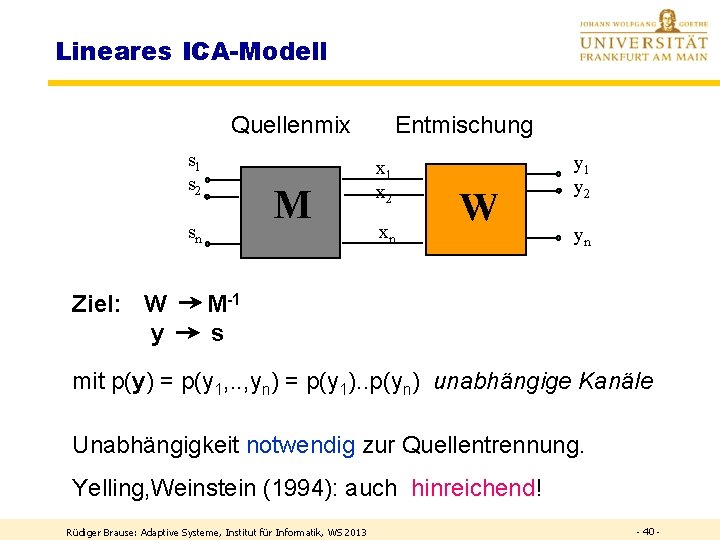

Lineares ICA-Modell Quellenmix s 1 s 2 sn M Entmischung x 1 x 2 xn W y 1 y 2 yn Ziel: W M-1 y s mit p(y) = p(y 1, . . , yn) = p(y 1). . p(yn) unabhängige Kanäle Unabhängigkeit notwendig zur Quellentrennung. Yelling, Weinstein (1994): auch hinreichend! Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 40 -

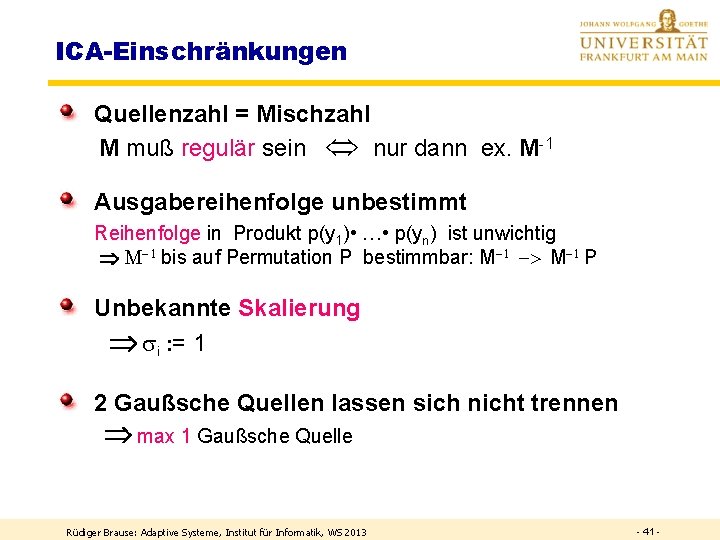

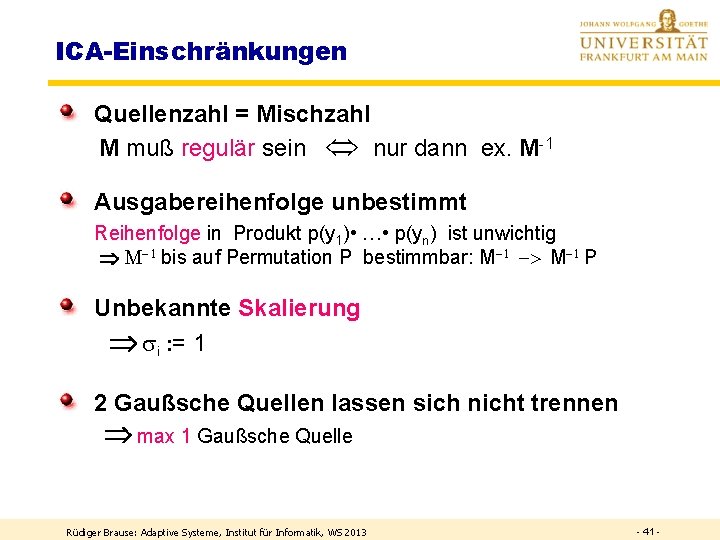

ICA-Einschränkungen Quellenzahl = Mischzahl M muß regulär sein nur dann ex. M-1 Ausgabereihenfolge unbestimmt Reihenfolge in Produkt p(y 1) • … • p(yn) ist unwichtig M 1 bis auf Permutation P bestimmbar: M 1 > M 1 P Unbekannte Skalierung si : = 1 2 Gaußsche Quellen lassen sich nicht trennen max 1 Gaußsche Quelle Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 41 -

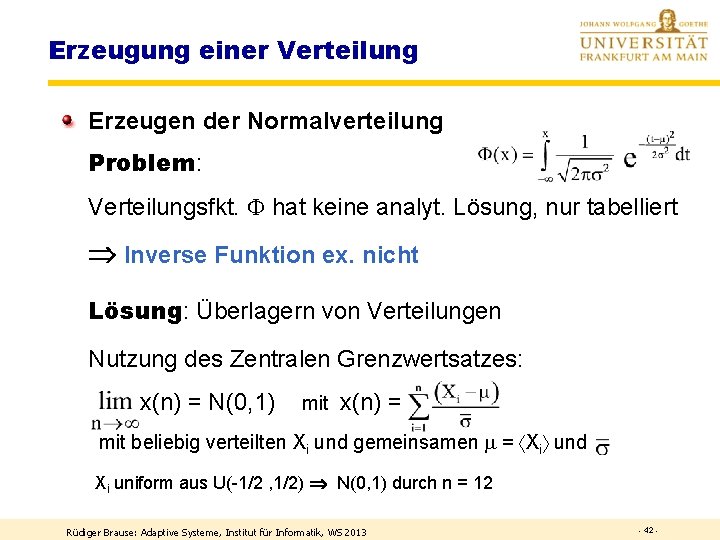

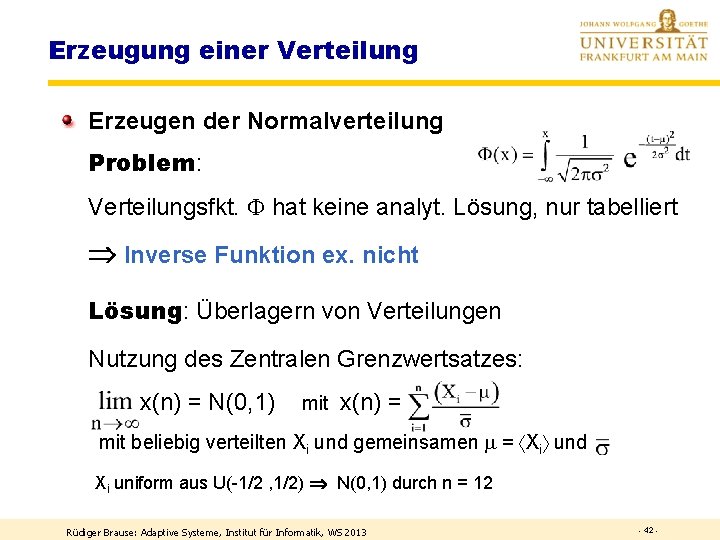

Erzeugung einer Verteilung Erzeugen der Normalverteilung Problem: Verteilungsfkt. hat keine analyt. Lösung, nur tabelliert Inverse Funktion ex. nicht Lösung: Überlagern von Verteilungen Nutzung des Zentralen Grenzwertsatzes: x(n) = N(0, 1) mit x(n) = mit beliebig verteilten Xi und gemeinsamen m = Xi und Xi uniform aus U(-1/2 , 1/2) N(0, 1) durch n = 12 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 42 -

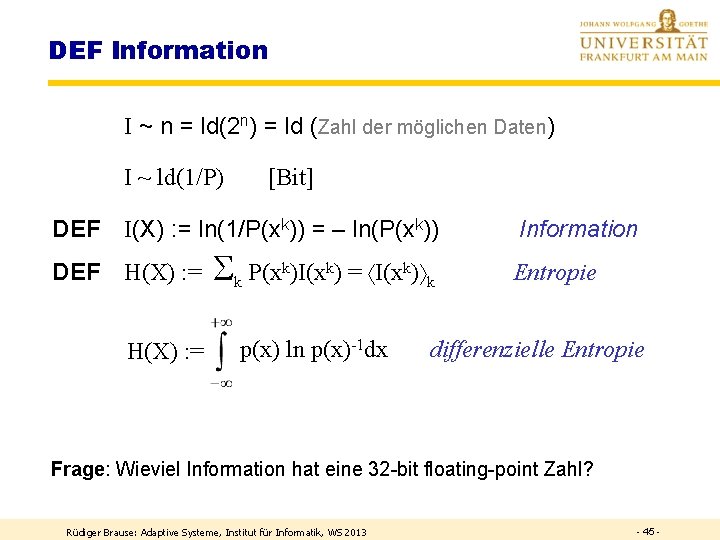

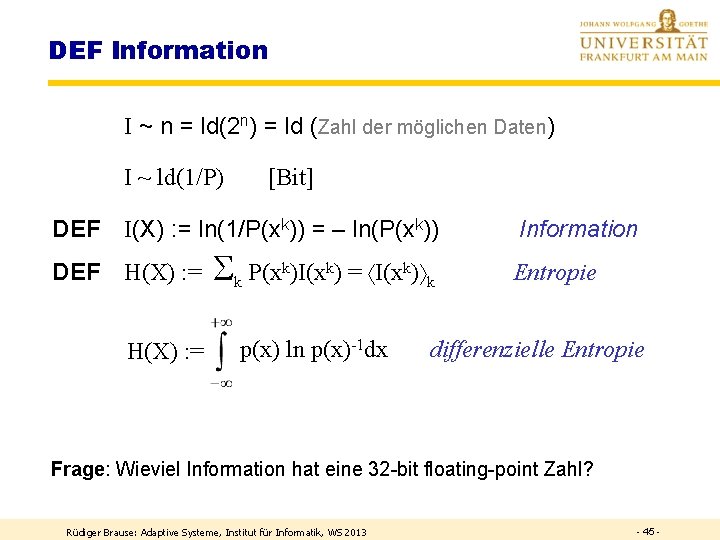

DEF Information I ~ n = ld(2 n) = ld (Zahl der möglichen Daten) I ~ ld(1/P) [Bit] DEF I(X) : = ln(1/P(xk)) = – ln(P(xk)) Information DEF H(X) : = k P(xk)I(xk) = I(xk) k Entropie H(X) : = p(x) ln p(x)-1 dx differenzielle Entropie Frage: Wieviel Information hat eine 32 -bit floating-point Zahl? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 45 -

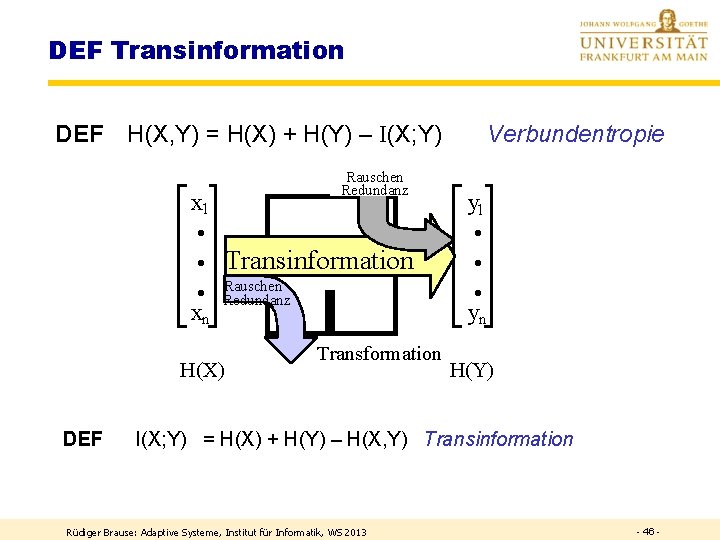

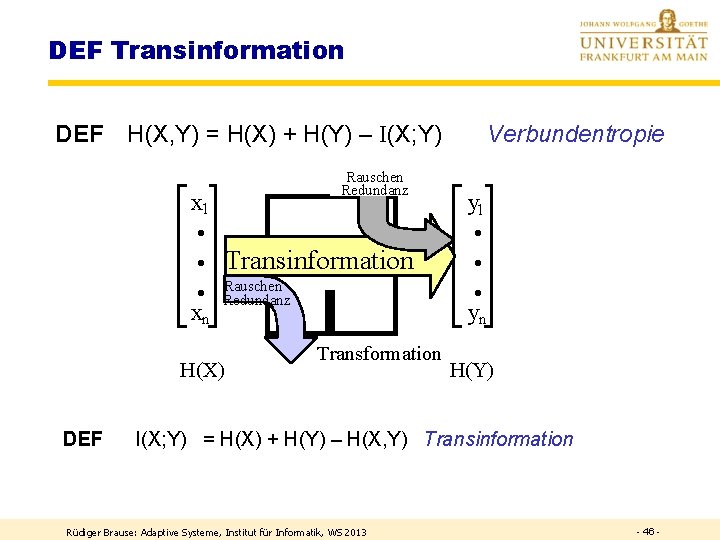

DEF Transinformation DEF H(X, Y) = H(X) + H(Y) – I(X; Y) Rauschen Redundanz x 1 · y 1 · · Transinformation · · Rauschen Redundanz · xn H(X) DEF Verbundentropie yn Transformation H(Y) I(X; Y) = H(X) + H(Y) – H(X, Y) Transinformation Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 46 -

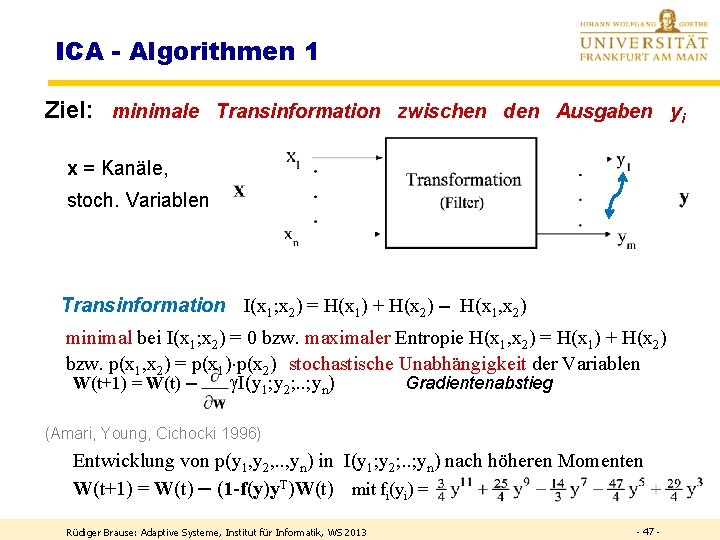

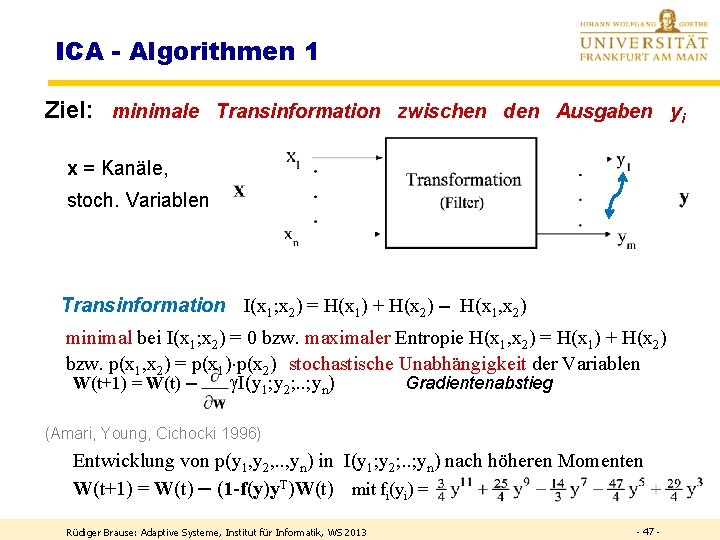

ICA - Algorithmen 1 Ziel: minimale Transinformation zwischen den Ausgaben yi - x = Kanäle, stoch. Variablen Transinformation I(x 1; x 2) = H(x 1) + H(x 2) – H(x 1, x 2) minimal bei I(x 1; x 2) = 0 bzw. maximaler Entropie H(x 1, x 2) = H(x 1) + H(x 2) bzw. p(x 1, x 2) = p(x 1) p(x 2) stochastische Unabhängigkeit der Variablen W(t+1) = W(t) – I(y 1; y 2; . . ; yn) Gradientenabstieg (Amari, Young, Cichocki 1996) Entwicklung von p(y 1, y 2, . . , yn) in I(y 1; y 2; . . ; yn) nach höheren Momenten W(t+1) = W(t) – (1 -f(y)y. T)W(t) mit fi(yi) = Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 47 -

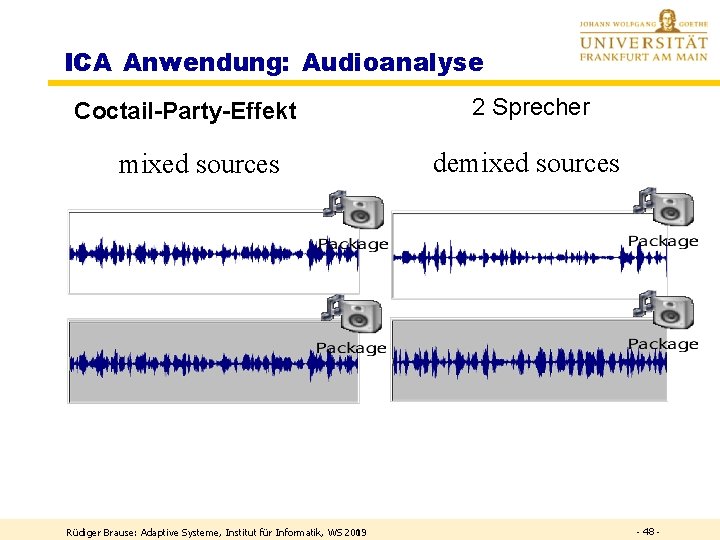

ICA Anwendung: Audioanalyse Coctail-Party-Effekt mixed sources Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 2009 2 Sprecher demixed sources - 48 -

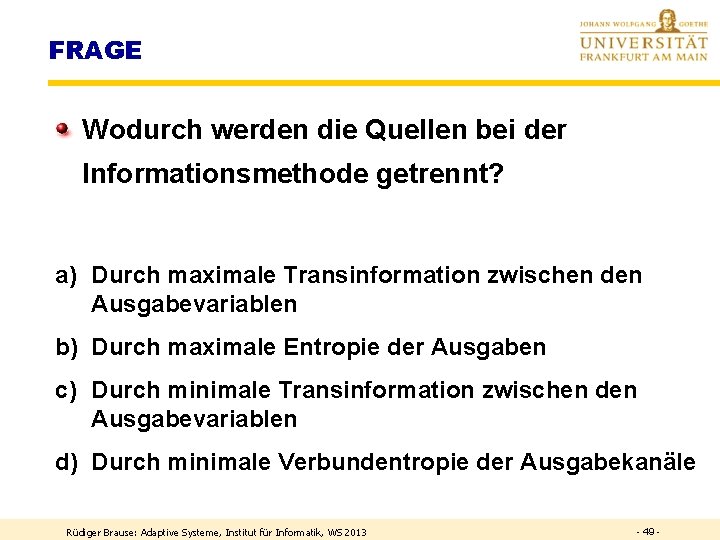

FRAGE Wodurch werden die Quellen bei der Informationsmethode getrennt? a) Durch maximale Transinformation zwischen den Ausgabevariablen b) Durch maximale Entropie der Ausgaben c) Durch minimale Transinformation zwischen den Ausgabevariablen d) Durch minimale Verbundentropie der Ausgabekanäle Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 49 -

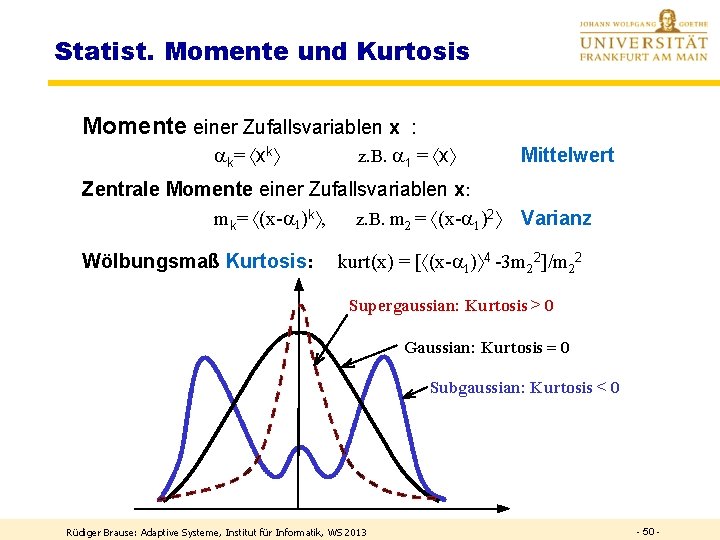

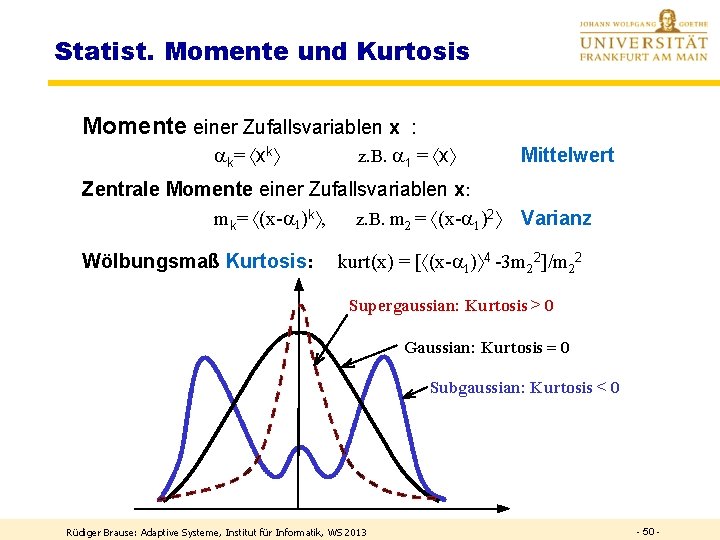

Statist. Momente und Kurtosis Momente einer Zufallsvariablen x : ak= xk z. B. a 1 = x Zentrale Momente einer Zufallsvariablen x: mk= (x-a 1)k , z. B. m 2 = (x-a 1)2 Wölbungsmaß Kurtosis: Mittelwert Varianz kurt(x) = [ (x-a 1) 4 -3 m 22]/m 22 Supergaussian: Kurtosis > 0 Gaussian: Kurtosis = 0 Subgaussian: Kurtosis < 0 Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 50 -

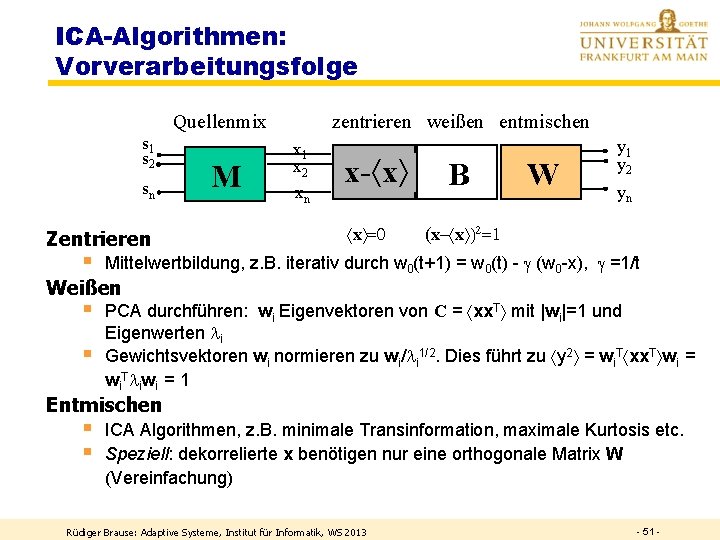

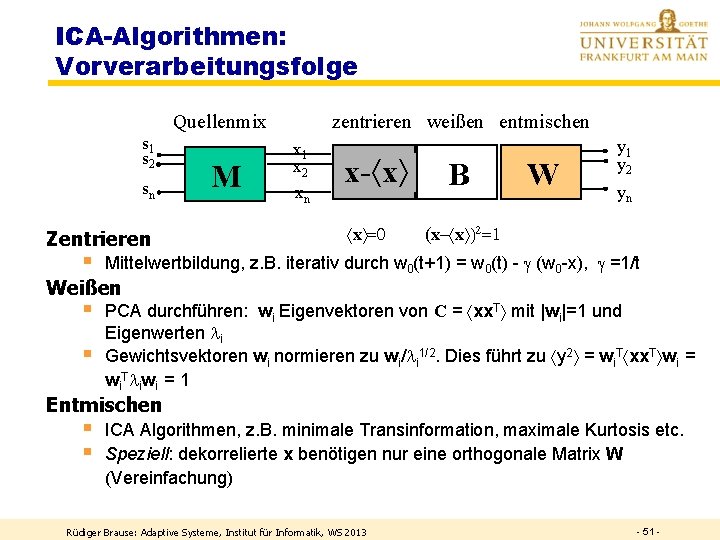

ICA-Algorithmen: Vorverarbeitungsfolge Quellenmix s 1 s 2 sn Zentrieren § M zentrieren weißen entmischen x 1 x 2 xn x- x x =0 B W y 1 y 2 yn (x x )2=1 Mittelwertbildung, z. B. iterativ durch w 0(t+1) = w 0(t) - (w 0 -x), =1/t Weißen § § PCA durchführen: wi Eigenvektoren von C = xx. T mit |wi|=1 und Eigenwerten i Gewichtsvektoren wi normieren zu wi/ i 1/2. Dies führt zu y 2 = wi. T xx. T wi = wi. T iwi = 1 Entmischen § § ICA Algorithmen, z. B. minimale Transinformation, maximale Kurtosis etc. Speziell: dekorrelierte x benötigen nur eine orthogonale Matrix W (Vereinfachung) Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 51 -

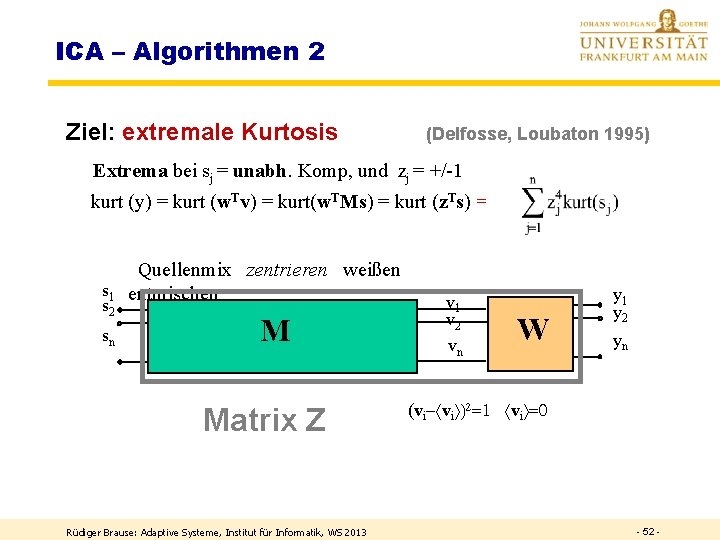

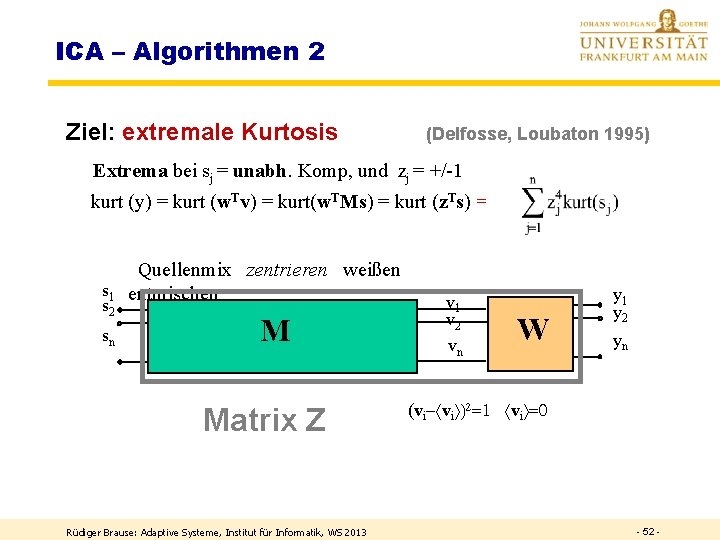

ICA – Algorithmen 2 Ziel: extremale Kurtosis (Delfosse, Loubaton 1995) Extrema bei sj = unabh. Komp, und zj = +/-1 kurt (y) = kurt (w. Tv) = kurt(w. TMs) = kurt (z. Ts) = Quellenmix zentrieren weißen s 1 entmischen s 2 sn M Matrix Z Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 v 1 v 2 vn W y 1 y 2 yn (vi vi )2=1 vi =0 - 52 -

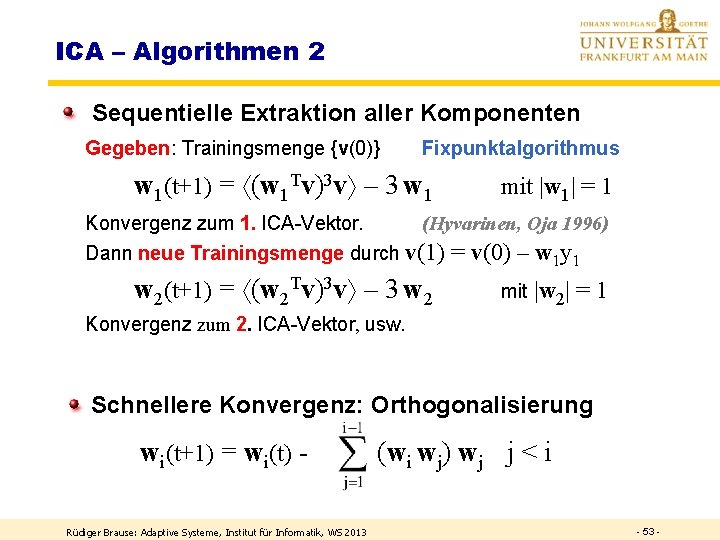

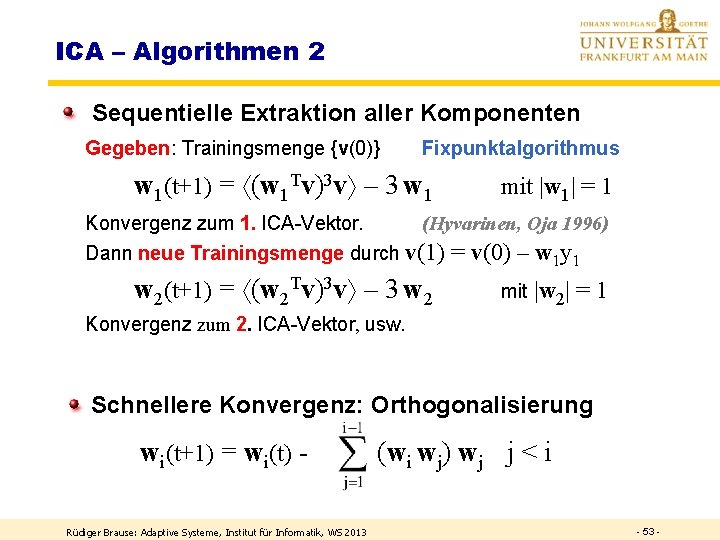

ICA – Algorithmen 2 Sequentielle Extraktion aller Komponenten Gegeben: Trainingsmenge {v(0)} Fixpunktalgorithmus w 1(t+1) = (w 1 Tv)3 v – 3 w 1 mit |w 1| = 1 Konvergenz zum 1. ICA-Vektor. (Hyvarinen, Oja 1996) Dann neue Trainingsmenge durch v(1) = v(0) – w 1 y 1 w 2(t+1) = (w 2 Tv)3 v – 3 w 2 mit |w 2| = 1 Konvergenz zum 2. ICA-Vektor, usw. Schnellere Konvergenz: Orthogonalisierung wi(t+1) = wi(t) Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 (wi wj) wj j < i - 53 -

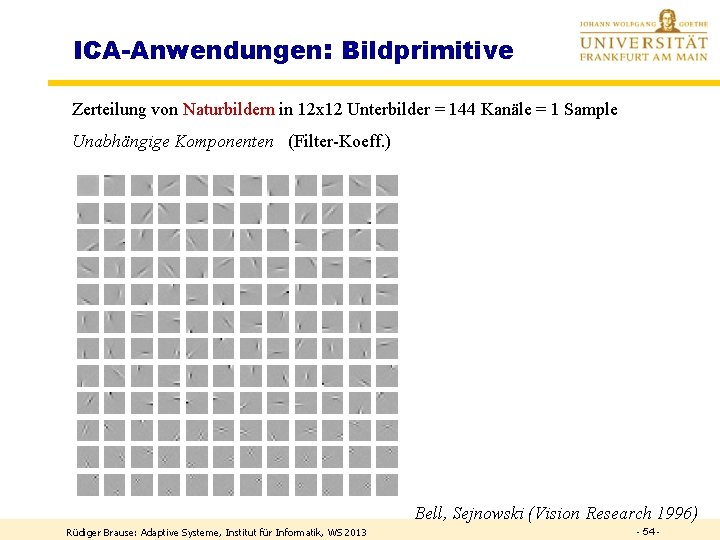

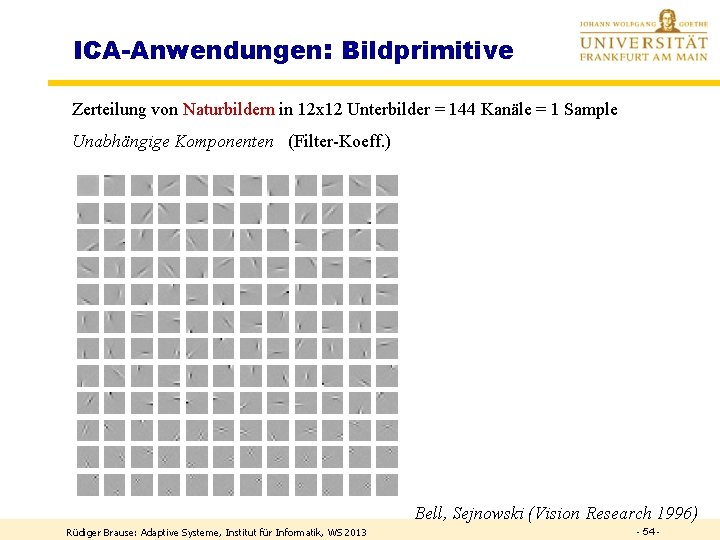

ICA-Anwendungen: Bildprimitive Zerteilung von Naturbildern in 12 x 12 Unterbilder = 144 Kanäle = 1 Sample Unabhängige Komponenten (Filter-Koeff. ) Alternative Analyseverfahren Bell, Sejnowski (Vision Research 1996) Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 54 -

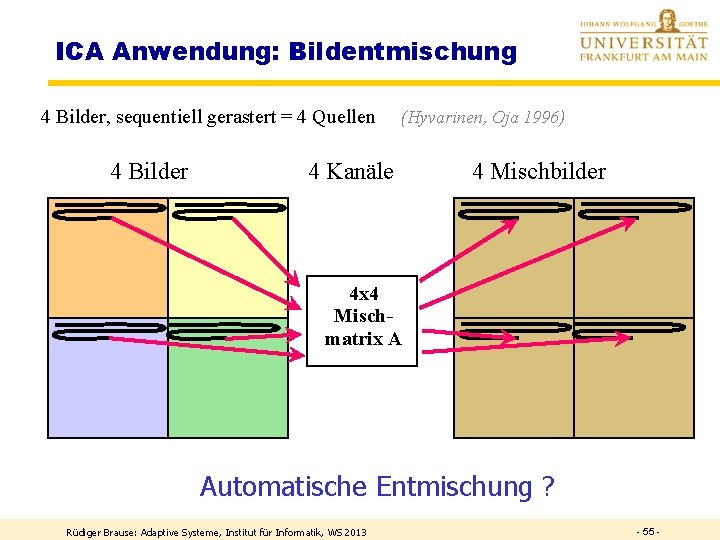

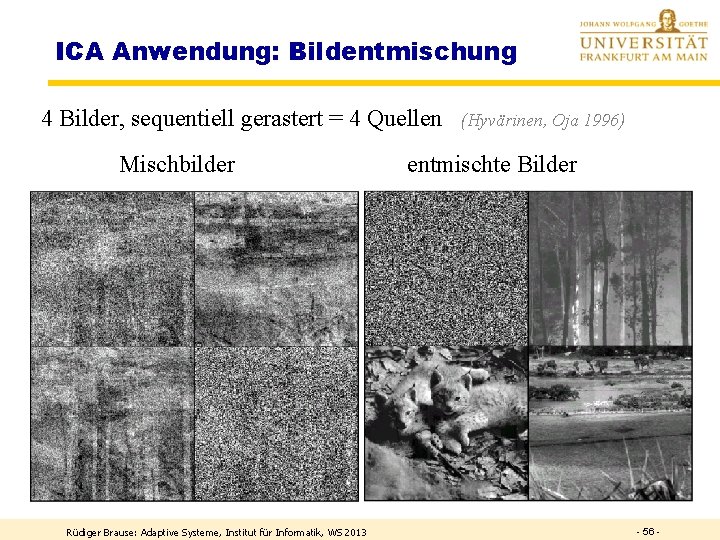

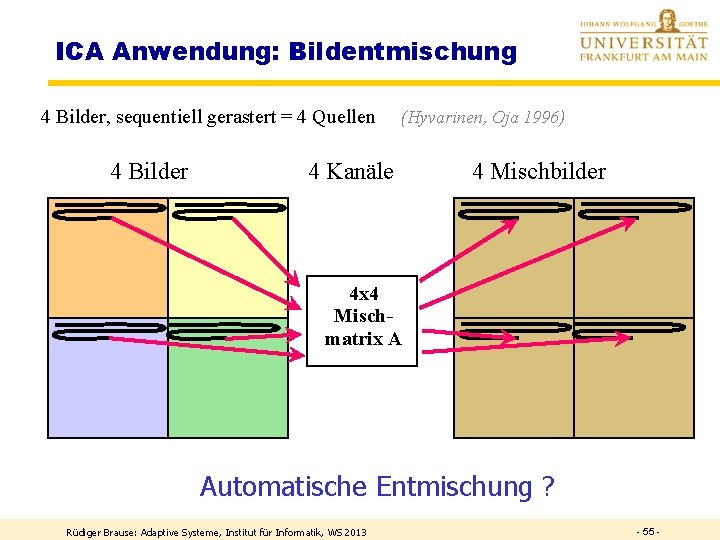

ICA Anwendung: Bildentmischung 4 Bilder, sequentiell gerastert = 4 Quellen 4 Bilder (Hyvarinen, Oja 1996) 4 Kanäle 4 Mischbilder 4 x 4 Mischmatrix A Automatische Entmischung ? Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 55 -

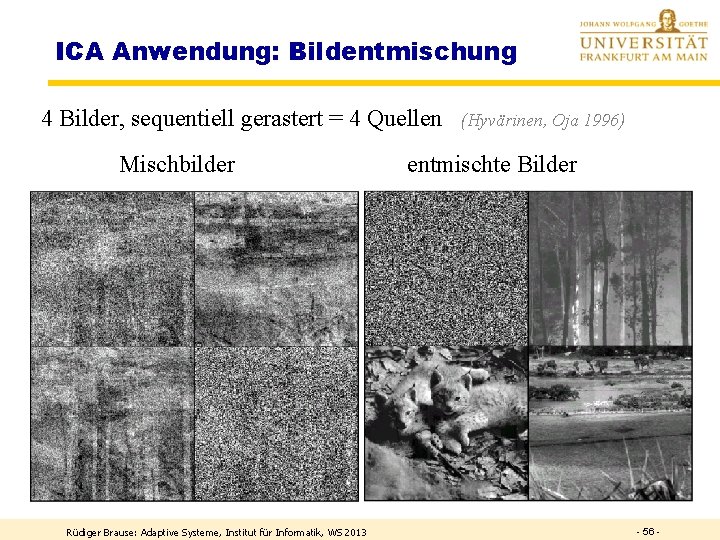

ICA Anwendung: Bildentmischung 4 Bilder, sequentiell gerastert = 4 Quellen Mischbilder Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 (Hyvärinen, Oja 1996) entmischte Bilder - 56 -

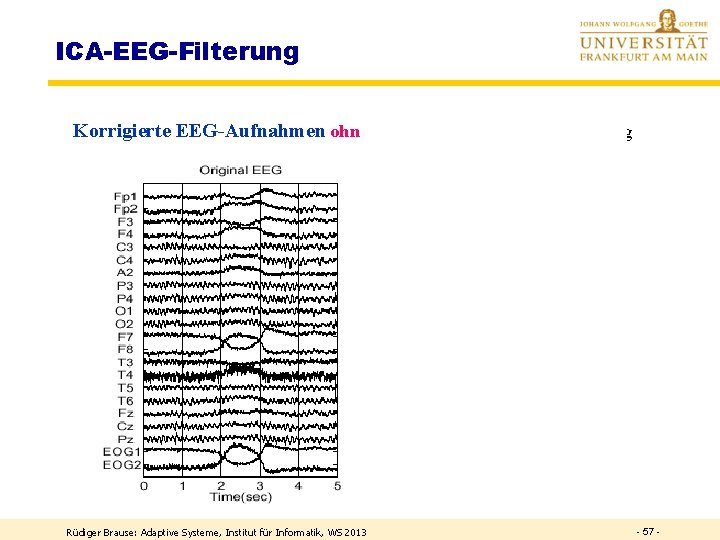

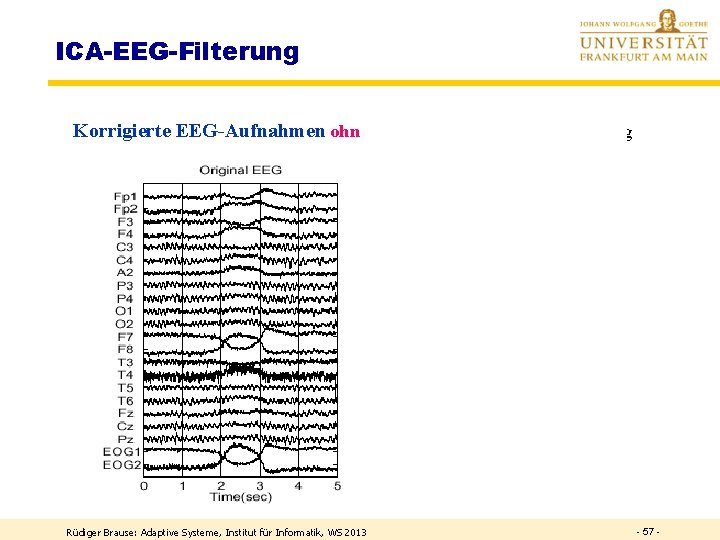

ICA-EEG-Filterung Korrigierte EEG-Aufnahmen ohne 5 ICA-Muskelaktivitäten, Mischung Rüdiger Brause: Adaptive Systeme, Institut für Informatik, WS 2013 - 57 -

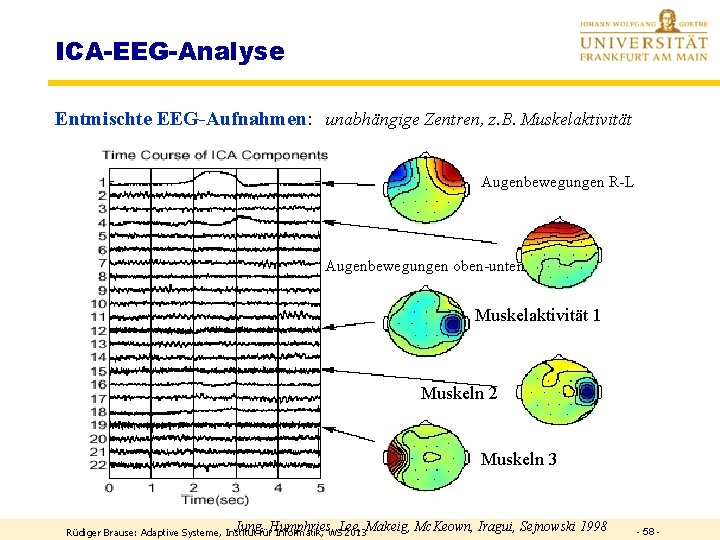

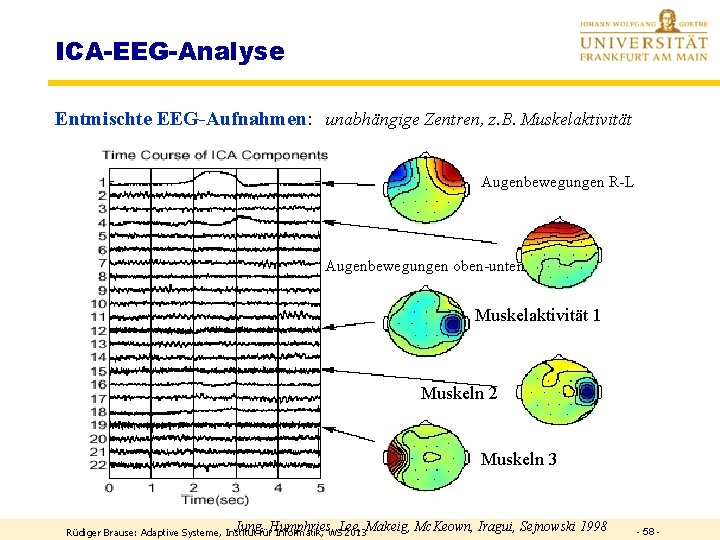

ICA-EEG-Analyse Entmischte EEG-Aufnahmen: unabhängige Zentren, z. B. Muskelaktivität Augenbewegungen R-L Augenbewegungen oben-unten Muskelaktivität 1 Muskeln 2 Muskeln 3 Jung, für. Humphries, Rüdiger Brause: Adaptive Systeme, Institut Informatik, WSLee, 2013 Makeig, Mc. Keown, Iragui, Sejnowski 1998 - 58 -