1 EVALUASI Sejarah Evaluasi IR Penelitian awal Membandingkan

1 ~ EVALUASI

Sejarah ~ Evaluasi IR

Penelitian awal � Membandingkan pengindeksan secara manual vs otomatis › Apakah pendekatan otomatis dapat mendekati kualitas manual › Asumsi bahwa pengindeksan manual adalah pendekatan yang benar

TREC Conference � � Text REtrieval Conference Mulai 1992 › Evaluasi IR dalam skala besar › Koleksi data GB Setiap tahun bulan November NIST (National Institute of Standard for Testing) – Information Access Division � Evaluasi IR paling dikenal � � › Mulanya diikuti 25 organisasi peserta › Mulai tahun 2005 diikuti 117 grup dari 22 negara � Laporannya tersedia online di http: //trec. nist. gov

Format Umum TREC � TREC berisi track IR › Cross language, speech recognition, video retrieval, question-answering, interactive IR, terabyte, law, …… � Setiap track menggunakan model yang sama › › Peneliti melakukan training sesuai dengan spresifikasi Peneliti melakukan evaluasi resmi NIST melakukan evaluasi November diadalakan pertemuan �Mengetahui seberapa baik hasil dari suatu grup �Bagaimana grup lain menangani masalah � Pendekatan yang berhasil umumnya akan diulang lagi tahun berikutnya

Forum Lainnya � CLEF › Cross Language Evaluation Forum � NTCIR › Forum evaluasi IR di Asia untuk bahasa Korea, Jepang, dan Cina

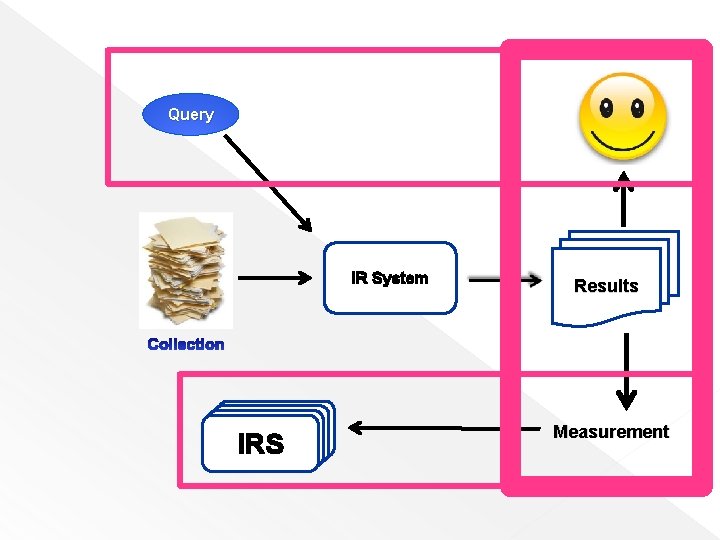

Evaluation as a Process

Query IR System IRS Results Measurement

Mengevaluasi Search Engine � Beberapa aspek yang dapat dievaluasi: › › › Kemudahan untuk menuliskan query Kecepatan dari perolehan informasi Sumber daya yang diperlukan Kecepatan pengindeksan jumlah dokumen/jam) Kemampuan untuk menemukan dokumen � Evaluasi sistem biasanya membandingkan: › Sistem A vs Sistem B

� Ukuran lain yang penting adalah kepuasan user › Isu: �Siapa user yang akan dinilai kepusannya? �Bagaimana teknik untuk mengkuantifikasi kepuasan user?

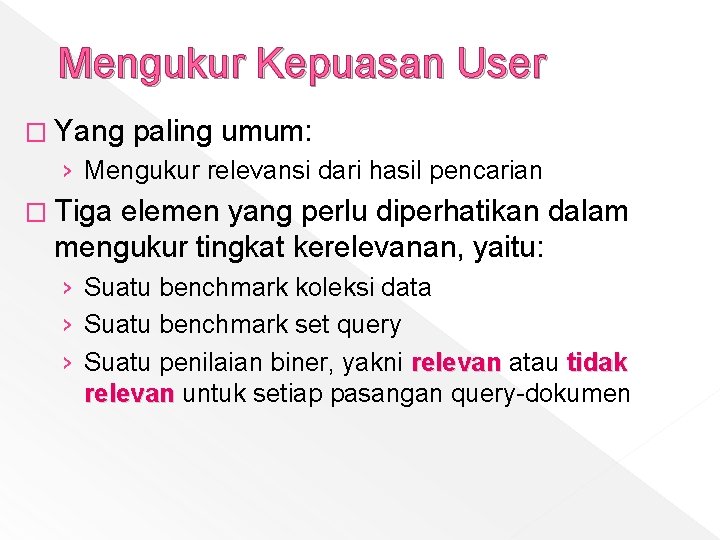

Mengukur Kepuasan User � Yang paling umum: › Mengukur relevansi dari hasil pencarian � Tiga elemen yang perlu diperhatikan dalam mengukur tingkat kerelevanan, yaitu: › Suatu benchmark koleksi data › Suatu benchmark set query › Suatu penilaian biner, yakni relevan atau tidak relevan untuk setiap pasangan query-dokumen relevan

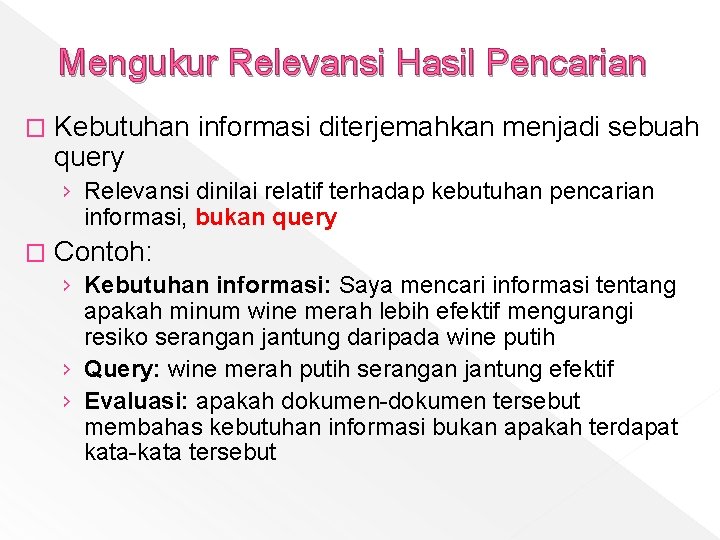

Mengukur Relevansi Hasil Pencarian � Kebutuhan informasi diterjemahkan menjadi sebuah query › Relevansi dinilai relatif terhadap kebutuhan pencarian informasi, bukan query � Contoh: › Kebutuhan informasi: Saya mencari informasi tentang apakah minum wine merah lebih efektif mengurangi resiko serangan jantung daripada wine putih › Query: wine merah putih serangan jantung efektif › Evaluasi: apakah dokumen-dokumen tersebut membahas kebutuhan informasi bukan apakah terdapat kata-kata tersebut

Benchmark Relevansi yang Standar � Menggunakan koleksi dokumen benchmark Reuters, AP, dan lain-lain � “Retrieval Task” diberikan sebagai query � Para ahli menandai, untuk setiap query dan document, Relevant atau Irrelevant › Atau paling sedikit untuk subset

Kerelevanan � Relevan sulit untuk didefinisikan � Suatu dokumen dinilai berguna untuk suatu query › › Siapa yang menilai? Apa yang berguna? Manusia tidak konsisten Penilaian bergantung pada dokumen dan query

Metrik Evaluasi

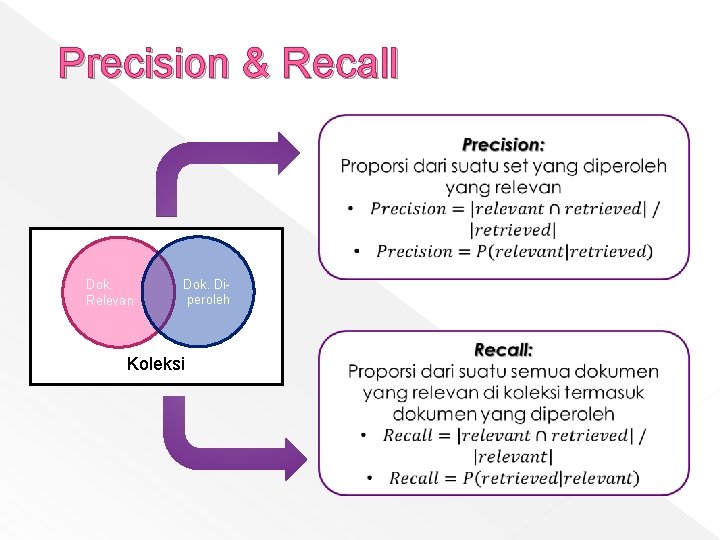

Precision & Recall Dok. Relevan Dok. Diperoleh Koleksi

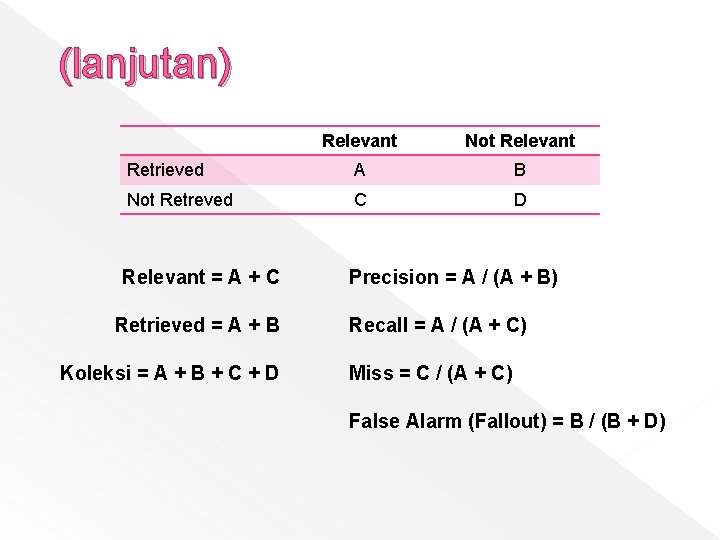

(lanjutan) Relevant Not Relevant Retrieved A B Not Retreved C D Relevant = A + C Precision = A / (A + B) Retrieved = A + B Koleksi = A + B + C + D Recall = A / (A + C) Miss = C / (A + C) False Alarm (Fallout) = B / (B + D)

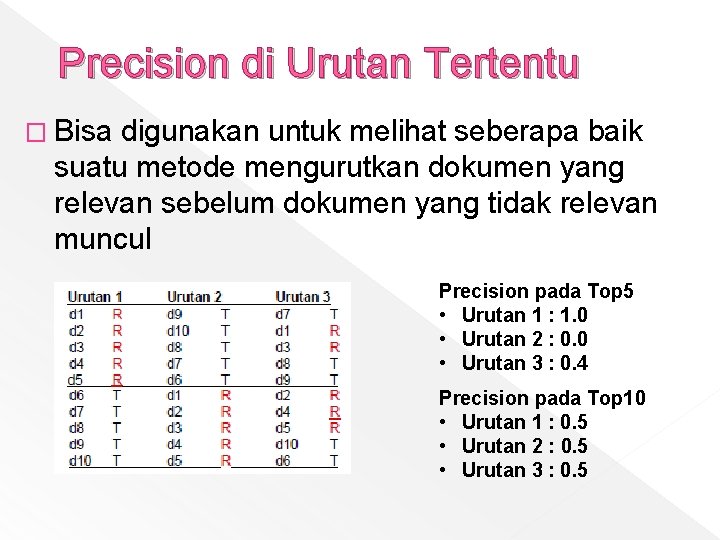

Precision di Urutan Tertentu � Bisa digunakan untuk melihat seberapa baik suatu metode mengurutkan dokumen yang relevan sebelum dokumen yang tidak relevan muncul Precision pada Top 5 • Urutan 1 : 1. 0 • Urutan 2 : 0. 0 • Urutan 3 : 0. 4 Precision pada Top 10 • Urutan 1 : 0. 5 • Urutan 2 : 0. 5 • Urutan 3 : 0. 5

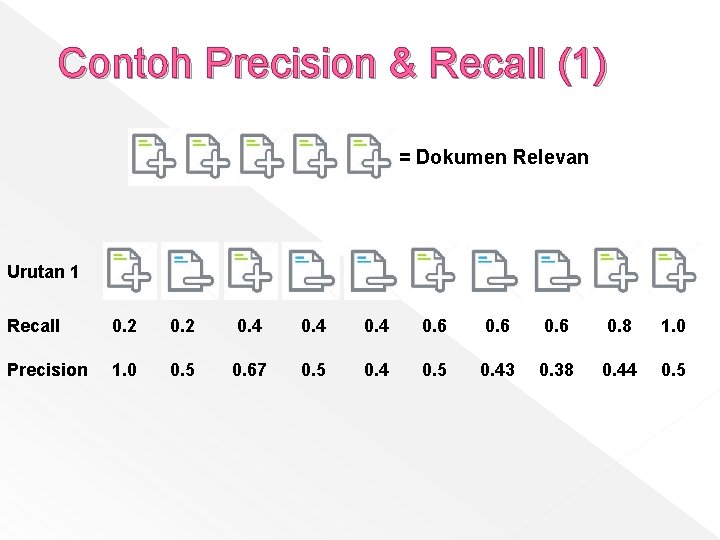

Contoh Precision & Recall (1) = Dokumen Relevan Urutan 1 Recall 0. 2 0. 4 0. 6 0. 8 1. 0 Precision 1. 0 0. 5 0. 67 0. 5 0. 43 0. 38 0. 44 0. 5

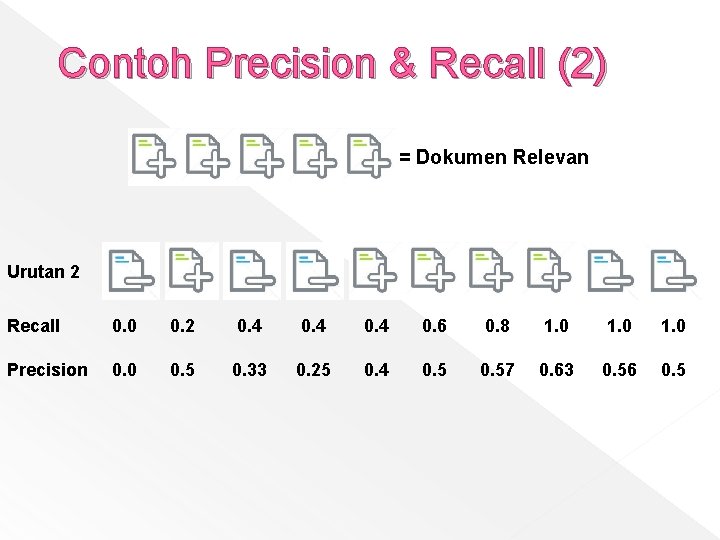

Contoh Precision & Recall (2) = Dokumen Relevan Urutan 2 Recall 0. 0 0. 2 0. 4 0. 6 0. 8 1. 0 Precision 0. 0 0. 5 0. 33 0. 25 0. 4 0. 57 0. 63 0. 56 0. 5

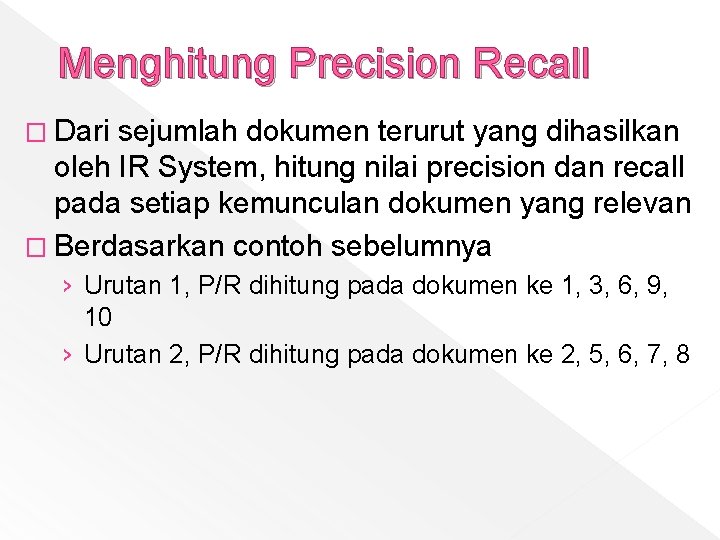

Menghitung Precision Recall � Dari sejumlah dokumen terurut yang dihasilkan oleh IR System, hitung nilai precision dan recall pada setiap kemunculan dokumen yang relevan � Berdasarkan contoh sebelumnya › Urutan 1, P/R dihitung pada dokumen ke 1, 3, 6, 9, 10 › Urutan 2, P/R dihitung pada dokumen ke 2, 5, 6, 7, 8

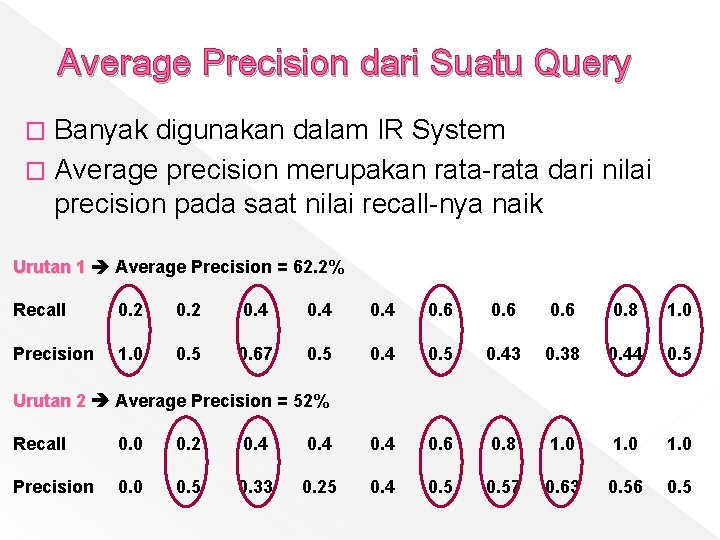

Average Precision dari Suatu Query Banyak digunakan dalam IR System � Average precision merupakan rata-rata dari nilai precision pada saat nilai recall-nya naik � Urutan 1 Average Precision = 62. 2% Recall 0. 2 0. 4 0. 6 0. 8 1. 0 Precision 1. 0 0. 5 0. 67 0. 5 0. 43 0. 38 0. 44 0. 5 Urutan 2 Average Precision = 52% Recall 0. 0 0. 2 0. 4 0. 6 0. 8 1. 0 Precision 0. 0 0. 5 0. 33 0. 25 0. 4 0. 57 0. 63 0. 56 0. 5

Latihan = Dokumen Relevan Soal: • Tentukan nilai precision dan recall untuk masing-masing kemunculan dokumen! • Berapa nilai average precision untuk Top-5 dan Top-10 dari urutan perolehan dokumen di atas?

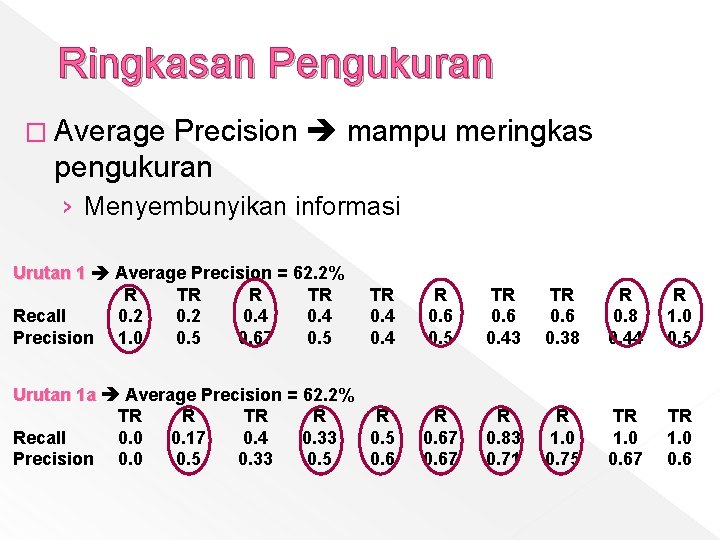

Ringkasan Pengukuran � Average Precision mampu meringkas pengukuran › Menyembunyikan informasi Urutan 1 Average Precision = 62. 2% R TR Recall 0. 2 0. 4 Precision 1. 0 0. 5 0. 67 0. 5 TR 0. 4 R 0. 6 0. 5 TR 0. 6 0. 43 TR 0. 6 0. 38 R 0. 8 0. 44 R 1. 0 0. 5 Urutan 1 a Average Precision = 62. 2% TR R R Recall 0. 0 0. 17 0. 4 0. 33 0. 5 Precision 0. 0 0. 5 0. 33 0. 5 0. 6 R 0. 67 R 0. 83 0. 71 R 1. 0 0. 75 TR 1. 0 0. 67 TR 1. 0 0. 6

Ringkasan Pengukuran � Orang cenderung menginginkan ringkasan dari pengukuran › Precision pada suatu tingkat retrieval yang tetap �Paling tepat untuk web search �Orang menginginkan hasil terbaik pada halaman ke-1 atau ke-2

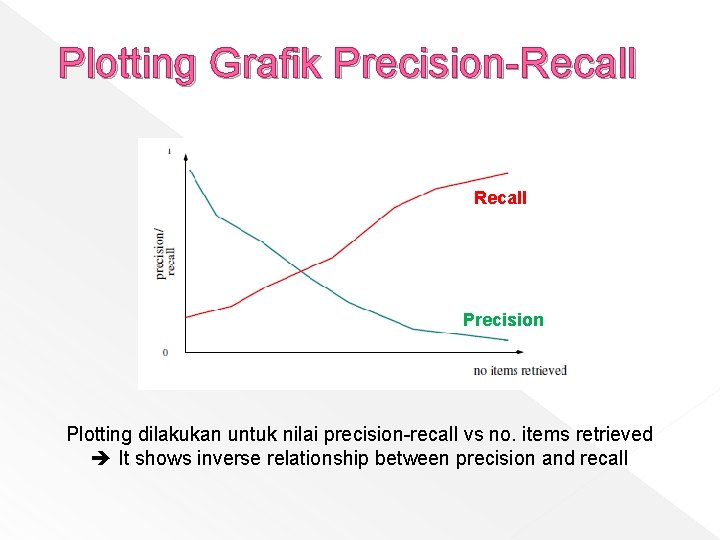

Plotting Grafik Precision-Recall Precision Plotting dilakukan untuk nilai precision-recall vs no. items retrieved It shows inverse relationship between precision and recall

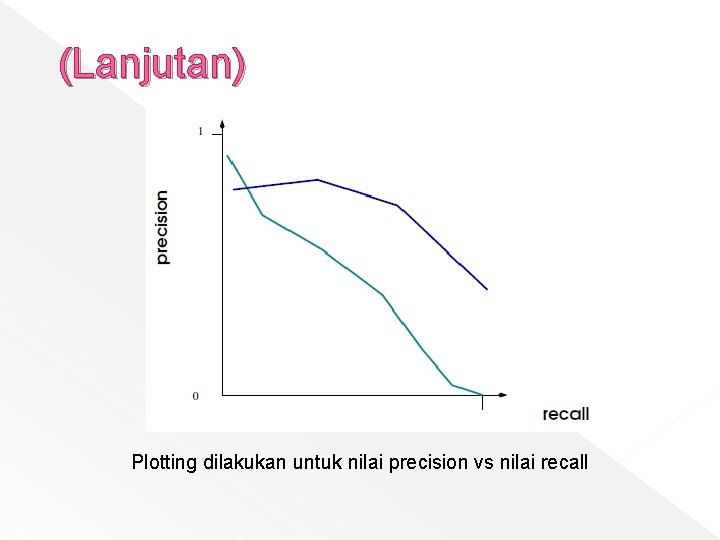

(Lanjutan) Plotting dilakukan untuk nilai precision vs nilai recall

Waktu pencarian tidak diperhatikan � Satu dokumen relevan yang tidak diperoleh bisa menyebabkan hilangnya informasi yang dibutuhkan � Perlu untuk melihat masing-masing (satu per satu) dokumen yang relevan � Contoh : pattent search Precision � Recall Precision vs Recall Critical Task Waktu pencarian sangat terbatas � Jumlah dokumen relevan yang sedikit sudah menjawab kebutuhan pencarian informasi � Jumlah dokumen yang banyak memungkinkan informasi redundan � Contoh : web search for factual information �

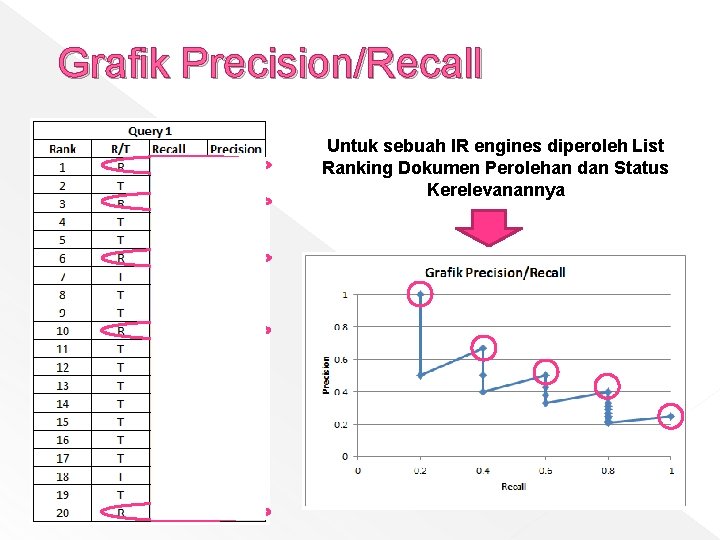

Grafik Precision/Recall Untuk sebuah IR engines diperoleh List Ranking Dokumen Perolehan dan Status Kerelevanannya

Definisi Formal � Precision pada Ranking Tertentu : P(100) � Precision pada Nilai Recall Tertentu : P(R=0. 2) � Precision pada Dokumen Relevan Terakhir : P(last_relevant) � Recall pada ranking tertentu : R(100) � Recall pada Nilai Precision Tertentu : R(P=0. 1)

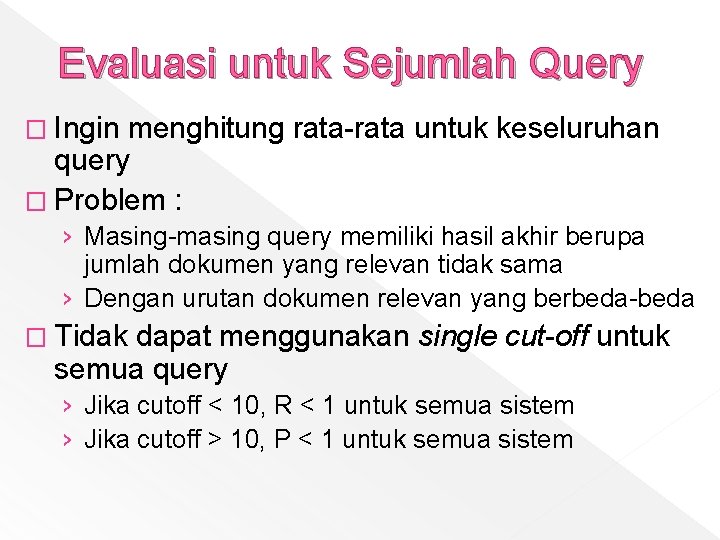

Evaluasi untuk Sejumlah Query � Ingin menghitung rata-rata untuk keseluruhan query � Problem : › Masing-masing query memiliki hasil akhir berupa jumlah dokumen yang relevan tidak sama › Dengan urutan dokumen relevan yang berbeda-beda � Tidak dapat menggunakan single semua query cut-off untuk › Jika cutoff < 10, R < 1 untuk semua sistem › Jika cutoff > 10, P < 1 untuk semua sistem

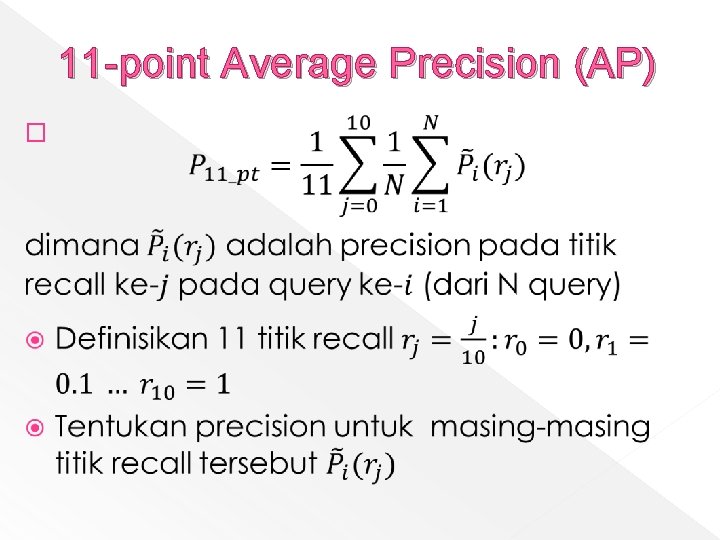

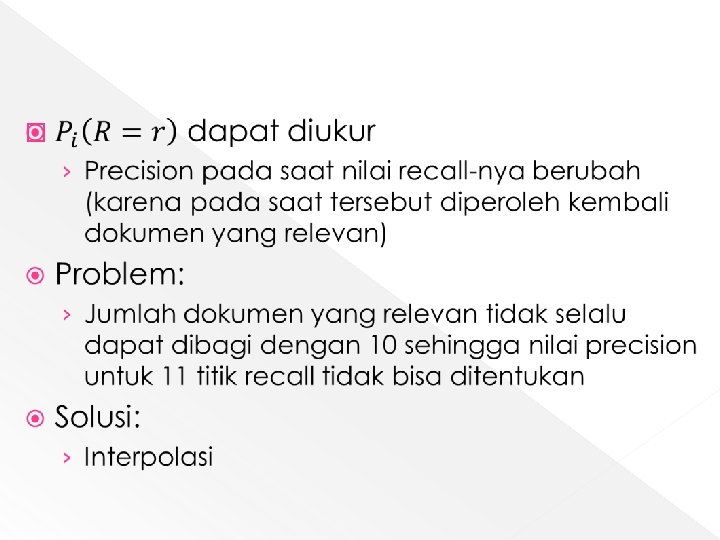

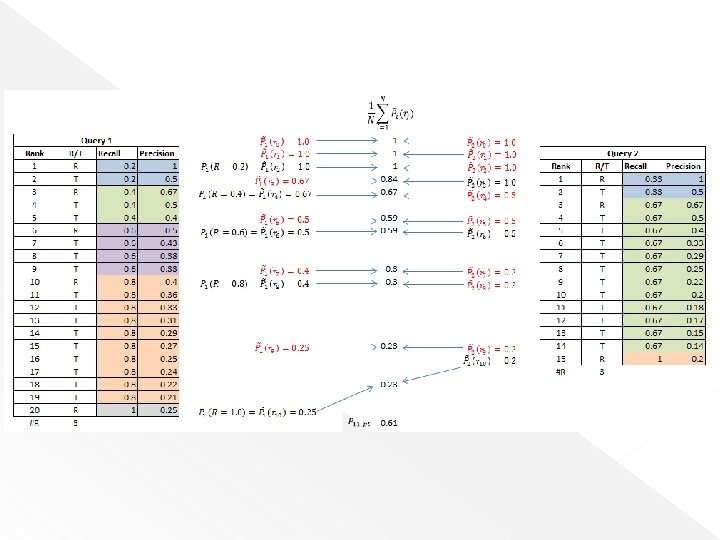

11 -point Average Precision (AP) �

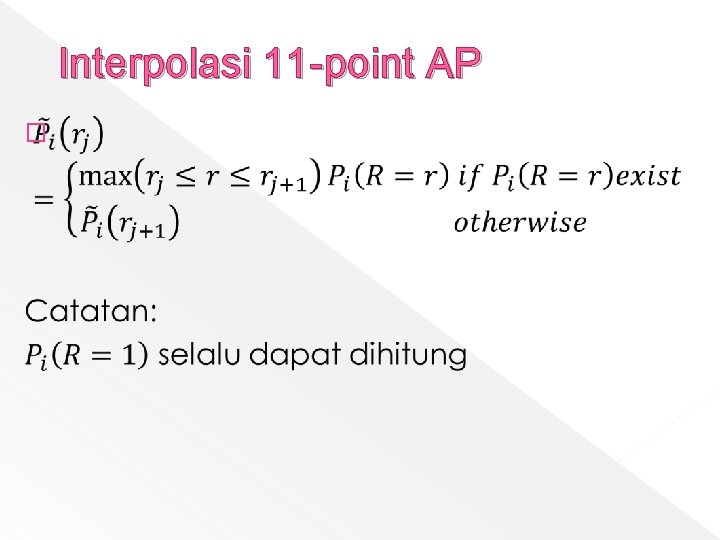

Interpolasi 11 -point AP �

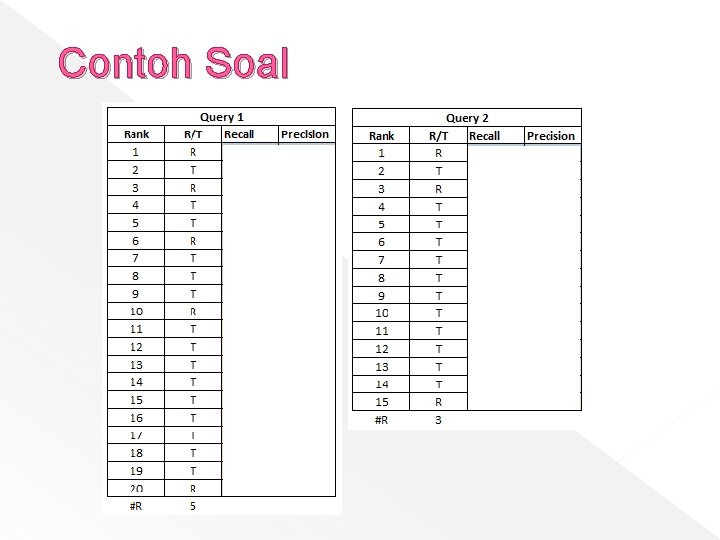

Contoh Soal

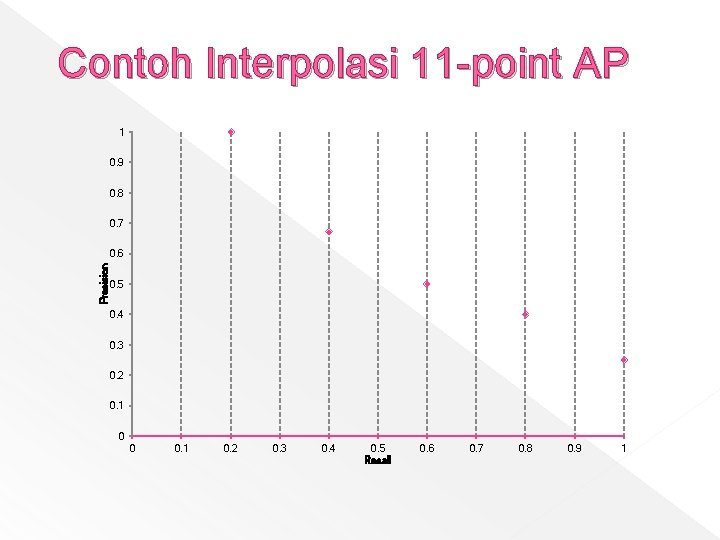

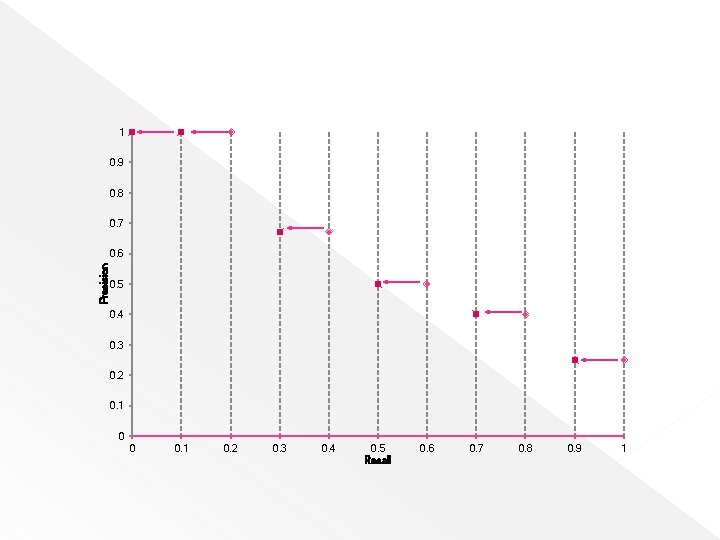

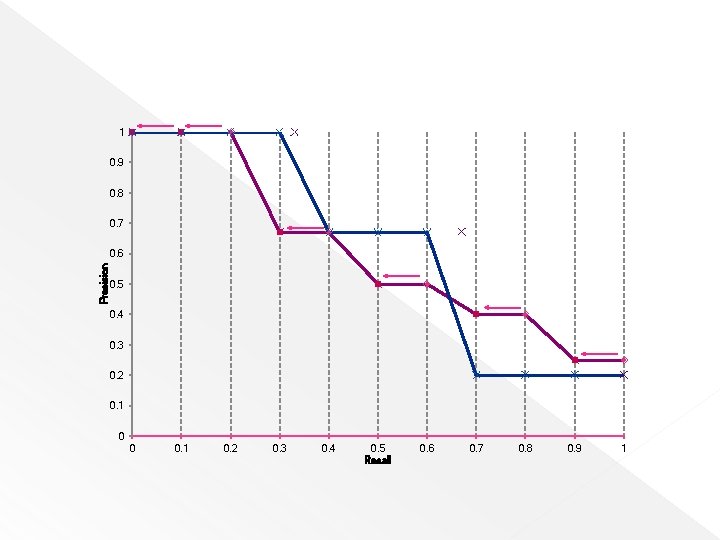

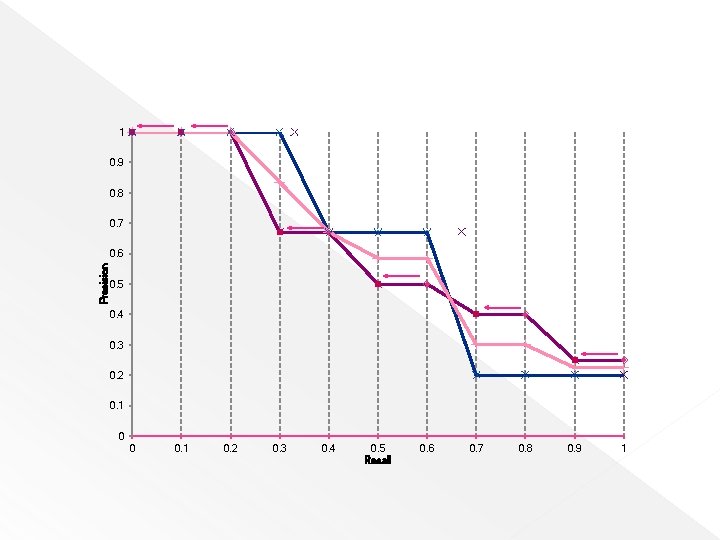

Contoh Interpolasi 11 -point AP 1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

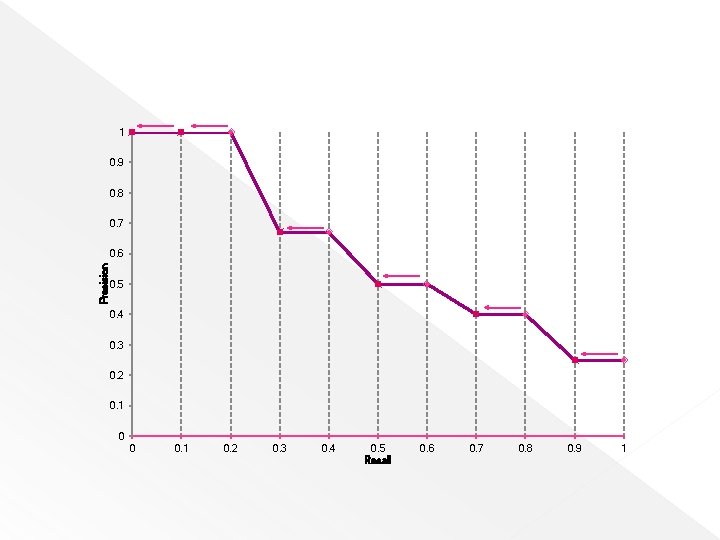

1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

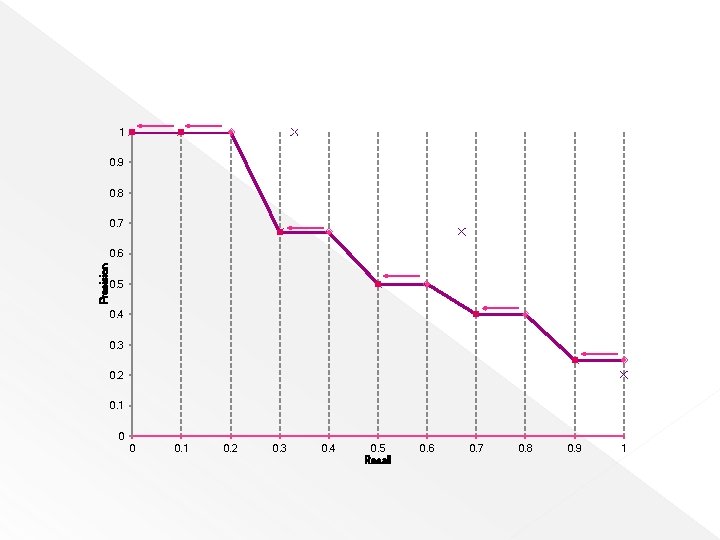

1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

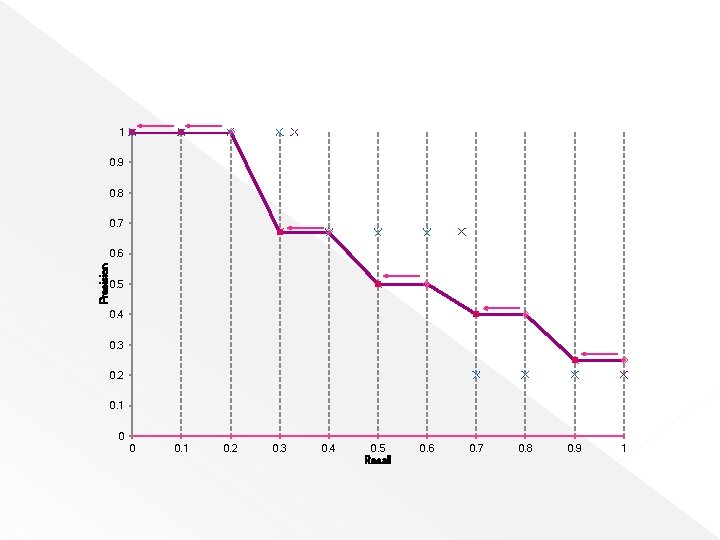

1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

1 0. 9 0. 8 0. 7 Precision 0. 6 0. 5 0. 4 0. 3 0. 2 0. 1 0 0 0. 1 0. 2 0. 3 0. 4 0. 5 Recall 0. 6 0. 7 0. 8 0. 9 1

Pengukuran Evaluasi Yang Lain

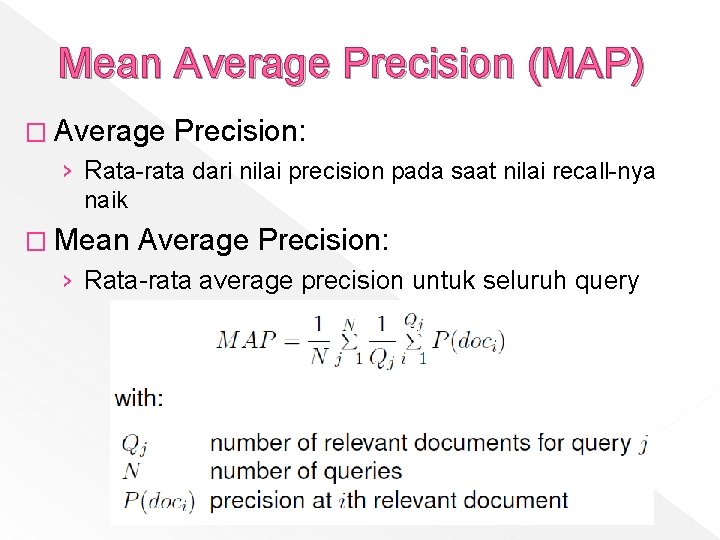

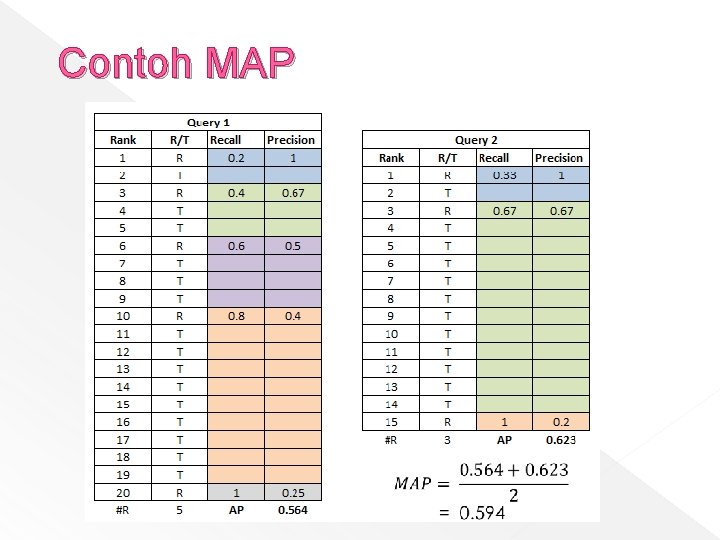

Mean Average Precision (MAP) � Average Precision: › Rata-rata dari nilai precision pada saat nilai recall-nya naik � Mean Average Precision: › Rata-rata average precision untuk seluruh query

Contoh MAP

R-Precision � Ide : › menghasilkan nilai tunggal untuk perangkingan � Cara : › Menghitung precision pada posisi ke-R dimana R adalah total jumlah dokumen yang relevan.

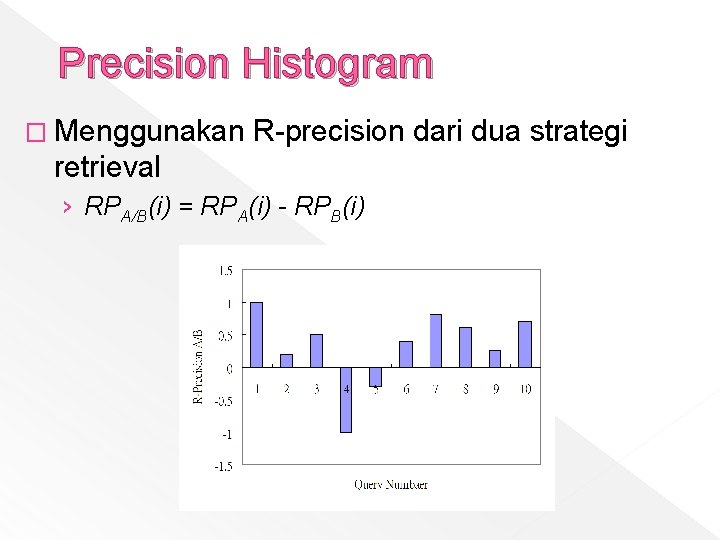

Precision Histogram � Menggunakan R-precision dari dua strategi retrieval › RPA/B(i) = RPA(i) - RPB(i)

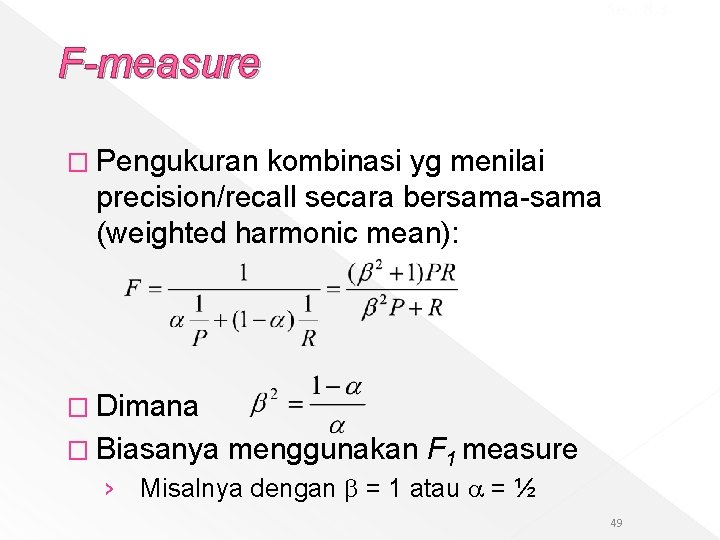

Sec. 8. 3 F-measure � Pengukuran kombinasi yg menilai precision/recall secara bersama-sama (weighted harmonic mean): � Dimana � Biasanya menggunakan F 1 measure › Misalnya dengan = 1 atau = ½ 49

Membuat Koleksi Pengetesan untuk Evaluasi IR

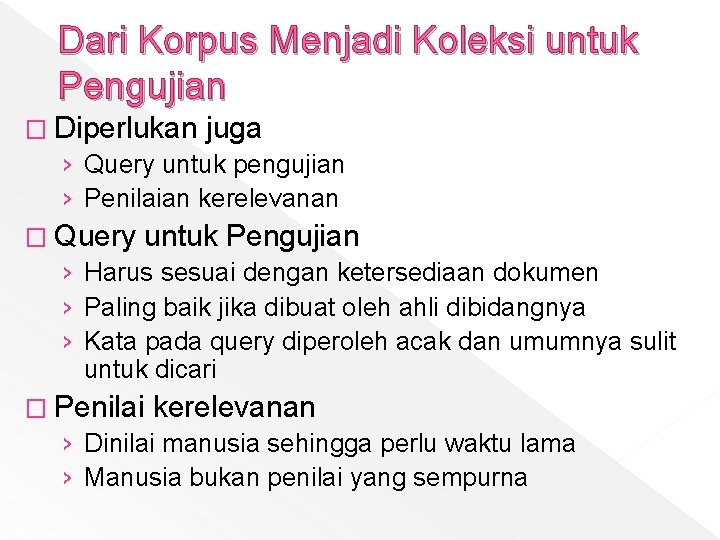

Dari Korpus Menjadi Koleksi untuk Pengujian � Diperlukan juga › Query untuk pengujian › Penilaian kerelevanan � Query untuk Pengujian › Harus sesuai dengan ketersediaan dokumen › Paling baik jika dibuat oleh ahli dibidangnya › Kata pada query diperoleh acak dan umumnya sulit untuk dicari � Penilai kerelevanan › Dinilai manusia sehingga perlu waktu lama › Manusia bukan penilai yang sempurna

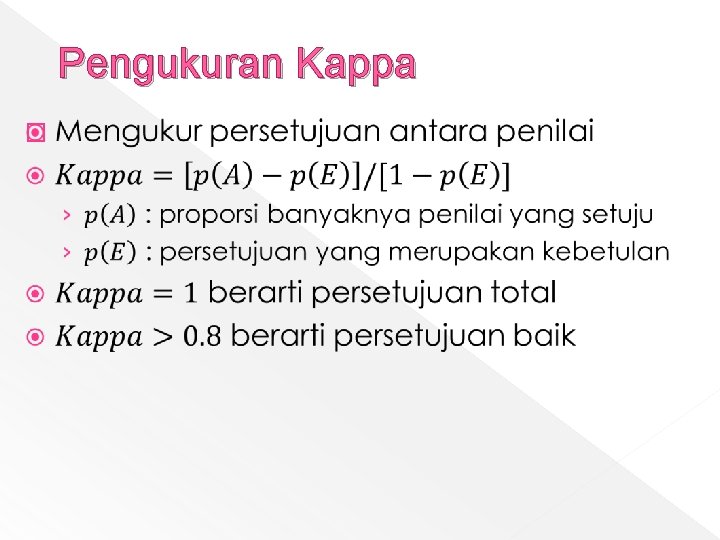

Pengukuran Kappa �

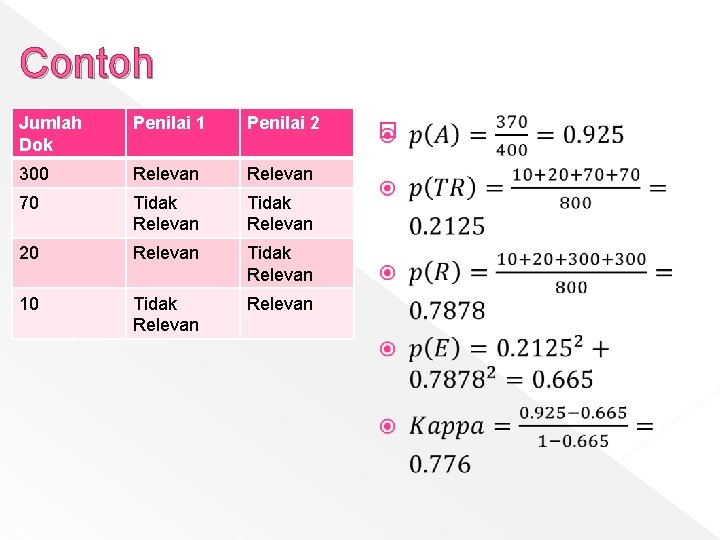

Contoh Jumlah Dok Penilai 1 Penilai 2 300 Relevan 70 Tidak Relevan 20 Relevan Tidak Relevan 10 Tidak Relevan �

Terima kasih

- Slides: 54